一、介绍

集成学习(Ensemble Learning)是一种机器学习技术,通过结合多个学习器(例如决策树、神经网络、支持向量机等)的预测结果,来达到更好的分类或回归预测性能。集成学习可以通过降低模型的方差,提高模型的稳定性和泛化性能,从而改善预测结果。常见的集成学习方法包括Bagging,Boosting,Stacking等。

二、原理

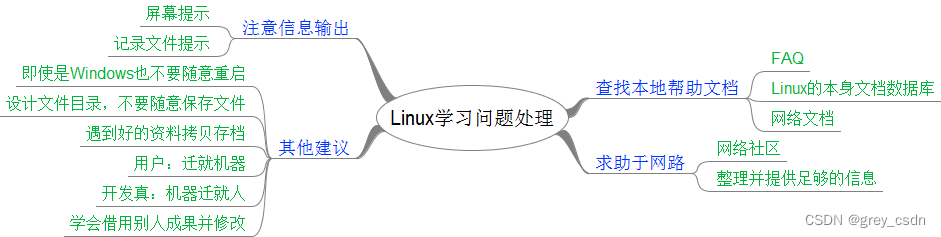

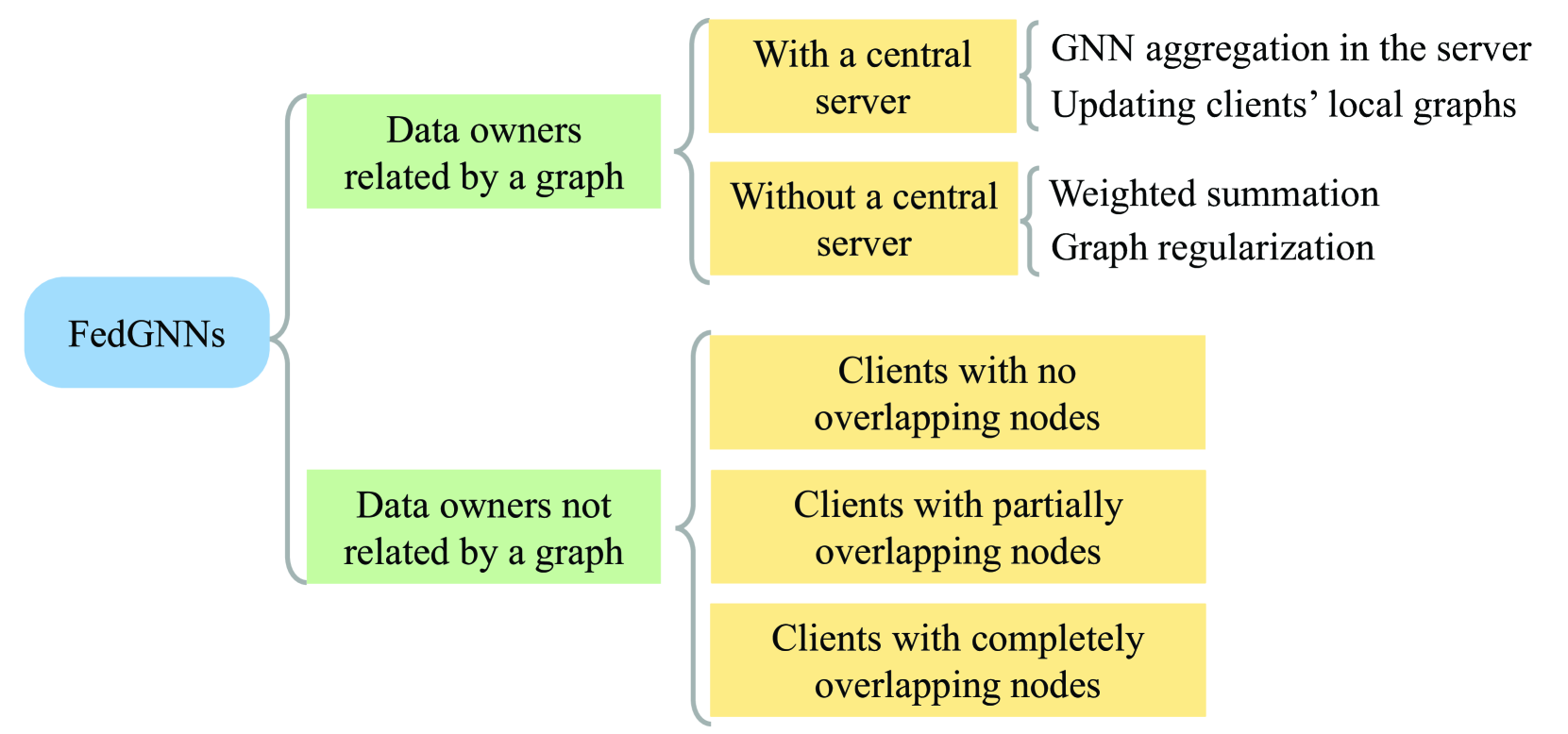

图中显示出集成学习的一般结构:先产生一组"个体学习器" (individual learner) ,再用某种策略将它们结合起来.个体学习器通常由一个现有的学习算法从训练数据产生,例如 决策树算法、 BP 神经网络算法等,此时集成中只包含同种类型的个体学习器,例如"决策树集成"中全是决策树?"神经网络集成"中全是神经网络,这样的集成是"同质"的 (homogeneous).同质集成中的个体学习器亦称"基学习器" (base learner),相应的学习算法称为"基学习算法" (base learning algorithm).。

集成也可包含不同类型的个体学习器,例如同时包含决策树和神经网络,这样的集成是"异质"的(heterogenous) .异质集成中的个体学习器由不同的学习算法生成,这时就不再有基学习算法;相应的,个体学习器一般不称为基学习器,常称为"组件学习器" (component learner)或直接称为个体学习器。

三、步骤

-

收集和准备数据集:集成模型需要多个基本模型的预测结果才能进行训练和预测,因此需要准备大量的数据集。

-

选择合适的集成方法:包括 bagging、boosting、stacking、blending等方法。

-

选择合适的基本模型:基本模型应该选用不同的模型类型和参数设置,以提供更多的多样性。

-

训练基本模型:基本模型的训练应该采用不同的数据集采样和参数设置,以增加多样性。

-

组合基本模型:将训练得到的基本模型组合起来,得到集成模型。

-

评估集成模型:使用测试集对集成模型进行评估,比较其性能和单个基本模型的性能。

-

调整集成模型参数:如果集成模型的性能不尽如人意,可以根据测试结果调整模型的参数。

-

在新数据上进行预测:使用训练好的集成模型对新数据进行预测。

参考:

集成学习简介

集成学习(Ensemble Learning) - 知乎

https://www.cnblogs.com/zongfa/p/9304353.html