https://arxiv.org/pdf/2202.07256.pdf

摘要

图神经网络以其处理实际应用中广泛存在的图形数据的强大能力,受到了广泛的研究关注。然而,随着社会越来越关注数据隐私,GNN需要适应这种新常态。这导致了近年来联邦图神经网络(FedGNNs)研究的快速发展。虽然有前途,这个跨学科的领域是非常具有挑战性的感兴趣的研究人员进入。缺乏对这一主题的深入调查只会加剧这一问题。在本文中,我们弥合这一差距,提供了一个全面的调查这一新兴领域。我们提出了一个独特的3层分类FedGNNs文献提供了一个清晰的视图GNNs如何在联邦学习(FL)的背景下工作。 它通过分析图形数据如何在FL设置中表现自己,GNN训练如何在不同的FL系统架构下执行,以及图形数据在数据筒仓上重叠的程度,以及GNN聚合如何在各种FL设置下执行,将现有的工作纳入透视图。通过讨论现有工作的优点和局限性,我们设想了未来的研究方向,可以帮助建立更强大,动态,高效和可解释的FedGNNs。

1 引言

图神经网络(GNNs)是处理图结构数据的强大工具。(2020年)。图结构数据是通过图拓扑连接的数据样本。例如,分子数据是图形结构化数据,其中原子作为图形中的节点,并且连接它们的键作为图形中的边。GNN可以通过考虑从底层图拓扑中提取的邻域信息来提高节点嵌入的质量。它们已被广泛应用于各种应用中,包括药物发现Gilmer et al.(2017),神经科学Ding等人(2021),社交网络汉密尔顿et al.(2017),knowledge graphs Chen et al.(2020),推荐系统Ying et al.(2018)和交通流预测Cui et al.(2019年)。

训练良好的GNN需要大量的训练图数据,这些数据在实践中可能分布在不同的机构或数据所有者中。由于GDPR(2018)的隐私问题,这些数据所有者可能不愿意共享数据,这导致了数据隔离的问题。此外,由不同数据所有者存储的图数据的分布通常是非相同分布的(非IID),这增加了数据隔离的挑战。这样的非IID属性可以表现为跨数据所有者的图结构或节点特征分布的差异。与全局图分布相比,数据所有者中的子图也可能有偏差。

联邦学习(FL),分布式协作机器学习范式,是一个很有前途的方法来处理这个数据隔离的挑战。它使本地模型能够相互受益,同时保持本地数据的私密性。(2021年)。此外,在存在非IID数据的情况下学习个性化FL模型的问题已经被广泛研究。(2021年)。在FL中,FL参与者仅共享模型参数或嵌入特征,而不暴露潜在敏感的本地数据。这种体系结构设计与各种加密技术相结合,可以有效地保护本地数据隐私。

这两种发展趋势的汇合激发了近年来联邦图神经网络(FedGNNs)领域的出现。(二零二零年),于二零二一年取得快速发展。一个立场文件张等人。(2021b)通过设想四种可能的FedGNN场景总结了这一趋势,这些场景基于图数据如何在数据所有者之间划分。由于当时没有广泛发现这些设想情景的技术研究,这些情景之间的界限存在重叠。例如,当重建由不同数据所有者存储的图之间的缺失链接时,“水平图内FL”可能与“图结构化FL”混淆。如果每个数据所有者只有一个图,则它也可以与“图间FL”混淆。到目前为止,还没有对FedGNN跨学科主题进行有见地的调查,以指导感兴趣的研究人员进入这个充满希望但具有挑战性的领域。

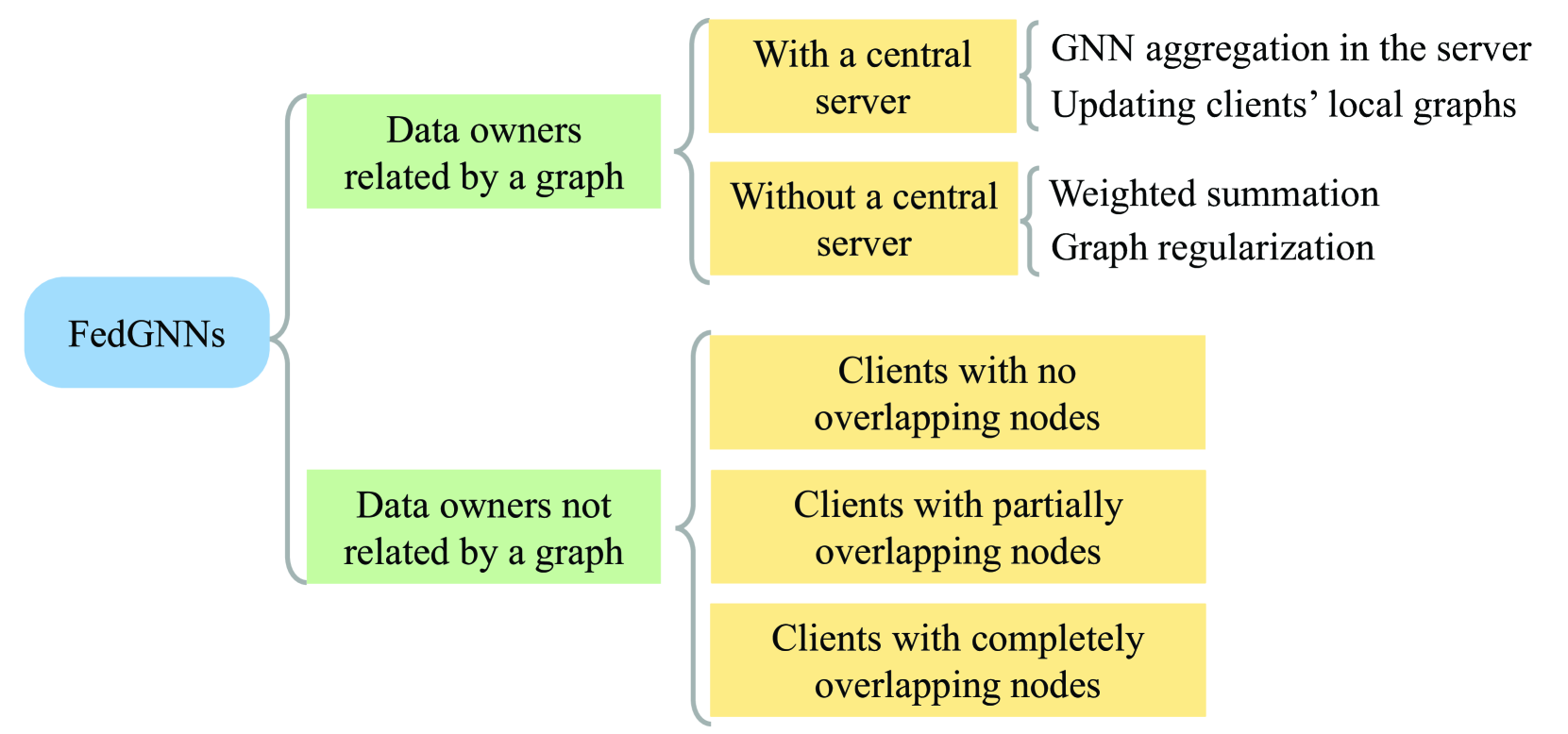

在本文中,我们通过对FedGNN现有文献进行全面回顾来弥合这一差距。我们提出了一个多层次的分类法,

首先划分现有的作品根据图形数据之间的关系,FL数据所有者,

然后根据GNN训练是如何在不同的FL系统架构和程度的图形数据重叠的数据筒仓,

最后根据GNN聚合是如何在各种FL设置下进行。

它提供了一个紧密集成的视图,以帮助读者了解这两个领域如何相互补充。我们分析了现有FedGNN方法的优点和局限性,并讨论了未来有前途的研究方向,可以导致更强大,动态,高效和可解释的FedGNN。

2 术语和分类

2.1 术语

在FL中,如果具有敏感本地数据的数据所有者由称为服务器的中央实体协调,则可以将其称为客户端。此设置称为集中FL。在数据所有者在没有中央服务器的情况下直接彼此通信的情况下,该设置被称为分散式FL。

GNN和FL都涉及“聚合”操作。GNN上下文中的聚合通过聚合来自其相邻节点的信息来更新给定节点的嵌入。聚合操作可以是均值、加权平均或最大/最小池化方法。FL上下文中的聚合通过遵循给定FL算法(例如,McMahan et al.(2017))。为了消除GNN和FL中的聚合操作的歧义,我们在本文中分别将它们称为“GNN聚合”和“FL聚合”。

2.2 建议的3层FedGNN分类

5未来的研究方向

As an emerging field, FedGNN research is starting to gain traction. Nevertheless, in order for this technology to be able to deal with challenges in real-world applications, many problems remain to be addressed. Here, we highlight six of them which hold promising opportunities.

作为一个新兴领域,FedGNN研究开始获得吸引力。然而,为了使该技术能够应对现实世界应用中的挑战,仍有许多问题有待解决。在这里,我们强调其中六个具有良好机会的国家。

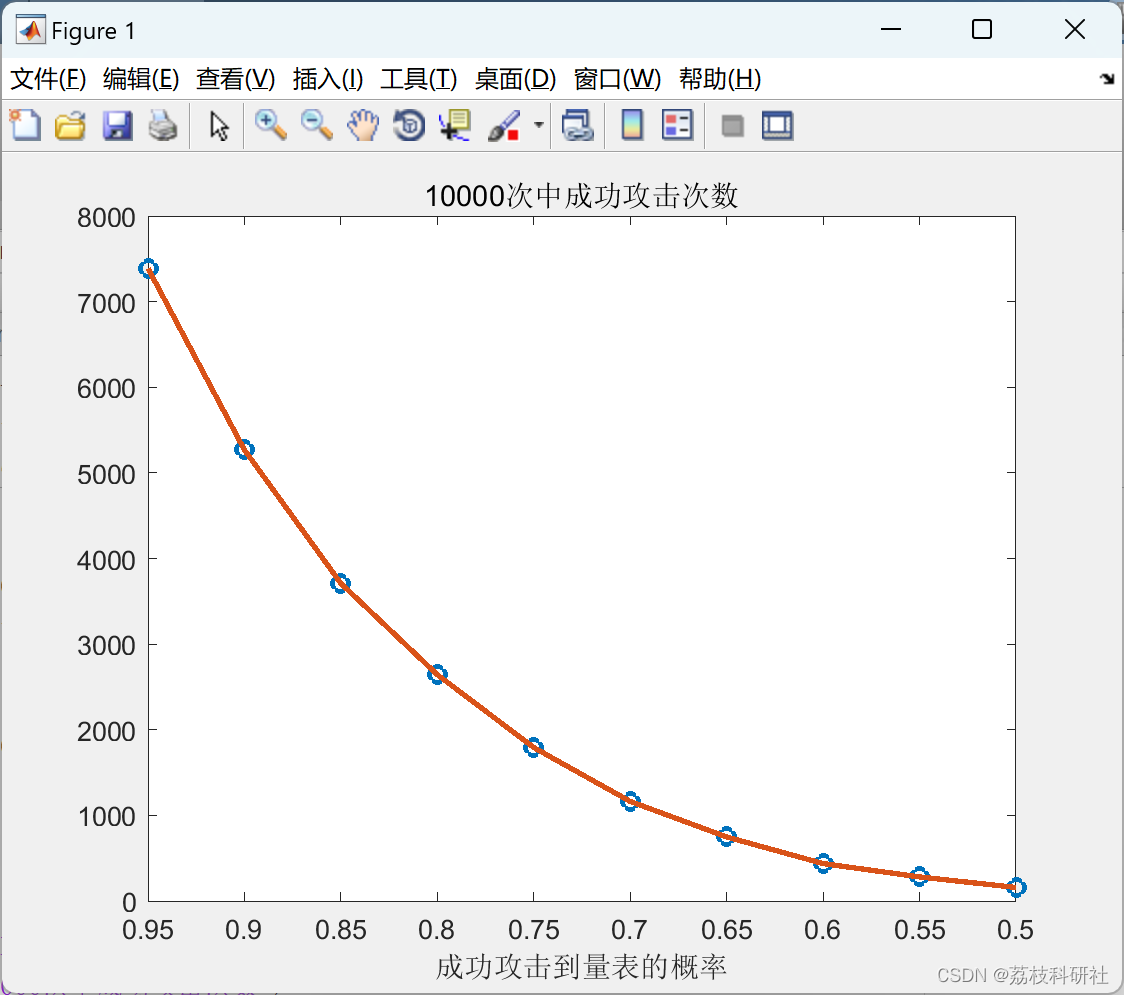

强大的FedGNNs抵御恶意攻击。

通过共享节点嵌入、图拓扑和模型参数,FedGNNs具有较大的攻击面。虽然一些作品试图通过利用差分隐私来解决这个问题,Peng等人。(2021 a); Zhang等人(2021 a); Wu等人(2021)或加密方法,例如Secure Multi-Party Computation Chen et al.(2021 b); Zhou等人(2020),同态加密Ni et al.(2021),Diffie-HellmanKey交换Pei等人。(2021)或秘密共享Rizk和Sayed(2021); Zheng等人(2021),它们旨在防范半诚实的攻击者。还需要进一步的研究来探索如何使FedGNNs在面对恶意隐私攻击时更加强大。

用于动态图形数据的FedGNNs。

动态图形数据中的图形拓扑或节点特征可以随时间改变。在这种情况下,时间信息需要在GNN训练期间考虑。从每个FL客户端内的动态图形数据中提取时间特征的工作开始出现孟等人。(2021); Zhang等人(2021a)。然而,在由图相关的FL客户端的设置中,客户端之间的关系也可以随着时间的推移而演变。因此,需要探索其中FL客户端之间的边权重和连接性是可学习的FedGNN方法。

用于大规模图形数据的高效FedGNNs。

现有的FedGNN通常使用小规模分布式数据集进行研究。因此,通信效率尚未得到充分考虑。然而,为了将FedGNN扩展到大规模图形数据(例如,知识图),通信开销可能是重要的瓶颈,因为数据所有者通常采用具有大量要传输的模型参数的多层GNN模型。

可解释的FedGNN,以提高可解释性。

作品对GNNs的可解释性Yuan et al.(2020)和FL Li et al.(2021年)开始出现。FedGNN涉及复杂的模型结构和训练过程。因此,在这种情况下实现可解释性甚至更具挑战性。将可解释性纳入FedGNN需要共同考虑相关利益相关者对可解释性的需求,同时平衡保护隐私和有效训练模型的目标。

分散式FedGNNs中的多跳邻域聚合。

在现有的分散式FedGNN研究中,仅聚合1跳邻居的模型参数以产生针对每个数据所有者的个性化FL模型。虽然这种方法简化了模型结构,但它限制了FedGNN利用数据所有者间图中丰富的邻域信息的能力。新技术使FedGNN能够超越这一限制,同时仍然保持模型结构和训练过程相当简单是可取的。

用于基准测试的真实分布式图形数据集。

现有的FedGNN研究工作主要是用合成的分布式图数据进行评估。这些是从GNN基准数据集生成的,如Cora,PubMed和Citeseer。为了将它们重新关联到FL设置中,当前的做法是将整个图划分为多个子图,然后将其分配给不同的数据所有者。以这种方式分配给每个数据所有者的子图的大小往往很小。在He et al.(2021a),已经提出了一个支持3个GNN模型和2个FL聚合方法的开源平台。它收集了36个图形数据集,并将它们划分为分布式孤岛,形成了一个有前途的FedGNN基准测试工具。然而,FedGNN领域的长期发展仍然需要建立现实的和大规模的联邦图数据集,以支持在接近实际应用的设置下的实验评估。 真实世界的图数据集,例如大脑连接组数据集、分子数据集、推荐系统和知识图,可以是有用的起点。