论文作者 | Haiping Wang, Haiping Wang,Haiping Wang,etal

论文来源 | CVPR2023

文章解读 | William

1 摘要

之前的多视图配准方法依赖于穷举成对配准构造密集连接的位姿图,并在位姿图上应用迭代重加权最小二乘(IRLS)计算扫描位姿。但是,构造一个密集连接图十分耗时且包含大量离群边,使得后续的IRLS很难找到准确的位姿。

为了解决上述问题,提出使用神经网络来估计扫描对之间的重叠率,并构建稀疏且可靠的姿态图。然后,在IRLS中设计了一种新的历史重加权函数,该函数对图上的离群边具有较强的鲁棒性。

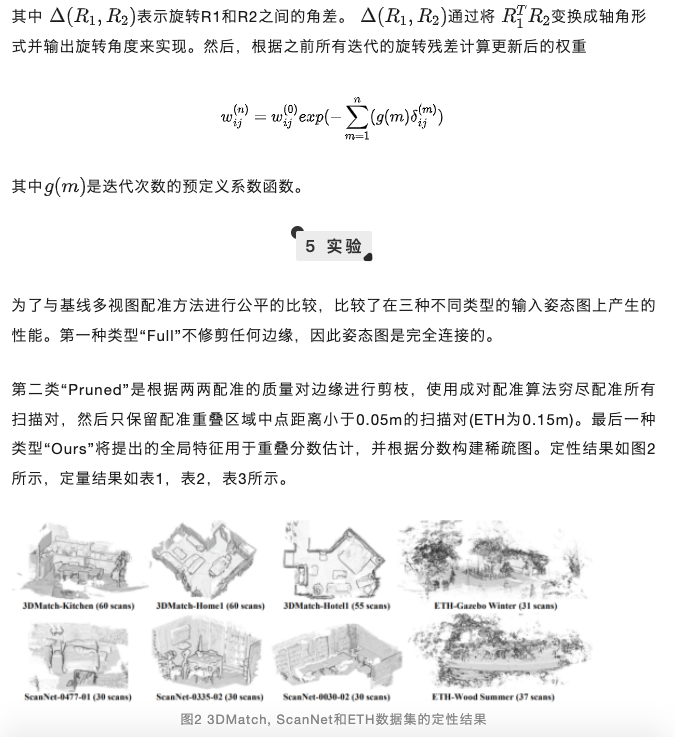

与现有的多视图配准方法相比,本文方法在3DMatch数据集上的配准召回率提高了11%,在ScanNet数据集上的配准误差降低了13%,同时所需的成对配准减少了70%。消融实验证明了本文方法的有效性。源代码开源在:https://github.com/WHUUSI3DV/SGHR

2 主要贡献

1.学习了输入姿态图的良好初始化,避免了穷举成对配准并降低了离群比

2.提出了一种新的历史重加权函数,使IRLS方案的姿态校正具有稳定的收敛性

3.在3DMatch/3DLoMatch、ScanNet和ETH三个广泛使用的基准数据集上评估本文方法,均取得了较为先进的效果。

3 网络结构

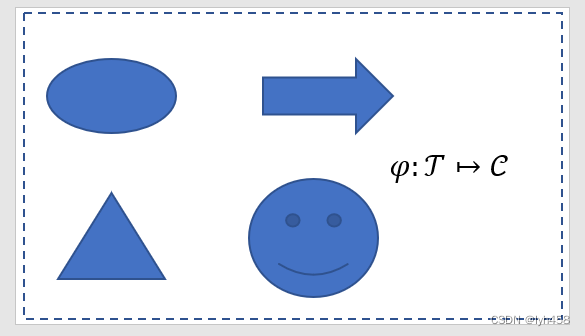

对于一组在相同3D场景中未对齐的扫描点集P=\{P_{i}|i=1,...,N\},多视图配准的目标是恢复底层全局扫描姿态

,应用如图1所示网络结构。

图1 网络结构

6 结论

本文提出了一种新的多视点云配准方法。该方法的关键是基于学习的稀疏姿态图构建,该方法可以估计两次扫描之间的重叠比,能够选择高重叠的扫描对来构建稀疏且可靠的图。

在此基础上,提出了一种新的历史加权函数,提高了IRLS方案对异常值的鲁棒性,并对姿态校正有较好的收敛性。所提出的方法在室内和室外数据集上都具有最先进的性能,而且配对配准的次数要少得多。

来源:深蓝学堂EDU