目录

一、引言

1.1 神经网络的发展历程

1.2 图神经网络的出现

二、深度卷积图神经网络的基本概念

2.1 图的表示

2.2 图卷积神经网络

2.3 深度卷积图神经网络

三、深度卷积图神经网络的应用

3.1 图像分类

3.2 图像分割

3.3 图像生成

四、深度卷积图神经网络的优缺点

4.1 优点

4.2 缺点

五、结论

六、参考文献

一、引言

1.1 神经网络的发展历程

神经网络是一种模拟人类神经系统的计算模型,它由许多个神经元组成,每个神经元接收来自其他神经元的输入,并根据输入计算出输出。神经网络的发展历程可以追溯到上世纪50年代,当时人们开始研究人工神经元和神经网络的模型。随着计算机技术的发展,神经网络逐渐成为了一种重要的机器学习方法。

1.2 图神经网络的出现

传统的神经网络主要应用于处理向量和矩阵数据,而对于非结构化数据,如图像、语音、文本等,传统的神经网络方法往往无法处理。为了解决这个问题,图神经网络应运而生。图神经网络是一种专门用于处理图数据的神经网络模型,它可以对图数据进行分类、聚类、分割等任务。

二、深度卷积图神经网络的基本概念

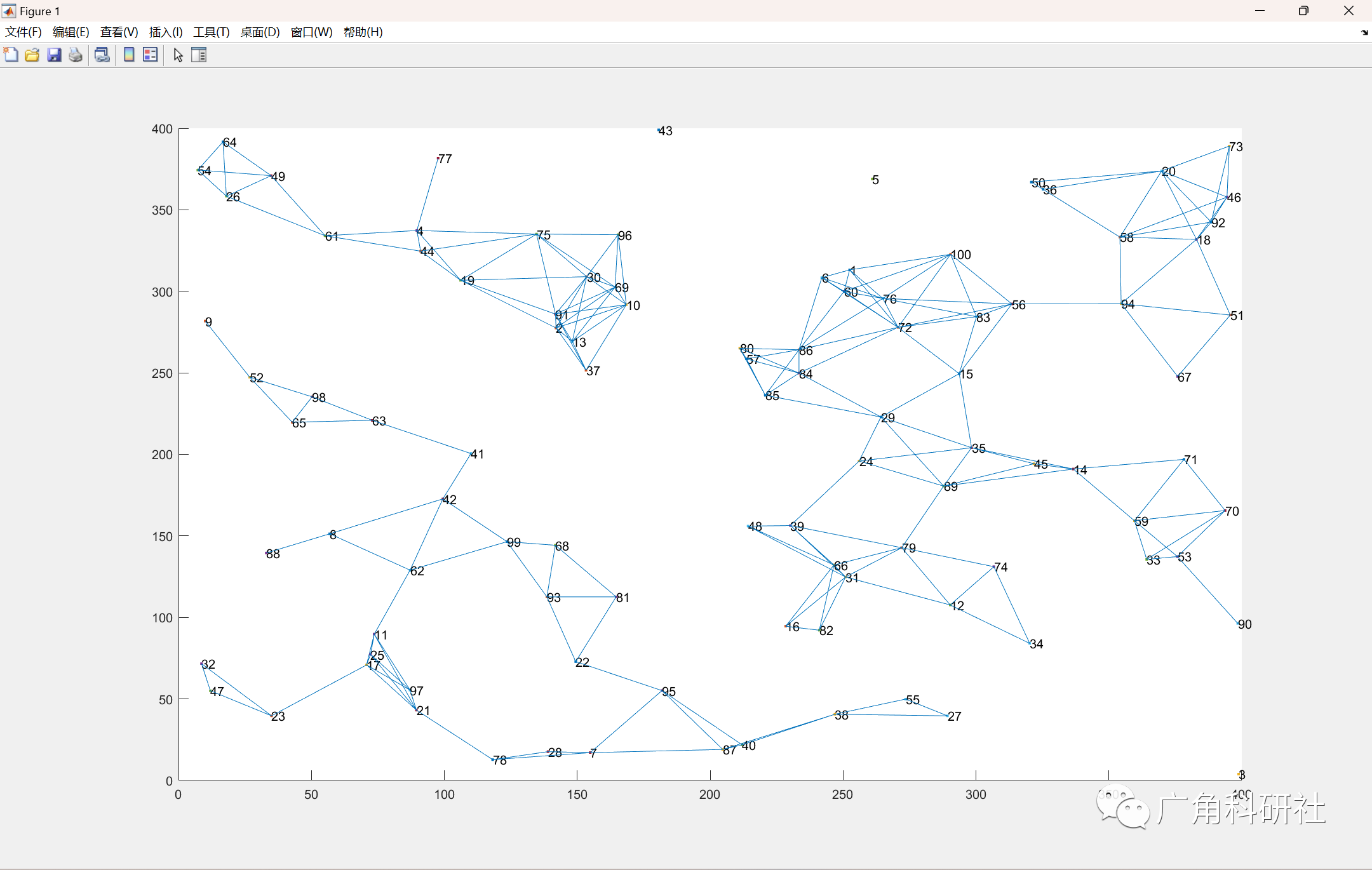

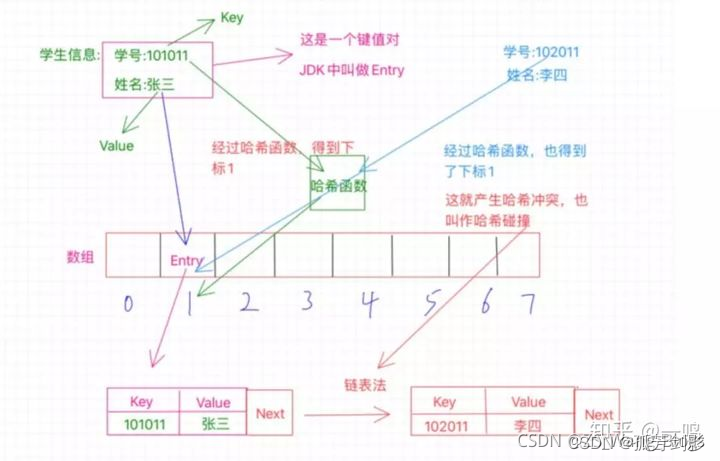

2.1 图的表示

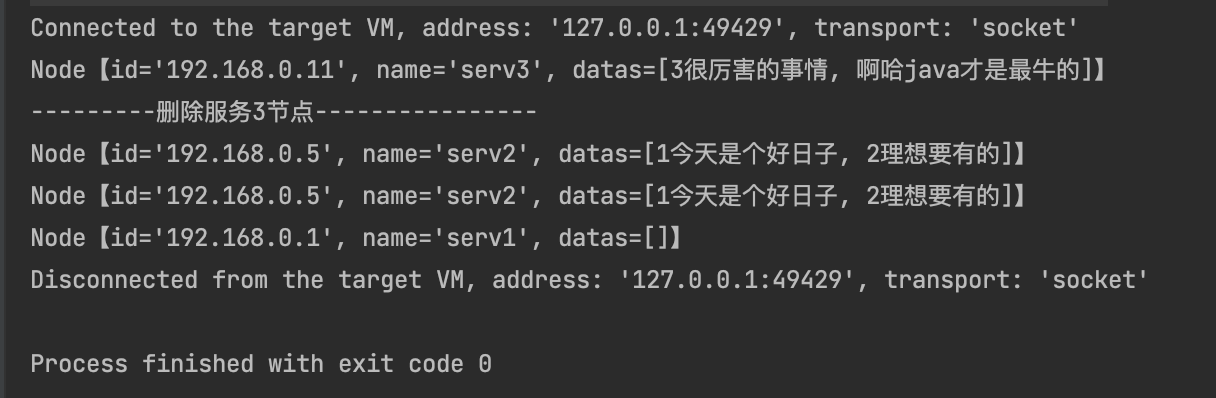

在图神经网络中,图是一种由节点和边组成的数据结构。节点表示图中的对象,边表示节点之间的关系。图可以用邻接矩阵或邻接表来表示。邻接矩阵是一个二维矩阵,其中每个元素表示两个节点之间是否有边相连。邻接表是一种链表数据结构,其中每个节点表示一个图节点,每个节点包含一个指向与之相连的节点的指针。

2.2 图卷积神经网络

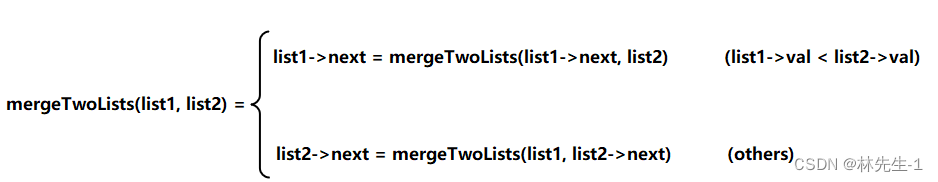

图卷积神经网络(Graph Convolutional Neural Network,GCN)是一种用于处理图数据的神经网络模型。它通过对节点和边进行卷积操作来提取特征,从而实现对图数据的分类、聚类、分割等任务。GCN的核心思想是将节点的特征与其邻居节点的特征进行卷积操作,从而得到节点的新特征表示。GCN的数学表达式如下:

其中,表示第

层的节点特征矩阵,

表示邻接矩阵

加上自环,

表示度矩阵,

表示激活函数,

表示第

层的权重矩阵。

2.3 深度卷积图神经网络

深度卷积图神经网络(Deep Convolutional Graph Neural Network,DCGNN)是一种基于GCN的深度神经网络模型。它通过多层卷积操作来提取图数据的特征,从而实现对图数据的分类、聚类、分割等任务。DCGNN的核心思想是将GCN的卷积操作与卷积神经网络(Convolutional Neural Network,CNN)的卷积操作相结合,从而实现对图数据的深度特征提取。DCGNN的数学表达式如下:

其中,表示第

层的节点特征矩阵,

表示第$l$层的权重矩阵,

表示激活函数,

表示节点

的邻居节点集合,

表示池化操作。

三、深度卷积图神经网络的应用

3.1 图像分类

图像分类是指将图像分为不同的类别。传统的图像分类方法主要基于手工设计的特征提取器,如SIFT、HOG等。这些方法需要大量的人工干预,并且往往无法处理复杂的图像数据。DCGNN可以自动学习图像的特征表示,从而实现对图像的分类。例如,可以使用DCGNN对MNIST数据集进行分类,得到较好的分类效果。

3.2 图像分割

图像分割是指将图像分为不同的区域,每个区域具有相似的特征。传统的图像分割方法主要基于聚类、分割、边缘检测等技术。这些方法往往需要大量的人工干预,并且无法处理复杂的图像数据。DCGNN可以自动学习图像的特征表示,从而实现对图像的分割。例如,可以使用DCGNN对PASCAL VOC数据集进行分割,得到较好的分割效果。

3.3 图像生成

图像生成是指根据给定的条件生成新的图像。传统的图像生成方法主要基于GAN、VAE等技术。这些方法需要大量的训练数据,并且往往无法生成高质量的图像。DCGNN可以自动学习图像的特征表示,从而实现对图像的生成。例如,可以使用DCGNN对CelebA数据集进行生成,得到较好的生成效果。

四、深度卷积图神经网络的优缺点

4.1 优点

(1)自动学习特征表示:DCGNN可以自动学习图像的特征表示,无需手工设计特征提取器。

(2)适用于非结构化数据:DCGNN适用于处理非结构化数据,如图像、语音、文本等。

(3)较好的性能:DCGNN在图像分类、图像分割、图像生成等任务中具有较好的性能。

4.2 缺点

(1)计算复杂度高:DCGNN的计算复杂度较高,需要大量的计算资源。

(2)数据量要求高:DCGNN需要大量的训练数据才能达到较好的性能。

五、结论

深度卷积图神经网络是一种用于处理图数据的深度神经网络模型,它可以自动学习图像的特征表示,适用于处理非结构化数据,具有较好的性能。但是,它的计算复杂度较高,需要大量的计算资源,并且需要大量的训练数据才能达到较好的性能。

六、参考文献

[1] Kipf T N, Welling M. Semi-supervised classification with graph convolutional networks[J]. arXiv preprint