大家好,我是微学AI,今天给大家介绍一下深度学习技巧应用10-PyTorch框架中早停法类的构建与运用,文章将介绍深度学习训练过程中的一个重要技巧—早停法,以及如何在PyTorch框架中实现早停法。文章将从早停法原理和实践出发,结合实际案例剖析早停法的优缺点及在PyTorch中的应用方法。

目录:

1. 什么是早停法?

2. 为什么需要早停法?

3. 如何在PyTorch中实现早停法?

4. 生成假数据并实践

5. 小结

1. 什么是早停法?

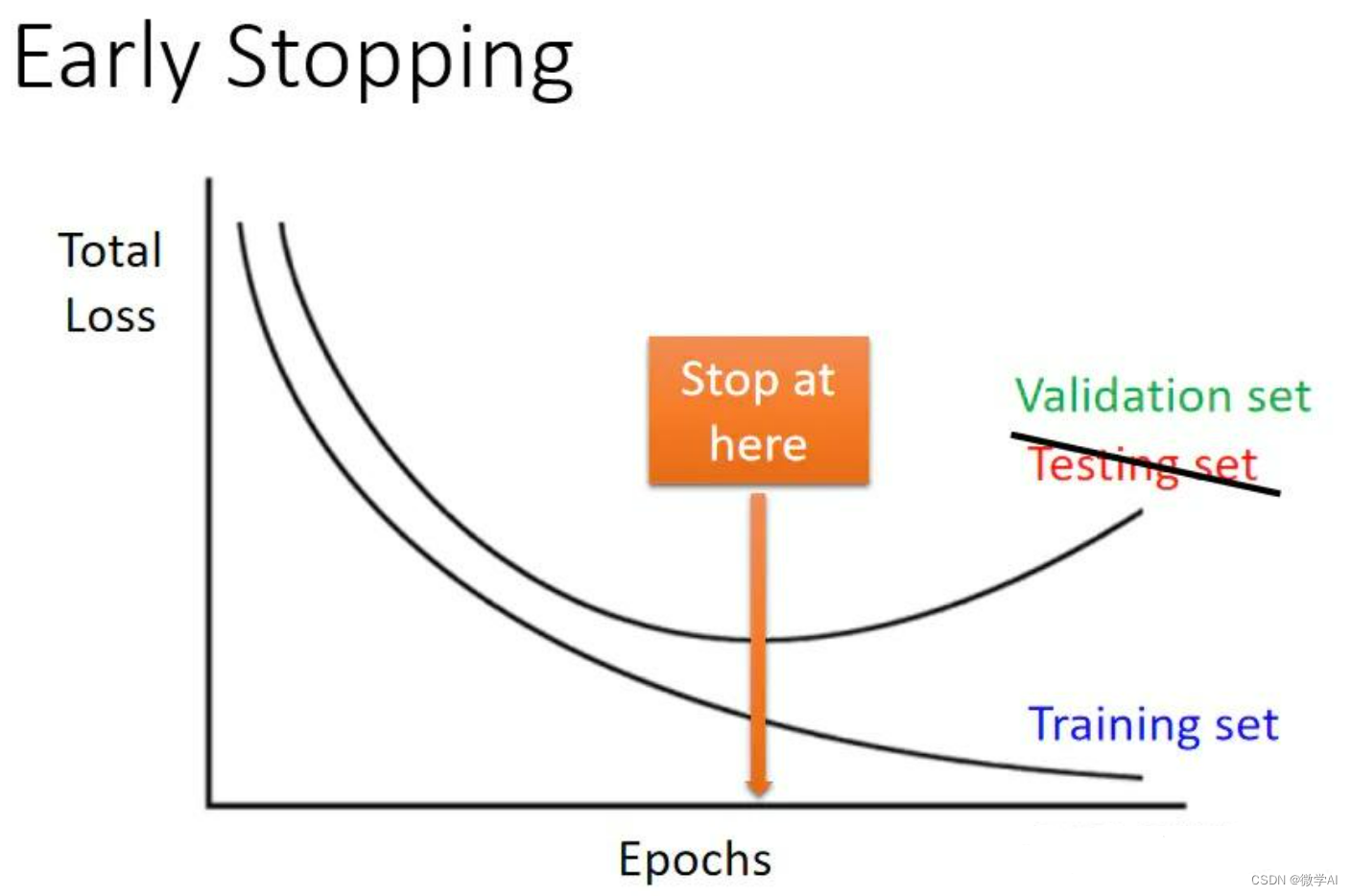

早停法是深度学习中一种防止过拟合的方法。过拟合是指模型在训练数据上表现良好,但在测试数据上表现较差。这是因为模型在训练过程中学习到了太多训练数据的随机噪声,导致模型泛化性能下降。早停法的核心思想是在训练过程中检验模型在验证数据上的表现,一旦验证损失停止减小(或者连续几轮未明显减小),就停止训练。这种做法的目的就是通过提前结束训练来防止模型过拟合。

2. 为什么需要早停法?

在深度学习中,过拟合是很常见的问题。过拟合会导致模型泛化性能下降,对未知数据的预测变得不准确。为了避免过拟合,一种常见的策略是采用早停法。早停法的优点有以下几个方面:

简单易实现:在训练过程中进行损失值观察,无须调整网络结构或者修改损失函数。

自动控制训练轮数: 不需要手

![[创新工具和方法论]-02- DOE实验设计步骤](https://img-blog.csdnimg.cn/img_convert/957a894034fa06407e058325031ca946.png)