文章目录

- 一、Zookeeper 介绍

- 1. Zookeeper概述

- 2. Zookeeper工作机制

- 3. Zookeeper特点

- 4. Zookeeper数据结构

- 5. Zookeeper应用场景

- (1)统一命名服务

- (2)统一配置管理

- (3)统一集群管理

- (4)服务器动态上下线

- (5)软负载均衡

- 二、Zookeeper下载

- 1. 下载地址

- 2. 下载截图

- 3. 下载 Linux 环境安装的 tar 包

- 三、Zookeeper本地安装

- 1. 本地模式安装

- (1)安装前准备

- (2)修改配置

- (3)操作 Zookeeper

- 四、Zookeeper 集群安装

- 1. 集群规划

- 2. 解压安装

- 3. 配置服务器编号

- 4. 配置zoo.cfg文件

- 5. 启动集群

- 6. Zookeeper集群启动停止脚本

- 五、Zookeeper选举机制

- 1. Zookeeper选举机制——第一次启动

- 2. Zookeeper选举机制——非第一次启动

一、Zookeeper 介绍

1. Zookeeper概述

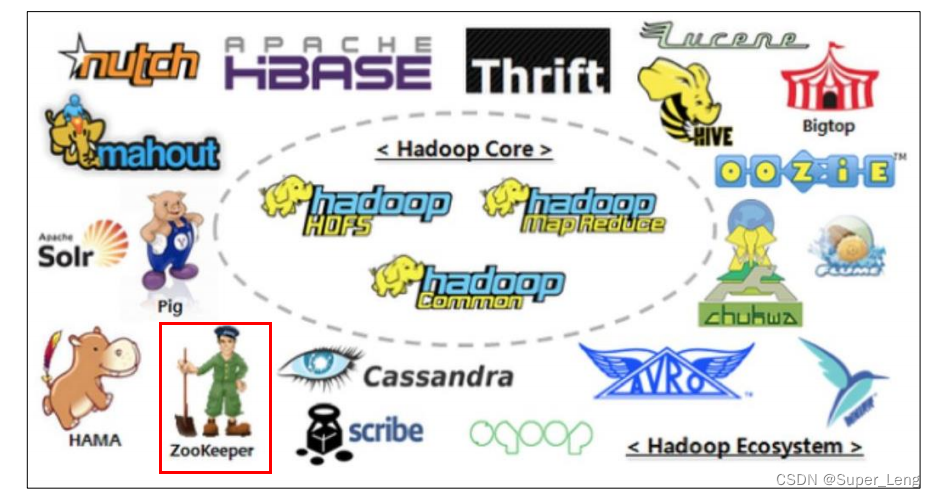

Zookeeper 是一个开源的、分布式的,为分布式框架提供协调服务的 Apache 项目。

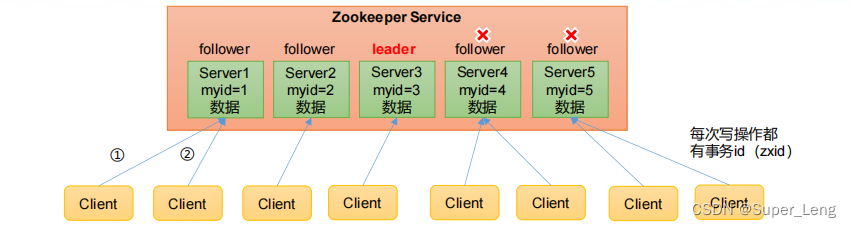

2. Zookeeper工作机制

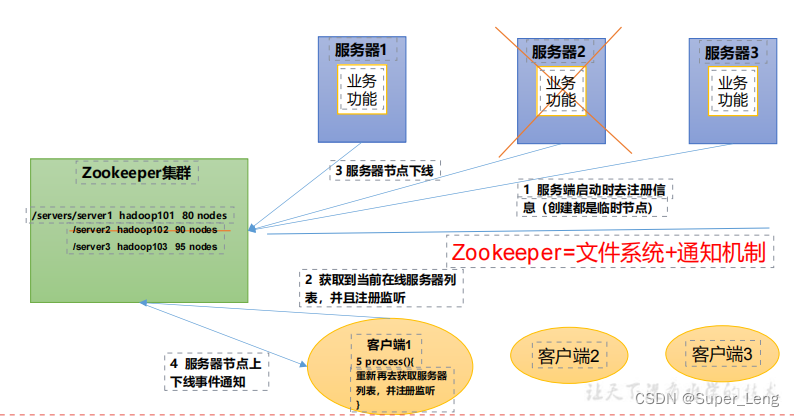

Zookeeper从设计模式角度来理解:是一个基于观察者模式设计的分布式服务管理框架,它负责存储和管理大家都关心的数据,然后接受观察者的注册,一旦这些数据的状态发生变化,Zookeeper将通知已经在Zookeeper上注册的那些观察者做出相应的反应。

3. Zookeeper特点

1.Zookeeper:一个领导者(Leader),多个跟随者(Follower)组成的集群。

2.集群中只要有半数以上节点存活,Zookeeper集群就能正常服务。所 以Zookeeper适合安装奇数台服务器。

3.全局数据一致:每个Server保存一份相同的数据副本,Client无论连接到哪个Server,数据都是一致的。

4.更新请求顺序执行,来自同一个Client的更新请求按其发送顺序依次执行。

5.数据更新原子性,一次数据更新要么成功,要么失败。

6.实时性,在一定时间范围内,Client能读到最新数据。

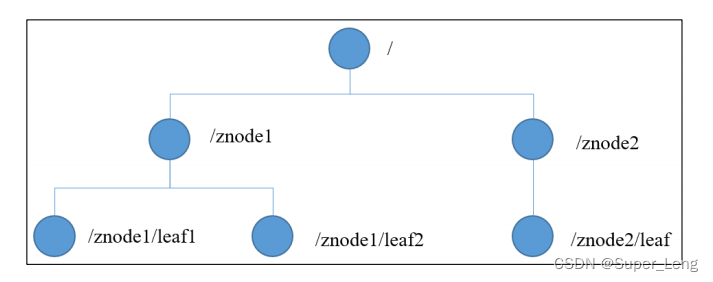

4. Zookeeper数据结构

ZooKeeper 数据模型的结构与 Unix 文件系统很类似,整体上可以看作是一棵树,每个节点称做一个 ZNode。每一个 ZNode 默认能够存储 1MB 的数据,每个 ZNode 都可以通过其路径唯一标识。

5. Zookeeper应用场景

提供的服务包括:统一命名服务、统一配置管理、统一集群管理、服务器节点动态上下线、软负载均衡等。

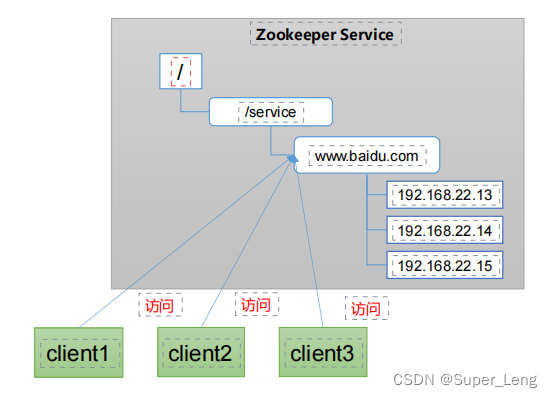

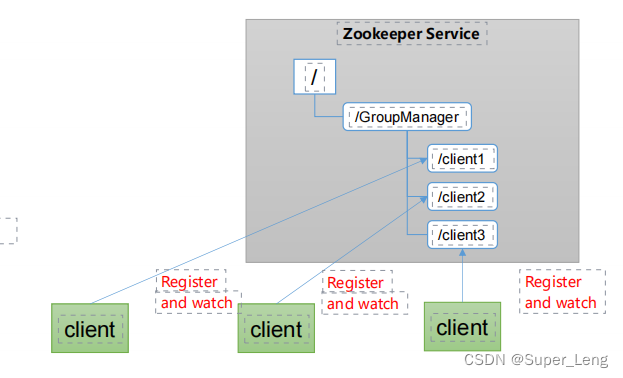

(1)统一命名服务

在分布式环境下,经常需要对应用/服务进行统一命名,便于识别。

例如:IP不容易记住,而域名容易记住。

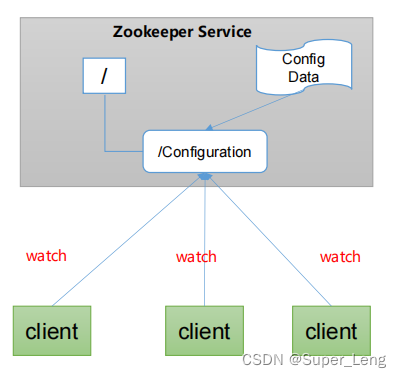

(2)统一配置管理

1.分布式环境下,配置文件同步非常常见。

(1)一般要求一个集群中,所有节点的配置信息是一致的,比如 Kafka 集群。

(2)对配置文件修改后,希望能够快速同步到各个节点上。

2.配置管理可交由ZooKeeper实现。

(1)可将配置信息写入ZooKeeper上的一个Znode。

(2)各个客户端服务器监听这个Znode。

(3)一 旦Znode中的数据被修改,ZooKeeper将通知各个客户端服务器。

(3)统一集群管理

1.分布式环境中,实时掌握每个节点的状态是必要的。

(1)可根据节点实时状态做出一些调整。

2.ZooKeeper可以实现实时监控节点状态变化

(1)可将节点信息写入ZooKeeper上的一个ZNode。

(2)监听这个ZNode可获取它的实时状态变化。

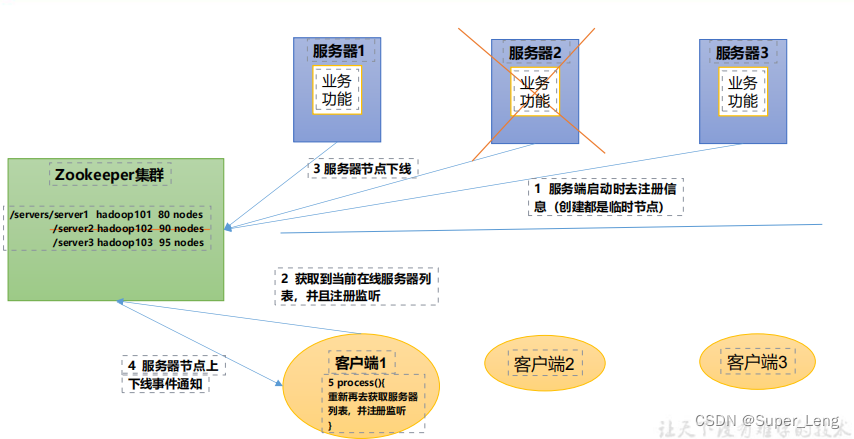

(4)服务器动态上下线

客户端能实时洞察到服务器上下线的变化

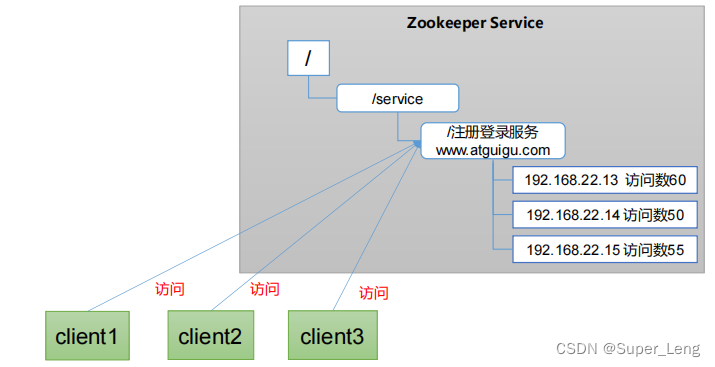

(5)软负载均衡

在Zookeeper中记录每台服务器的访问数,让访问数最少的服务器去处理最新的客户端请求

二、Zookeeper下载

1. 下载地址

官网首页:https://zookeeper.apache.org/

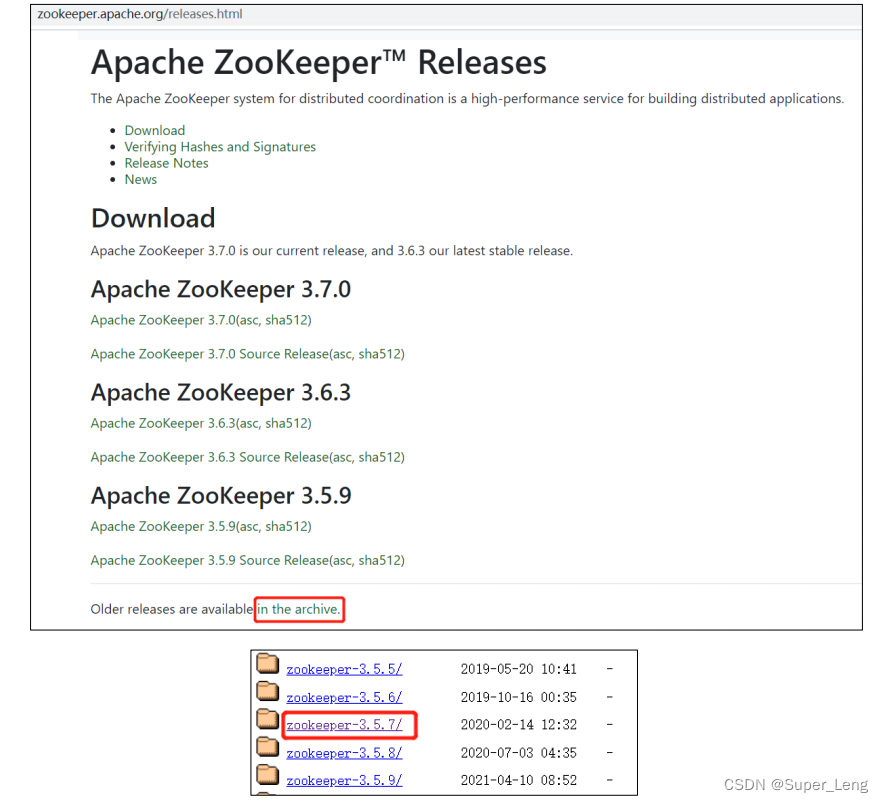

2. 下载截图

3. 下载 Linux 环境安装的 tar 包

三、Zookeeper本地安装

1. 本地模式安装

(1)安装前准备

(1)安装 JDK

(2)拷贝 apache-zookeeper-3.5.7-bin.tar.gz 安装包到 Linux 系统下

(3)解压到指定目录

[root@hadoop102 software]$ tar -zxvf apache-zookeeper-3.5.7-bin.tar.gz -C /opt/module/

(4)修改名称

[root@hadoop102 module]$ mv apache-zookeeper-3.5.7-bin/ zookeeper-3.5.7

(2)修改配置

(1)将/opt/module/zookeeper-3.5.7/conf 这个路径下的 zoo_sample.cfg 修改为 zoo.cfg;

[root@hadoop102 conf]$ mv zoo_sample.cfg zoo.cfg

(2)打开 zoo.cfg 文件,修改 dataDir 路径:

[root@hadoop102 zookeeper-3.5.7]$ vim zoo.cfg

修改如下内容:

dataDir=/opt/module/zookeeper-3.5.7/zkData

(3)在/opt/module/zookeeper-3.5.7/这个目录上创建 zkData 文件夹

[root@hadoop102 zookeeper-3.5.7]$ mkdir zkData

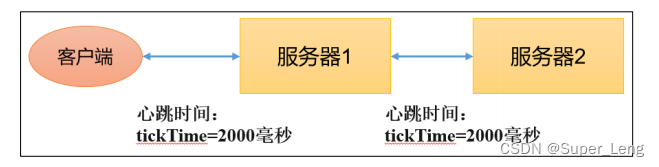

Zookeeper中的配置文件zoo.cfg中参数含义解读如下:

1.tickTime = 2000:通信心跳时间,Zookeeper服务器与客户端心跳时间,单位毫秒

2.initLimit = 10:LF初始通信时限

Leader和Follower初始连接时能容忍的最多心跳数(10 个 tickTime就是102000)

3,syncLimit = 5:LF同步通信时限(5 个 tickTime就是52000)

Leader和Follower之间通信时间如果超过syncLimit * tickTime,Leader认为Follwer死掉,从服务器列表中删除Follwer。

4.dataDir:保存Zookeeper中的数据

注意:默认的tmp目录,容易被Linux系统定期删除,所以一般不用默认的tmp目录。

5.clientPort = 2181:客户端连接端口,通常不做修改。

(3)操作 Zookeeper

(1)启动 Zookeeper

[root@hadoop102 zookeeper-3.5.7]$ bin/zkServer.sh start

(2)查看进程是否启动

[root@hadoop102 zookeeper-3.5.7]$ jps

4020 Jps

4001 QuorumPeerMain

(3)查看状态

[root@hadoop102 zookeeper-3.5.7]# bin/zkServer.sh status

/usr/bin/java

ZooKeeper JMX enabled by default

Using config: /opt/module/zookeeper-3.5.7/bin/../conf/zoo.cfg

Client port found: 2181. Client address: localhost.

Mode: standalone

(4)启动客户端

[root@hadoop102 zookeeper-3.5.7]$ bin/zkCli.sh

(5)退出客户端:

[zk: localhost:2181(CONNECTED) 0] quit

(6)停止 Zookeeper

[root@hadoop102 zookeeper-3.5.7]$ bin/zkServer.sh stop

四、Zookeeper 集群安装

1. 集群规划

在 hadoop102、hadoop103 和 hadoop104 三个节点上都部署 Zookeeper。

2. 解压安装

(1)在 hadoop102 解压 Zookeeper 安装包到/opt/module/目录下

[root@hadoop102 software]$ tar -zxvf apache-zookeeper-3.5.7-bin.tar.gz -C /opt/module/

(2)修改 apache-zookeeper-3.5.7-bin 名称为 zookeeper-3.5.7

[root@hadoop102 module]$ mv apache-zookeeper-3.5.7-bin/ zookeeper-3.5.7

3. 配置服务器编号

(1)在/opt/module/zookeeper-3.5.7/这个目录下创建 zkData

[root@hadoop102 zookeeper-3.5.7]$ mkdir zkData

(2)在/opt/module/zookeeper-3.5.7/zkData 目录下创建一个 myid 的文件(文件名必须是myid,因为源码中读取的就是myid文件)

[root@hadoop102 zkData]$ vi myid

在文件中添加与 server 对应的编号(注意:上下不要有空行,左右不要有空格)

2

注意:添加 myid 文件,一定要在 Linux 里面创建,在 notepad++里面很可能乱码

(3)拷贝配置好的 zookeeper 到其他机器上

[root@hadoop102 module ]$ xsync zookeeper-3.5.7

并分别在 hadoop103、hadoop104 上修改 myid 文件中内容为 3、4

4. 配置zoo.cfg文件

(1)重命名/opt/module/zookeeper-3.5.7/conf 这个目录下的 zoo_sample.cfg 为 zoo.cfg

[root@hadoop102 conf]$ mv zoo_sample.cfg zoo.cfg

(2)打开 zoo.cfg 文件

[root@hadoop102 conf]$ vim zoo.cfg

#修改数据存储路径配置

dataDir=/opt/module/zookeeper-3.5.7/zkData

#增加如下配置

#######################cluster##########################

server.2=hadoop102:2888:3888

server.3=hadoop103:2888:3888

server.4=hadoop104:2888:3888

#配置参数解读

server.A=B:C:D。

A 是一个数字,表示这是第几号服务器;

集群模式下配置一个文件 myid,这个文件在 dataDir 目录下,这个文件里面有一个数据就是 A 的值,Zookeeper 启动时读取此文件,拿到里面的数据与 zoo.cfg 里面的配置信息比较从而判断到底是哪个 server。

B 是这个服务器的地址;

C 是这个服务器 Follower 与集群中的 Leader 服务器交换信息的端口;

D 是万一集群中的 Leader 服务器挂了,需要一个端口来重新进行选举,选出一个新的Leader,而这个端口就是用来执行选举时服务器相互通信的端口。

(3)同步 zoo.cfg 配置文件

[root@hadoop102 conf]$ xsync zoo.cfg

5. 启动集群

(1)分别启动 Zookeeper

[root@hadoop102 zookeeper-3.5.7]$ bin/zkServer.sh start

[root@hadoop103 zookeeper-3.5.7]$ bin/zkServer.sh start

[root@hadoop104 zookeeper-3.5.7]$ bin/zkServer.sh start

(2)查看状态

[root@hadoop102 zookeeper-3.5.7]# bin/zkServer.sh status

#hadoop102为follower

Mode: follower

[root@hadoop103 zookeeper-3.5.7]# bin/zkServer.sh status

#hadoop103为leader

Mode: leader

[root@hadoop104 zookeeper-3.4.5]# bin/zkServer.sh status

#hadoop104为follower

Mode: follower

6. Zookeeper集群启动停止脚本

(1)在 hadoop102 的/home/hadoop/bin 目录下创建脚本

[root@hadoop102 bin]$ vim zk.sh

在脚本中编写如下内容

#!/bin/bash

case $1 in

"start"){

for i in hadoop102 hadoop103 hadoop104

do

echo ---------- zookeeper $i 启动 ------------

ssh $i "/opt/module/zookeeper-3.5.7/bin/zkServer.sh start"

done

};;

"stop"){

for i in hadoop102 hadoop103 hadoop104

do

echo ---------- zookeeper $i 停止 ------------

ssh $i "/opt/module/zookeeper-3.5.7/bin/zkServer.sh stop"

done

};;

"status"){

for i in hadoop102 hadoop103 hadoop104

do

echo ---------- zookeeper $i 状态 ------------

ssh $i "/opt/module/zookeeper-3.5.7/bin/zkServer.sh status"

done

};;

esac

(2)增加脚本执行权限

[root@hadoop102 bin]$ chmod u+x zk.sh

(3)Zookeeper 集群启动脚本

[root@hadoop102 module]$ zk.sh start

(4)Zookeeper 集群停止脚本

[root@hadoop102 module]$ zk.sh stop

五、Zookeeper选举机制

1. Zookeeper选举机制——第一次启动

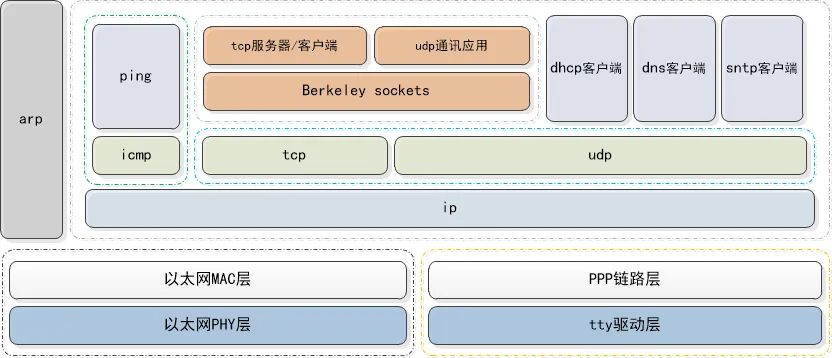

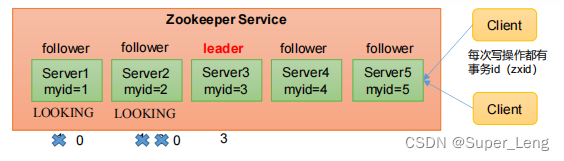

SID:服务器ID。用来唯一标识一台ZooKeeper集群中的机器,每台机器不能重复,和myid一致。

ZXID:事务ID。ZXID是一个事务ID,用来标识一次服务器状态的变更。在某一时刻,集群中的每台机器的ZXID值不一定完全一致,这和ZooKeeper服务器对于客户端“更新请求”的处理逻辑有关。

Epoch:每个Leader任期的代号。没有Leader时同一轮投票过程中的逻辑时钟值是相同的。每投完一次票这个数据就会增加。

(1)服务器1启动,发起一次选举。服务器1投自己一票。此时服务器1票数1票,不够半数以上(5台服务器至少要3票),选举无法完成,服务器1状态保持为LOOKING;

(2)服务器2启动,再发起一次选举。服务器1和2分别投自己一票并交换选票信息:此时服务器1发现服务器2的myid比自己目前投票推举的(服务器1)大,更改选票为推举服务器2。此时服务器1票数0票,服务器2票数2票,没有半数以上结果,选举无法完成,服务器1,2状态保持LOOKING

(3)服务器3启动,发起一次选举。此时服务器1和2都会更改选票为服务器3。此次投票结果:服务器1为0票,服务器2为0票,服务器3为3票。此时服务器3的票数已经超过半数,服务器3当选Leader。服务器1,2更改状态为FOLLOWING,服务器3更改状态为LEADING;

(4)服务器4启动,发起一次选举。此时服务器1,2,3已经不是LOOKING状态,不会更改选票信息。交换选票信息结果:服务器3为3票,服务器4为1票。此时服务器4服从多数,更改选票信息为服务器3,并更改状态为FOLLOWING;

(5)服务器5启动,同4一样当小弟。

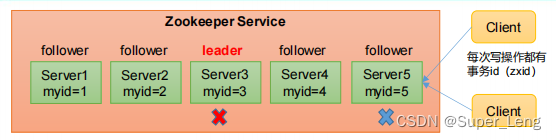

2. Zookeeper选举机制——非第一次启动

(1)当ZooKeeper集群中的一台服务器出现以下两种情况之一时,就会开始进入Leader选举:

• 服务器初始化启动。

• 服务器运行期间无法和Leader保持连接。(例如:上面的5挂了,5无法和leader连接,5会发起leader选举)

(2)而当一台机器进入Leader选举流程时,当前集群也可能会处于以下两种状态:

• 集群中本来就已经存在一个Leader。(例如:上面的5挂了,5发起leader选举时,集群中已经存在leader的场景)

对于第一种已经存在Leader的情况,机器试图去选举Leader时,会被告知当前服务器的Leader信息,对于该机器来说,仅仅需要和Leader机器建立连接,并进行状态同步即可。

• 集群中确实不存在Leader。(例如:上面的5挂了,5发起leader选举时,集群中不存在leader的场景)

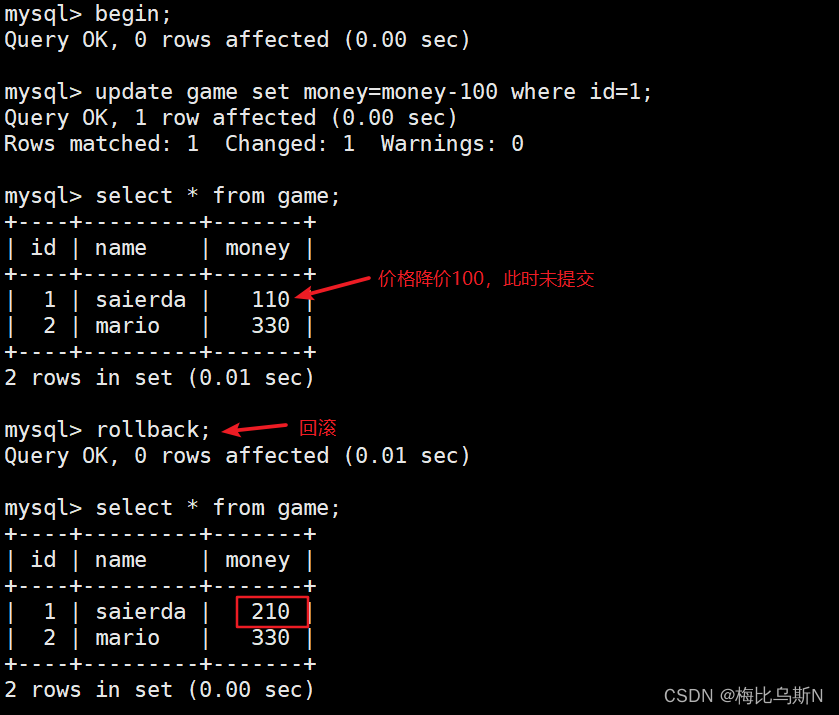

假设ZooKeeper由5台服务器组成,SID分别为1、2、3、4、5,ZXID分别为8、8、8、7、7,并且此时SID为3的服务器是Leader。某一时刻,3和5服务器出现故障,因此开始进行Leader选举。

(EPOCH,ZXID,SID ) (EPOCH,ZXID,SID ) (EPOCH,ZXID,SID )

SID为1、2、4的机器投票情况: (1,8,1) (1,8,2) (1,7,4)

选举Leader规则: 1.EPOCH大的直接胜出; 2.EPOCH相同,事务id大的胜出; 3.事务id相同,服务器id大的胜出;

![[附源码]计算机毕业设计springboot个性化产品服务管理系统论文](https://img-blog.csdnimg.cn/6cb1f3f191a34072a0cbd772f4d59631.png)