前言

python爬虫技术在java开发工作中属于工具性的技术属性,所以我这里就只从爬取一个网站的数据为例作为教学内容,具体的基础学习与其它的扩展知识内容,我会以链接的形式给出,若有兴趣可自行点击学习。

python基础知识教学

Python re.findall中正则表达式(.*?)和参数re.S使用

Python数据爬取超详细讲解(零基础入门,老年人都看的懂)

结合以上三篇与本篇内容,相信你可以快熟入门python爬虫

实战教学

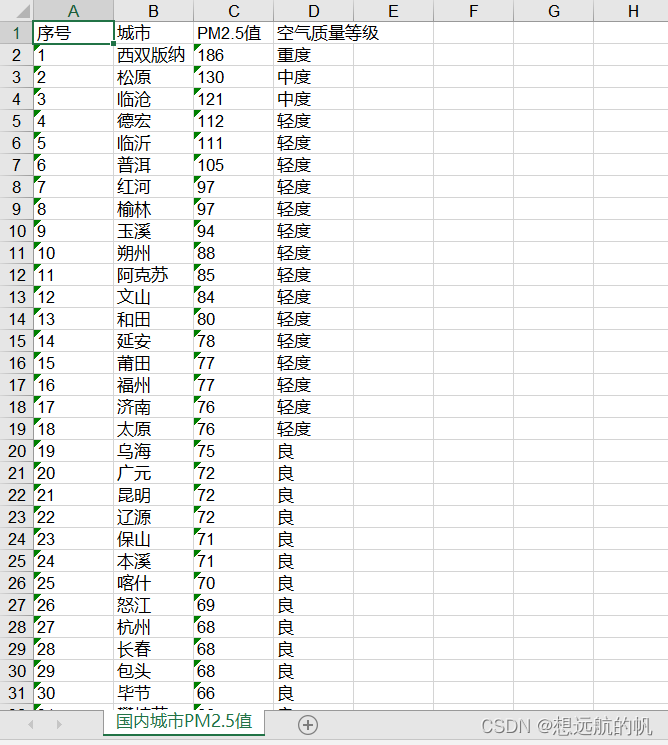

我们本篇的目标是爬取2345天气王中的全国最差PM2.5排行榜中的数据

2345天气王地址

python爬取代码

# -*- codeing = utf-8 -*-

from bs4 import BeautifulSoup # 网页解析,获取数据

import re # 正则表达式,进行文字匹配`

import urllib.request, urllib.error # 制定URL,获取网页数据

import xlwt # 进行excel操作

#import sqlite3 # 进行SQLite数据库操作

findNum = re.compile(r'<div class="j-td">(.*)</div>') # 创建正则表达式对象,获取列表

findCity = re.compile(r'<a href=".*">(.*)</a>')# 获得城市 第一个.*表示这段字符匹配任意字符,(.*)表示拿到该处的值

findValue = re.compile(r' (\d*)') # 获得数值

findQuality = re.compile(r'<i class="wea-aqi wea-aqi-.*">(.*)</i>') # 获取空气质量等级

def main():

baseurl = "https://tianqi.2345.com/rank-pm25-rev.htm" #要爬取的网页链接

# 1.爬取网页

datalist = getData(baseurl)

print(datalist)

savepath = "国内城市PM2.5值.xls" #当前目录新建XLS,存储进去

# dbpath = "movie.db" #当前目录新建数据库,存储进去

# 3.保存数据

saveData(datalist,savepath) #2种存储方式可以只选择一种

# saveData2DB(datalist,dbpath)

# 得到指定一个URL的网页内容

def askURL(url):

head = { # 模拟浏览器头部信息,向豆瓣服务器发送消息

"User-Agent": "Mozilla / 5.0(Windows NT 10.0; Win64; x64) AppleWebKit / 537.36(KHTML, like Gecko) Chrome / 80.0.3987.122 Safari / 537.36"

}

# 用户代理,表示告诉豆瓣服务器,我们是什么类型的机器、浏览器(本质上是告诉浏览器,我们可以接收什么水平的文件内容)

request = urllib.request.Request(url, headers=head)

html = ""

try:

response = urllib.request.urlopen(request)

html = response.read().decode("utf-8")

except urllib.error.URLError as e:

if hasattr(e, "code"):

print(e.code)

if hasattr(e, "reason"):

print(e.reason)

return html

# 爬取网页

def getData(baseurl):

datalist = [] #用来存储爬取的网页信息

html = askURL(baseurl) # 保存获取到的网页源码

# 2.逐一解析数据

soup = BeautifulSoup(html, "html.parser")

# ===拿到所有div class = ‘j-tr’的字段,城市PM2.5的数据===

for table in soup.find_all('div', class_="j-tr"): # 查找符合要求的字符串

data = [] # 设置数组用来保存单部电影所有信息

table = str(table)# 转化为String

num = re.findall(findNum, table) # 通过正则表达式查找我们想要得信息

print(num)

data.append(num)

# 获取城市

city = re.findall(findCity,table)

print(city)

data.append(city)

# 获得数值

value = re.findall(findValue,table)

for values in value:

if(values != ''):

print(values)

data.append(values)

# 获取空气质量等级

qualityre = re.findall(findQuality,table)

print(qualityre)

data.append(qualityre)

# cityAndValues = re.findall(findCityAndValue, table)

# print(cityAndValues)

# # 按照城市的正则表达式,这里会拿到两个数据,第一个为城市名称,第二个为PM2.5的值

# if (len(cityAndValues) == 2):

# city = cityAndValues[0]

# data.append(city)

print("====")

datalist.append(data)

return datalist

# 保存数据到表格

def saveData(datalist,savepath):

# 移除掉第一组空数据

datalist.pop(0)

print("save.......")

book = xlwt.Workbook(encoding="utf-8",style_compression=0) #创建workbook对象

sheet = book.add_sheet('国内城市PM2.5值', cell_overwrite_ok=True) #创建工作表

col = ("序号","城市","PM2.5值","空气质量等级")

for i in range(0,4):

sheet.write(0,i,col[i]) #列名

for i in range(0, len(datalist)):

print("第%d条" %(i+1)) #输出语句,用来测试

data = datalist[i]

print(data)

for j in range(0,4):

print(data[j])

sheet.write(i+1,j,data[j]) #数据

book.save(savepath) #保存

if __name__ == "__main__": # 当程序执行时

# 调用函数

main()

# init_db("movietest.db")

print("爬取完毕!")

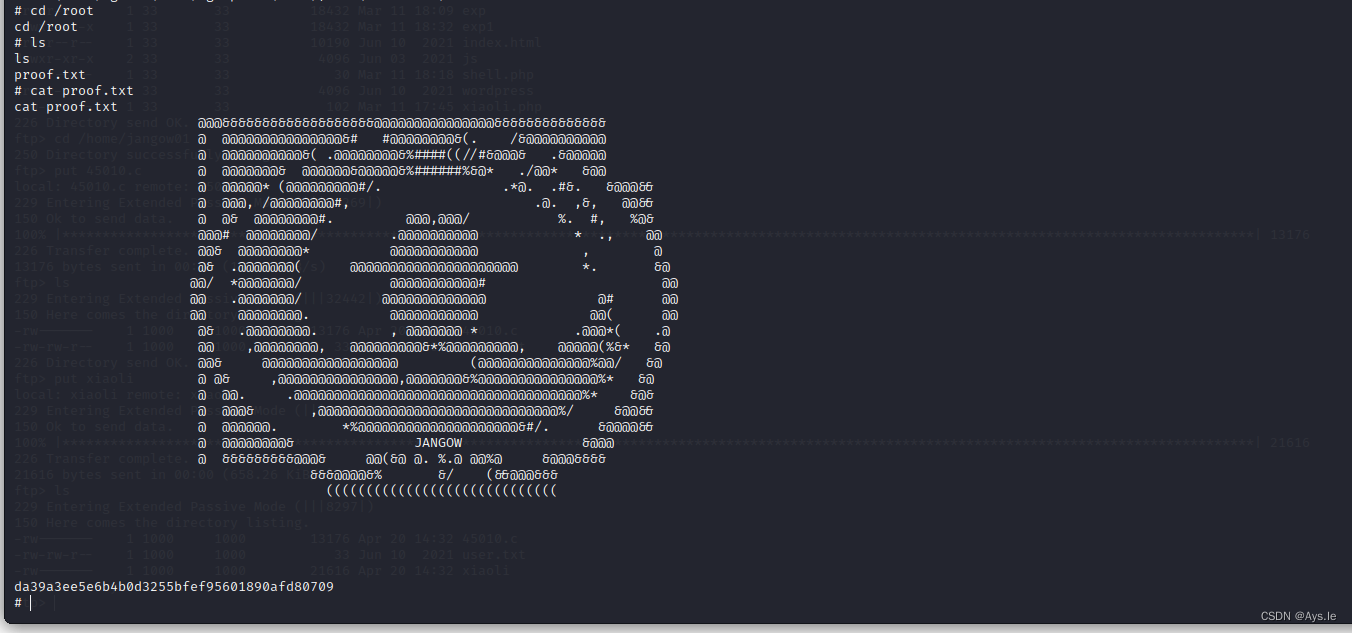

爬取效果

下面我根据代码,从下到下给大家讲解分析一遍

讲解

第一部分包的引入

# -*- codeing = utf-8 -*-

from bs4 import BeautifulSoup # 网页解析,获取数据

import re # 正则表达式,进行文字匹配`

import urllib.request, urllib.error # 制定URL,获取网页数据

import xlwt # 进行excel操作

#import sqlite3 # 进行SQLite数据库操作

正则表达式的编写(重要)

(.?)表示获取括号中的内容

. 表示匹配任意字符

正则表达式:即根据所要爬取的数据内容编写对应的正则表达式,是爬数据中最为重要的内容。

findNum = re.compile(r'<div class="j-td">(.*)</div>') # 创建正则表达式对象,获取列表

findCity = re.compile(r'<a href=".*">(.*)</a>')# 获得城市 第一个.*表示这段字符匹配任意字符,(.*)表示拿到该处的值

findValue = re.compile(r' (\d*)') # 获得数值

findQuality = re.compile(r'<i class="wea-aqi wea-aqi-.*">(.*)</i>') # 获取空气质量等级

下面为需要爬取数据的html格式。我们需要根据html格式来编写,匹配规则可以查考下面的地址。

Python re.findall中正则表达式(.*?)和参数re.S使用

设置爬取网页(格式较固定)

def main():

baseurl = "https://tianqi.2345.com/rank-pm25-rev.htm" #要爬取的网页链接

# 1.爬取网页

datalist = getData(baseurl)

print(datalist)

savepath = "国内城市PM2.5值.xls" #当前目录新建XLS,存储进去

# dbpath = "movie.db" #当前目录新建数据库,存储进去

# 3.保存数据

saveData(datalist,savepath) #2种存储方式可以只选择一种

# saveData2DB(datalist,dbpath)

设置请求投(用来模拟人为请求,格式固定)

# 得到指定一个URL的网页内容

def askURL(url):

head = { # 模拟浏览器头部信息,向豆瓣服务器发送消息

"User-Agent": "Mozilla / 5.0(Windows NT 10.0; Win64; x64) AppleWebKit / 537.36(KHTML, like Gecko) Chrome / 80.0.3987.122 Safari / 537.36"

}

# 用户代理,表示告诉被请求的服务器,我们是什么类型的机器、浏览器(本质上是告诉浏览器,我们可以接收什么水平的文件内容)

request = urllib.request.Request(url, headers=head)

html = ""

try:

response = urllib.request.urlopen(request)

html = response.read().decode("utf-8")

except urllib.error.URLError as e:

if hasattr(e, "code"):

print(e.code)

if hasattr(e, "reason"):

print(e.reason)

return html

根据网站内容爬取数据(需要自己思考编写核心内容)

# 爬取网页

def getData(baseurl):

datalist = [] #用来存储爬取的网页信息

html = askURL(baseurl) # 保存获取到的网页源码

# 2.逐一解析数据

soup = BeautifulSoup(html, "html.parser")

# ===拿到所有div class = ‘j-tr’的字段,城市PM2.5的数据===

for table in soup.find_all('div', class_="j-tr"): # 查找符合要求的字符串

data = [] # 设置数组用来保存单个城市的所有信息

table = str(table)# 转化为String

num = re.findall(findNum, table) # 通过正则表达式查找我们想要得信息

print(num)

data.append(num)

# 获取城市

city = re.findall(findCity,table)

print(city)

data.append(city)

# 获得数值

value = re.findall(findValue,table)

for values in value:

if(values != ''):

print(values)

data.append(values)

# 获取空气质量等级

qualityre = re.findall(findQuality,table)

print(qualityre)

data.append(qualityre)

# cityAndValues = re.findall(findCityAndValue, table)

# print(cityAndValues)

# # 按照城市的正则表达式,这里会拿到两个数据,第一个为城市名称,第二个为PM2.5的值

# if (len(cityAndValues) == 2):

# city = cityAndValues[0]

# data.append(city)

print("====")

datalist.append(data)

return datalist

保存文件(较为固定,小改动)

# 保存数据到表格

def saveData(datalist,savepath):

# 移除掉第一组空数据

datalist.pop(0)

print("save.......")

book = xlwt.Workbook(encoding="utf-8",style_compression=0) #创建workbook对象

sheet = book.add_sheet('国内城市PM2.5值', cell_overwrite_ok=True) #创建工作表

col = ("序号","城市","PM2.5值","空气质量等级")

for i in range(0,4):

sheet.write(0,i,col[i]) #列名

for i in range(0, len(datalist)):

print("第%d条" %(i+1)) #输出语句,用来测试

data = datalist[i]

print(data)

for j in range(0,4):

print(data[j])

sheet.write(i+1,j,data[j]) #数据

book.save(savepath) #保存

启动命令

if __name__ == "__main__": # 当程序执行时

# 调用函数

main()

# init_db("movietest.db")

print("爬取完毕!")