目录

- 激活函数

- 逻辑回归的优缺点总结

- LR可以进行多分类吗?

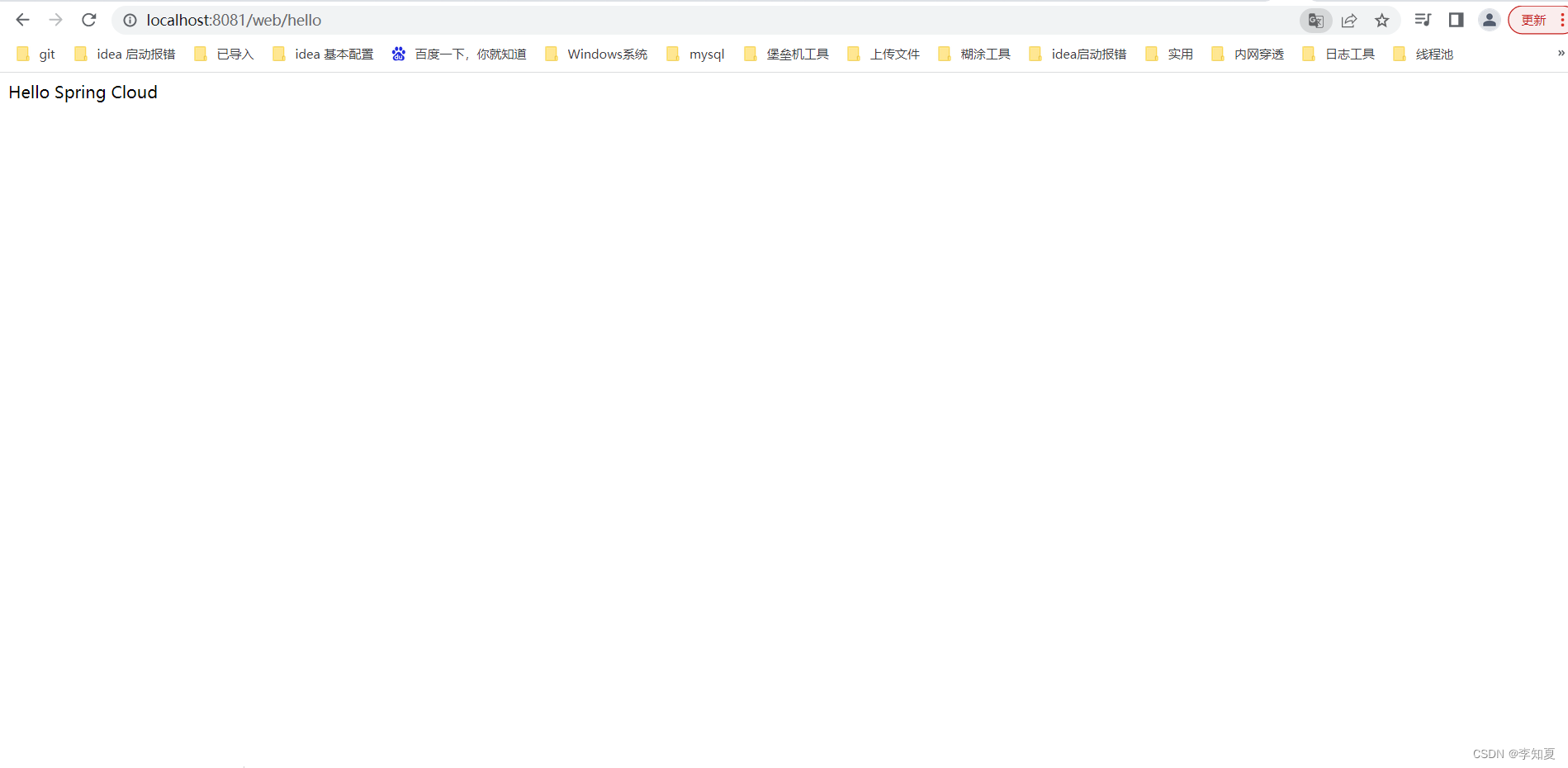

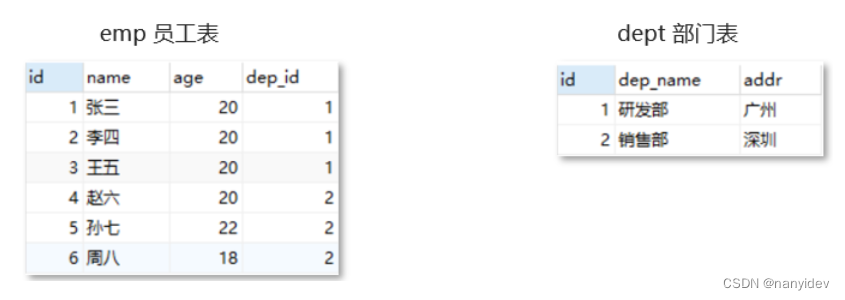

激活函数

h(w)表示输入的线性方程

逻辑回归的优缺点总结

优点:

- 形式简单,模型的可解释性非常好。从特征的权重可以看到不同的特征对最后结果的影响,某个特征的权重值比较高,那么这个特征最后对结果的影响会比较大。

- 模型效果不错。在工程上是可以接受的(作为baseline),如果特征工程做的好,效果不会太差,并且特征工程可以大家并行开发,大大加快开发的速度。

- 训练速度较快。分类的时候,计算量仅仅只和特征的数目相关。并且逻辑回归的分布式优化sgd发展比较成熟,训练的速度可以通过堆机器进一步提高,这样我们可以在短时间内迭代好几个版本的模型。

- 资源占用小,尤其是内存。因为只需要存储各个维度的特征值。

- 方便输出结果调整。逻辑回归可以很方便的得到最后的分类结果,因为输出的是每个样本的概率分数,我们可以很容易的对这些概率分数进行cut off,也就是划分阈值(大于某个阈值的是一类,小于某个阈值的是一类)。

缺点:

- 准确率并不是很高。因为形式非常的简单,很难去拟合数据的真实分布。

- 很难处理数据不平衡的问题。

- 处理非线性数据较麻烦。逻辑回归在不引入其他方法的情况下,只能处理线性可分的数据,或者进一步说,处理二分类的问题 。

- 逻辑回归本身无法筛选特征。有时候,我们会用gbdt来筛选特征,然后再上逻辑回归。

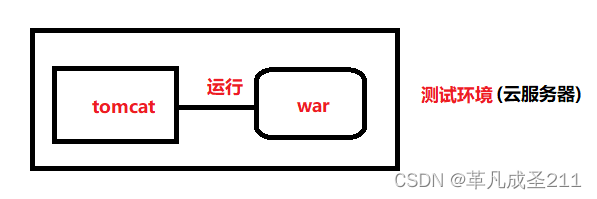

LR可以进行多分类吗?

-

采用一对多的方法扩展到多分类:

每次将一个类型作为正例,其他的作为反例,训练N个分类器。在预测阶段,每个分类器可以根据测试样本,得到当前正类的概率,选择概率最大的分类器,其正类就可以作为预测结果。

特点:效率较高,有多少个类别就训练多少个分类器,复杂度使O(n)。

但容易造成训练集样本数量的不平衡(Unbalance),尤其在类别较多的情况下,经常容易出现正类样本的数量远远不及负类样本的数量,这样就会造成分类器的偏向性。 -

一对一的方法:

将N个类别两两配对,得到多个分类器N ( N − 1 ) / 2,预测的时候,将样本通过所有分类器,通过投票来得到结果,最后票数最多的类别被认定为该样本的类

心得:对于逻辑回归的优缺点还需要加深理解,以及逻辑回归进行多分类方面的知识掌握还不牢固