1 卷积神经网络(CNN)可以做什么?

- 检测任务

- 分类与检索

- 超分辨率重构:将图像训练的更清晰

- 医学任务等

- 无人驾驶

- 人脸识别

2 用GPU:图像处理单元

比CPU块一百倍以上

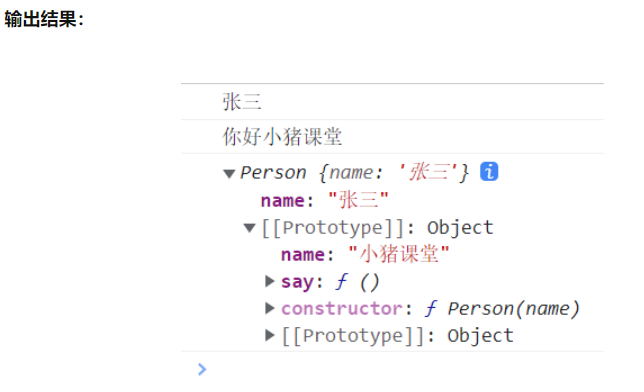

3 卷积神经网络与传统神经网络的区别

传统神经网络:将数据拉成向量

卷积神经网络:三维数据

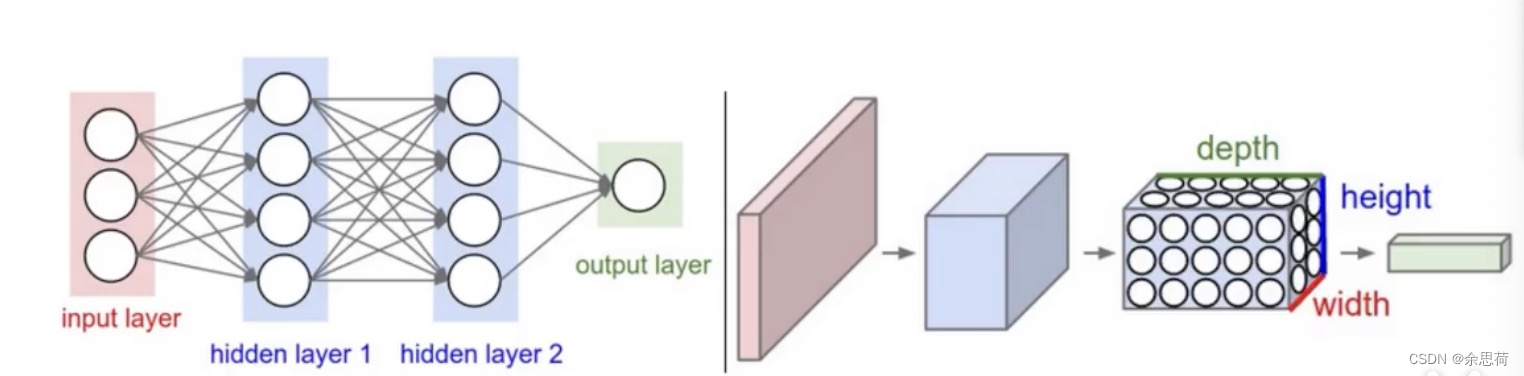

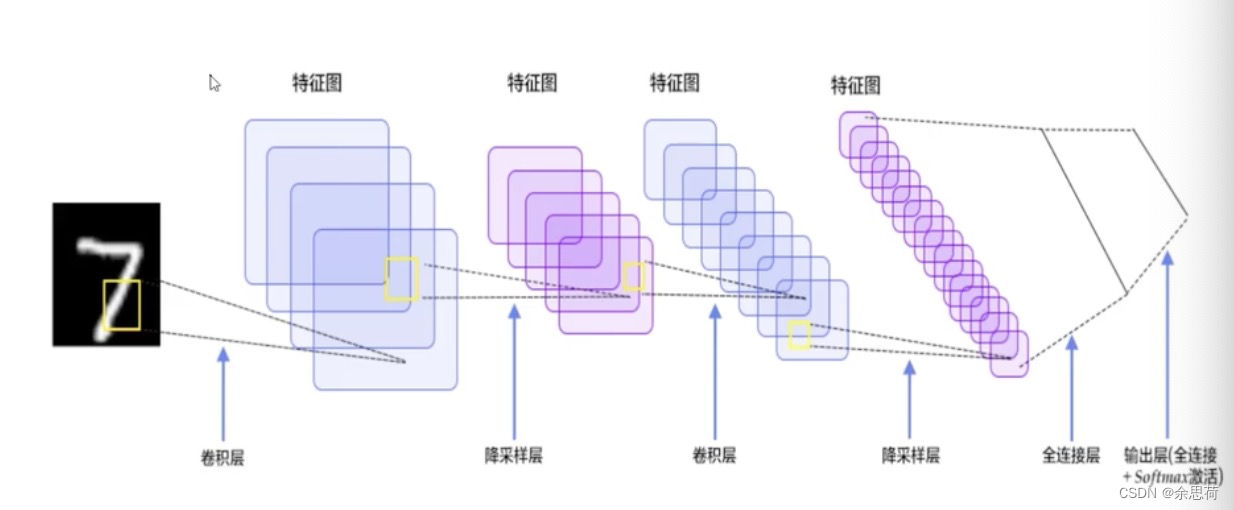

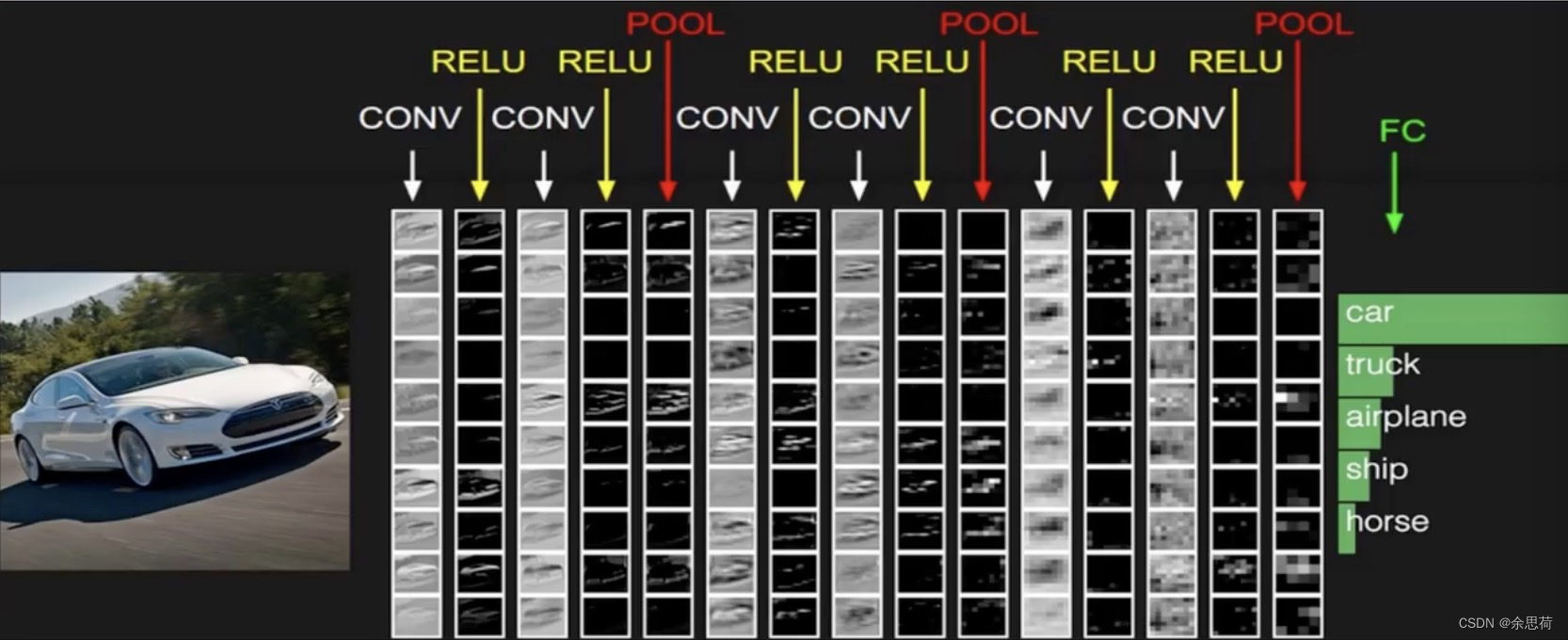

4 整体架构

- 输入层

- 卷积层:提取特征

- 池化层:压缩特征

- 全链接层

5 卷积进行特征提取:

绿色的:特征图

6 步长与卷积核大小对结果的影响

卷积网络中可以无限堆叠,但是并不是堆叠次数越高效果越好

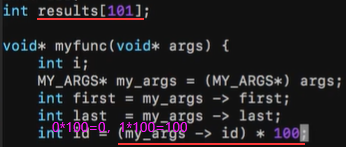

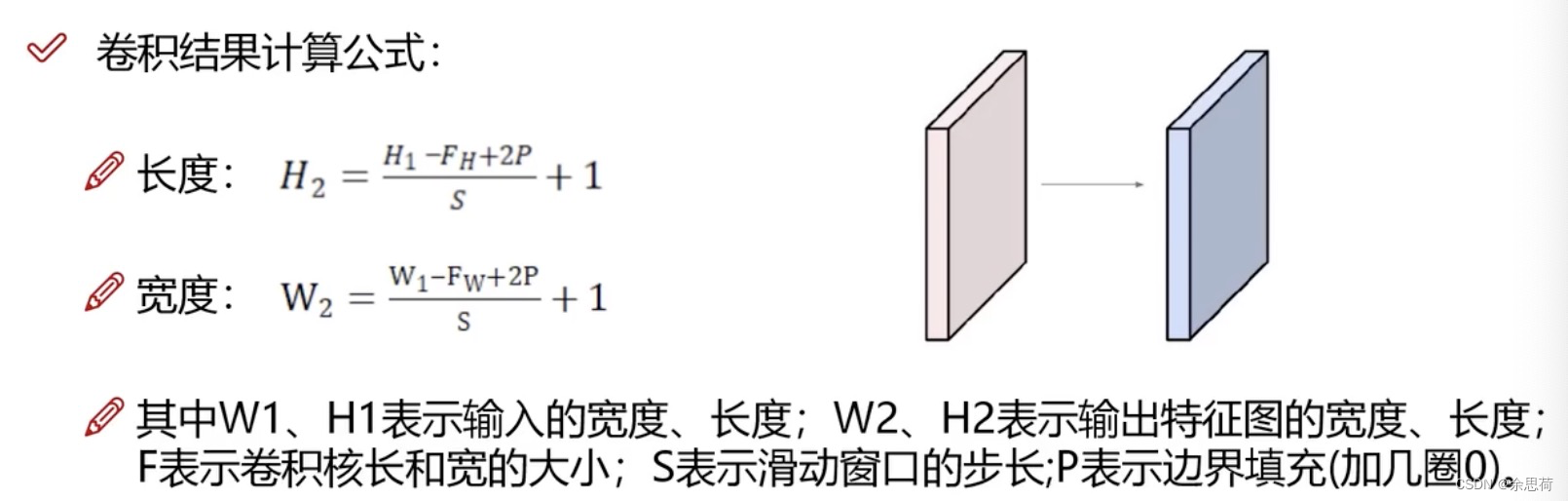

7 卷积层涉及参数

- 滑动窗口步长:移动窗口移动的步长决定特征图的大小(丰富度)一般为1

- 卷积核尺寸:一般用正方形卷积3✖️3(图像)

- 边缘填充:边缘的数据不一定不重要,所以用0填充图像的边缘保证图像数据被充分利用

- 卷积核个数:最后在计算过程当中要得到多少个特征图(相等)每个卷积核里面的数据都是不一样的:卷积核就是权重参数的三维版本

8 特征图尺寸计算与参数共享

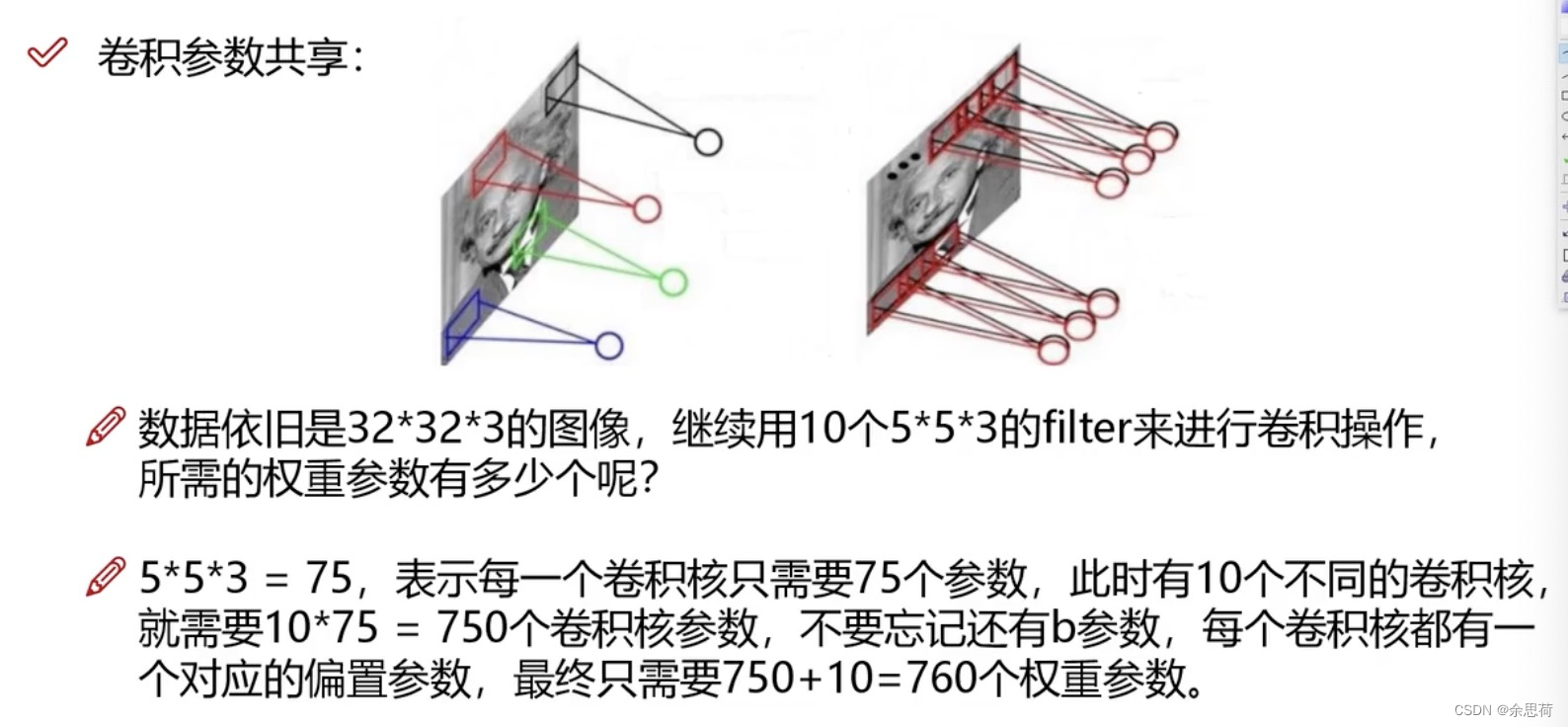

9 卷积参数共享

每个区域都是用相同的核进行训练的,参数是全局共享的

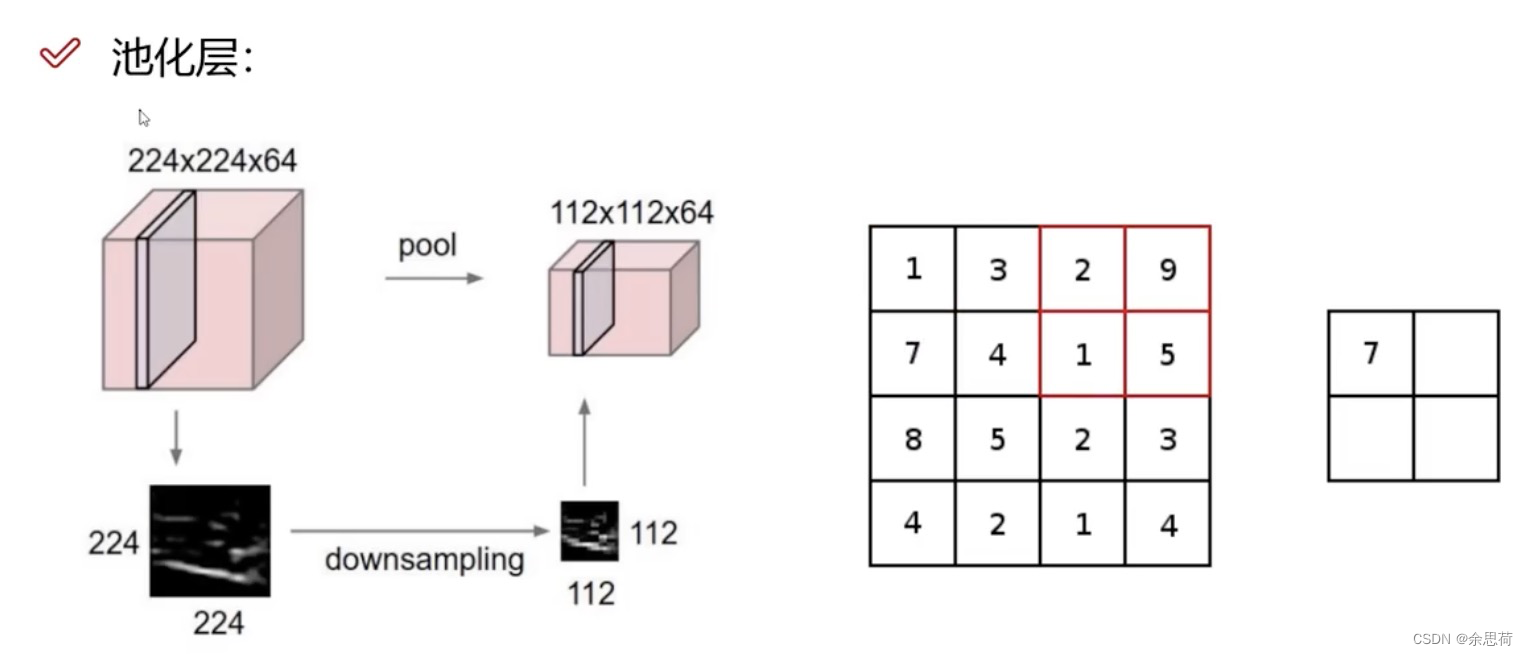

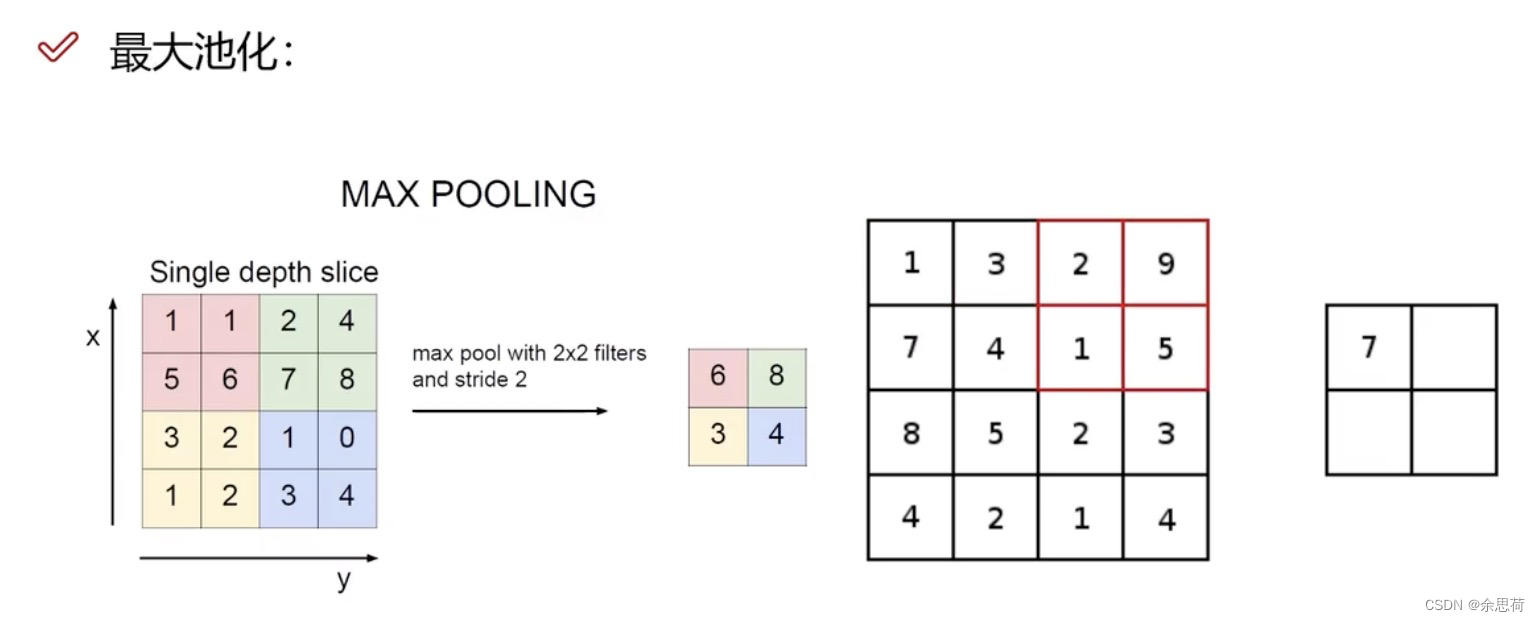

10 池化层的作用

池化层:进行压缩(下采样操作)相当于是数据瘦身

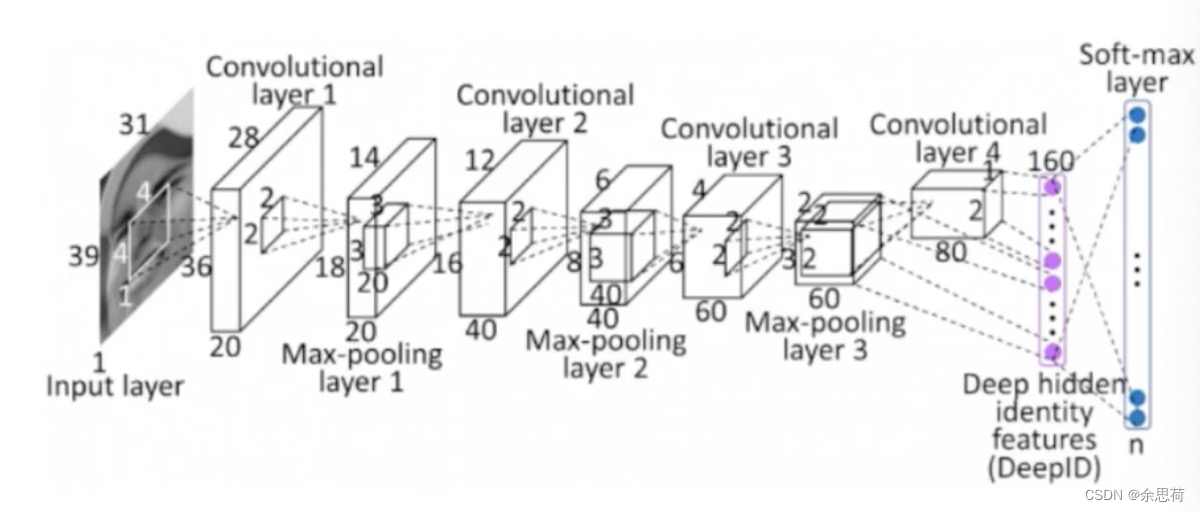

11 整体网络架构

全联接层要将所有的特征值拉成一个特征向量,然后进行五分类操作

【10240,5】将10240个特征转化成五个类别的概率

12 怎么判断神经网络有多少层

带参数计算的才算一层:卷积层,全联接层(上图为七层神经网络)

激活层,池化层没有参数,不算一层

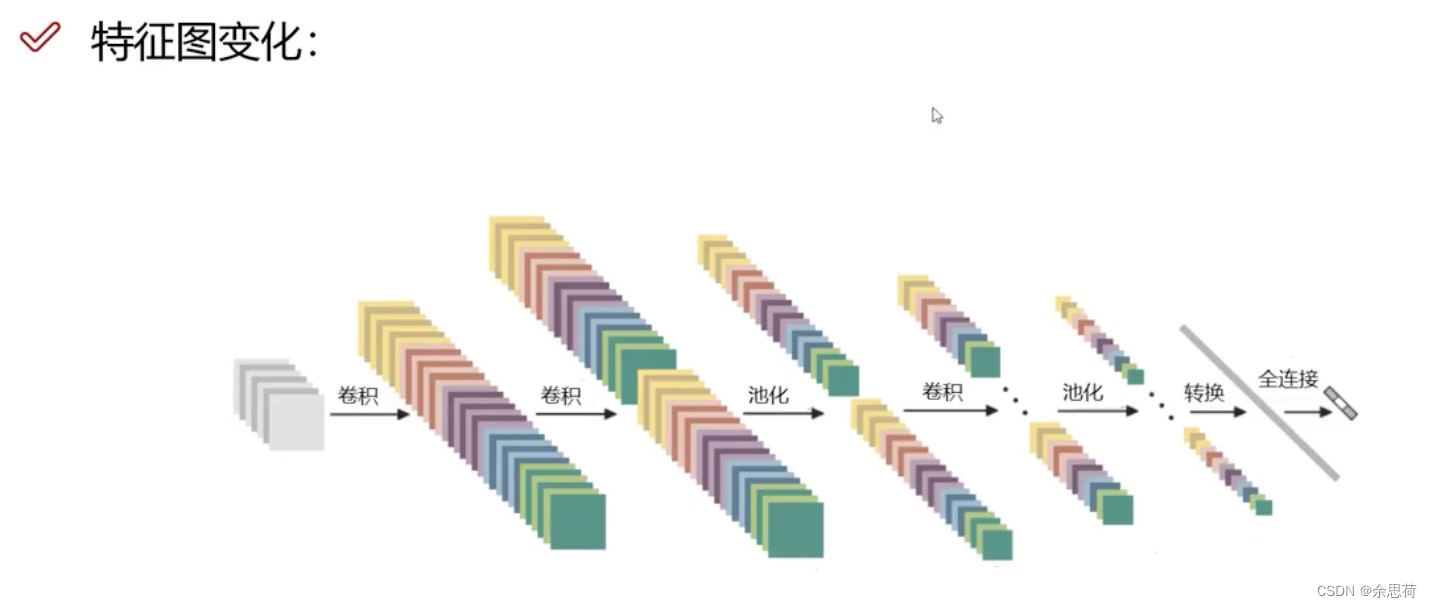

13 特征图的变换

14 历史上几种经典的神经网络

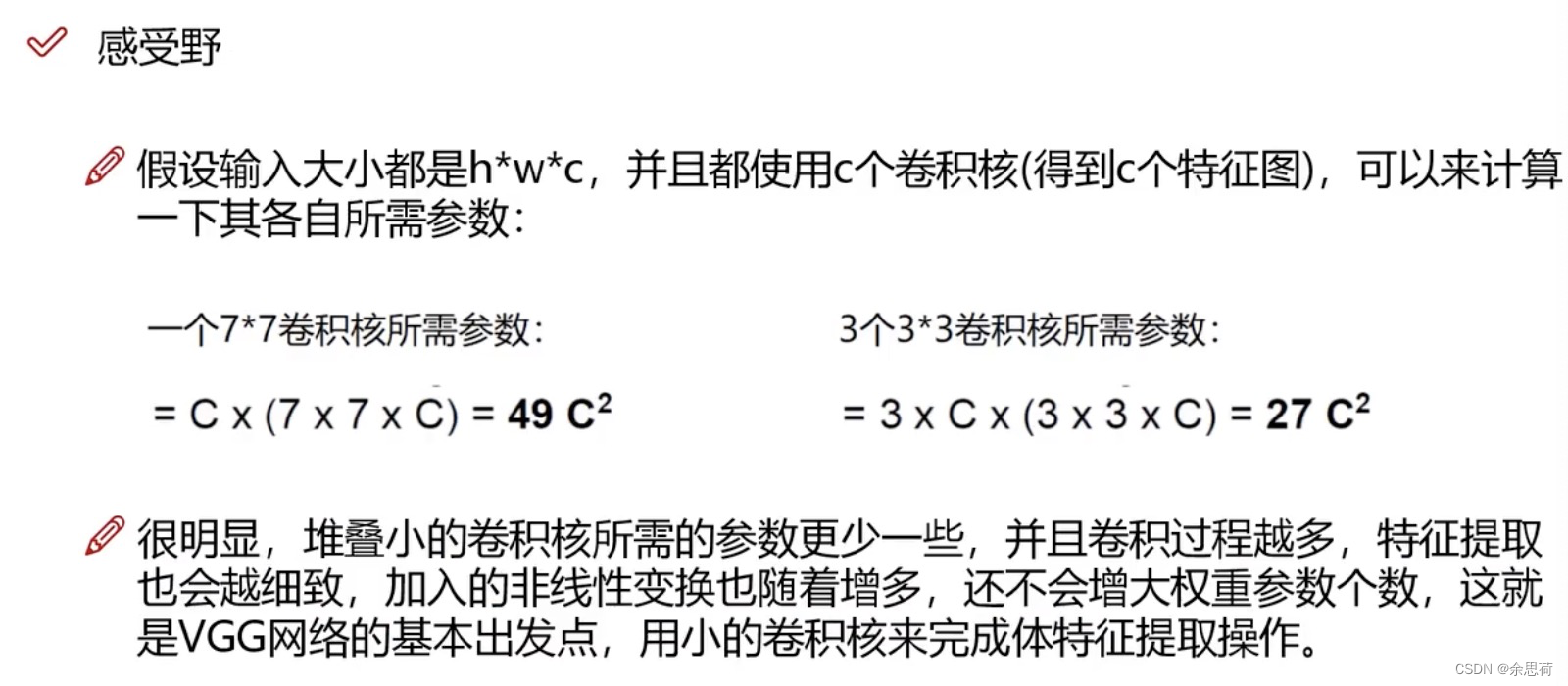

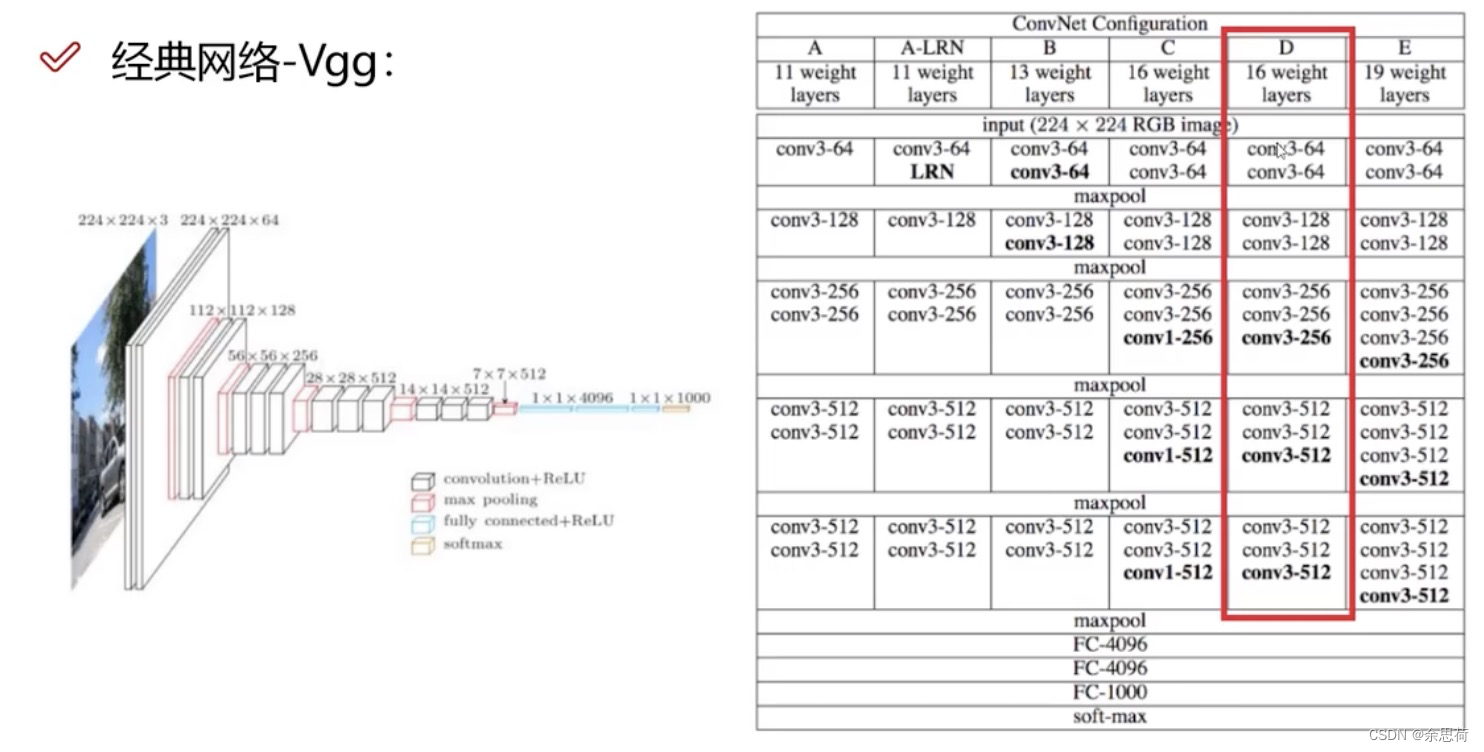

2014年:经典网络-VGG

所有卷积大小都是3✖️3 精细提取网络特征

当pooling之后会有数据损失,下次用卷积弥补起来,用特征图的个数弥补数据的确实

问题就是训练时间太久了,但效率比AIEXNEX高15%左右

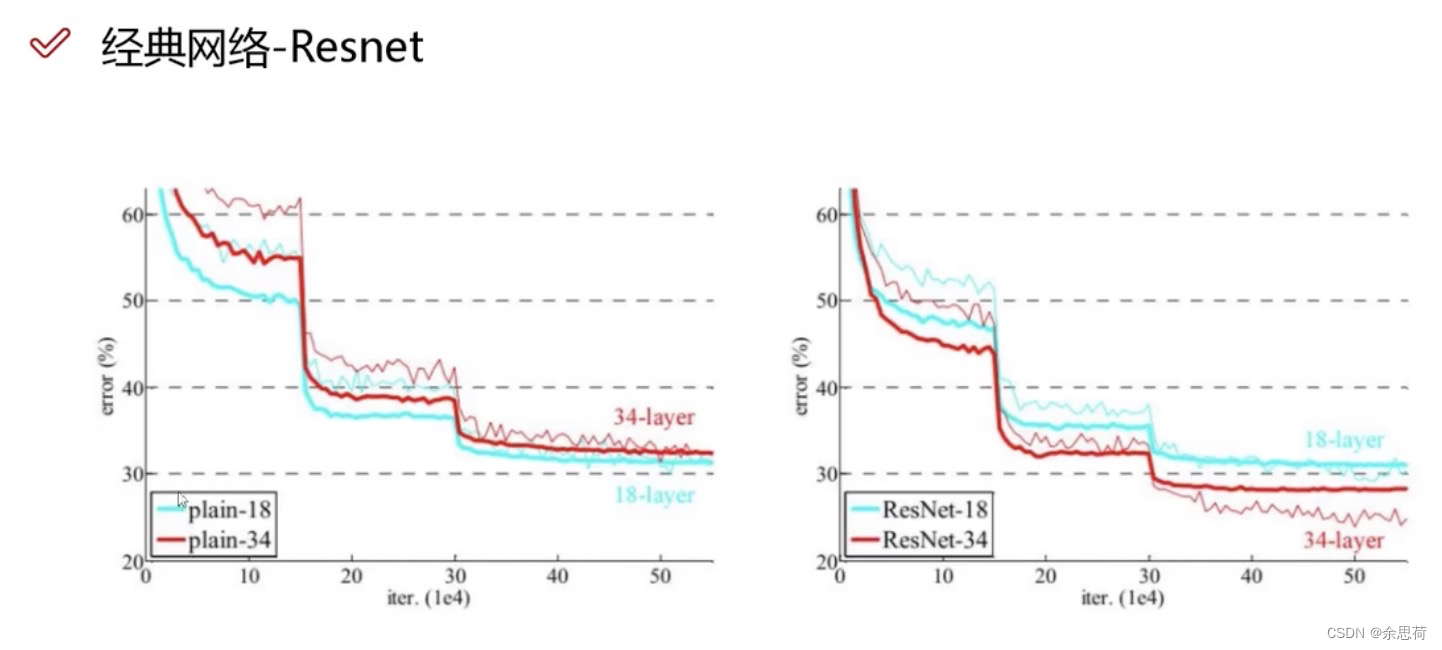

2015年:经典网络-Resnet 残差网络

现在是主流网络结构 最常见的是50层和101层

想要把层数堆叠起来,并且将不利于模型的层权重设为零

所以深度网络效果只能越来越好

左图:传统网络 右图:残差网络

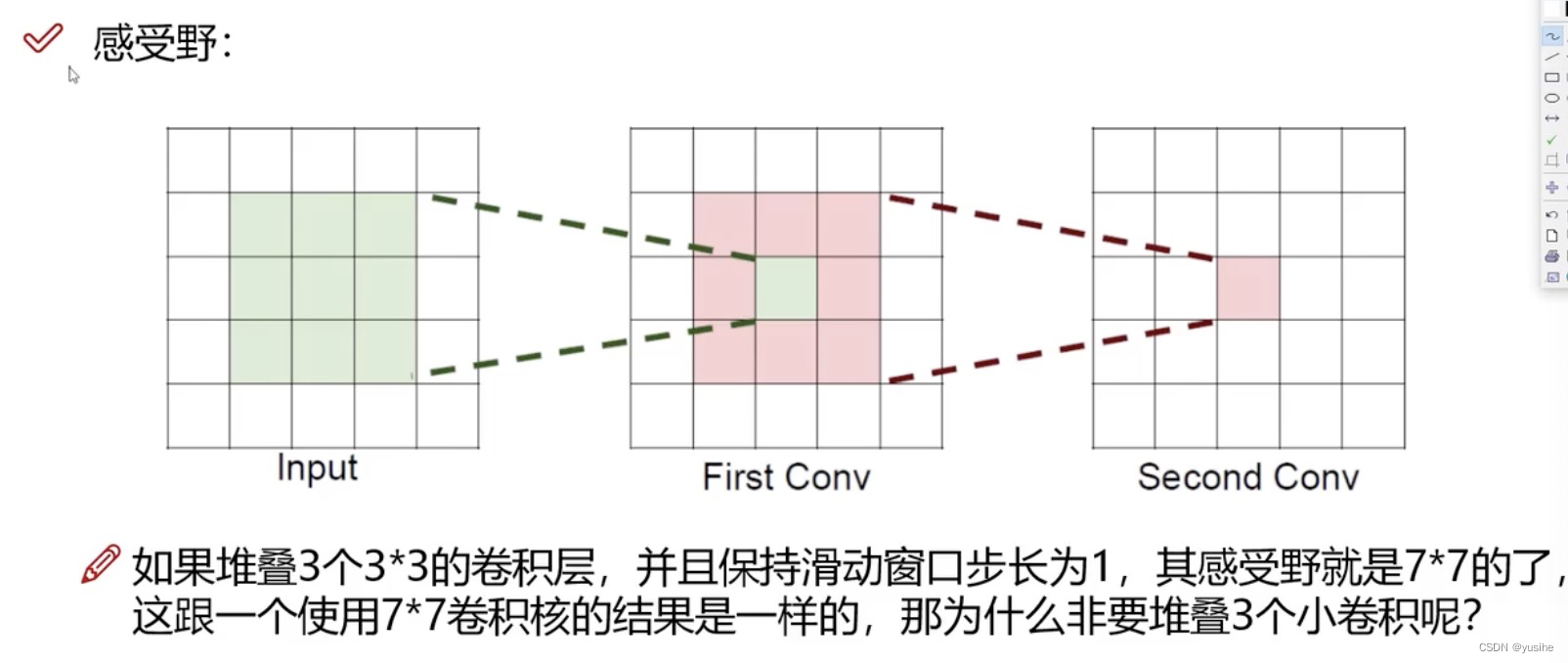

15 感受野

我们希望感受野越大越好