—从数据加密到权限管控,构建企业级AI安全防线

企业AIGC面临的5大数据安全风险

1. 数据出境违规

- 典型场景:

- 使用ChatGPT处理客户信息 → 数据经美国服务器中转 → 违反《个人信息保护法》第38条

- 某金融公司因通过Midjourney生成宣传图,导致产品参数泄露,被罚¥200万

2. 模型逆向攻击

- 黑客手段:

- 通过API反复查询,倒推训练数据(如“澳大利亚总理隐私泄露事件”)

- 恶意注入Prompt获取敏感信息(如“生成包含身份证号的测试数据”)

3. 内部泄密通道

- 员工行为:

- 将未发布的商品设计图上传至公共AI工具

- 通过AI生成内容夹带机密信息(如用Stable Diffusion隐写术嵌入数据)

4. 版权溯源追责

- 法律陷阱:

- AI生成内容含未授权素材(如迪士尼元素),被原作者起诉

- 训练数据未清洗,导致模型产出侵权内容

5. 供应链漏洞

- 第三方依赖风险:

- 开源模型(如LLaMA)可能植入后门代码

- 云服务商超权限访问数据(如AWS管理员可查看S3存储内容)

️ AIGC本地化部署的6层安全架构

1. 物理隔离网络

- 部署方案:

- 企业内网专属服务器,禁止外网访问

- 军工级隔离:光闸+单向数据传输(仅允许内部向外推送审核后内容)

- 硬件要求:

- mermaid

- 复制

- graph LR A[员工终端] --> B[DMZ区] --> C[AI服务器集群] C --> D[加密存储阵列]

2. 全链路加密

- 技术实现:

- 传输层存储层计算层国密SM4算法AES-256加密可信执行环境TEESSL双向认证分片存储+纠删码内存数据动态混淆

3. 权限最小化

- RBAC模型配置示例:

- yaml

- 复制

- # security/policy.yml roles: designer: permissions: - generate_image - use_template data_access: max_size: 10MB blacklist: ["身份证号", "银行卡"] admin: permissions: - model_fine_tune - view_audit_log

4. 数据清洗引擎

- 合规化流程:

- 输入过滤:屏蔽敏感词(对接网信办词库)

- 训练数据清洗:去除版权素材(使用DiffusionDB清洗工具)

- 输出检测:自动添加数字水印(含生成者/时间/设备指纹)

5. 审计与溯源

- 日志记录项:

- python

- 复制

- # 记录所有AI操作 audit_log = { "user": "zhangsan", "action": "generate_image", "prompt": "未来城市概念设计", "output_hash": "a1b2c3...", "timestamp": "2025-03-20T14:30:00+08:00" }

- 区块链存证:关键操作上链(采用Hyperledger Fabric私有链)

6. 漏洞防御体系

- 实时防护:

- 模型沙箱:隔离运行防止逆向工程

- 异常检测:API调用频率>100次/分钟自动熔断

- 渗透测试:

- bash

- 复制

- # 使用Kali Linux测试工具 nmap -sV 192.168.1.100 sqlmap -u "http://ai-server/api" --risk=3

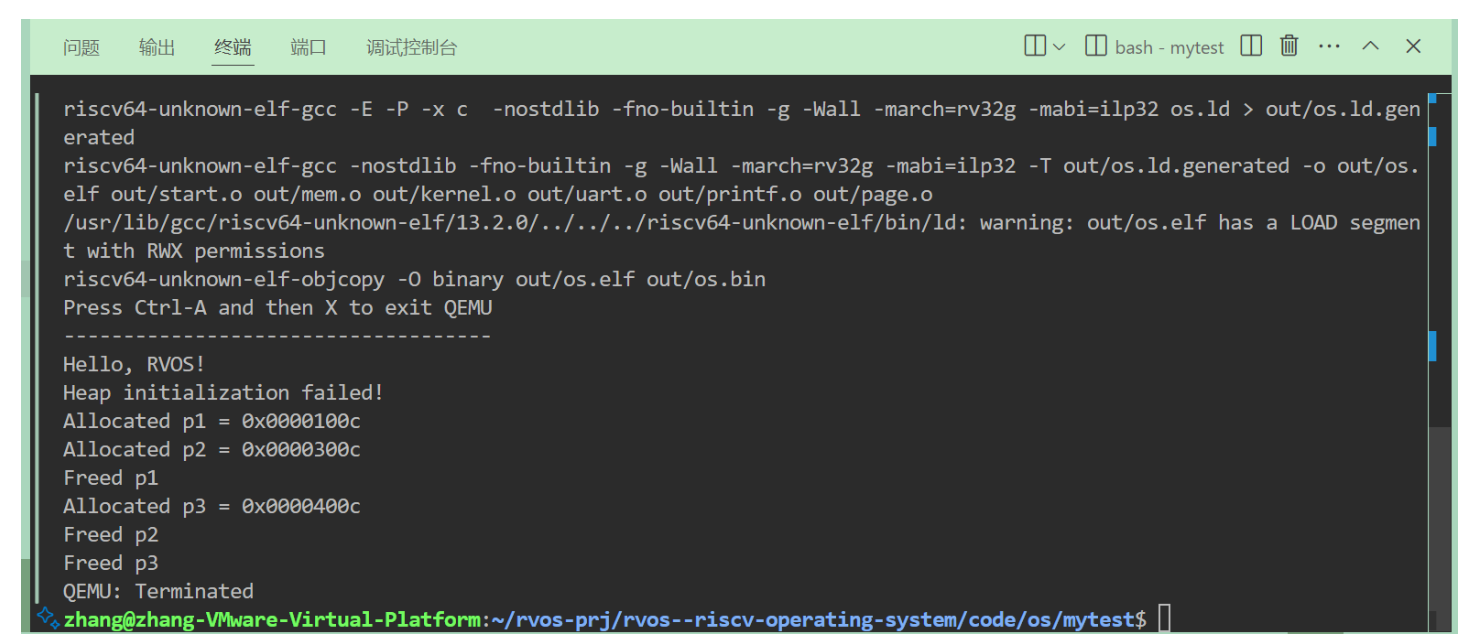

本地化部署实战(含代码)

1. 安全增强版Docker部署

bash

复制

# 使用铁威马OS安全基线

docker run -d \

--name bixiang-ai \

--security-opt seccomp=./seccomp.json \

--cap-drop ALL \

--read-only \

-v /encrypted_volume:/data \

bixiang/ai-secure:v3 2. 企业级身份认证

python

复制

from ldap3 import Server, Connection

# 对接AD域控

server = Server('ldap://corp.example.com')

conn = Connection(server, user='cn=admin,dc=example,dc=com', password='***')

if not conn.bind():

raise PermissionError("LDAP认证失败") 3. 敏感数据过滤

python

复制

from safety_checker import SafetyChecker

checker = SafetyChecker(

keyword_file="sensitive_words.txt",

image_nudity_filter=True

)

if checker.scan(prompt="生成上海浦东规划图"):

raise ValueError("输入含敏感词") 安全投入ROI分析

| 安全措施 | 成本投入 | 风险规避收益 |

| 本地化部署 | ¥50万/年 | 避免¥500万罚款 |

| 数据加密 | ¥15万/年 | 防止¥200万泄密损失 |

| 审计系统 | ¥8万/年 | 满足等保三级要求 |

| 合计 | ¥73万 | 规避¥700万风险 |

企业必做的5项安全自查

- 是否禁用模型微调接口的外网访问?

- 所有生成内容是否添加可追溯水印?

- 是否定期清理GPU显存中的残留数据?

- 员工操作日志是否保存180天以上?

- 是否通过《网络安全等级保护2.0》三级认证?

比象AI系统源码数据安全优势:

- 本地化部署:

- 支持完全断网运行,数据0出境

- 提供国产化硬件适配(华为昇腾/海光DCU)

- 安全认证:

✅ 通过等保三级✅ 符合《个人信息保护法》《数据安全法》

· 全链路国密加密

| 环节 | 技术方案 | 对比传统方案 |

| 数据传输 | SM4+SSL双向认证 | AES-256(可被量子破解) |

| 数据存储 | 分片加密+纠删码 | 明文存储 |

| 模型权重 | 动态混淆+量子噪声注入 | 开源模型裸奔 |