目录

1. 前言

2. 自编码器的基本概念

2.1 自编码器的结构

2.2 损失函数

3. 使用 PyTorch 构建自编码器:压缩数字图像

3.1 导入必要的库

3.2 定义自编码器模型

3.3 准备数据集

3.4 训练模型

3.5 可视化重建结果

3.6 完整代码

4. 自编码器的应用场景

5. 总结

1. 前言

在深度学习领域,自编码器(AutoEncoder)是一种无监督学习模型,用于学习数据的压缩表示并从中重建原始数据。它的核心思想是通过一个“压缩-解压缩”的过程,提取数据的关键特征,同时尽可能保留原始信息。自编码器在降噪、图像压缩、异常检测等领域有着广泛的应用。

本文将从自编码器的基本原理入手,结合详细的 PyTorch 代码实现,帮助你全面理解自编码器的工作机制,并通过一个完整的实例展示如何使用 PyTorch 构建和训练自编码器。

2. 自编码器的基本概念

自编码器是一种神经网络模型,主要由以下两部分组成:

-

编码器(Encoder):将输入数据压缩为低维的潜在空间表示(特征提取)。

-

解码器(Decoder):从潜在空间表示中重建原始数据(特征还原)。

自编码器的目标是尽可能准确地重建输入数据,同时通过瓶颈层(低维表示)限制模型的容量,从而学习到数据的高效表示。

2.1 自编码器的结构

自编码器的结构通常对称,分为以下三个主要部分:

-

输入层:接收原始数据。

-

隐藏层(瓶颈层):低维的潜在空间表示,用于捕捉数据的关键特征。

-

输出层:重建的原始数据。

2.2 损失函数

自编码器通常使用均方误差(MSE)或二元交叉熵(BCE)作为损失函数,衡量重建数据与原始数据之间的差异。

3. 使用 PyTorch 构建自编码器:压缩数字图像

以下是使用 PyTorch 构建和训练自编码器的完整代码示例:

3.1 导入必要的库

import torch

import torch.nn as nn

import torch.optim as optim

from torchvision import datasets, transforms

import matplotlib.pyplot as plt3.2 定义自编码器模型

class Autoencoder(nn.Module):

def __init__(self):

super(Autoencoder, self).__init__()

# 编码器部分

self.encoder = nn.Sequential(

nn.Linear(28 * 28, 128), # 输入维度为 28x28,输出维度为 128

nn.ReLU(True),

nn.Linear(128, 64), # 输入维度为 128,输出维度为 64

nn.ReLU(True),

nn.Linear(64, 12) # 输入维度为 64,输出维度为 12(瓶颈层)

)

# 解码器部分

self.decoder = nn.Sequential(

nn.Linear(12, 64), # 输入维度为 12,输出维度为 64

nn.ReLU(True),

nn.Linear(64, 128), # 输入维度为 64,输出维度为 128

nn.ReLU(True),

nn.Linear(128, 28 * 28), # 输入维度为 128,输出维度为 28x28

nn.Sigmoid() # 使用 Sigmoid 激活函数,输出范围在 [0, 1]

)

def forward(self, x):

x = self.encoder(x)

x = self.decoder(x)

return x3.3 准备数据集

# 数据预处理

transform = transforms.Compose([

transforms.ToTensor(), # 将图像转换为 Tensor

])

# 加载 MNIST 数据集

train_dataset = datasets.MNIST(root='./data', train=True, download=True, transform=transform)

test_dataset = datasets.MNIST(root='./data', train=False, transform=transform)

# 创建数据加载器

train_loader = torch.utils.data.DataLoader(train_dataset, batch_size=128, shuffle=True)

test_loader = torch.utils.data.DataLoader(test_dataset, batch_size=128, shuffle=False)3.4 训练模型

# 初始化模型、损失函数和优化器

model = Autoencoder()

criterion = nn.MSELoss() # 使用均方误差作为损失函数

optimizer = optim.Adam(model.parameters(), lr=0.001) # 使用 Adam 优化器

# 训练模型

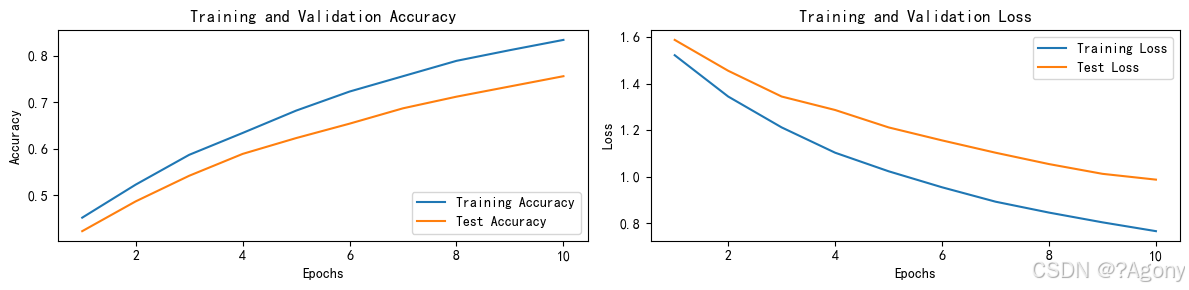

num_epochs = 10

for epoch in range(num_epochs):

for data in train_loader:

img, _ = data

img = img.view(img.size(0), -1) # 将图像展平为一维向量

# 前向传播

output = model(img)

loss = criterion(output, img)

# 反向传播和优化

optimizer.zero_grad()

loss.backward()

optimizer.step()

# 每个 epoch 打印一次损失

print(f'Epoch [{epoch+1}/{num_epochs}], Loss: {loss.item():.4f}')3.5 可视化重建结果

# 测试模型并可视化重建结果

with torch.no_grad():

for data in test_loader:

img, _ = data

img = img.view(img.size(0), -1)

output = model(img)

break

# 可视化原始图像和重建图像

plt.figure(figsize=(10, 5))

for i in range(5):

plt.subplot(2, 5, i+1)

plt.imshow(img[i].reshape(28, 28).numpy(), cmap='gray')

plt.title('Original')

plt.axis('off')

plt.subplot(2, 5, i+6)

plt.imshow(output[i].reshape(28, 28).numpy(), cmap='gray')

plt.title('Reconstructed')

plt.axis('off')

plt.tight_layout()

plt.show()3.6 完整代码

完整代码如下用于调试

import os

os.environ['KMP_DUPLICATE_LIB_OK'] = 'TRUE'

import torch

import torch.nn as nn

import torch.optim as optim

from torchvision import datasets, transforms

import matplotlib.pyplot as plt

class Autoencoder(nn.Module):

def __init__(self):

super(Autoencoder, self).__init__()

# 编码器部分

self.encoder = nn.Sequential(

nn.Linear(28 * 28, 128), # 输入维度为 28x28,输出维度为 128

nn.ReLU(True),

nn.Linear(128, 64), # 输入维度为 128,输出维度为 64

nn.ReLU(True),

nn.Linear(64, 12) # 输入维度为 64,输出维度为 12(瓶颈层)

)

# 解码器部分

self.decoder = nn.Sequential(

nn.Linear(12, 64), # 输入维度为 12,输出维度为 64

nn.ReLU(True),

nn.Linear(64, 128), # 输入维度为 64,输出维度为 128

nn.ReLU(True),

nn.Linear(128, 28 * 28), # 输入维度为 128,输出维度为 28x28

nn.Sigmoid() # 使用 Sigmoid 激活函数,输出范围在 [0, 1]

)

def forward(self, x):

x = self.encoder(x)

x = self.decoder(x)

return x

# 数据预处理

transform = transforms.Compose([

transforms.ToTensor(), # 将图像转换为 Tensor

])

# 加载 MNIST 数据集

train_dataset = datasets.MNIST(root='./data', train=True, download=True, transform=transform)

test_dataset = datasets.MNIST(root='./data', train=False, transform=transform)

# 创建数据加载器

train_loader = torch.utils.data.DataLoader(train_dataset, batch_size=128, shuffle=True)

test_loader = torch.utils.data.DataLoader(test_dataset, batch_size=128, shuffle=False)

# 初始化模型、损失函数和优化器

model = Autoencoder()

criterion = nn.MSELoss() # 使用均方误差作为损失函数

optimizer = optim.Adam(model.parameters(), lr=0.001) # 使用 Adam 优化器

# 训练模型

num_epochs = 10

for epoch in range(num_epochs):

for data in train_loader:

img, _ = data

img = img.view(img.size(0), -1) # 将图像展平为一维向量

# 前向传播

output = model(img)

loss = criterion(output, img)

# 反向传播和优化

optimizer.zero_grad()

loss.backward()

optimizer.step()

# 每个 epoch 打印一次损失

print(f'Epoch [{epoch+1}/{num_epochs}], Loss: {loss.item():.4f}')

print(img.shape)

# 测试模型并可视化重建结果

with torch.no_grad():

for data in test_loader:

img, _ = data

img = img.view(img.size(0), -1)

output = model(img)

break

print(img.shape)

# 可视化原始图像和重建图像

plt.figure(figsize=(10, 5))

for i in range(6):

plt.subplot(2, 6, i+1)

plt.imshow(img[i].reshape(28, 28).numpy(), cmap='gray')

plt.title('Original')

plt.axis('off')

plt.subplot(2, 6, i+7)

plt.imshow(output[i].reshape(28, 28).numpy(), cmap='gray')

plt.title('Reconstructed')

plt.axis('off')

plt.tight_layout()

plt.show()4. 自编码器的应用场景

自编码器在许多领域都有广泛的应用,以下是一些典型的场景:

-

降噪:通过学习数据的干净和噪声版,可以去除图片的噪声。

-

图像压缩:通过有效的编码方式减少图像存储数据的需求。

-

异常检测:在工业监控和医疗影像中,识别未见过的模式。

-

特征提取:作为预训练模型,为下游任务(如分类)提供更好的特征表示。

5. 总结

自编码器是一种强大的无监督学习模型,能够自动学习数据的特征表示并用于重建原始数据。通过 PyTorch,构建和训练自编码器变得简单高效。本文通过一个完整的实例,展示了如何使用 PyTorch 实现自编码器,并可视化了重建效果。

自编码器的核心在于通过“压缩-解压缩”的过程提取数据的关键特征,虽然它在某些任务上可能不如更复杂的模型(如变分自编码器或生成对抗网络),但它仍然是一个非常有用的工具,尤其是在特征提取和降维任务中。希望本文能帮助你入门自编码器的实现,并激发你在此领域的进一步探索!我是橙色小博,关注我,一起在人工智能领域学习进步!

![每日一题洛谷P8649 [蓝桥杯 2017 省 B] k 倍区间c++](https://i-blog.csdnimg.cn/direct/fd17fb358bdf4ce2bac05457902556ba.jpeg)