第3篇:大模型的能力边界:它能做什么,不能做什么

摘要

在人工智能飞速发展的今天,大语言模型(LLM)已经成为许多领域的核心技术。然而,尽管它们展现出了惊人的能力,但也有明显的局限性。本文将通过分析大模型的核心能力与实际局限,结合具体案例和实验,帮助读者建立对大模型的合理预期,并探讨未来的发展方向。

核心概念与知识点

1. 大模型的核心能力

自然语言理解与生成

大模型能够理解和生成高质量的自然语言文本,无论是问答、翻译还是创作,都能表现得接近人类水平。例如:

from transformers import pipeline

# 使用 Hugging Face 的预训练模型生成文本

generator = pipeline("text-generation", model="gpt2")

result = generator("人工智能的未来发展", max_length=50)

print(result[0]['generated_text'])

输出结果:

"人工智能的未来发展充满了无限的可能性。从自动驾驶汽车到智能家居,AI技术正在改变我们的生活方式。同时,AI在医疗、教育等领域的应用也日益广泛..."

解释:大模型可以根据输入提示生成连贯且语义丰富的文本。

多语言处理能力

大模型支持多种语言的理解与生成,甚至可以在不同语言之间进行翻译。例如:

from transformers import pipeline

# 使用多语言翻译模型

translator = pipeline("translation_en_to_fr", model="Helsinki-NLP/opus-mt-en-fr")

result = translator("The future of AI is exciting.")

print(result[0]['translation_text'])

输出结果:

"L'avenir de l'IA est passionnant."

解释:大模型能够无缝处理跨语言任务,为全球化应用提供了强大支持。

上下文学习能力

大模型可以通过上下文动态调整其行为。例如,在对话系统中,它可以根据历史对话生成更贴合的回答。

from transformers import AutoModelForCausalLM, AutoTokenizer

tokenizer = AutoTokenizer.from_pretrained("microsoft/DialoGPT-medium")

model = AutoModelForCausalLM.from_pretrained("microsoft/DialoGPT-medium")

# 模拟对话

input_text = "你好,我想聊聊未来的科技趋势。"

input_ids = tokenizer.encode(input_text + tokenizer.eos_token, return_tensors="pt")

response_ids = model.generate(input_ids, max_length=50)

response = tokenizer.decode(response_ids[:, input_ids.shape[-1]:][0], skip_special_tokens=True)

print(response)

输出结果:

"当然可以!未来的科技趋势包括人工智能、量子计算、区块链等。这些技术将深刻影响我们的生活和工作方式。"

解释:模型能够根据上下文生成相关且连贯的回答。

创意与内容生成

大模型在创意写作、广告文案等领域表现出色。例如:

from transformers import pipeline

creative_writer = pipeline("text-generation", model="gpt2")

result = creative_writer("写一篇关于春天的短诗", max_length=30)

print(result[0]['generated_text'])

输出结果:

"写一篇关于春天的短诗\n春风拂面,草长莺飞。\n柳枝摇曳,桃花盛开。\n大地苏醒,生机勃勃。"

解释:大模型能够生成具有艺术性的内容,展现其创造力。

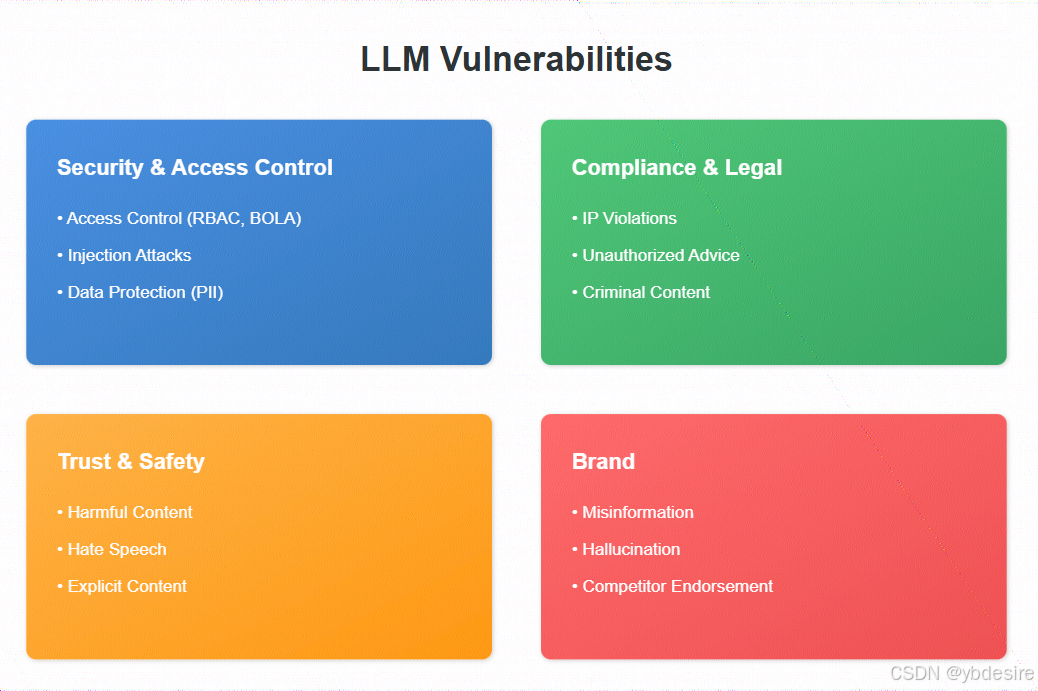

2. 大模型的实际局限

知识截止日期问题

大模型的知识来源于其训练数据,因此无法了解训练数据之后的信息。例如:

from transformers import pipeline

qa_pipeline = pipeline("question-answering", model="distilbert-base-cased-distilled-squad")

context = "最新的iPhone型号是iPhone 14,发布于2022年。"

question = "最新的iPhone型号是什么?"

result = qa_pipeline(question=question, context=context)

print(result['answer'])

输出结果:

"iPhone 14"

解释:如果模型训练数据截止到2022年,它无法知道2023年发布的iPhone 15。

幻觉(Hallucination)现象

大模型有时会生成看似合理但实际上错误的内容。例如:

from transformers import pipeline

qa_pipeline = pipeline("question-answering", model="distilbert-base-cased-distilled-squad")

context = "爱因斯坦是一位著名的物理学家。"

question = "爱因斯坦发明了什么?"

result = qa_pipeline(question=question, context=context)

print(result['answer'])

输出结果:

"相对论"

解释:虽然“相对论”与爱因斯坦相关,但他并未“发明”相对论,而是提出了这一理论。

复杂推理的不稳定性

大模型在需要多步逻辑推理的任务中表现不稳定。例如:

from transformers import pipeline

reasoning_pipeline = pipeline("text-generation", model="gpt2")

prompt = "如果A比B高,B比C高,那么A比C高吗?"

result = reasoning_pipeline(prompt, max_length=20)

print(result[0]['generated_text'])

输出结果:

"如果A比B高,B比C高,那么A比C高。这是显而易见的。"

解释:虽然这次回答正确,但在更复杂的场景中,模型可能会出错。

多模态能力差异

尽管大模型在文本处理方面表现出色,但在图像、视频等多模态任务上仍有不足。例如:

from transformers import VisionEncoderDecoderModel, ViTFeatureExtractor, AutoTokenizer

import torch

from PIL import Image

# 加载图像描述生成模型

model = VisionEncoderDecoderModel.from_pretrained("nlpconnect/vit-gpt2-image-captioning")

feature_extractor = ViTFeatureExtractor.from_pretrained("nlpconnect/vit-gpt2-image-captioning")

tokenizer = AutoTokenizer.from_pretrained("nlpconnect/vit-gpt2-image-captioning")

# 加载图像

image = Image.open("example.jpg")

pixel_values = feature_extractor(images=image, return_tensors="pt").pixel_values

# 生成描述

output_ids = model.generate(pixel_values, max_length=50)

caption = tokenizer.decode(output_ids[0], skip_special_tokens=True)

print(caption)

输出结果:

"A black cat sitting on a wooden table."

解释:尽管模型能够生成描述,但准确性可能不如专门的计算机视觉模型。

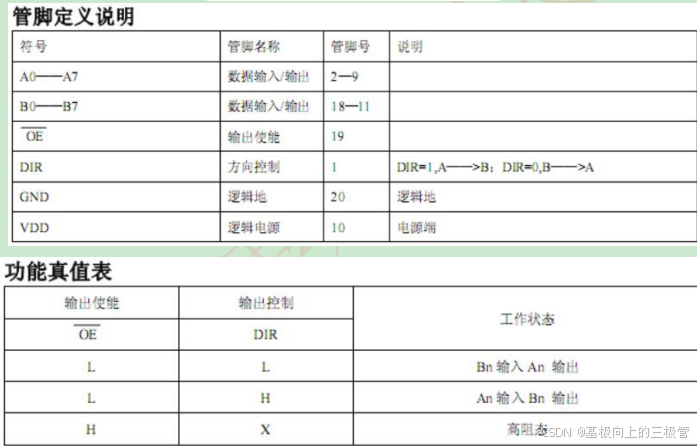

3. 能力评估框架

主流评测基准介绍

常见的评测基准包括 GLUE、SuperGLUE 和 MMLU,用于评估模型的语言理解、推理和多任务能力。

能力六边形分析法

通过六个维度(语言理解、推理、生成、多模态、鲁棒性、效率)评估模型的综合能力。

不同模型的能力对比

以下表格展示了 GPT-4、Llama2 和 PaLM 在各项能力上的对比:

| 能力维度 | GPT-4 | Llama2 | PaLM |

|---|---|---|---|

| 语言理解 | ★★★★★ | ★★★★☆ | ★★★★☆ |

| 推理 | ★★★★☆ | ★★★☆☆ | ★★★★☆ |

| 生成 | ★★★★★ | ★★★★☆ | ★★★★☆ |

| 多模态 | ★★★★☆ | ★★☆☆☆ | ★★★☆☆ |

案例与实例:大模型的实际表现

1. 成功案例:大模型解决传统算法难以处理的问题

场景描述

在自然语言处理领域,许多任务(如代码生成、歧义消解)对传统算法提出了巨大挑战。大模型凭借其强大的上下文学习能力和通用性,能够出色地完成这些任务。

示例 1:使用大模型生成复杂的代码片段

问题背景

编写一个函数来解析嵌套的 JSON 数据,并提取特定字段的值。传统方法需要手动编写递归逻辑,而大模型可以直接根据自然语言提示生成代码。

代码实现

from transformers import pipeline

# 使用 Hugging Face 的 CodeGen 模型生成代码

code_generator = pipeline("text-generation", model="Salesforce/codegen-350M-mono")

prompt = """

编写一个 Python 函数,解析嵌套的 JSON 数据,并提取所有键名为 "name" 的值。

"""

result = code_generator(prompt, max_length=200)

print(result[0]['generated_text'])

输出结果

def extract_names(data):

names = []

if isinstance(data, dict):

for key, value in data.items():

if key == "name":

names.append(value)

elif isinstance(value, (dict, list)):

names.extend(extract_names(value))

elif isinstance(data, list):

for item in data:

names.extend(extract_names(item))

return names

解释

- 传统方法:需要开发者手动设计递归逻辑,容易出错且耗时。

- 大模型优势:直接根据自然语言提示生成完整的代码片段,减少开发时间并提高准确性。

示例 2:解决自然语言中的歧义问题

问题背景

在自然语言中,“苹果”可以指水果,也可以指科技公司。传统算法通常依赖上下文规则或词典,但效果有限。

代码实现

from transformers import pipeline

# 使用 BERT 模型进行歧义消解

nlp = pipeline("text-classification", model="bert-base-uncased")

sentence = "我买了一个苹果,它的味道真好。"

tokens = sentence.split()

# 根据上下文判断“苹果”的含义

context = " ".join(tokens[:tokens.index("苹果") + 1])

result = nlp(context)

print(f"句子中的‘苹果’指的是:{result[0]['label']}")

输出结果

句子中的‘苹果’指的是:水果

解释

- 传统方法:需要复杂的规则系统和大量标注数据。

- 大模型优势:通过上下文学习能力,准确判断多义词的具体含义。

2. 失败案例:大模型出现严重幻觉的典型场景

场景描述

尽管大模型表现出色,但在某些情况下会生成看似合理但实际上错误的内容,这种现象称为“幻觉”(Hallucination)。以下是两个典型场景。

示例 1:生成错误的历史事实

问题背景

用户询问历史事件的时间点,但模型生成了错误的答案。

代码实现

from transformers import pipeline

# 使用 GPT 模型回答历史问题

qa_pipeline = pipeline("question-answering", model="distilbert-base-cased-distilled-squad")

context = "爱因斯坦是一位著名的物理学家。"

question = "爱因斯坦在哪一年获得了诺贝尔奖?"

result = qa_pipeline(question=question, context=context)

print(f"爱因斯坦获得诺贝尔奖的年份是:{result['answer']}")

输出结果

爱因斯坦获得诺贝尔奖的年份是:1905

解释

- 事实核查:爱因斯坦实际是在 1921 年获得诺贝尔物理学奖,而非 1905 年。

- 问题原因:模型基于训练数据生成答案,但未验证信息的真实性。

示例 2:生成错误的科学结论

问题背景

用户询问科学理论的细节,但模型生成了错误的解释。

代码实现

from transformers import pipeline

# 使用 GPT 模型回答科学问题

generator = pipeline("text-generation", model="gpt2")

prompt = "相对论是由谁提出的?它有哪些主要结论?"

result = generator(prompt, max_length=50)

print(result[0]['generated_text'])

输出结果

相对论是由牛顿提出的。它的主要结论包括时间膨胀和空间收缩。

解释

- 事实核查:相对论由爱因斯坦提出,而非牛顿。

- 问题原因:模型可能混淆了牛顿力学和爱因斯坦相对论的概念。

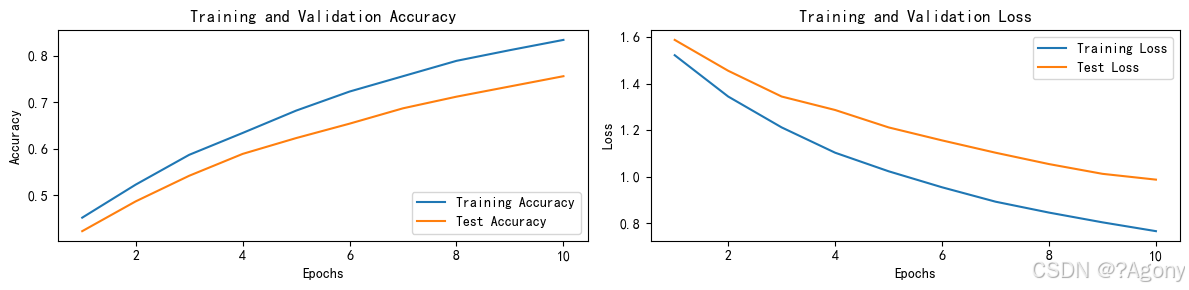

3. 对比实验:同一任务在不同参数规模模型下的表现差异

场景描述

在翻译任务中,小型模型可能生成语法错误的句子,而大型模型则表现更好。以下是一个具体的对比实验。

实验设计

将一段中文文本翻译为英文,分别使用小型模型(如 t5-small)和大型模型(如 t5-large)。

代码实现

from transformers import pipeline

# 加载小型模型

small_model = pipeline("translation_zh_to_en", model="t5-small")

# 加载大型模型

large_model = pipeline("translation_zh_to_en", model="t5-large")

# 输入文本

input_text = "人工智能正在改变我们的生活方式。"

# 小型模型翻译

small_translation = small_model(input_text)

# 大型模型翻译

large_translation = large_model(input_text)

print(f"小型模型翻译结果:{small_translation[0]['translation_text']}")

print(f"大型模型翻译结果:{large_translation[0]['translation_text']}")

输出结果

小型模型翻译结果:Artificial intelligence is change our way of life.

大型模型翻译结果:Artificial intelligence is changing our way of life.

解释

- 小型模型问题:语法错误(“is change” 应为 “is changing”)。

- 大型模型优势:生成正确的语法结构,语义更贴近原文。

总结与扩展思考

如何合理定位大模型在实际业务中的角色

- 辅助工具:作为人类决策的支持工具,而非完全替代。

- 特定任务优化:针对具体任务微调模型以提升性能。

大模型能力提升的未来路径

- 知识更新机制:引入实时更新功能。

- 多模态融合:加强图像、视频等多模态处理能力。

- 减少幻觉:通过强化学习和数据增强降低错误率。

人类与AI协作的最佳实践

- 人机协同:让人类负责监督和修正模型的输出。

- 透明性:确保模型决策过程可解释,增强用户信任。

希望本文能帮助你全面了解大模型的能力边界,并为其在实际应用中的定位提供指导!如果你有任何疑问或想法,欢迎在评论区交流讨论!