Does Transliteration Help Multilingual Language Modeling?

➡️ 论文标题:Does Transliteration Help Multilingual Language Modeling?

➡️ 论文作者:Ibraheem Muhammad Moosa, Mahmud Elahi Akhter, Ashfia Binte Habib

➡️ 研究机构: Pennsylvania State University, North South University, Dhaka, Bangladesh

➡️ 问题背景:多语言语言模型(MLLMs)在处理多种语言任务时表现出色,但不同语言使用不同的书写系统(scripts)导致了跨语言表示学习的障碍。特别是对于资源较少的语言,这种障碍更加明显。因此,将相关语言的书写系统转换为统一的书写系统(如拉丁字母)可能有助于提高MLLMs的下游任务性能。

➡️ 研究动机:现有的研究表明,通过将不同书写系统的语言转换为统一的书写系统,可以提高MLLMs在资源较少语言上的性能,而不会对资源较多的语言产生负面影响。为了验证这一发现,研究团队通过严格的实验设计和统计分析,评估了转换书写系统对MLLMs性能的影响,并探讨了其背后的机制。

➡️ 方法简介:研究团队使用ALBERT和RemBERT模型,分别在原始书写系统和转换为统一书写系统的数据上进行预训练。然后,这些模型在IndicGLUE基准数据集上的多个下游任务上进行微调和评估。为了确保结果的可靠性,每个任务都使用九个不同的随机种子进行微调。此外,研究团队还使用中心化核对齐(CKA)方法,测量了模型在不同语言平行句子上的跨语言表示相似性。

➡️ 实验设计:实验在IndicGLUE基准数据集的四个下游任务上进行,包括新闻文章分类、Wikipedia Section Title Prediction、CSQA和命名实体识别(NER)。实验设计了多个评估指标,包括准确率、F1分数等,以全面评估模型在不同任务上的表现。此外,研究团队还进行了Mann-Whitney U测试,以统计学方法验证转换书写系统对模型性能的影响是否显著。

Multi-modal Large Language Model Enhanced Pseudo 3D Perception Framework for Visual Commonsense Reasoning

➡️ 论文标题:Multi-modal Large Language Model Enhanced Pseudo 3D Perception Framework for Visual Commonsense Reasoning

➡️ 论文作者:Jian Zhu, Hanli Wang, Miaojing Shi

➡️ 研究机构: 同济大学、同济大学电子与信息工程学院

➡️ 问题背景:视觉常识推理(Visual Commonsense Reasoning, VCR)任务要求根据给定的图像和文本问题选择答案并提供合理的解释。现有的方法虽然能够识别图像中的对象并将其与文本中的关键词关联,但忽略了对象在场景中的精确位置,这导致了对对象关系和视觉场景理解的不准确。

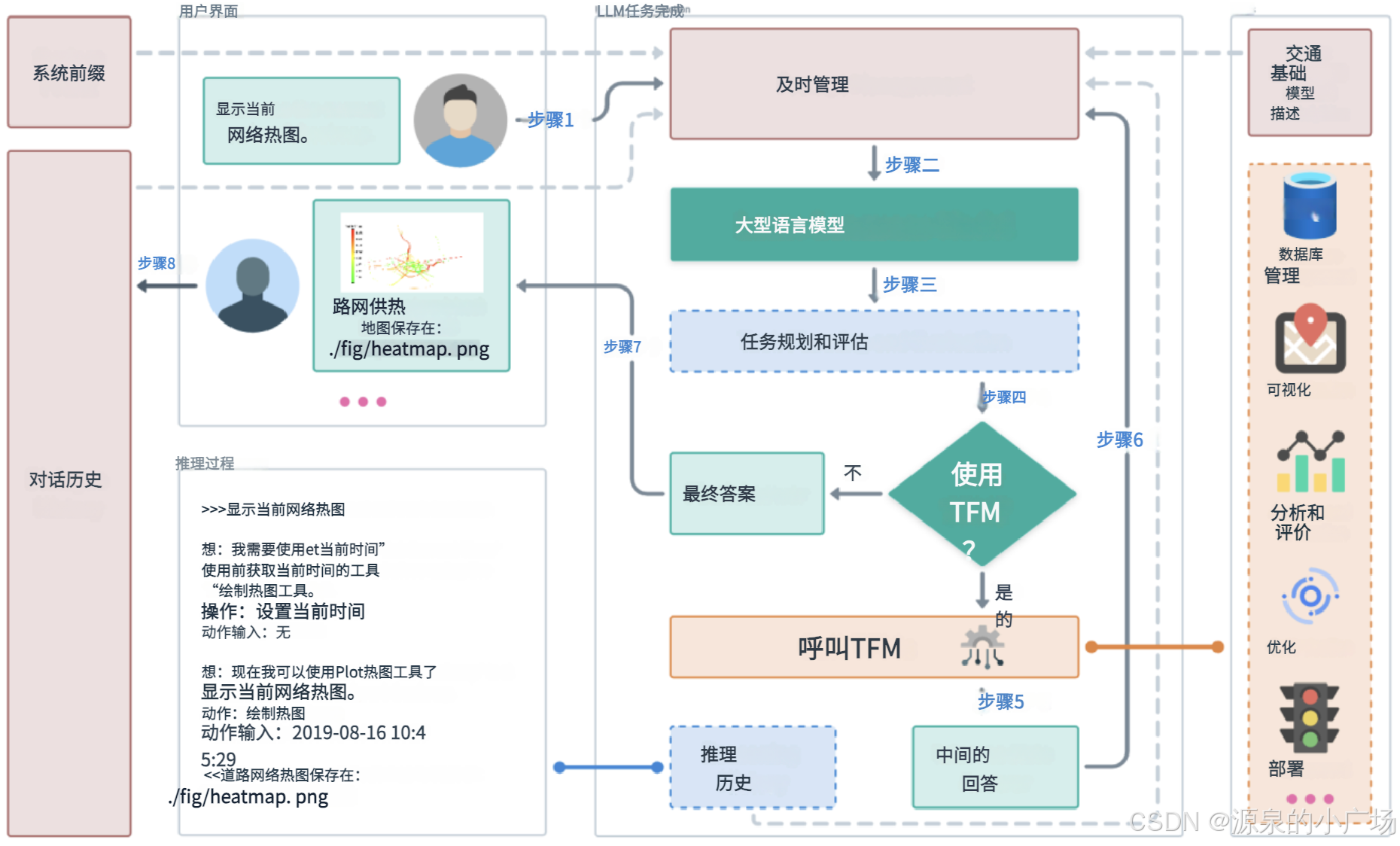

➡️ 研究动机:为了提高VCR任务的性能,研究团队提出了一种多模态大语言模型(MLLM)增强的伪3D感知框架(MEP3P)。该框架通过引入图像深度来表示对象的伪3D位置,并利用深度感知的Transformer来编码对象之间的深度差异,从而更准确地关联对象与视觉场景。此外,研究团队还设计了一个MLLM增强的推理模块,以提供更好的跨模态特征对齐和推理能力。

➡️ 方法简介:MEP3P框架包括伪3D感知VCR框架(P3PV)和MLLM增强推理模块(MER)。P3PV使用两分支Transformer架构(答案-图像分支和答案-问题分支)独立地将答案与图像或问题关联,并结合两个分支的特征进行进一步推理。在视觉表示阶段,基于从RGB图像生成的深度图像计算检测对象的伪3D位置,以增强原始视觉特征。答案-图像分支中设计了深度感知Transformer,通过编码对象之间的深度差异来突出对象关系。为了进一步强调跨模态关系,每个答案词都被标记了一个伪深度,以实现深度感知的词-对象关联。MER模块采用BLIP-2模型处理图像和文本,并将涉及特定视觉对象的指代表达式修改为语言对象标签,作为MLLM的输入。

➡️ 实验设计:在VCR数据集上进行了实验,评估了MEP3P框架在VCR任务中的性能。实验结果表明,MEP3P框架在多个子任务中均优于现有的最先进方法,特别是在结合深度信息和跨模态特征时,模型的推理能力得到了显著提升。

Language Is Not All You Need: Aligning Perception with Language Models

➡️ 论文标题:Language Is Not All You Need: Aligning Perception with Language Models

➡️ 论文作者:Shaohan Huang, Li Dong, Wenhui Wang, Yaru Hao, Saksham Singhal, Shuming Ma, Tengchao Lv, Lei Cui, Owais Khan Mohammed, Barun Patra, Qiang Liu, Kriti Aggarwal, Zewen Chi, Johan Bjorck, Vishrav Chaudhary, Subhojit Som, Xia Song, Furu Wei

➡️ 研究机构: Microsoft

➡️ 问题背景:当前的大型语言模型(LLMs)在自然语言处理任务中表现出色,但它们在处理多模态数据(如图像和音频)时仍面临挑战。多模态感知是实现人工通用智能的关键,能够使模型从文本描述之外获取常识知识,并为机器人技术、文档智能等高价值领域开辟新的应用。

➡️ 研究动机:为了克服LLMs在多模态数据处理上的局限,研究团队开发了KOSMOS-1,一个多模态大型语言模型(MLLM),旨在使模型能够感知多种模态,遵循指令,并在上下文中学习。研究的目标是将感知与LLMs对齐,使模型能够“看见”和“说话”。

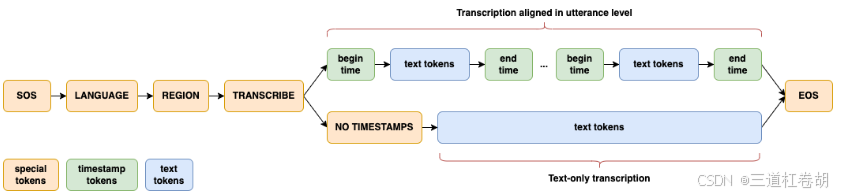

➡️ 方法简介:KOSMOS-1基于Transformer架构,通过嵌入其他模态(如图像)并将其输入语言模型,实现了对多模态数据的处理。模型在大规模的多模态语料库上进行训练,包括文本数据、图像-文本对和交错的多模态数据。此外,通过转移仅语言数据来校准跨模态的指令跟随能力。

➡️ 实验设计:KOSMOS-1在多种任务上进行了评估,包括语言理解、生成、OCR-free文本分类、常识推理、非言语推理(如Raven IQ测试)、图像描述、视觉问答、网页问答、零样本图像分类等。实验设计了零样本和少样本学习设置,以评估模型在不同任务上的表现。实验结果表明,KOSMOS-1在多模态任务上表现出色,特别是在零样本和少样本学习设置中,其性能优于现有的多模态模型。

Equivariant Similarity for Vision-Language Foundation Models

➡️ 论文标题:Equivariant Similarity for Vision-Language Foundation Models

➡️ 论文作者:Tan Wang, Kevin Lin, Linjie Li, Chung-Ching Lin, Zhengyuan Yang, Hanwang Zhang, Zicheng Liu, Lijuan Wang

➡️ 研究机构: Nanyang Technological University, Microsoft

➡️ 问题背景:当前的视觉-语言基础模型(Vision-Language Foundation Models, VLMs)在多种视觉-语言任务中表现出色,但它们在处理细微和复杂的语义组合时仍存在不足。具体来说,现有的图像-文本相似性度量方法主要关注匹配对和不匹配对的分类,而忽略了语义变化的忠实反映,这导致模型在处理细微语义变化时的泛化能力不足。

➡️ 研究动机:为了提高VLMs在处理细微语义变化时的性能,研究团队提出了等变相似性(Equivariant Similarity)的概念,并开发了相应的等变相似性学习(EQSIM)方法。此外,为了评估模型的等变性能,研究团队还构建了一个新的基准测试集EQBEN,该测试集专注于“视觉最小变化”,以更准确地诊断模型的等变性。

➡️ 方法简介:研究团队提出了EQSIM,这是一种新的正则化损失函数,可以在不增加额外监督的情况下,对图像-文本对进行等变性正则化。EQSIM通过确保相似性分数的变化与语义变化一致,来提高模型的等变性能。此外,研究团队还构建了EQBEN,这是一个包含多种视觉最小变化的基准测试集,用于评估VLMs的等变性能。

➡️ 实验设计:研究团队在多个公开数据集上进行了实验,包括Flickr30K、COCO、VALSE和Winoground等。实验结果表明,EQSIM可以显著提高VLMs在处理细微语义变化时的性能,特别是在EQBEN上的表现尤为突出。此外,EQSIM还可以在保持或提高现有模型在其他任务上的性能的同时,提高模型的等变性。

VPGTrans: Transfer Visual Prompt Generator across LLMs

➡️ 论文标题:VPGTrans: Transfer Visual Prompt Generator across LLMs

➡️ 论文作者:Ao Zhang, Hao Fei, Yuan Yao, Wei Ji, Li Li, Zhiyuan Liu, Tat-Seng Chua

➡️ 研究机构: NExT++ Lab, School of Computing, National University of Singapore; Department of Computer Science and Technology, Tsinghua University

➡️ 问题背景:构建新的多模态大语言模型(MLLM)需要大量的图像-文本对进行预训练,这在计算资源上非常昂贵。为了减少这种成本,研究者们开始探索将现有的轻量级视觉提示生成器(VPG)转移到新的MLLM中,而不是从头开始训练。

➡️ 研究动机:尽管直接继承VPG可以加速训练,但这种方法可能会导致性能下降,尤其是在需要细粒度视觉感知的任务上。因此,研究团队旨在开发一种高效的方法,以减少VPG转移的成本,同时保持或提高性能。

➡️ 方法简介:研究团队提出了一种两阶段的VPG转移框架VPGTrans,包括项目机预热(Projector Warm-up)和直接微调(Direct Fine-tuning)。项目机预热阶段通过初始化目标模型的项目机来加速训练,而直接微调阶段则对VPG和项目机进行联合训练。

➡️ 实验设计:实验在多个模型大小和类型之间进行了VPG转移,包括OPT系列(125M, 350M, 1.3B, 2.7B)和FlanT5系列(base, large, XL)。实验评估了不同任务(如COCO Caption, NoCaps, VQAv2, GQA, OKVQA)上的性能,以验证VPGTrans的有效性和效率。