引言

在当今科技快速发展的时代,人工智能(AI)已经成为一个热门话题,几乎渗透到了我们生活的方方面面。从智能手机的语音助手,到自动驾驶汽车,再到医疗诊断中的图像识别,人工智能的应用正在改变我们理解和互动的方式。但当我们深入探讨人工智能时,会发现其中包含了多个层次的技术,其中机器学习和深度学习尤为关键。这两者不仅是人工智能的一部分,还推动了其许多实际应用的实现。

什么是人工智能?它与机器学习和深度学习之间的关系是什么? 这些问题往往让人困惑。虽然它们常被混用,但实际上代表了不同的技术层次。本文将以层层递进的方式,深入解读人工智能、机器学习与深度学习的核心概念和技术关系,帮助读者厘清它们之间的联系,并理解为什么深度学习是推动当前人工智能突破的关键所在。

通过这篇文章,你将了解人工智能的广阔图景,掌握机器学习的基本原理,探索深度学习的复杂算法,并洞察这些技术如何共同塑造我们所处的数字时代。这不仅是对技术的解读,更是对未来无限可能性的展望。

第一层:人工智能(Artificial Intelligence)

1、定义与历史(Definition and History)

定义:人工智能(AI)是指通过计算机系统模拟人类智能的能力。它包括感知、学习、推理、决策、自然语言处理等多种智能行为。简而言之,人工智能旨在让机器能够执行通常需要人类智能的任务。

历史背景:人工智能的概念最早可以追溯到20世纪50年代,英国数学家艾伦·图灵(Alan Turing)提出了著名的图灵测试,试图回答“机器能思考吗?”这一问题。从那时起,人工智能经历了几次重要的发展阶段,包括早期的符号AI(Symbolic AI)、专家系统(Expert Systems)到如今的机器学习和深度学习。

2、应用领域(Applications)

医疗健康(Healthcare):AI在医疗领域的应用日益广泛,尤其在疾病预测、医学影像分析、个性化治疗等方面。例如,AI可以通过分析医学影像数据,快速识别肿瘤或其他异常情况,辅助医生做出诊断。

金融服务(Financial Services):在金融领域,AI用于风险管理、算法交易、欺诈检测等场景。例如,AI可以通过分析大量的市场数据和新闻信息,做出高速交易决策,从而获得投资回报。

智能制造(Smart Manufacturing):AI在制造业中应用于优化生产流程、预测性维护、质量控制等方面。例如,通过AI预测机器设备的故障,企业可以在问题发生之前进行维护,减少停机时间。

自动驾驶(Autonomous Vehicles):AI是自动驾驶技术的核心,通过感知、决策、控制等环节,AI使得车辆能够自主行驶、避障和决策。例如,自动驾驶汽车利用AI算法分析来自摄像头、激光雷达等传感器的数据,实时做出驾驶决策。

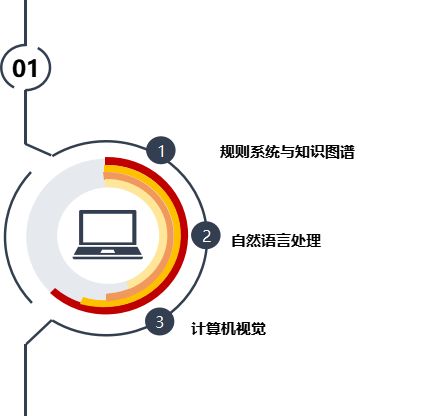

3、关键技术(Key Technologies)

规则系统与知识图谱(Rule-based Systems and Knowledge Graphs):早期的人工智能主要依赖于规则系统,通过预定义的一系列规则和逻辑来模拟决策过程。知识图谱是通过结构化的方式组织和存储知识,并利用这些知识来推理和回答复杂问题。这些技术在专家系统中得到了广泛应用。

自然语言处理(Natural Language Processing, NLP):NLP技术使得计算机能够理解和生成人类语言。它包括语音识别、文本分析、机器翻译等应用。例如,虚拟助手如Siri和Alexa使用NLP来理解用户的语音指令并做出响应。

计算机视觉(Computer Vision):计算机视觉是人工智能的一个分支,旨在使机器具备“看”的能力。它涉及图像识别、目标检测、视频分析等任务。例如,社交媒体平台使用计算机视觉技术自动标记和分类用户上传的照片。

4、人工智能的局限性(Limitations of Artificial Intelligence)

数据依赖性:AI的有效性通常依赖于大量的数据。缺乏足够的数据或数据质量不佳,可能导致AI系统表现不稳定或结果不准确。

可解释性问题:随着AI技术的复杂性增加,特别是在深度学习领域,AI决策过程的可解释性逐渐降低。这使得理解和信任AI的决策变得更加困难,特别是在关键领域如医疗和金融。

伦理与隐私:人工智能的应用带来了许多伦理问题,如隐私侵犯、算法偏见等。如何确保AI系统公平、公正并尊重用户隐私,是当前需要解决的重要问题之一。

这部分为机器学习和深度学习的讨论奠定了基础,展示了人工智能的广泛应用及其基本概念。接下来,文章将进一步探讨机器学习这一人工智能的核心领域。

第二层:机器学习(Machine Learning)

1、定义与基本概念(Definition and Basic Concepts)

定义:机器学习(Machine Learning, ML)是人工智能的一个子领域,旨在通过算法使计算机能够从数据中学习并进行预测和决策,而无需明确编程。简单来说,机器学习是通过数据“训练”计算机,以便它可以在遇到新数据时做出准确的判断。

基本概念:

数据驱动(Data-Driven):机器学习依赖大量的历史数据来构建模型,这些模型可以从数据中找到模式并预测未来的结果。

模型(Model):模型是机器学习的核心,通过训练数据构建,用于执行特定任务,如分类或回归。

训练与测试(Training and Testing):模型通过训练数据集进行学习,并在测试数据集上验证其性能,以确保模型的泛化能力。

2、常见算法(Common Algorithms)

(1)监督学习(Supervised Learning):

在监督学习中,模型通过带标签的数据进行训练。常见的算法包括:

线性回归(Linear Regression):用于预测数值输出(如房价预测)。

决策树(Decision Trees):通过树状结构进行决策,常用于分类任务(如客户是否会购买某产品)。

支持向量机(Support Vector Machines, SVMs):用于分类任务,通过找到最佳分割超平面将不同类别的数据分开。

(2)无监督学习(Unsupervised Learning):

在无监督学习中,模型通过未标注的数据进行训练,主要用于发现数据中的隐藏模式。常见的算法包括:

聚类分析(Clustering):如K均值(K-Means),用于将数据分组(如客户细分)。

主成分分析(Principal Component Analysis, PCA):用于数据降维,帮助识别数据中的主要特征。

(3)强化学习(Reinforcement Learning):

这种方法通过奖励和惩罚来训练模型,使其在某一环境中学习最优策略。例如,AI在游戏中通过不断尝试和学习,最终掌握获胜策略。

3、实际案例(Real-world Examples)

推荐系统(Recommendation Systems):机器学习广泛应用于电子商务和内容平台的推荐系统中。通过分析用户的历史行为数据,模型可以预测用户可能感兴趣的商品或内容,如Netflix的电影推荐或亚马逊的商品推荐。

图像分类(Image Classification):机器学习在图像分类任务中表现出色,如医疗图像分析中的肿瘤识别,或社交媒体中的自动照片标签。

自然语言处理(Natural Language Processing, NLP):在文本分析、情感分析和机器翻译等任务中,机器学习模型被广泛应用。例如,聊天机器人通过学习大量对话数据,能够理解并回应用户的查询。

4、模型评估与优化(Model Evaluation and Optimization)

模型评估(Model Evaluation):在机器学习中,评估模型性能是至关重要的一步。常用的评估指标包括精度(Accuracy)、召回率(Recall)、F1分数等,用于衡量模型的准确性和鲁棒性。

交叉验证(Cross-Validation):通过将数据分为多个子集进行训练和验证,可以更好地评估模型的性能并避免过拟合。

模型优化(Model Optimization):通过调节超参数(Hyperparameters)或使用正则化技术,来提高模型的泛化能力,确保其在新数据上的表现。

5、机器学习的局限性(Limitations of Machine Learning)

数据质量与数量:机器学习模型的性能高度依赖于数据的质量和数量。数据不足或数据偏差可能导致模型表现不佳。

过拟合(Overfitting):模型在训练数据上表现优异,但在测试数据或实际应用中表现不佳,这是因为模型过度拟合了训练数据中的噪声。

可解释性(Interpretability):复杂的机器学习模型(如深度学习)往往难以解释其决策过程,这在关键领域(如医疗)中可能导致信任问题。

机器学习作为人工智能的核心驱动技术,通过从数据中学习,实现了许多我们日常所见的智能应用。下一部分将深入探讨机器学习的一个重要分支——深度学习,它是当前许多复杂任务背后的关键技术。

第三层:深度学习(Deep Learning)

1、定义与特点(Definition and Characteristics)

定义:深度学习(Deep Learning, DL)是机器学习的一个子领域,基于人工神经网络的多层结构。通过模拟人脑的神经元连接,深度学习能够自动提取数据中的特征,并执行复杂的预测或分类任务。与传统机器学习方法不同,深度学习模型能够自动发现数据中的模式,无需人为设计特征。

特点:

多层神经网络(Multi-layer Neural Networks):深度学习模型由多个层级的神经元(层)组成,每一层从上一层获取信息,逐步抽象出更复杂的特征。

大规模数据处理(Handling Large-scale Data):深度学习能够处理和分析大规模数据集,这使其在图像、语音、文本等领域表现优异。

高计算需求(High Computational Requirements):由于深度学习模型的复杂性和对大规模数据的处理需求,训练深度学习模型通常需要强大的计算资源,如GPU或TPU。

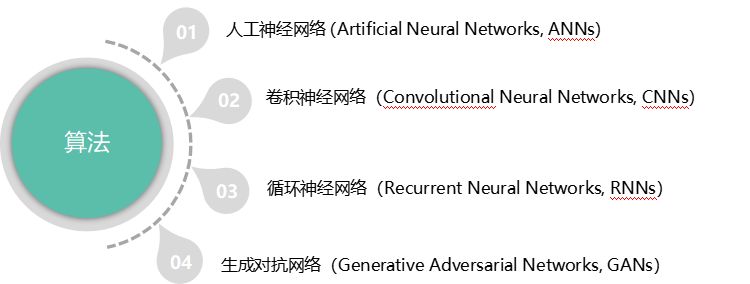

2、核心算法(Core Algorithms)

人工神经网络(Artificial Neural Networks, ANNs):

基本结构:人工神经网络是深度学习的基础,由输入层、隐藏层和输出层组成。每个神经元接收多个输入,通过激活函数处理后,输出给下一层的神经元。

训练过程:通过反向传播算法(Backpropagation),神经网络能够调整权重,以最小化预测误差。

卷积神经网络(Convolutional Neural Networks, CNNs):

图像处理:CNNs特别适合处理图像数据。通过卷积层、池化层的操作,CNNs能够自动提取图像中的局部特征,并逐层构建出图像的高级表示。

应用:广泛用于图像分类、目标检测、人脸识别等任务。例如,CNNs被用于自动标注社交媒体照片,或在医疗图像中检测肿瘤。

循环神经网络(Recurrent Neural Networks, RNNs):

序列数据处理:RNNs擅长处理序列数据,如时间序列、自然语言。通过保持前一时间步的信息,RNNs能够捕捉数据的时间依赖性。

长短期记忆网络(Long Short-Term Memory, LSTM):LSTM是RNN的一种变体,解决了传统RNN中长距离依赖信息难以保留的问题,常用于文本生成、语音识别等任务。

生成对抗网络(Generative Adversarial Networks, GANs):

对抗性训练:GANs由两个神经网络组成:生成器(Generator)和判别器(Discriminator)。生成器试图生成逼真的数据,而判别器试图区分真假数据。通过相互对抗的训练,生成器能够生成高质量的仿真数据。

应用:GANs被用于图像生成、视频合成、风格迁移等领域。例如,GANs可以生成逼真的人脸图像,或将一幅图像的风格转换为另一种艺术风格。

3、前沿应用(Advanced Applications)

自动驾驶(Autonomous Driving):深度学习在自动驾驶领域发挥了关键作用,特别是在物体检测、车道识别、行为预测等任务中。通过结合深度学习模型,自动驾驶系统能够实时分析道路环境,并做出驾驶决策。

语音识别与合成(Speech Recognition and Synthesis):深度学习推动了语音识别技术的巨大进步,使得智能助手如Siri、Alexa能够准确理解和响应用户的语音指令。同时,深度学习还被用于语音合成,生成更加自然的语音。

自然语言处理(Natural Language Processing, NLP):深度学习在机器翻译、文本生成、情感分析等NLP任务中表现卓越。基于深度学习的模型,如Transformer架构,极大提升了机器翻译的准确性,并推动了聊天机器人、文本摘要等应用的发展。

医疗影像分析(Medical Image Analysis):在医疗领域,深度学习被用于分析复杂的医学图像,如CT、MRI扫描,以辅助医生进行诊断。例如,深度学习模型可以识别医学图像中的异常区域,如肿瘤或病变,帮助医生更早地发现疾病。

4、深度学习的局限性(Limitations of Deep Learning)

数据需求与标注成本:深度学习模型通常需要大量的标注数据来进行有效的训练。而高质量、标注完备的数据往往难以获取,尤其在特定领域如医疗影像分析中。

计算资源消耗:训练深度学习模型通常需要大量的计算资源,包括GPU、TPU等硬件支持。这使得深度学习的开发成本较高,并且对硬件的依赖性较大。

可解释性问题:尽管深度学习在许多任务上表现优异,但由于其高度复杂性,模型的决策过程往往难以解释。这种“黑箱”问题在涉及安全、医疗等领域时,可能成为广泛应用的障碍。

模型泛化能力:深度学习模型在训练数据集上可能表现良好,但在实际应用中可能面临泛化问题,尤其是在遇到未见过的数据时。解决这一问题需要更多的研究和改进。

通过深度学习,人工智能实现了许多以前难以想象的技术突破,使得计算机能够胜任越来越多的复杂任务。虽然深度学习面临一些挑战,但它无疑是推动现代人工智能进步的重要力量。

四、技术关系与进化(Relationships and Evolution of Technologies)

1、人工智能、机器学习与深度学习的关系(The Relationship between AI, ML, and DL)

(1)层级关系:

人工智能(AI):是一个广义的概念,指任何通过计算机模拟人类智能行为的技术。AI包括了各种各样的方法和技术,从简单的规则系统到复杂的算法和模型。

机器学习(ML):作为人工智能的一个子集,机器学习通过数据驱动的方式,使计算机能够自动学习和改进。在AI框架下,ML提供了一个更具体的路径来实现智能行为,尤其在数据分析、预测和自动化任务中。

深度学习(DL):是机器学习的一个子集,专注于使用多层神经网络来处理和学习复杂的数据模式。深度学习是当前AI发展的前沿,通过自动特征提取和大规模数据处理,推动了许多AI应用的实现。

(2)相互依赖:

AI作为框架:AI是一个广泛的研究领域,其中机器学习和深度学习提供了实现智能行为的有效途径。

ML作为核心驱动力:机器学习是当前许多AI系统的核心驱动力,尤其在那些需要从数据中学习的任务中。ML算法通过数据训练模型,为AI提供了预测和决策能力。

DL作为先进工具:深度学习在许多复杂任务中,尤其是在图像识别、自然语言处理等领域,展现了超越传统机器学习方法的能力。它为AI提供了更强大的工具来处理大规模和复杂的数据。

2、技术进化的里程碑(Milestones in the Evolution of Technologies)

符号AI与专家系统(Symbolic AI and Expert Systems):人工智能最早期的发展集中在符号AI和专家系统上。这些方法依赖于预定义的规则和逻辑推理,尽管在特定领域表现出色,但缺乏灵活性和泛化能力。

统计学习的崛起(Rise of Statistical Learning):随着计算能力的提升和数据的增长,统计学习方法开始流行,标志着机器学习的兴起。这一阶段的技术如支持向量机(SVM)、决策树等,为AI带来了数据驱动的学习能力。

神经网络的复兴(Resurgence of Neural Networks):20世纪80年代,神经网络的基础算法,如反向传播(Backpropagation)得到了重视,但由于计算限制,其应用范围有限。随着21世纪初计算能力的飞跃,神经网络特别是深度学习的复兴,标志着AI技术的重大进展。

深度学习的突破(Breakthroughs in Deep Learning):2010年代,深度学习通过处理大规模数据集和利用高性能计算硬件,实现了许多领域的技术突破,如图像识别、语音识别和自然语言处理。这一阶段,深度学习超越了传统机器学习方法,成为AI发展的新引擎。

3、未来展望(Future Outlook)

AI与ML的融合发展(Integration of AI and ML):随着技术的不断进步,AI和ML之间的界限将变得更加模糊。未来,我们可能会看到更多融合了符号推理和数据驱动学习的系统,以更好地解决复杂问题。

深度学习的持续演进(Continuous Evolution of Deep Learning):深度学习将在处理更复杂的任务上继续演进,特别是在多模态数据处理、自监督学习、增强学习等方面。研究者们正在努力解决深度学习的可解释性和数据需求问题,以推动其在更多领域的应用。

量子计算与AI的结合(Quantum Computing and AI Integration):量子计算的潜力有望在未来提升AI系统的计算能力,尤其是在处理极其复杂和大规模的数据时。量子计算可能会带来新的算法和模型,进一步推动AI技术的前沿发展。

总结:人工智能、机器学习与深度学习构成了一个逐层递进、相互依赖的技术体系。随着技术的不断进化,三者之间的关系将更加紧密,为解决更为复杂的现实问题提供新的工具和方法。未来,随着新技术的融合与发展,AI领域将继续拓展其影响力,为社会和产业带来更多变革和机遇。

五、挑战与机遇(Challenges and Opportunities)

1、技术挑战(Technical Challenges)

数据质量与获取(Data Quality and Accessibility):

挑战:尽管深度学习和机器学习依赖大规模数据进行训练,但高质量、标注精确的数据并不总是容易获得。在一些领域,如医疗或自动驾驶,获取充足且准确的数据尤其困难。此外,数据隐私和安全问题进一步增加了数据获取的难度。

机遇:随着数据生成速度的加快和数据共享平台的发展,未来可能会出现更多标准化的数据集。同时,自动标注技术和合成数据生成(如GANs)有望减少对人工标注的依赖,提升数据获取的效率和质量。

计算资源需求(Computational Resource Requirements):

挑战:深度学习模型的训练通常需要大量的计算资源,尤其是对于大规模神经网络和复杂任务。这导致了较高的硬件和能源成本,并且限制了小型企业和研究机构的参与。此外,随着模型复杂度的增加,训练时间也随之增加,导致迭代速度放缓。

机遇:未来,量子计算、分布式计算和更高效的硬件(如专用AI芯片)有望大幅降低计算资源的需求。同时,模型压缩技术(如模型剪枝、蒸馏)和优化算法的进步,也将提高模型的计算效率,使得深度学习能够更广泛地应用。

模型的可解释性(Model Interpretability):

挑战:深度学习模型,尤其是那些具有高度复杂性和大量参数的模型,往往难以解释其决策过程。这种“黑箱”性质在涉及安全性、法律和伦理的应用中是一个显著的障碍,例如在医疗诊断和自动驾驶中,决策过程的透明度和可解释性至关重要。

机遇:研究者正在开发更透明、更可解释的模型,如基于注意力机制的模型或通过可视化技术揭示模型内部工作原理的工具。增强模型的可解释性将有助于提高AI应用的信任度,并扩大其在敏感领域的应用。

伦理与公平性(Ethics and Fairness):

挑战:AI系统可能会无意中放大或复制现有的社会偏见,这可能导致在决策过程中对特定群体的不公平对待。此外,AI的普及也引发了对隐私侵犯、工作替代等社会问题的担忧。

机遇:通过建立更严格的伦理标准和合规框架,AI开发者可以确保模型的公平性和透明性。伦理AI和负责任的AI开发将成为未来的重要趋势,推动AI技术在社会中得到更广泛的接受和应用。

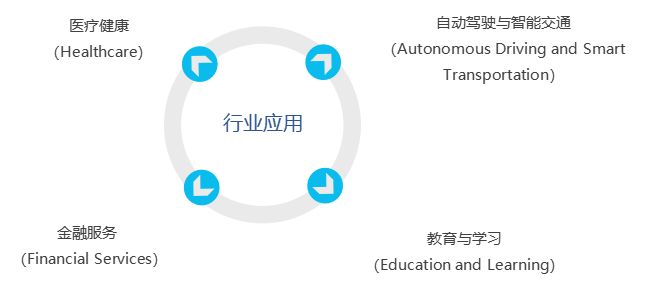

2、行业与应用机遇(Industry and Application Opportunities)

医疗健康(Healthcare):

挑战:在医疗领域,AI面临着数据隐私、法律合规和高标准的精确性要求。此外,医生和患者对AI决策的信任也是一个需要解决的问题。

机遇:AI有望通过个性化医疗、早期诊断、药物开发等方面大幅提升医疗效果和效率。例如,AI可以分析患者的基因组数据,提供个性化的治疗方案,或者通过影像分析及早发现疾病。

自动驾驶与智能交通(Autonomous Driving and Smart Transportation):

挑战:自动驾驶面临着复杂的环境感知、实时决策以及安全性和法律问题。尤其在恶劣天气、交通异常等极端条件下,自动驾驶系统的稳定性仍需大幅提升。

机遇:随着深度学习和传感技术的进步,自动驾驶将逐步成熟,并可能彻底改变运输行业。智能交通系统结合AI和物联网技术,可以优化交通流量、减少拥堵,并提高整体交通安全性。

金融服务(Financial Services):

挑战:金融领域对安全性和准确性要求极高,AI系统可能受到数据欺诈或其他恶意攻击的威胁。此外,如何确保AI在金融决策中没有偏见,也是一个重要的挑战。

机遇:AI在风险管理、算法交易、个性化金融产品推荐等方面展示了巨大潜力。通过AI对市场数据的实时分析,金融机构可以更快速、更精准地做出决策,降低风险并提高收益。

教育与学习(Education and Learning):

挑战:AI在教育中的应用面临着数据隐私、学习效果个性化的难题,以及如何有效地与传统教育方法结合。

机遇:AI可以通过个性化学习路径、智能辅导系统、学习分析等方式,帮助学生更高效地学习。此外,AI可以为教师提供更深刻的洞察,使他们能够更好地满足每个学生的需求。

3、社会与经济机遇(Societal and Economic Opportunities)

就业与经济增长(Employment and Economic Growth):

挑战:AI技术的广泛应用可能导致某些职业的自动化,从而引发失业问题。此外,技术的快速变化也可能使劳动力市场难以跟上技能需求的变化。

机遇:AI同时也创造了新的工作岗位,尤其是在AI开发、数据科学和智能系统维护等领域。经济增长也可能因AI提高了生产效率和创新能力而获得新的动力。政府和企业可以通过培训项目,帮助劳动力适应这些变化,从而实现包容性增长。

全球竞争力(Global Competitiveness):

挑战:随着各国加大对AI的投入,全球竞争将日益激烈。那些无法迅速适应AI技术变化的国家和企业,可能在全球市场上失去竞争优势。

机遇:国家层面的AI战略和企业的创新投入,将决定未来全球竞争的格局。通过投资AI研发和基础设施建设,国家和企业可以在全球市场中占据有利地位,并推动科技前沿的发展。

可持续发展(Sustainable Development):

挑战:AI的能耗问题和潜在的环境影响,可能成为可持续发展目标中的一大挑战。如何在不牺牲环境的情况下推进AI发展,是未来需要解决的问题。

机遇:AI可以通过优化资源使用、改善能源效率、推动环境监测等方式,助力可持续发展。例如,AI可以通过分析大数据,优化能源分配,减少碳足迹,并提高整体生态系统的可持续性。

总结:尽管人工智能、机器学习和深度学习面临许多技术和社会挑战,但它们也带来了前所未有的机遇。通过应对这些挑战,充分利用技术优势,AI将能够在未来塑造一个更智能、更高效的世界。

结论

人工智能、机器学习与深度学习作为当今科技发展的核心力量,已经在多个领域取得了显著的进展。从广义的人工智能到更加具体的机器学习,再到深度学习的细致应用,这些技术层层递进,相互补充,共同推动了人类在数据处理、自动化和智能决策方面的能力。

尽管技术在不断进步,但我们也必须正视其中的挑战,包括数据质量、计算资源需求、模型可解释性,以及伦理和公平性问题。然而,这些挑战不仅是技术发展的障碍,也为创新提供了广阔的空间。未来,随着计算能力的提升、算法的优化,以及社会对技术的接受程度增加,人工智能有望在医疗、自动驾驶、金融服务、教育等多个领域带来革命性的变化。

在全球竞争日益激烈的背景下,抓住人工智能带来的机遇将是各国和企业在未来保持竞争力的关键。同时,AI技术的发展也必须与可持续发展目标相结合,通过智慧的技术应用,助力全球应对环境、经济和社会问题。

总之,人工智能、机器学习与深度学习代表了未来科技进步的方向。通过克服挑战、把握机遇,我们将能够充分利用这些技术,开创一个更加智能、创新和可持续的未来。