前 言

YOLO算法改进系列出到这,很多朋友问改进如何选择是最佳的,下面我就根据个人多年的写作发文章以及指导发文章的经验来看,按照优先顺序进行排序讲解YOLO算法改进方法的顺序选择。具体有需求的同学可以私信我沟通:首推,是将两种最新推出算法的模块进行融合形成最为一种新型自己提出的模块然后引入到YOLO算法中,可以起个新的名字,这种改进是最好发高水平期刊论文。后续改进将主要教大家这种方法,有需要的朋友可私信我了解。

第一,创新主干特征提取网络,将整个Backbone改进为其他的网络,比如这篇文章中的整个方法,直接将Backbone替换掉,理由是这种改进如果有效果,那么改进点就很值得写,不算是堆积木那种,也可以说是一种新的算法,所以做实验的话建议朋友们优先尝试这种改法。

第二,创新特征融合网络,这个同理第一,比如将原yolo算法PANet结构改进为Bifpn等。

第三,改进主干特征提取网络,就是类似加个注意力机制等。根据个人实验情况来说,这种改进有时候很难有较大的检测效果的提升,乱加反而降低了特征提取能力导致mAP下降,需要有技巧的添加。

第四,改进特征融合网络,理由、方法等同上。

第五,改进检测头,更换检测头这种也算个大的改进点。

第六,改进损失函数,nms、框等,要是有提升检测效果的话,算是一个小的改进点,也可以凑字数。

第七,对图像输入做改进,改进数据增强方法等。

第八,剪枝以及蒸馏等,这种用于特定的任务,比如轻量化检测等,但是这种会带来精度的下降。

...........未完待续

一、创新改进思路或解决的问题

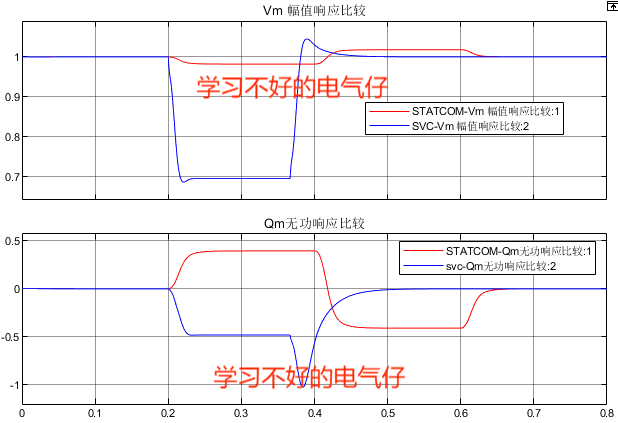

提出了一个新的现代卷积网络系列,称为 MogaNet,用于 dis-在纯基于 ConvNet 的模型中使用 fa-可行的复杂性-性能权衡。MogaNet 在概念上封装将简单而有效的卷积和门控聚合集成到一个紧凑的模块中,其中,区分性特征被有效地收集并置于情境中 adap-tively.MogaNet 具有出色的可扩展性、令人印象深刻的参数效率、与最先进的 ViT 和 ConvNet 相比,性能具有竞争力ImageNet 及各种下游视觉本。

二、基本原理

摘要:通过尽可能全局地将内核置于上下文中,现代卷积网络已经表明在计算机视觉任务中具有巨大潜力。然而,近年来在多阶深度神经网络 (DNN) 中的博弈论交互揭示了现代卷积神经网络的感知瓶颈,其中富有表现力的交互具有没有随着内核大小的增加而进行有效编码。为了应对这一挑战——lenge,我们提出了一个新的现代卷积网络系列,称为 MogaNet,用于 dis-在纯基于 ConvNet 的模型中使用 fa-可行的复杂性-性能权衡。MogaNet 在概念上封装将简单而有效的卷积和门控聚合集成到一个紧凑的模块中,其中,区分性特征被有效地收集并置于情境中 adap-tively.MogaNet 具有出色的可扩展性、令人印象深刻的参数效率、与最先进的 ViT 和 ConvNet 相比,性能具有竞争力ImageNet 及各种下游视觉本。

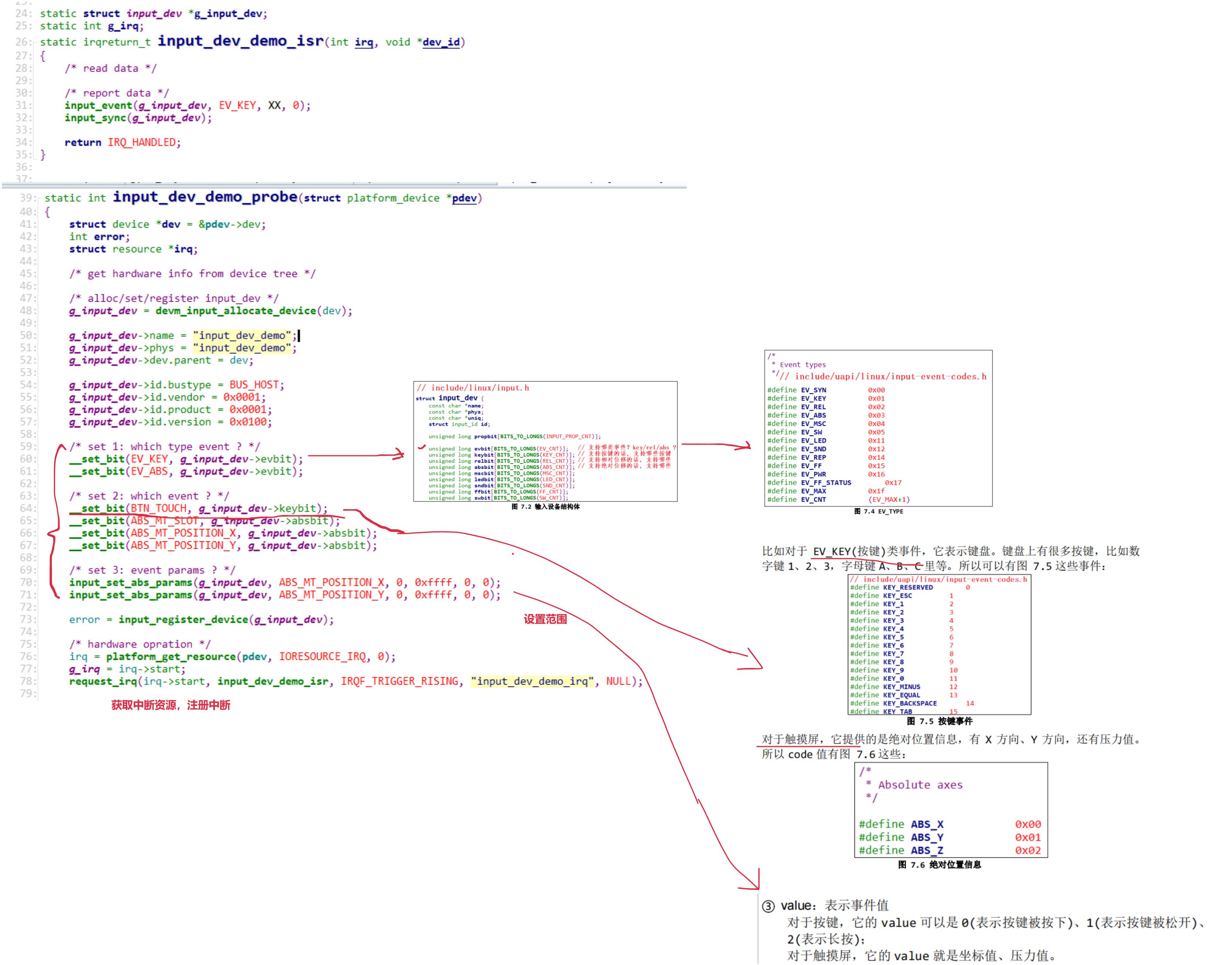

三、添加方法

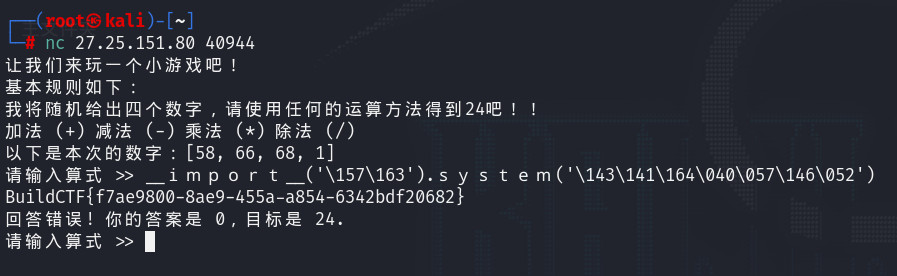

部分代码如下所示,具体可关注后私信我获取。yolov8n为baseline。

四、总结

预告一下:下一篇内容将继续分享深度学习算法相关改进方法。有兴趣的朋友可以关注一下我,有问题可以留言或者私聊我哦

PS:该方法不仅仅是适用改进YOLOv8,也可以改进其他的YOLO网络以及目标检测网络,比如YOLOv7、v6、v4、v3,Faster rcnn ,ssd等。

最后,有需要的请关注私信我吧。关注免费领取深度学习算法学习资料!