文章目录

- 前言

- 一、欧盟《人工智能法案》的重点监管要求

-

- (一)基于风险的监管路径

-

- 1.具有不可接受风险的人工智能系统

- 2.高风险人工智能系统

- 3.有限风险与低风险人工智能系统

- (二)对高风险人工智能的监管要求

-

- 1.针对高风险人工智能系统的要求

- 2.针对高风险人工智能系统产业链参与者的要求

- (三)针对特定人工智能系统以及通用目的人工智能系统的监管要求

前言

欧盟《人工智能法案》的核心监管思路是根据人工智能系统的风险等级采取不同的监管要求。针对高风险人工智能系统、特定人工智能系统以及通用目的人工智能系统,该法案均规定了相应的合规义务。

一、欧盟《人工智能法案》的重点监管要求

(一)基于风险的监管路径

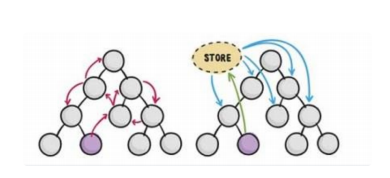

欧盟《人工智能法案》采用基于风险的规制框架,对不同风险程度的人工智能系统提出了不同的要求和义务。在此框架下,人工智能系统对健康、安全或基本权利所造成的风险越大,规则越严格。该法案将人工智能系统分为以下四个风险类型,包括不可接受风险、高风险、有限风险和低风险。

1.具有不可接受风险的人工智能系统

某些人工智能系统的使用可能会带来不可接受的风险,因此这类使用应被禁止。该法案第五条明确规定了以下五类被禁止的人工智能用途。

认知行为操纵。采用超出人类意识的潜意识技术或有目的的操纵或欺骗技术,通过明显损害其做出明智决定的能力达到严重扭曲个人或群体行为的目的或效果,从而导致或可能导致其本人、他人或群体受到重大伤害。

利用特定弱点。利用个人或特定群体因年龄、残疾或特定社会或经济状况而存在的任何脆弱性,达到实质性扭曲其本人或属于该群体的个人行为的目的或效果,从而导致或可能导致其本人或他人受到重大伤害。

社会评分。根据自然人或其群体的社会行为,或已知、推断或预测的个人或人格特征,在一定时期对自然人或其群体进行评估或分类,并进行可能造成以下后果的社会评分:在与数据最初生成或收集的背景无关的社会背景下,使某些自然人或其整个群体受到有害或不利待遇;使某些自然人或其群体受到不公正或与其社会行为或其严重性不相称的有害或不利待遇。

生物识别归类。使用基于生物识别数据对自然人进行分类的生物识别分类系统推断自然人的种族、政治观点、宗教信仰和性取向等敏感信息。

远程生物识别。为执法目的在公共区域使用实时远程生物识别系统,除非该等使用对下述任何目的而言严格必要:有针对性地寻找绑架、贩运人口和性剥削的具体受害者以及寻找失踪人员;防止对自然人的生命或人身安全造成具体的、实质性的和迫在眉睫的威胁,或者防止当前存在的或可预见的真正的恐怖袭击威胁;定位或识别刑事犯罪嫌疑人。