爬虫技术作为数据抓取的重要手段,其效率和性能直接影响到数据获取的质量与速度。Haskell,作为一种纯函数式编程语言,以其强大的类型系统和并发处理能力,在构建高效爬虫方面展现出独特的优势。本文将探讨在Haskell中如何通过连接管理和HTTP请求优化来提升爬虫的性能。

连接管理的重要性

在HTTP请求中,连接管理是一个关键因素。有效的连接管理可以减少建立和关闭连接的开销,提高请求的响应速度。在Haskell中,Network.HTTP.Client库提供了Manager,它负责持久化HTTP连接,使得多个请求可以复用同一个连接,从而提高性能。

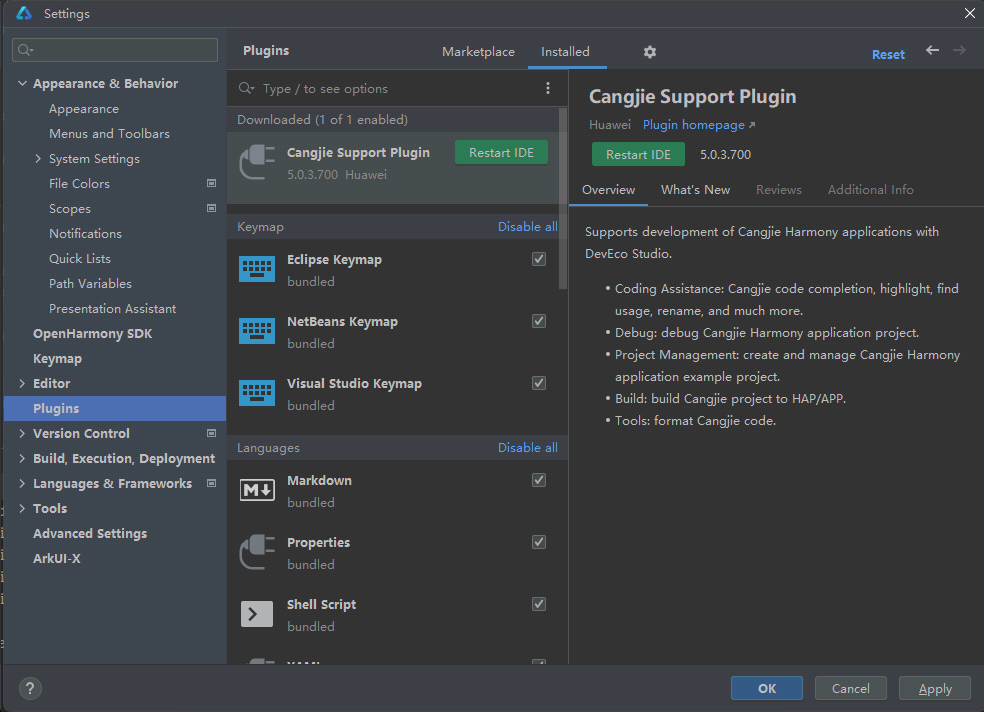

创建Manager

首先,我们需要创建一个Manager,它将用于后续的所有HTTP请求。

haskell

import Network.HTTP.Client

import Network.HTTP.Client.TLS

main :: IO ()

main = do

manager <- newManager tlsManagerSettings

-- 使用manager进行HTTP请求

HTTP请求性能优化

1. 并发请求

在处理大量请求时,单线程顺序执行显然效率不高。Haskell的并发模型可以让我们同时发起多个请求,显著提高爬虫的效率。

haskell

import Control.Concurrent.Async

fetchURLs :: Manager -> [String] -> IO ()

fetchURLs manager urls = mapConcurrently (fetchURL manager) urls

fetchURL :: Manager -> String -> IO ()

fetchURL manager url = do

response <- httpLbs url manager

print $ statusCode (responseStatus response)

2. 流式响应处理

对于大型响应,如下载大文件或处理大量数据,采用流式处理可以减少内存消耗,提高处理速度。

haskell

import Data.Conduit

import Data.Conduit.Binary

import System.IO

downloadFile :: Manager -> String -> IO ()

downloadFile manager url = do

request <- parseRequest url

withManager manager $ \manager ->

httpSource request manager $$+- sinkFile "output.txt"

3. 错误处理

在网络请求中,错误处理是必不可少的。合理的错误处理机制可以确保爬虫在遇到问题时不会崩溃,而是可以优雅地处理错误。

haskell

fetchURLWithRetry :: Manager -> String -> Int -> IO ()

fetchURLWithRetry manager url retries = do

response <- httpLbs url manager

case response of

Left err -> do

putStrLn $ "请求失败: " ++ show err

if retries > 0

then fetchURLWithRetry manager url (retries - 1)

else putStrLn "请求失败,重试次数用尽。"

Right _ -> print "请求成功"

4. 连接超时

设置合理的超时时间可以避免爬虫在等待响应时无限期地挂起。

haskell

import Network.HTTP.Client

fetchWithTimeout :: Manager -> String -> IO ()

fetchWithTimeout manager url = do

let settings = tlsManagerSettings { managerResponseTimeout = responseTimeoutMicro 5000000 }

response <- httpLbs url (settings manager)

print $ statusCode (responseStatus response)

实际应用

在实际应用中,我们可以将上述技术结合起来,构建一个高效的Haskell爬虫。

import Network.HTTP.Client

import Network.HTTP.Client.TLS

import Network.HTTP.Client.Conduit

import Network.Proxy

import Control.Concurrent.Async

import Data.Conduit

import Data.Conduit.Binary

import System.IO

main :: IO ()

main = do

-- 创建代理设置

let proxy = Proxy {

proxyHost = "www.16yun.cn"

, proxyPort = Port 5445

, proxyType = ProxyHttp

, proxyUser = "16QMSOML"

, proxyPass = "280651"

}

-- 使用代理设置创建管理器

manager <- newManager tlsManagerSettings { managerProxy = Just proxy }

let urls = ["http://example.com/data1", "http://example.com/data2"]

fetchURLs manager urls

fetchURLs :: Manager -> [String] -> IO ()

fetchURLs manager urls = mapConcurrently (fetchURL manager) urls

fetchURL :: Manager -> String -> IO ()

fetchURL manager url = do

request <- parseRequest url

response <- httpLbs request manager

case response of

Left err -> putStrLn $ "请求失败: " ++ show err

Right res -> do

print $ statusCode (responseStatus res)

responseBody res $$+- sinkHandle stdout

结论

通过有效的连接管理和HTTP请求优化,Haskell爬虫可以在保证数据准确性的同时,大幅提升数据获取的效率。本文介绍的技术和示例代码为构建高效、稳定的Haskell爬虫提供了实用的参考。随着技术的发展,我们还可以探索更多优化策略,以适应不断变化的网络环境和数据需求。

![[DICOM活久见] 序列内部的RescaleIntercept不同导致的问题](https://i-blog.csdnimg.cn/direct/35fbf225d4a24615a1c7e57a41c7d6b9.png)