DataWhale AI夏令营-《李宏毅深度学习教程》笔记

- 第四章 卷积神经网络

- 卷积神经网络构成

- 一个通俗的例子

第四章 卷积神经网络

这部分看书的时候感觉云里雾里的,好在之前学过一些卷积神经网络、全链接、感受野的概念,我就用自己的理解阐述一篇笔记吧,当复习了。

卷积神经网络构成

传统的卷积神经网络由三部分构成:

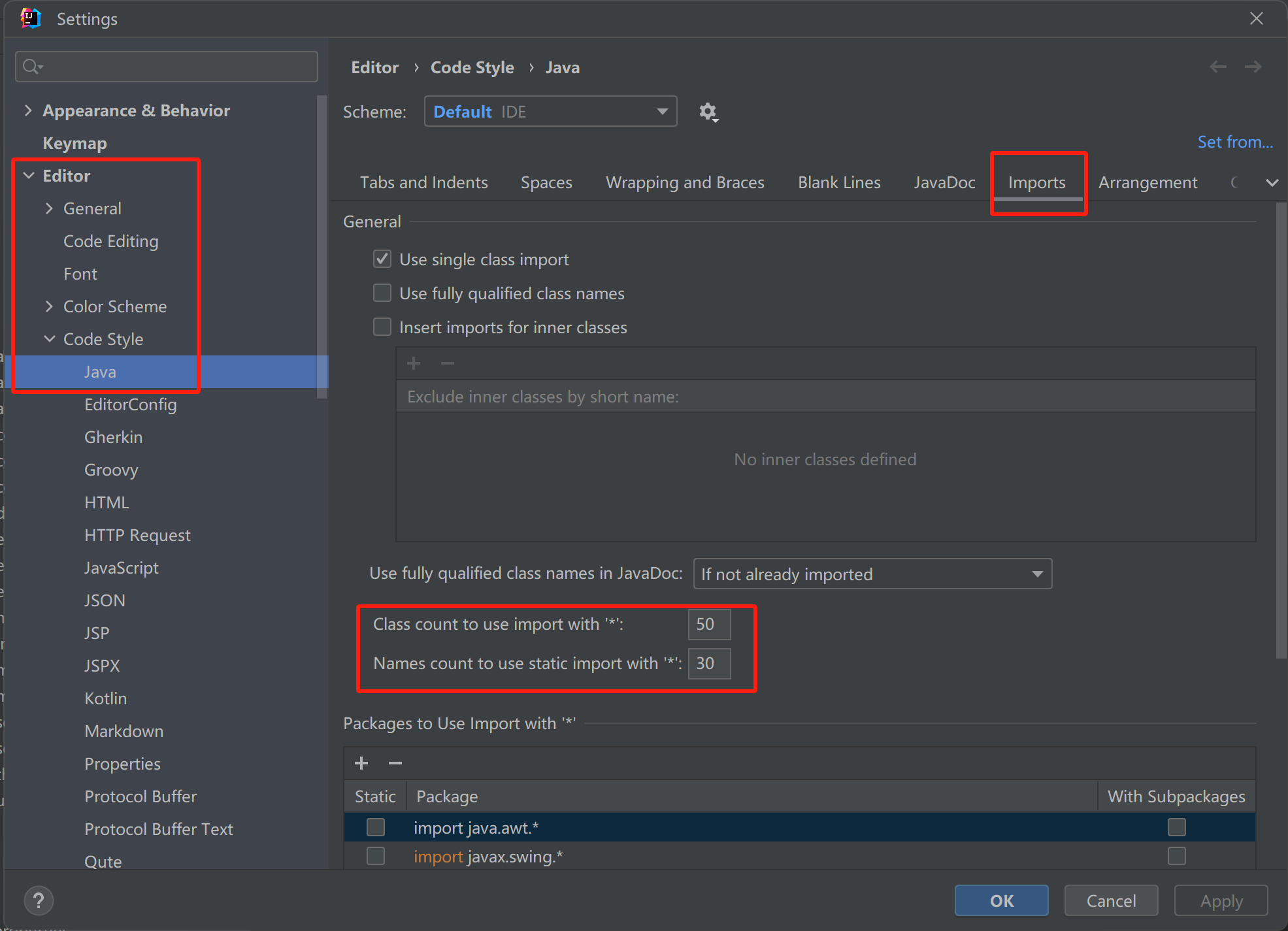

卷积层:想象你拿一个小窗口在图片上滑动,每次看到的只是局部区域。这个窗口就是卷积核,它负责提取图片的局部特征。例如,当这个窗口在图片中滑动时,它可能会捕捉到图像的边缘或颜色变化。

就像下图一样,有一个3×3的框,在原始6×6的图像上滑动,来捕捉一些信息

池化层:这个层类似于你在大图上压缩信息,把一些相邻区域的特征点取个平均或最大值,这个过程叫做池化(Pooling)。池化层帮助减少数据的维度,同时保留重要信息,类似于我们拍摄缩略图,虽然图像变小了,但主要内容还是保留了。

传统的池化有两这类型应用广泛,即最大池化和平均池化。

最大池化可以看作一个2×2的区域最后只保留这四个值中最大的一个。

平均池化就是2×2的区域的平均值作为结构保存。

全连接层:在经过多个卷积层和池化层后,网络最终会把提取的特征展平,然后连接到全连接层。这一层就像传统的神经网络,负责最后的分类或回归任务。

全连接层就是 y=wx+b 的操作

其中:

w 是权重矩阵,表示每个输入节点对输出节点的影响。

x 是输入向量,即来自上一层的输出。

b 是偏置向量,帮助模型更好地拟合数据。

y 是输出向量,即这一层的输出,通常会作为下一层的输入。

一个通俗的例子

假设你有一只机器人,它要学会识别照片中的猫和狗。最初,机器人什么都不懂,它只是看到一堆像素点。

卷积层:机器人先学习“看”图像的小部分,比如耳朵、眼睛的形状、胡须的样子等等。就像你第一次看一张模糊的照片,可能只会注意到某个区域的轮廓。

池化层:然后,机器人会把这些特征简化,找到最具代表性的部分,好比你在一个小尺寸的缩略图中还认得出这些部分。

全连接层:最后,机器人会综合所有这些信息,得出结论:“嗯,这只动物有尖尖的耳朵、圆圆的眼睛、长长的胡须,应该是一只猫!”

好了就这样吧。感觉有点水笔记的感觉,但是卷积神经网络通俗的说其实就这些内容,但是要是细讲公式太多了CSDN用的还不是很熟练。