一、模型介绍

1. 项目背景与概述

mPLUG-Owl3 是阿里巴巴 mPLUG 团队最新发布的通用多模态大模型,该模型在理解和处理复杂多图及长视频内容方面实现了显著突破。这一创新成果不仅提升了模型的推理效率,还保持了高度的准确性,为多模态大模型的应用开辟了新的可能性。

2.核心能力与特点

高效推理能力 :

- mPLUG-Owl3 在推理效率上实现了显著提升,将 First Token Latency 缩小了 6 倍,使得模型在处理大量图像和视频时更加迅速。

- 在单张 A100 显卡上,mPLUG-Owl3 能够处理的图像数量提升至 400 张,这意味着它能在极短的时间内完成大量图像的分析和理解。

- 特别是对于长视频,mPLUG-Owl3 能在 4 秒内“看”完一部 2 小时的电影,并快速回答用户关于视频内容的问题。

多模态融合能力 :

- mPLUG-Owl3 创新性地引入了 Hyper Attention 模块,该模块允许模型在不增加语言模型序列负担的情况下,直接与视觉特征交互,减少了计算成本和内存占用。

- 通过 Cross-Attention 操作,模型能够精准提取并利用视觉信息,同时保持了对文本的高效处理能力,实现了视觉和语言信息的深度融合。

鲁棒性与准确性 :

- mPLUG-Owl3 在多模态场景的多个基准测试中均达到了最佳水平(SOTA),展现了其卓越的性能和稳定性。

- 在处理长视觉序列时,即使面对大量无关图像的干扰,mPLUG-Owl3 依然能保持较高准确率,体现了其在复杂场景下的鲁棒性。

3. 应用场景与示例

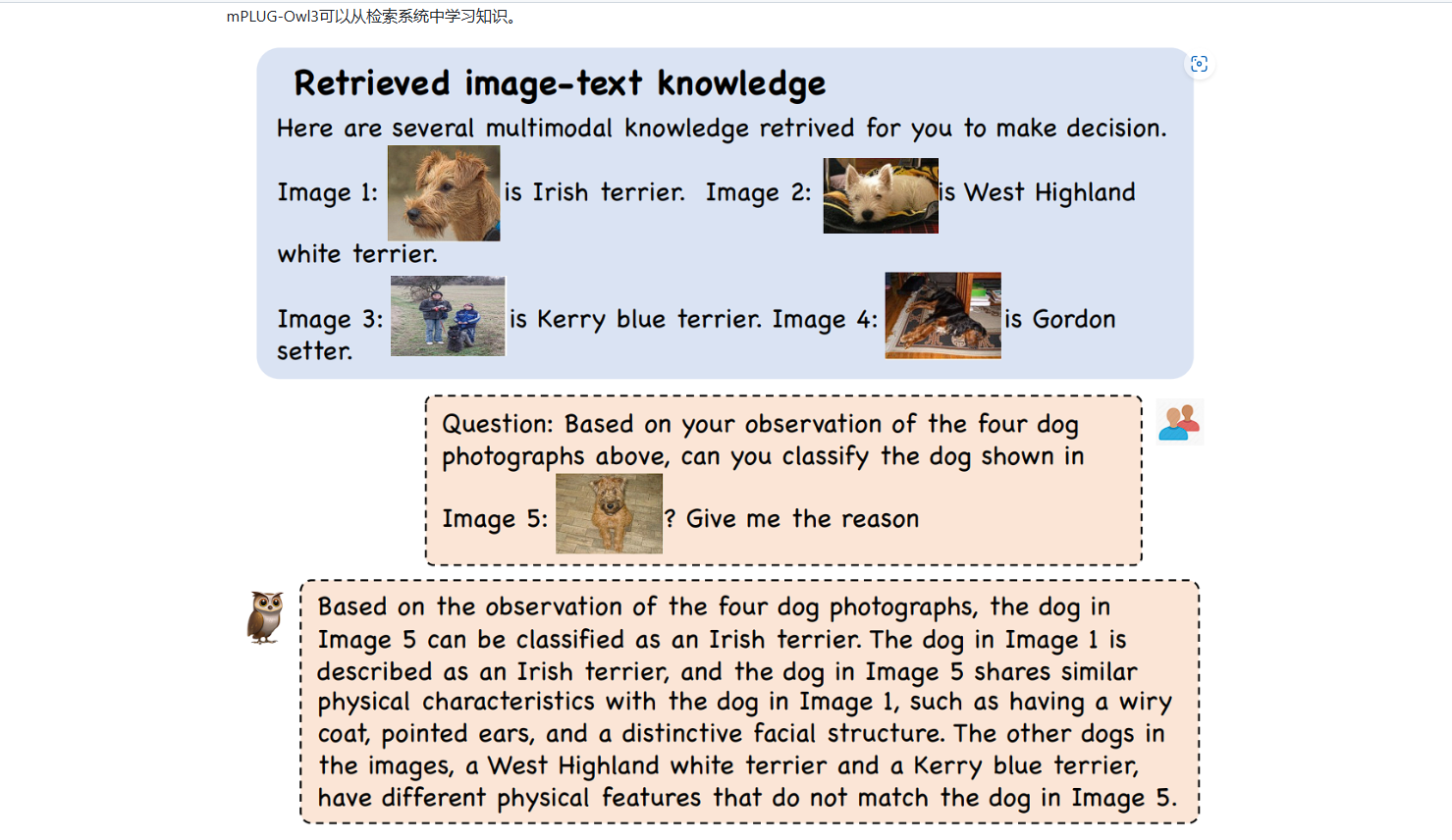

多模态检索增强 :

- 在多模态检索任务中,mPLUG-Owl3 不仅能够准确回应查询,还能明确指出其决策依据,提高了检索的透明度和可信度。

多图推理 :

- mPLUG-Owl3 能够理解不同图像间的关联,进行逻辑推理。例如,在识别不同风格或角色的图像时,它能准确判断并给出依据。

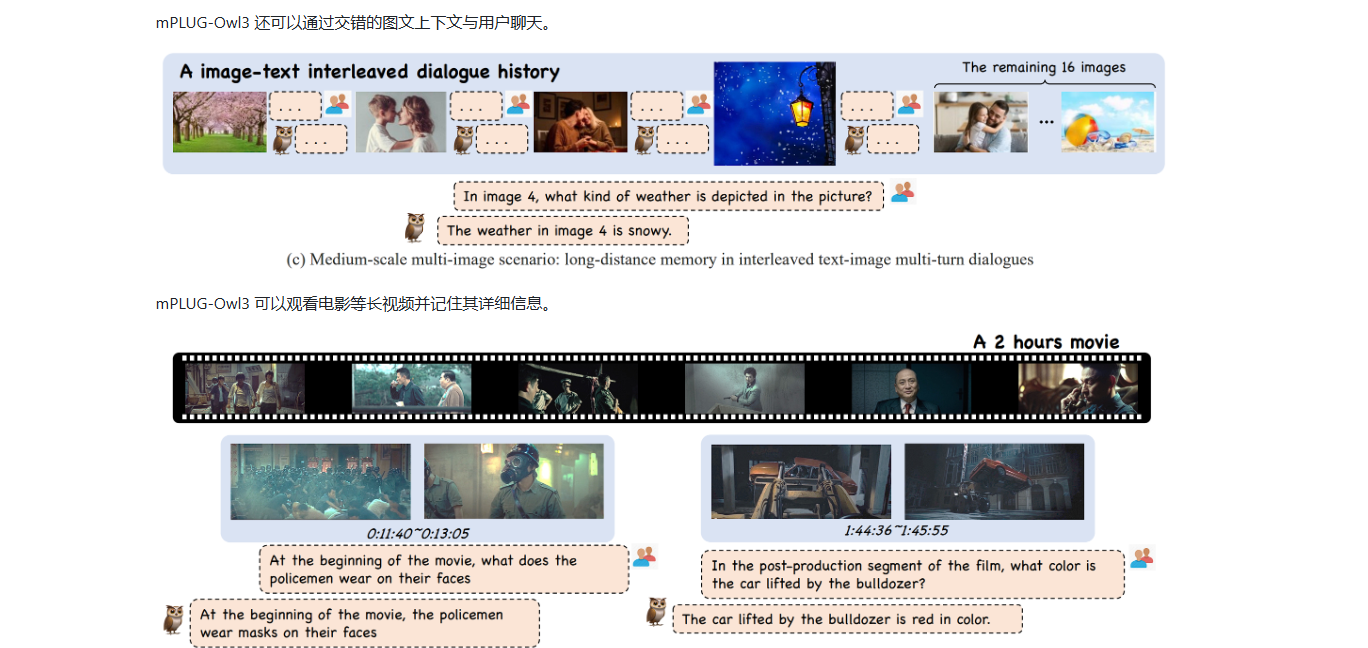

长视频理解 :

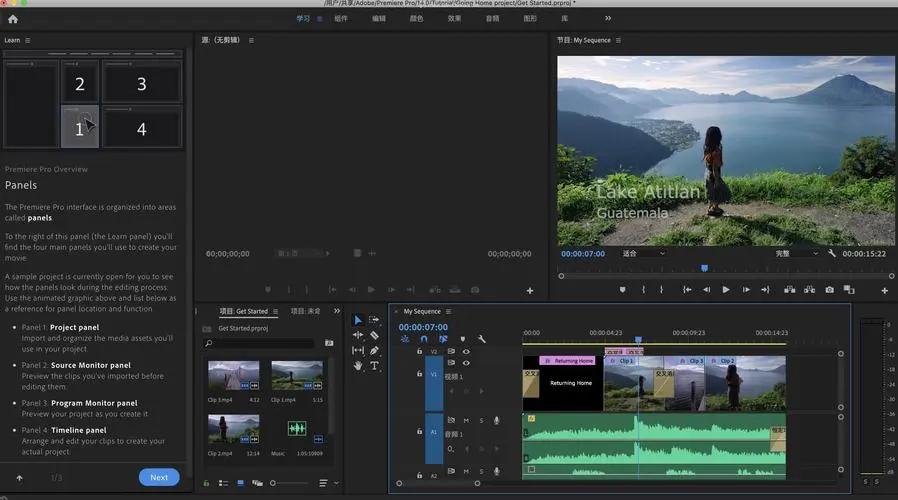

- 对于长视频内容,mPLUG-Owl3 能在短时间内解析并回答关于视频细节的问题。无论是电影的开头、中间还是结尾部分的问题,它都能对答如流。

4. 技术创新与优势

轻量化 Hyper Attention 模块 :

- 通过精心设计的 Hyper Attention 模块,mPLUG-Owl3 实现了图文特征的高效交互和文本建模,降低了额外引入的新参数数量,使得模型更容易训练且推理效率更高。

多模态交错的旋转位置编码(MI-Rope) :

- 引入 MI-Rope 帮助模型更好地理解视觉元素在原始文本中的上下文关系,进一步优化了多模态融合效果。

高效的训练与推理效率 :

- mPLUG-Owl3 在保持高准确性的同时,显著提升了模型的训练和推理效率,使得大规模数据的处理变得更加快速和高效。

二、模型搭建流程

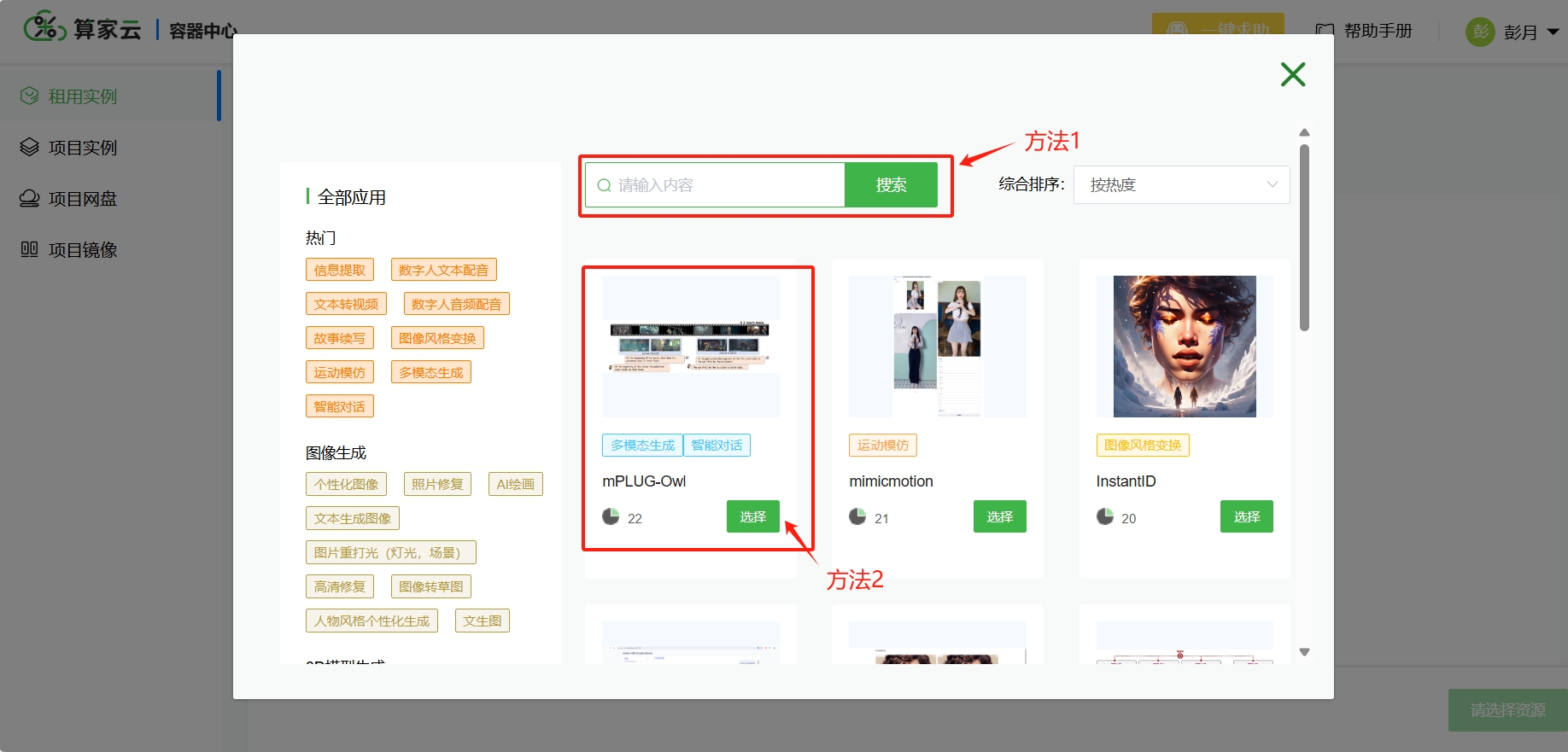

下面将以 mPLUG-Owl3项目进行部署,由于模型较大建议使用 RTX3090 及以上显卡 。

1. 选择主机和镜像

在“租用实例”页面进入应用社区,选择相应的模型和3090显卡,点击“立即创建”,只需三步即可创建实例

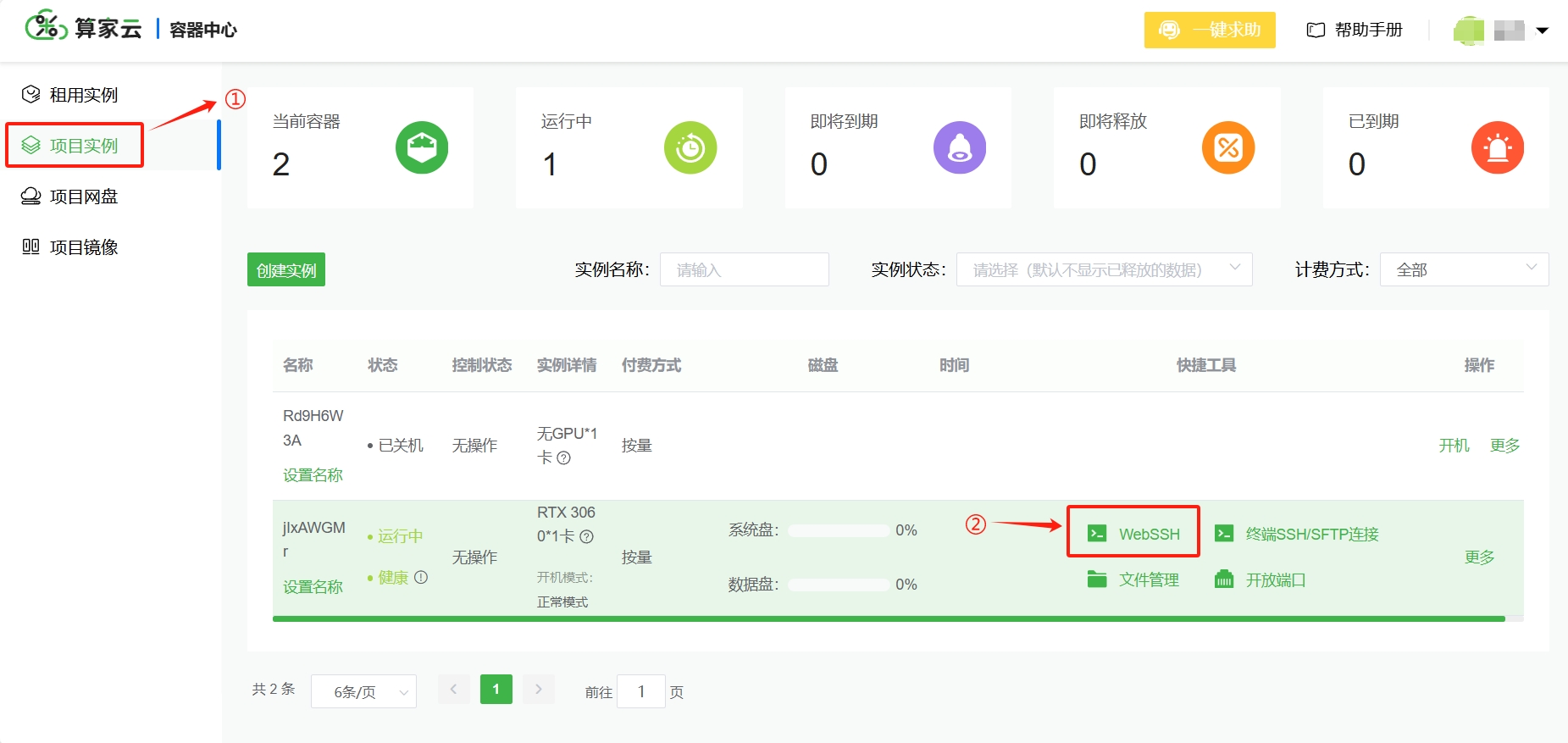

2. 进入创建的实例

在“项目实例”页面点击对应实例的“Web SSH”进入终端操作页面

以下命令均在该页面进行

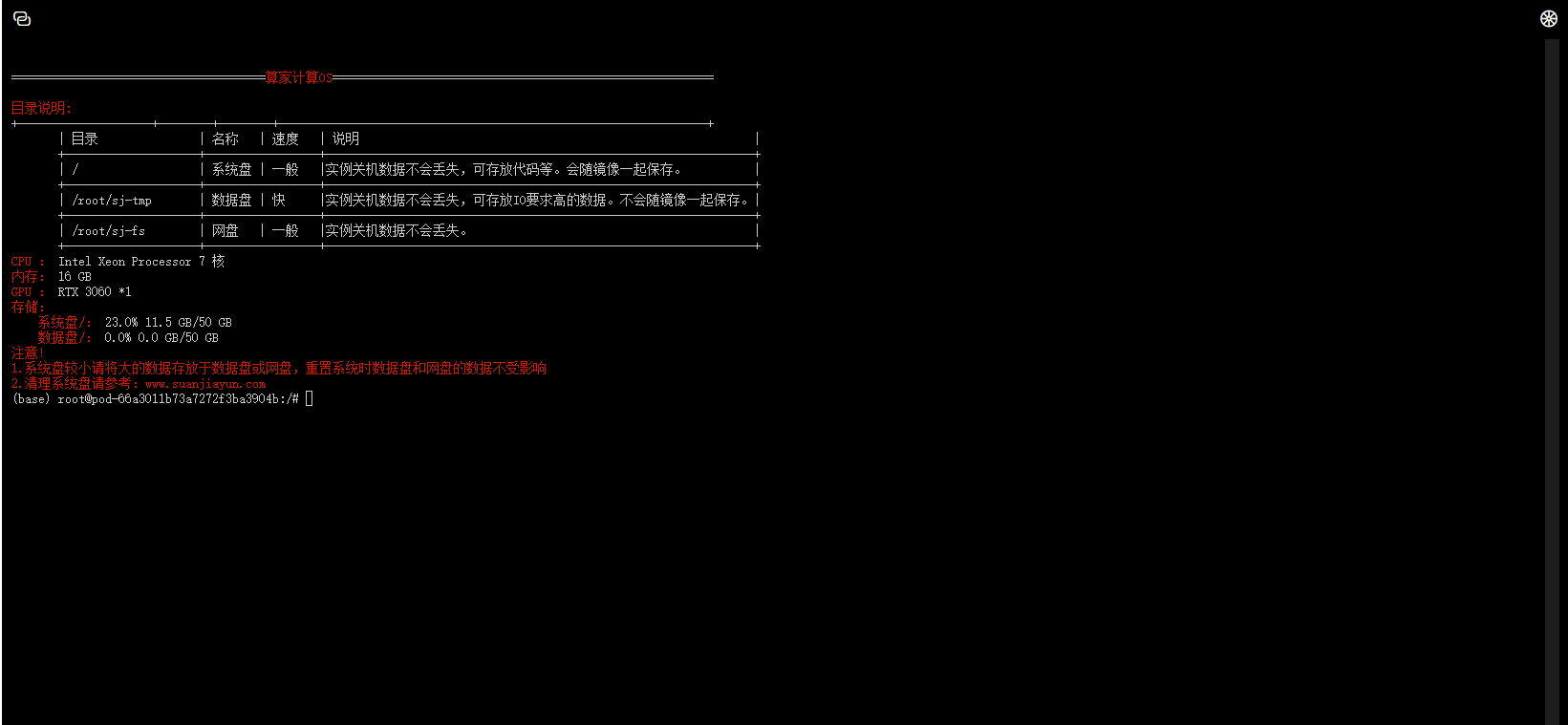

(1)打开文档

cd mPLUG-Owl/mPLUG-Owl3

(2) 创建 python 为 3.9 版本的虚拟环境,名称为owl

conda create -n owl python=3.9 -y

(3)激活虚拟环境owl

conda activate owl

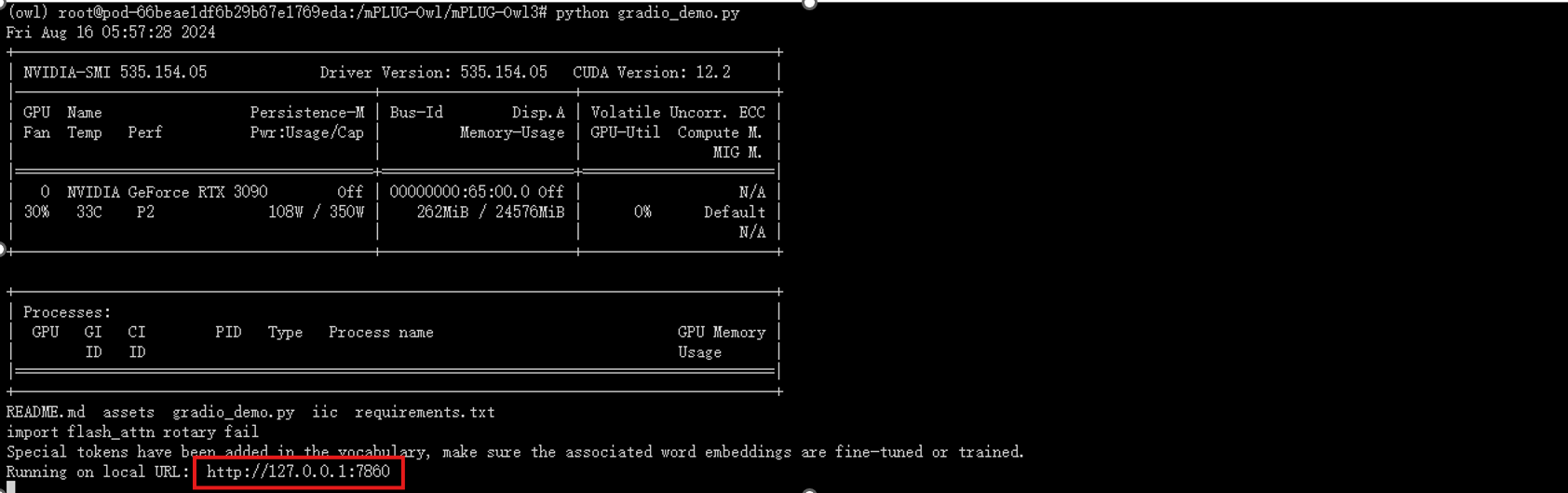

(4)指定端口,运行py文件

export HF_ENDPOINT=https://hf-mirror.com

export GRADIO_SERVER_NAME=0.0.0.0

export GRADIO_SERVER_PORT=8080

python gradio_demo.py

出现以下网址为http://0.0.0.0:8080即为运行成功:

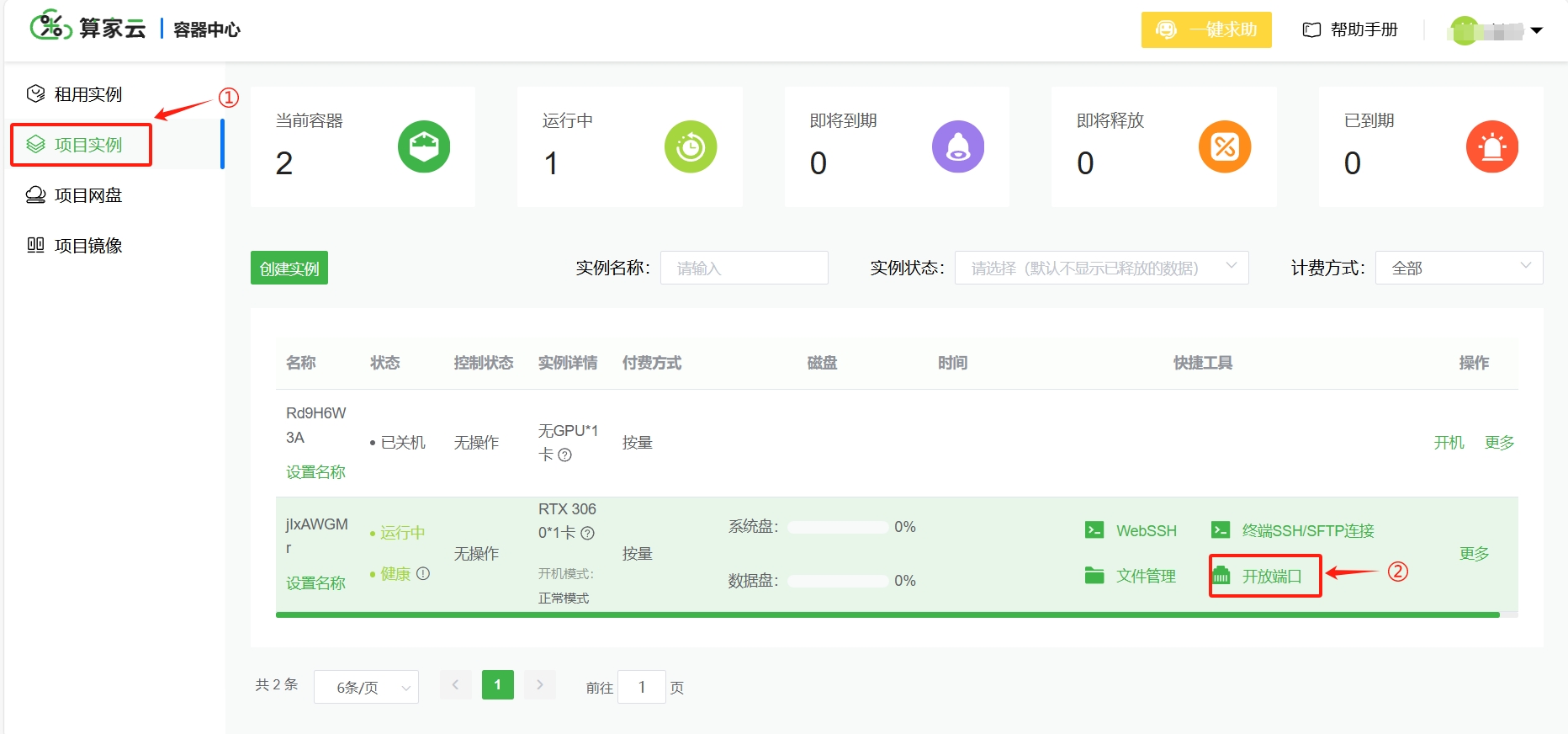

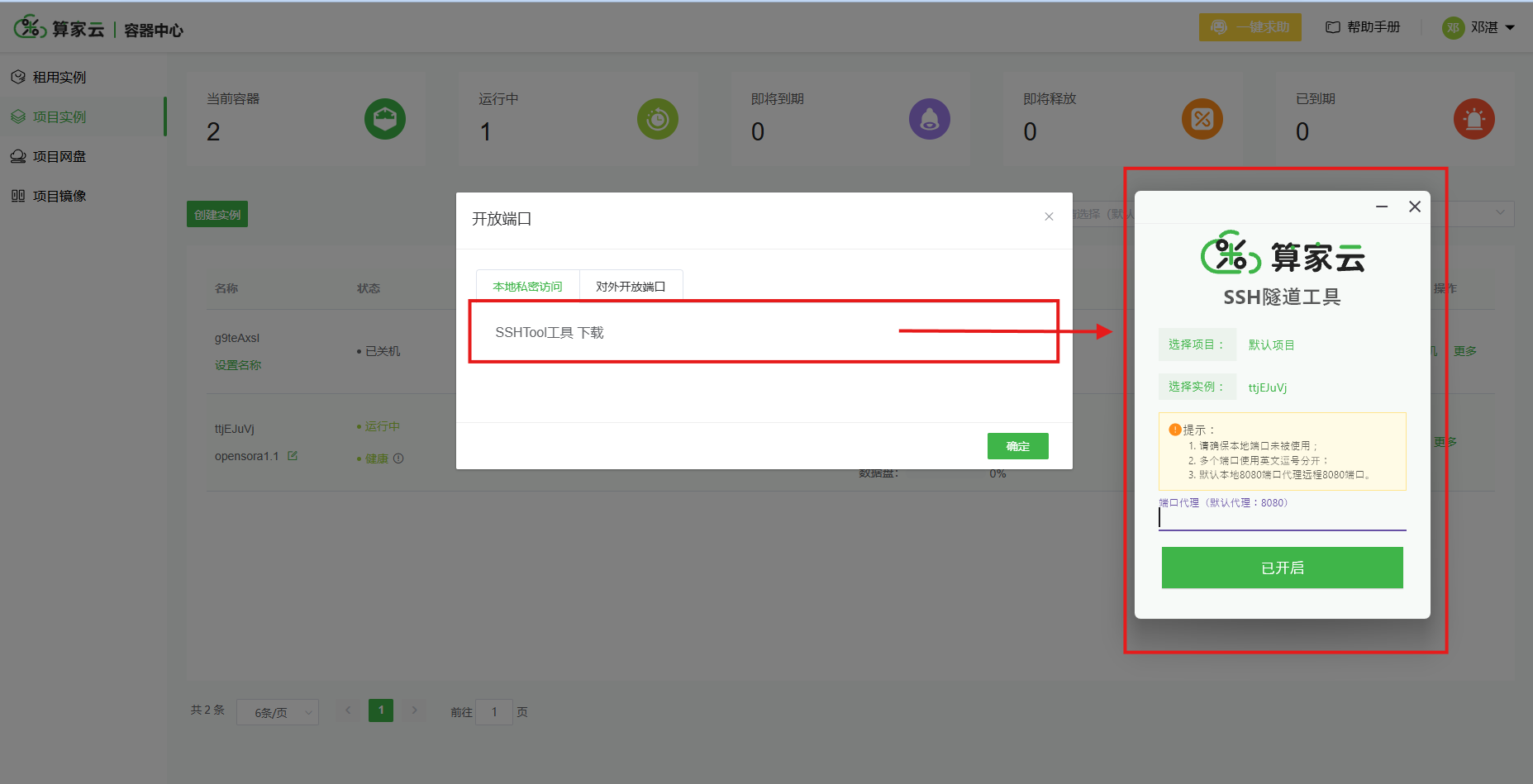

3.开放端口

返回“项目实例”列表,选择并点击对应实例“开放端口”操作。

可选择”本地私密访问“进行下载解压ssh工具,打开得到对应界面,选择对应的项目以及实例开放端口即可。也可选择”对外开放端口“,实名认证后即可使用。

点击开放端口在浏览器输入 127.0.0.1:8080即可访问。

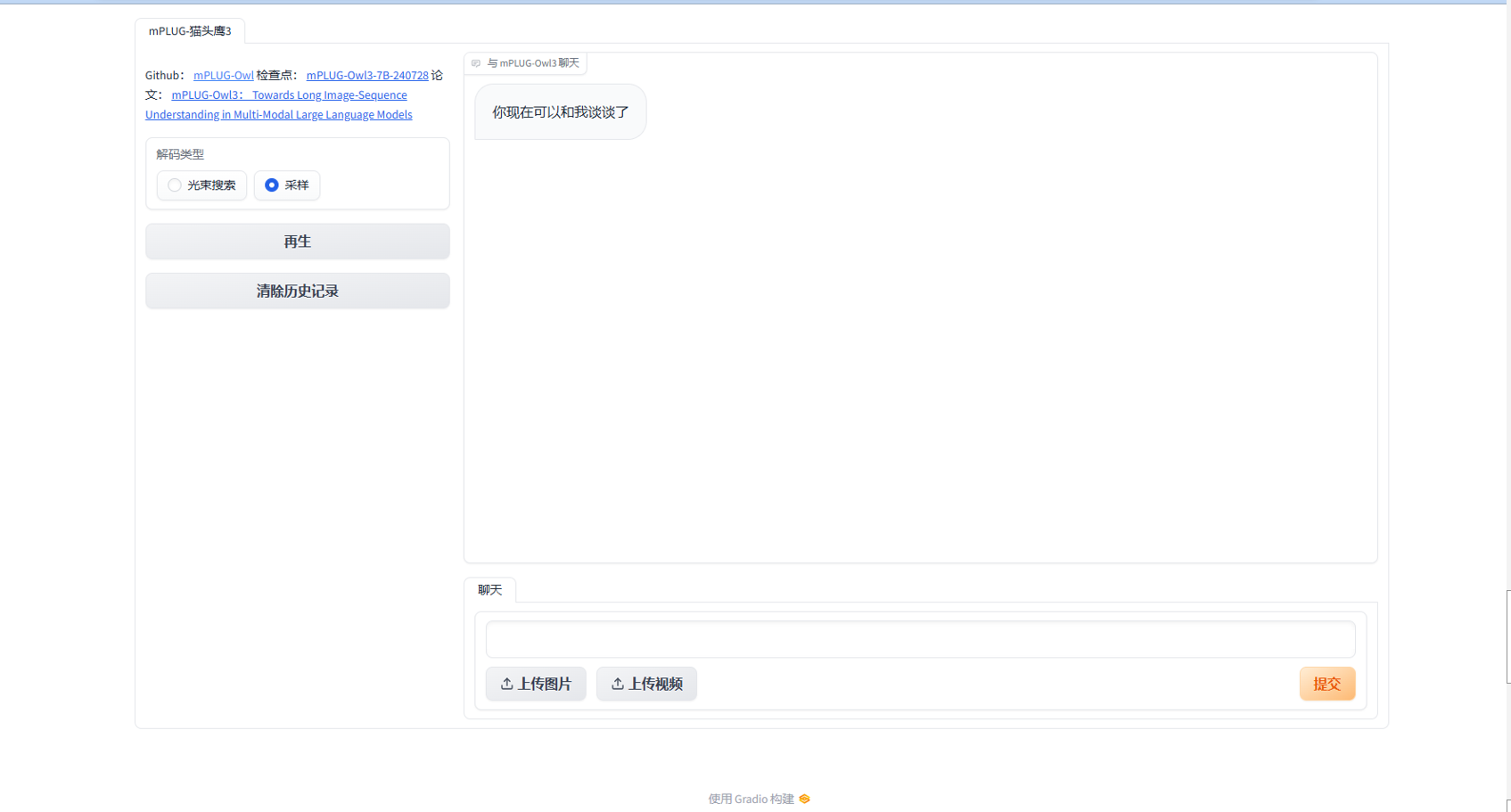

三、网页演示

打开浏览器输入 127.0.0.1:8080 即可进入本地webUI 界面,即可操作。