前言

随着人工智能技术的飞速发展,图像生成已经成为了一个热门领域。在这其中,Stable Diffusion插件ControlNet凭借其创新的技术和强大的功能,获得了一致好评。

所有的AI设计工具,模型和插件,都已经整理好了,👇获取~

ControlNet是什么?

ControlNet是一个用于控制AI图像生成的插件,它使用条件生成对抗网络(Conditional Generative Adversarial Networks, C-GAN)技术来生成图像。它允许用户对生成的图像进行精细的控制,使得在许多应用场景中都非常有用,如计算机视觉、艺术设计、虚拟现实等。通过ControlNet,用户可以精准控制AI图像的生成,以获得更好的视觉效果。

ControlNet的工作原理

ControlNet可以在生成图像过程中引入更多条件来干预图像生成过程。例如,可以使用canny边缘检测来控制图像生成,通过提取参考图像的边缘信息,与文本条件共同作用于目标图像。此外,还可以使用OpenPose来迁移人物姿势特征,从参考图像中提取手、脚、肩膀、头和眼睛等位置特征。

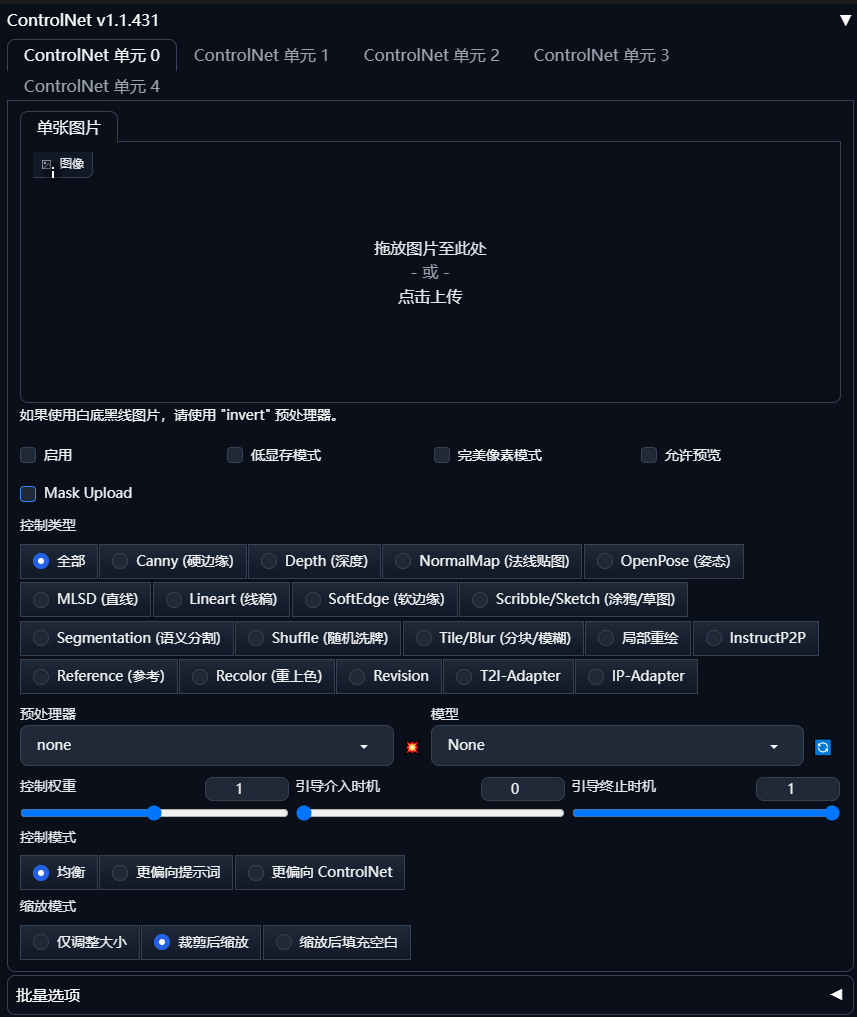

ControlNet的安装和使用

安装ControlNet需要先安装Stable Diffusion和ControlNet插件。安装完成后,需要安装相应的模型。模型的安装通常涉及下载模型文件并将其复制到正确的文件夹中,然后重启UI以使安装生效。

ControlNet的模型和应用

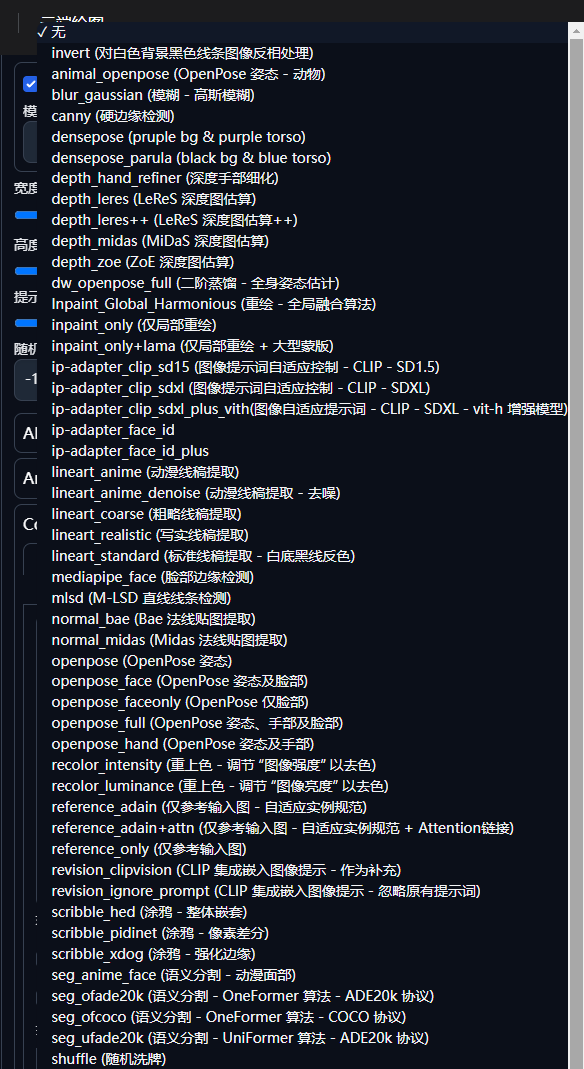

ControlNet提供了多种预处理器和模型,如Canny边缘检测、SoftEdge、Lineart等。这些模型可以用于不同的应用,例如线稿上色、软边缘检测等。用户可以根据需要选择单模型应用或多模型组合应用。

(CONTROLNET模型列表)

StableDifusion中ControlNet的功能和用途

在Stable Diffusion中,ControlNet的功能主要体现在对图像生成过程的精准控制。ControlNet的核心能力在于能够让用户通过设置各种条件,如人体姿势、图像的深度估计、边缘检测等,来让AI更可控地生成最终图像结果。ControlNet的架构与思想让其可以对图像的背景、结构、动作、表情等特征进行精准的控制。例如,通过人体姿势检测,ControlNet可以指导大模型生成特定姿势的人物图片;通过边缘检测,可以控制图像的结构;通过深度估计,可以控制图像内物体的空间位置。ControlNet的应用场景非常广泛,包括艺术二维码生成、光影文字创作、线稿上色、老照片修复等。

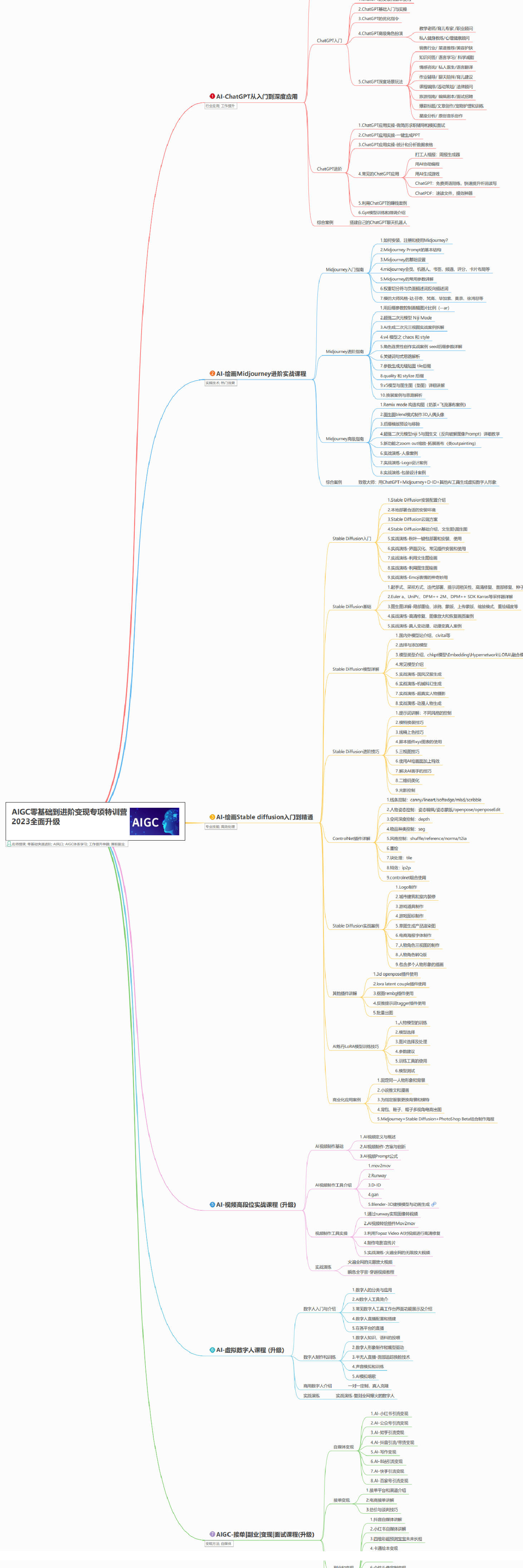

这里分享给大家一份Adobe大神整理的《AIGC全家桶学习笔记》,相信大家会对AIGC有着更深入、更系统的理解。

有需要的朋友,可以点击下方免费领取!

AIGC所有方向的学习路线思维导图

这里为大家提供了总的路线图。它的用处就在于,你可以按照上面的知识点去找对应的学习资源,保证自己学得较为全面。如果下面这个学习路线能帮助大家将AI利用到自身工作上去,那么我的使命也就完成了:

AIGC工具库

AIGC工具库是一个利用人工智能技术来生成应用程序的代码和内容的工具集合,通过使用AIGC工具库,能更加快速,准确的辅助我们学习AIGC

有需要的朋友,可以点击下方卡片免费领取!

精品AIGC学习书籍手册

书籍阅读永不过时,阅读AIGC经典书籍可以帮助读者提高技术水平,开拓视野,掌握核心技术,提高解决问题的能力,同时也可以借鉴他人的经验,结合自身案例融会贯通。

AI绘画视频合集

我们在学习的时候,往往书籍源码难以理解,阅读困难,这时候视频教程教程是就很适合了,生动形象加上案例实战,科学有趣才能更方便的学习下去。

![[数据集][目标检测]绳子检测数据集VOC+YOLO格式322张1类别](https://i-blog.csdnimg.cn/direct/723177636fc843e59f45d42d3c33bab1.png)