因为以前用过LMDeploy,所以本章的内容相对熟悉。

另外,因为教程写的很详细保姆级,所以大多数情况直接复制执行命令即可。开发机的创建略过。

总体验证结论:

- LMDeploy的模型加载有点慢,但推理速度快,符合预期

- 新一代视觉-语言多模态大模型InternVL2-2B模型的能力出乎意料的好,作为2B参数模型相当出色

- Streamlit和Gradio简单高效,配合LLM运用做原型开发很合适,LMDeploy内置支持Gradio

Python环境的准备

在 /root/share/pre_envs 中配置好了预置环境 icamp3_demo

可以通过如下指令进行激活:

conda activate /root/share/pre_envs/icamp3_demo

Cli Demo 部署 InternLM2-Chat-1.8B 模型

首先,创建一个目录,用于存放我们的代码。并创建一个 cli_demo.py。

mkdir -p /root/demo

touch /root/demo/cli_demo.py

然后,我们将下面的代码复制到 cli_demo.py 中。

import torch

from transformers import AutoTokenizer, AutoModelForCausalLM

model_name_or_path = "/root/share/new_models/Shanghai_AI_Laboratory/internlm2-chat-1_8b"

tokenizer = AutoTokenizer.from_pretrained(model_name_or_path, trust_remote_code=True, device_map='cuda:0')

model = AutoModelForCausalLM.from_pretrained(model_name_or_path, trust_remote_code=True, torch_dtype=torch.bfloat16, device_map='cuda:0')

model = model.eval()

system_prompt = """You are an AI assistant whose name is InternLM (书生·浦语).

- InternLM (书生·浦语) is a conversational language model that is developed by Shanghai AI Laboratory (上海人工智能实验室). It is designed to be helpful, honest, and harmless.

- InternLM (书生·浦语) can understand and communicate fluently in the language chosen by the user such as English and 中文.

"""

messages = [(system_prompt, '')]

print("=============Welcome to InternLM chatbot, type 'exit' to exit.=============")

while True:

input_text = input("\nUser >>> ")

input_text = input_text.replace(' ', '')

if input_text == "exit":

break

length = 0

for response, _ in model.stream_chat(tokenizer, input_text, messages):

if response is not None:

print(response[length:], flush=True, end="")

length = len(response)

接下来,我们便可以通过 python /root/demo/cli_demo.py 来启动我们的 Demo。

模型加载的的速度有点慢,大约60s后,可以看到输入提示符。

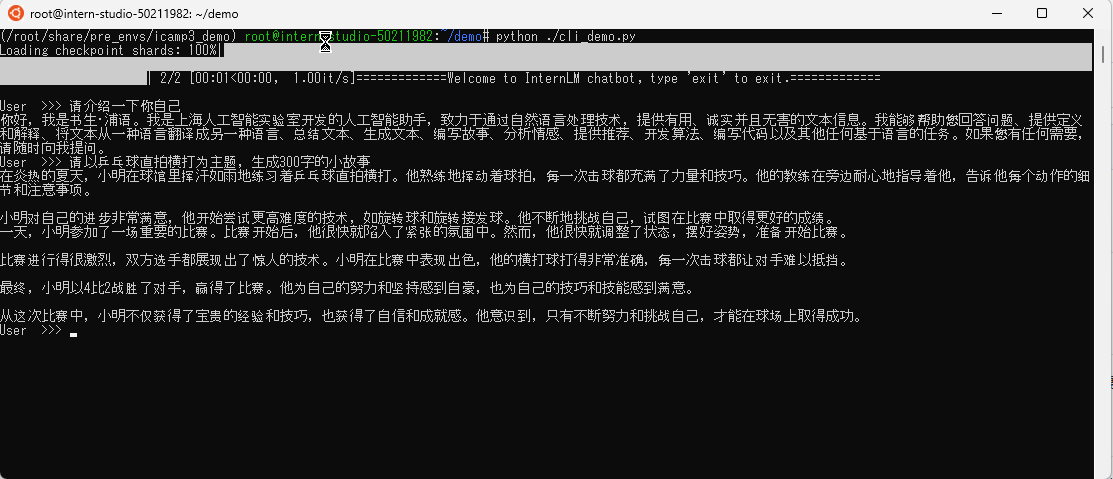

输入问题后,即可以看到回答。提问了如下问题:

- “请介绍一下你自己”

- “以乒乓球直拍横打为主题,生成一个300字的小故事”

总的来说,以1.8B参数的能力,还是中规中矩的。

详细如下图:

Streamlit Web Demo 部署 InternLM2-Chat-1.8B 模型

本章实际是在上一章的基础上,用Streamlit(为什么不用Gradio?)包裹了一层UI,来使用模型。

在模型的使用上没有本质的区别。

执行如下代码来把本教程仓库 clone 到本地,以执行后续的代码。

cd /root/demo

git clone https://github.com/InternLM/Tutorial.git

然后,执行如下代码来启动一个 Streamlit 服务。

cd /root/demo

streamlit run /root/demo/Tutorial/tools/streamlit_demo.py --server.address 127.0.0.1 --server.port 6006

接下来,将端口映射到本地。

ssh -CNg -L 6006:127.0.0.1:6006 root@ssh.intern-ai.org.cn -p <远程端口号>

在完成端口映射后,我们便可以通过浏览器访问 http://localhost:6006 来启动我们的 Demo。

把Temp调整到1.0,来激发最大的灵感,还是输入同样的两个问题,看看回答

- “请介绍一下你自己”

- “以乒乓球直拍横打为题,生成一个300字的小故事”

效果如下图所示:

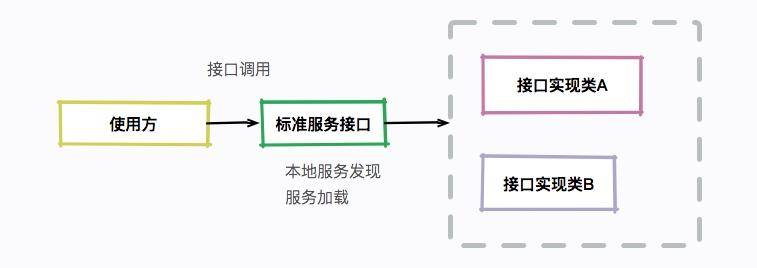

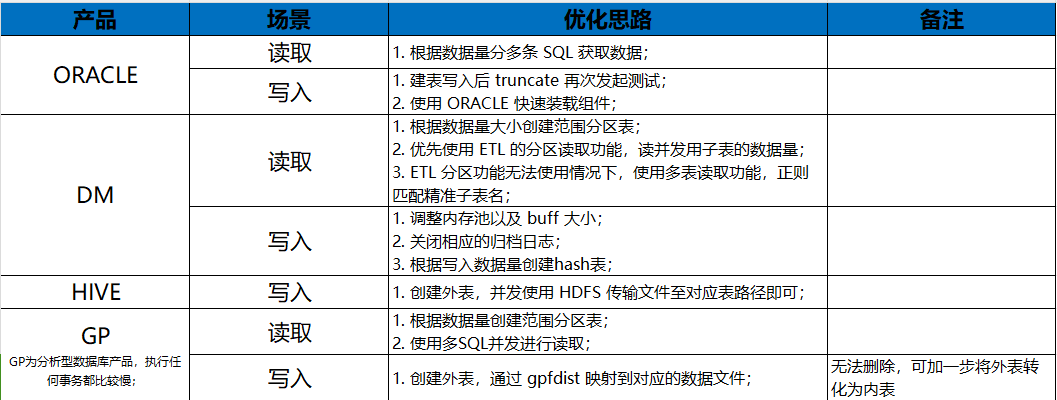

LMDeploy 部署 InternLM-XComposer2-VL-1.8B 模型

InternLM-XComposer2 是一款基于 InternLM2 的视觉语言大模型,其擅长自由形式的文本图像合成和理解。其主要特点包括:

- 自由形式的交错文本图像合成:InternLM-XComposer2 可以根据大纲、详细文本要求和参考图像等不同输入,生成连贯且上下文相关,具有交错图像和文本的文章,从而实现高度可定制的内容创建。

- 准确的视觉语言问题解决:InternLM-XComposer2 基于自由形式的指令准确地处理多样化和具有挑战性的视觉语言问答任务,在识别,感知,详细标签,视觉推理等方面表现出色。

- 令人惊叹的性能:基于 InternLM2-7B 的InternLM-XComposer2 在多个基准测试中位于开源多模态模型第一梯队,而且在部分基准测试中与 GPT-4V 和 Gemini Pro 相当甚至超过它们。

LMDeploy 是一个用于压缩、部署和服务 LLM 的工具包,由 MMRazor 和 MMDeploy 团队开发。它具有以下核心功能:

- 高效的推理:LMDeploy 通过引入持久化批处理、块 KV 缓存、动态分割与融合、张量并行、高性能 CUDA 内核等关键技术,提供了比 vLLM 高 1.8 倍的推理性能。

- 有效的量化:LMDeploy 支持仅权重量化和 k/v 量化,4bit 推理性能是 FP16 的 2.4 倍。量化后模型质量已通过 OpenCompass 评估确认。

- 轻松的分发:利用请求分发服务,LMDeploy 可以在多台机器和设备上轻松高效地部署多模型服务。

- 交互式推理模式:通过缓存多轮对话过程中注意力的 k/v,推理引擎记住对话历史,从而避免重复处理历史会话。

- 优秀的兼容性:LMDeploy支持 KV Cache Quant,AWQ 和自动前缀缓存同时使用。

LMDeploy 已经支持了 InternLM-XComposer2 系列的部署,但值得注意的是 LMDeploy 仅支持了 InternLM-XComposer2 系列模型的视觉对话功能。

使用 LMDeploy 启动一个与 InternLM-XComposer2-VL-1.8B 模型交互的 Gradio 服务。(这次没用Streamlit)。

conda activate /root/share/pre_envs/icamp3_demo

lmdeploy serve gradio /share/new_models/Shanghai_AI_Laboratory/internlm-xcomposer2-vl-1_8b --cache-max-entry-count 0.1

在使用 Upload Image 上传图片后,我们输入 Instruction 后按下回车,便可以看到模型的输出。

原图为:

识别速度很快,输出是:

这张图片描绘了一座雄伟的高山,它的雪白山顶和周围白雪皑皑的景象,构成了一幅壮丽的雪景。山脚下有一片翠绿的草地,与山势形成鲜明的对比。

在山腰处,有一些树木和建筑物,它们与周围的环境融为一体,构成一幅宁静而美丽的自然风景。

嗯,第一句非常棒。后面只能说还是有点幻觉的。不过1.8B的模型不能要求太高。

实际的执行图:

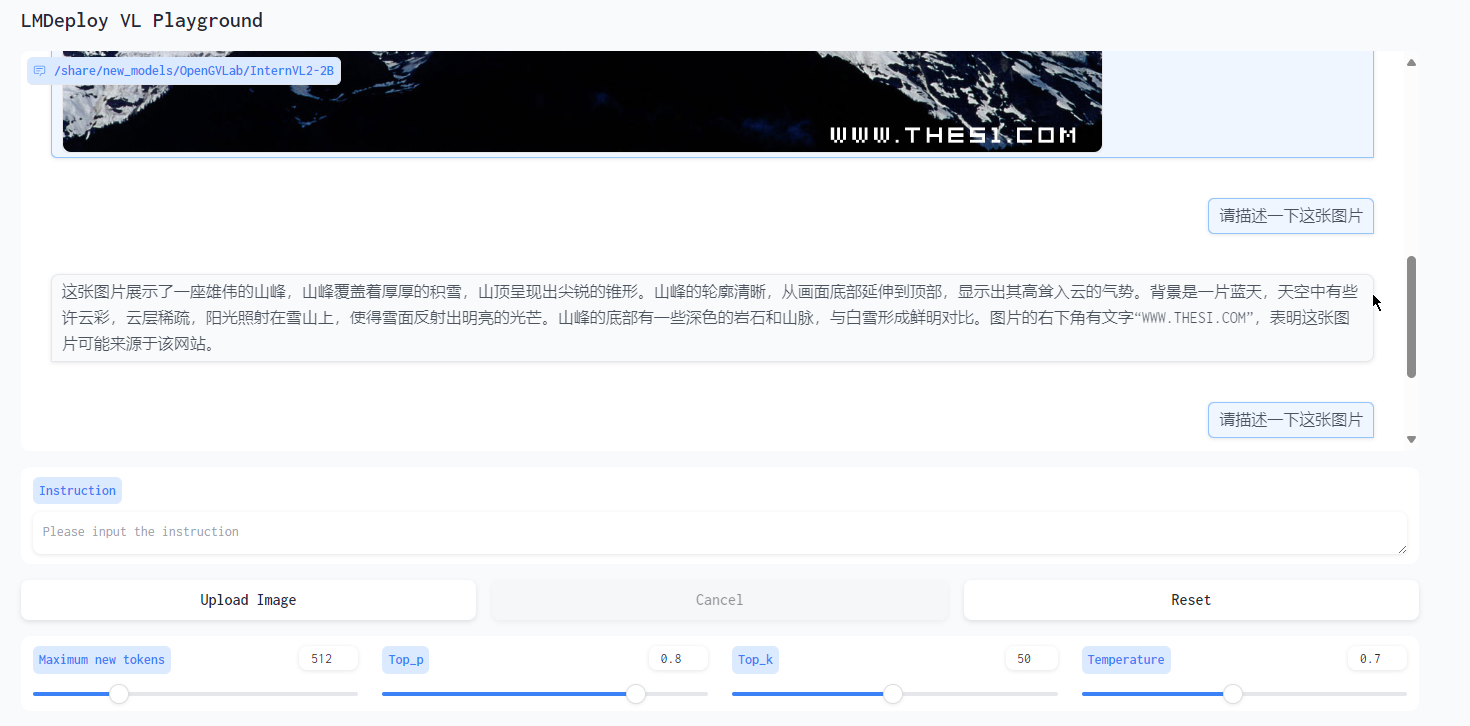

LMDeploy 部署 InternVL2-2B 模型

InternVL2 是上海人工智能实验室推出的新一代视觉-语言多模态大模型,是首个综合性能媲美国际闭源商业模型的开源多模态大模型。InternVL2 系列从千亿大模型到端侧小模型全覆盖,通专融合,支持多种模态。

LMDeploy 也已经支持了 InternVL2 系列模型的部署,使用 LMDeploy 部署 InternVL2-2B 模型。

通过下面的命令来启动 InternVL2-2B 模型的 Gradio 服务。

conda activate /root/share/pre_envs/icamp3_demo

lmdeploy serve gradio /share/new_models/OpenGVLab/InternVL2-2B --cache-max-entry-count 0.1

在完成端口映射后,便可以通过浏览器访问 http://localhost:6006 来启动我们的 Demo。

在使用 Upload Image 上传图片后,我们输入 Instruction 后按下回车,便可以看到模型的输出。

上传了一章中同样的图片,这次的输出相比InternLM-XComposer2-VL-1.8B效果明显好很多。

试了两次,各个部分的细节内容描述非常准确,用语简洁明快。而且还能察觉出整体感(壮丽、雄伟)。

更强的是连右下角的水印都识别并分析出来了。相当厉害,出乎意料。

回答1:

这张图片展示了一座雄伟的山峰,山峰覆盖着厚厚的积雪,山顶呈现出尖锐的锥形。山峰的轮廓清晰,从画面底部延伸到顶部,显示出其高耸入云的气势。

背景是一片蓝天,天空中有些许云彩,云层稀疏,阳光照射在雪山上,使得雪面反射出明亮的光芒。山峰的底部有一些深色的岩石和山脉,

与白雪形成鲜明对比。图片的右下角有文字“WWW.THESI.COM”,表明这张图片可能来源于该网站。

回答2:

这张图片展示了一座雄伟的山峰,山峰覆盖着厚厚的积雪,山顶尖锐而陡峭。山峰的轮廓清晰,从画面底部延伸到顶部,显示出其高耸入云的气势。

背景是一片蓝天,天空中有些许云彩,云层稀疏,阳光照射在雪山上,使得雪面反射出明亮的光芒。山峰的底部有一些深色的岩石和山脉,

与白雪形成鲜明对比。图片的右下角有文字“WWW.THESI.COM”,表明这张图片可能来源于该网站。整体画面给人一种壮丽和雄伟的感觉。

实际执行图: