Focal Loss

理念

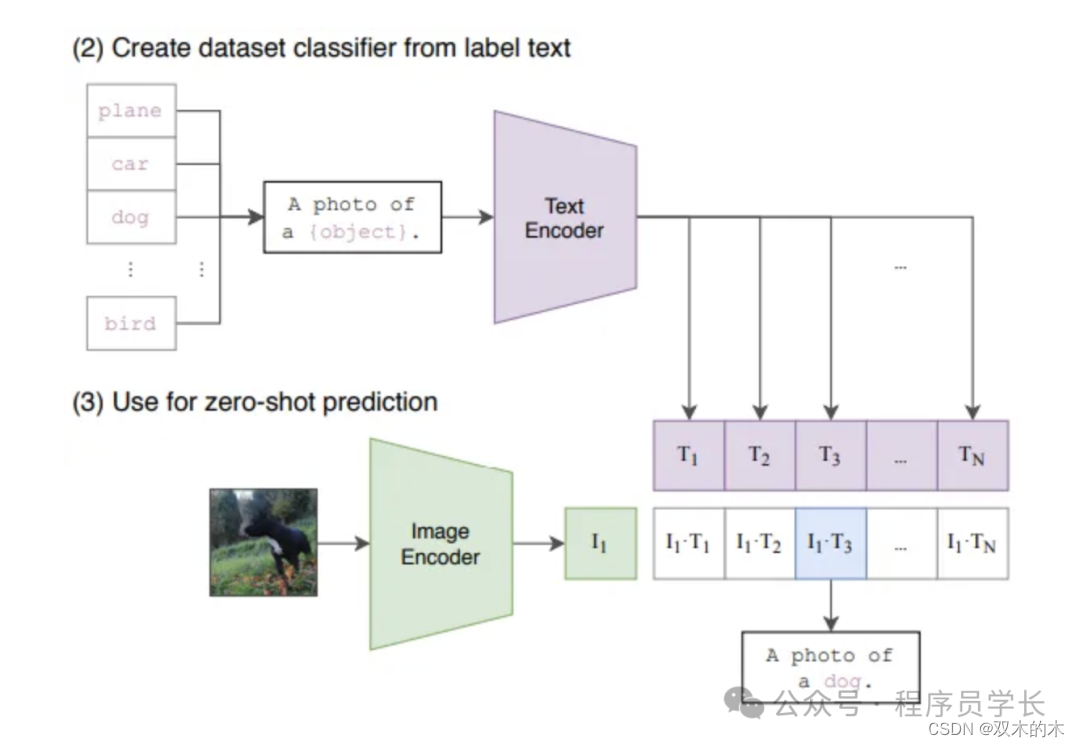

Focal loss 可以 平衡简单样本和困难样本(或大量样本和少量样本)的学习 。在遇到样本不同类别之间学习难度相差很大(比如区分飞机、摩托车和自行车,飞机的特征明显与后两者更易区分,可以用混淆矩阵看出来),或者样本数量相差很多时(飞机有 1k 个样本,汽车只有 10 个,模型倾向于无脑预测飞机)时,大量简单样本产生的小 loss 可能会淹没少量困难样本的大 loss,因此我们考虑:

- 当遇到非常简单的样本、输出十分坚决时,对 loss 截断。

- 当遇到非常困难的样本、输出摸棱两可时,对 loss 保留。

这就是 Focal Loss 的基本思路,让模型更加注重困难样本所贡献的 loss ,另外 Focal loss 用于分类任务,实际上也是一种扩展的 cross entropy loss ( γ = 0