什么是Spark?

Apache Spark是一个开源的分布式计算系统,它提供了一个快速和通用的集群计算平台。Spark 能够处理大规模数据,支持多种编程语言,如Scala、Java和Python,并且具有多种高级功能,包括SQL查询、机器学习、图处理和实时数据流处理。

以下是Spark的一些基础概念和组件:

-

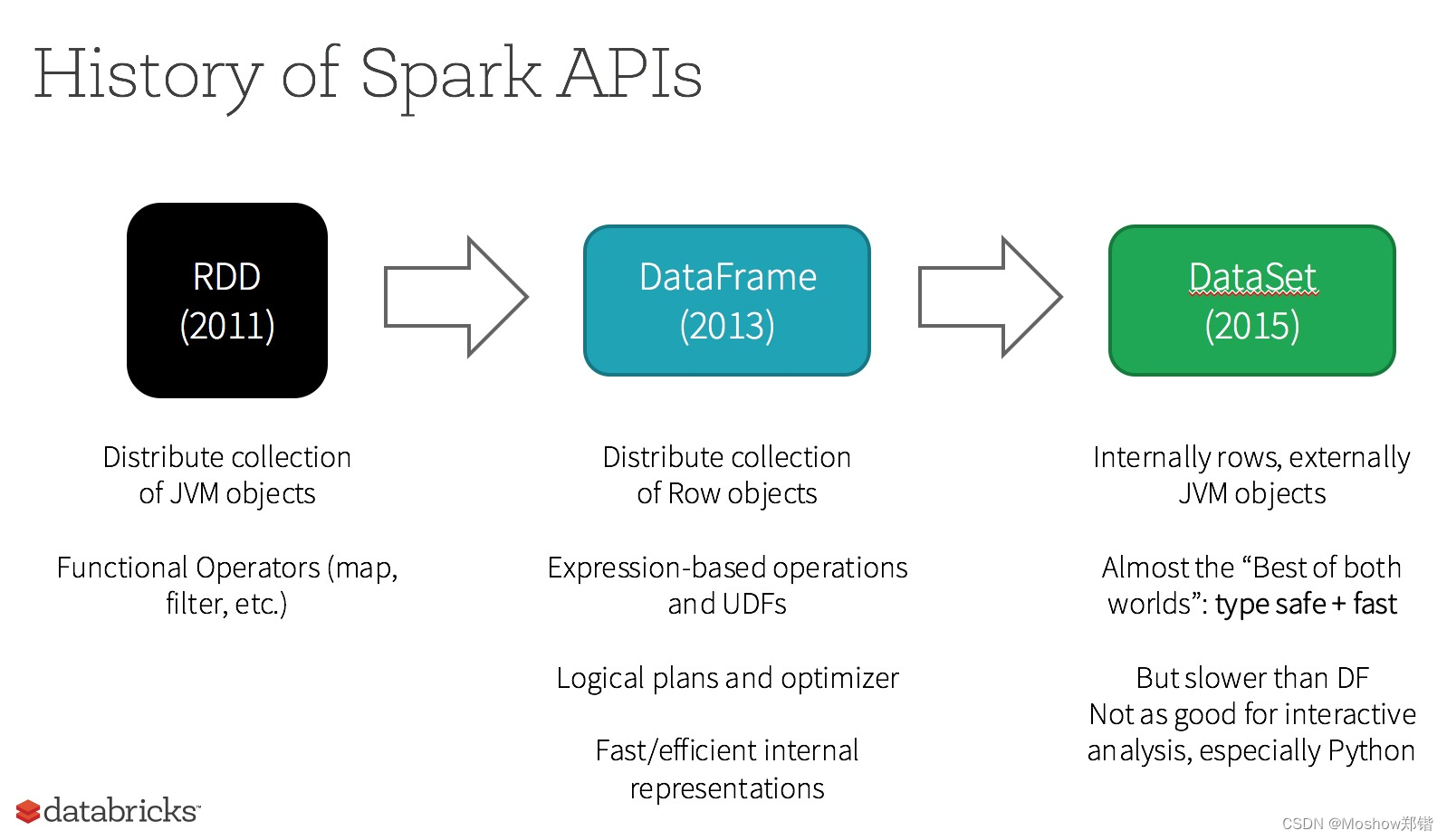

弹性分布式数据集(RDD):

- RDD是Spark的最基本的数据抽象,代表一个不可变、分布式的数据集合。

- RDD提供了丰富的转换操作,如map、filter、reduce等,以及行动操作,如count、collect等。

-

DataFrame:

- DataFrame是一个以RDD为基础的更高级的抽象,提供了结构化的数据操作。

- DataFrame API允许用户以声明式的方式进行数据查询,类似于SQL。

-

Dataset:

- Dataset是Spark的另一个数据抽象,结合了RDD的强类型和DataFrame的结构化特性。

- Dataset API提供了编译时类型检查和运行时的高性能优化。

-

Spark SQL:

- Spark SQL是Spark的一个模块,提供了用于执行SQL查询和操作DataFrame和Dataset的编程接口。

- 用户可以使用Spark SQL进行数据的读取、写入、转换和查询。

-

Spark Streaming:

- Spark Streaming是Spark的实时数据流处理模块。

- 它允许用户以微批处理的方式处理实时数据流。

-

MLlib:

- MLlib是Spark的机器学习库,提供了一系列的算法和工具,用于分类、回归、聚类等机器学习任务。

-

GraphX:

- GraphX是Spark的图处理模块,用于处理图结构数据。

- 它提供了图的创建、查询、转换和迭代图计算的功能。

-

Spark Core:

- Spark Core是Spark框架的核心,提供了基本的分布式任务调度和集群管理功能。

-

集群管理器:

- Spark可以运行在多种集群管理器上,如Standalone、Hadoop YARN、Apache Mesos和Kubernetes。

-

部署模式:

- Spark支持不同的部署模式,包括本地模式和集群模式。

-

缓存和持久化:

- Spark允许将数据缓存到内存中,以加速迭代算法或多次使用的数据集。

-

SparkSession:

- 在Spark 2.0及以后的版本中,SparkSession是新的入口点,用于创建DataFrame和Dataset,以及访问Spark SQL功能。

-

DataFrame转换操作:

- 转换操作包括select、filter、groupBy、orderBy、join等。

-

DataFrame行动操作:

- 行动操作包括count、collect、show、save等。

-

Spark UI:

- Spark提供了一个Web UI,用于监控和调试Spark应用程序。

-

容错机制:

- Spark使用 lineage信息和数据的不可变性来实现容错。

-

资源调度:

- Spark提供了资源调度的机制,允许用户配置应用程序的资源需求。

Spark是一个功能强大且灵活的计算平台,适用于各种大数据处理场景。通过其丰富的API和组件,Spark能够满足从批处理到实时处理、从数据处理到机器学习的多种需求。

DataFrame API

在Java中使用Apache Spark的DataFrame API,你首先需要在Spring Boot项目中添加Spark的依赖。以下是在Spring Boot项目中集成Apache Spark并使用DataFrame API的步骤:

-

添加依赖: 在你的

pom.xml文件中添加Apache Spark的依赖。由于Spark的依赖可能与其他库有冲突,建议使用spark-sql模块,它包含了DataFrame API所需的核心库。<dependencies> <!-- 其他依赖 --> <dependency> <groupId>org.apache.spark</groupId> <artifactId>spark-sql_2.12</artifactId> <version>3.1.1</version> <!-- 使用适合你的Spark版本 --> </dependency> </dependencies> -

创建SparkSession:

SparkSession是使用DataFrame API的入口点,你需要创建一个SparkSession实例来开始使用DataFrame。import org.apache.spark.sql.SparkSession; public class SparkDemo { public static void main(String[] args) { SparkSession spark = SparkSession .builder() .appName("Java Spark DataFrame API Demo") .master("local[*]") // 使用本地所有核心 .getOrCreate(); } } -

读取数据: 使用

SparkSession读取数据,可以是JSON、CSV、Parquet等格式。import org.apache.spark.sql.Dataset; import org.apache.spark.sql.Row; Dataset<Row> df = spark.read().json("path_to_your_data.json"); -

DataFrame操作: 使用DataFrame API进行数据操作,如选择、过滤、聚合等。

import static org.apache.spark.sql.functions.*; // 选择列 df.select("column1", "column2").show(); // 过滤数据 df.filter(col("column1").equalTo("value")).show(); // 聚合操作 df.groupBy("column1").agg(sum("column2").alias("total")).show(); -

执行行动操作: 行动操作会触发实际的计算,如

collect、count、show等。long count = df.count(); // 计数 df.show(); // 显示前20行数据 -

停止SparkSession: 在应用程序结束时,应该停止

SparkSession以释放资源。spark.stop(); -

配置Spring Boot: 如果你希望Spark集成到Spring Boot中,可以在Spring Boot的配置类中配置

SparkSession,并通过Spring的依赖注入将其注入到需要使用Spark的组件中。import org.springframework.context.annotation.Bean; import org.springframework.context.annotation.Configuration; @Configuration public class SparkConfig { @Bean public SparkSession sparkSession() { return SparkSession .builder() .appName("Spring Boot Spark DataFrame API") .master("local[*]") .getOrCreate(); } }

请注意,在使用Spark时,你可能需要根据你的数据源和业务需求进行配置和调整。此外,由于Spark是一个分布式计算框架,通常用于处理大规模数据集,因此在本地模式下可能不会看到其全部优势。在生产环境中,你可能会配置Spark以连接到一个集群。

![[数据集][目标检测]婴儿状态睡觉哭泣检测数据集VOC+YOLO格式7109张3类别](https://img-blog.csdnimg.cn/direct/d51f7da7b67c480a8879c3064d26d018.png)