说明:这是一个机器学习实战项目(附带数据+代码+文档+视频讲解),如需数据+代码+文档+视频讲解可以直接到文章最后获取。

1.项目背景

在探索机器学习算法的性能与适用性时,我们往往需要依赖于精心设计的人工数据集来测试和验证各种模型的效能。其中一个广泛使用的数据集是“Make Moons”,它由Scikit-Learn库提供。本项目旨在利用“Make Moons”数据集,深入研究并比较不同分类算法的表现,以解决一个典型的二分类问题。

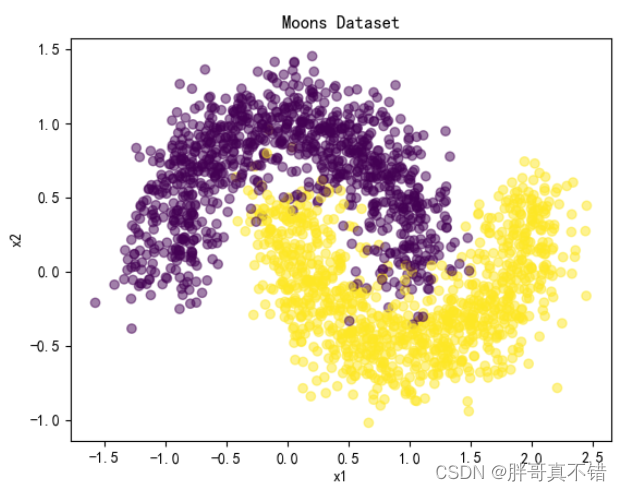

“Make Moons”数据集由两个交错的半圆形分布组成,形似两个相互重叠的月亮。每个数据点都包含两个特征,分别代表该点在二维空间中的横纵坐标。数据点被分为两个类别,即两个不同的“月亮”,这使得分类任务既直观又具有挑战性。数据集的设计初衷是为了测试分类器如何处理非线性可分的问题。

本项目的核心目标是评估和对比多种机器学习分类算法在解决“Make Moons”数据集上的表现。

本项目通过决策树分类模型、支持向量机分类模型、随机森林分类模型和XGBoost分类模型实现月亮数据标签预测。

2.数据获取

本次建模数据来源于网络(本项目撰写人整理而成),数据项统计如下:

| 编号 | 变量名称 | 描述 |

| 1 | x1 | 表示每个数据点在二维空间的位置 |

| 2 | x2 | 表示每个数据点在二维空间的位置 |

| 3 | Label | 表示每个数据点所属的类别(0或1) |

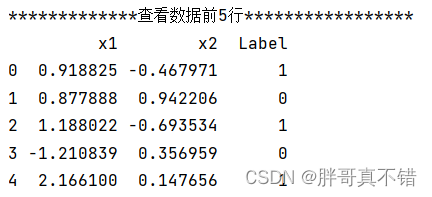

数据详情如下(部分展示):

3.数据预处理

3.1 用Pandas工具查看数据

使用Pandas工具的head()方法查看前五行数据:

关键代码:

3.2数据缺失查看

使用Pandas工具的info()方法查看数据信息:

从上图可以看到,总共有3个变量,数据中无缺失值,共2000条数据。

关键代码:

3.3数据描述性统计

通过Pandas工具的describe()方法来查看数据的平均值、标准差、最小值、分位数、最大值。

关键代码如下:

4.探索性数据分析

4.1 Label变量柱状图

用Matplotlib工具的plot()方法绘制柱状图:

4.2 特征散点图

4.3 Label=1样本x1变量分布直方图

用Matplotlib工具的hist()方法绘制直方图:

4.4 相关性分析

从上图中可以看到,数值越大相关性越强,正值是正相关、负值是负相关。

5.特征工程

5.1 建立特征数据和标签数据

关键代码如下:

5.2 数据集拆分

通过train_test_split()方法按照80%训练集、20%测试集进行划分,关键代码如下:

![]()

6.构建分类模型

主要使用决策树分类算法、支持向量机分类模型、随机森林分类算法和XGBoost分类算法,用于目标分类。

6.1 构建模型

| 编号 | 模型名称 | 参数 |

| 1 | 决策树分类模型 | 默认参数值 |

| 2 | random_state=123 | |

| 3 | 支持向量机分类模型 | probability=True |

| 4 | random_state=42 | |

| 5 | 随机森林分类模型 | 默认参数值 |

| 6 | random_state=42 | |

| 7 | XGBoost分类模型 | 默认参数值 |

| 8 | random_state=42 |

7.模型评估

7.1评估指标及结果

评估指标主要包括准确率、查准率、查全率、F1分值等等。

| 模型名称 | 指标名称 | 指标值 |

| 测试集 | ||

| 决策树分类模型 | 准确率 | 0.9750 |

| 查准率 | 0.9854 | |

| 查全率 | 0.9667 | |

| F1分值 | 0.976 | |

| 支持向量机分类模型 | 准确率 | 0.9750 |

| 查准率 | 0.9808 | |

| 查全率 | 0.9714 | |

| F1分值 | 0.9761 | |

| 随机森林分类模型 | 准确率 | 0.9725 |

| 查准率 | 0.9807 | |

| 查全率 | 0.9667 | |

| F1分值 | 0.9736 | |

| XGBoost分类模型 | 准确率 | 0.9725 |

| 查准率 | 0.9807 | |

| 查全率 | 0.9667 | |

| F1分值 | 0.9736 | |

从上表可以看出,4个模型的F1分值都在0.9以上,说明4个模型在月亮数据集上效果较好。

7.2 分类报告

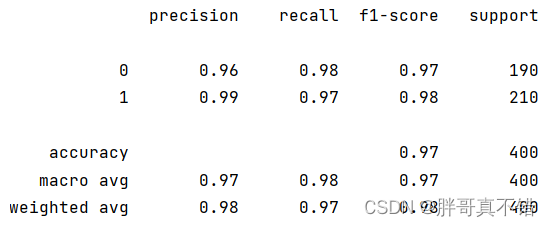

决策树分类模型:

从上图可以看出,分类为0的F1分值为0.97;分类为1的F1分值为0.98。

支持向量机分类模型:

从上图可以看出,分类为0的F1分值为0.97;分类为1的F1分值为0.98。

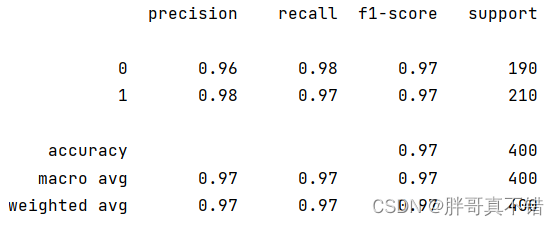

随机森林分类模型:

从上图可以看出,分类为0的F1分值为0.97;分类为1的F1分值为0.97。

XGBoost分类模型:

从上图可以看出,分类为0的F1分值为0.97;分类为1的F1分值为0.97。

7.3 混淆矩阵

决策树分类模型:

从上图可以看出,实际为0预测不为0的 有3个样本;实际为1预测不为1的 有7个样本。

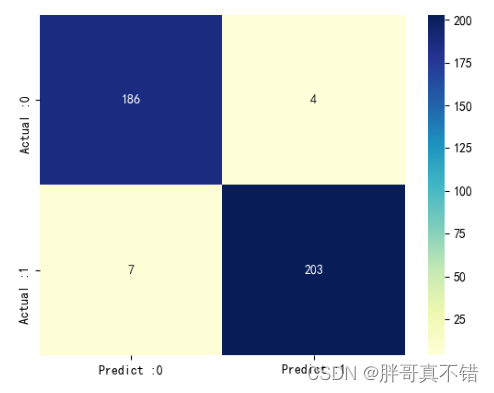

支持向量机分类模型:

从上图可以看出,实际为0预测不为0的 有4个样本;实际为1预测不为1的 有6个样本。

随机森林分类模型:

从上图可以看出,实际为0预测不为0的 有4个样本;实际为1预测不为1的 有7个样本。

XGBoost分类模型:

从上图可以看出,实际为0预测不为0的 有4个样本;实际为1预测不为1的 有7个样本。

7.4 ROC曲线

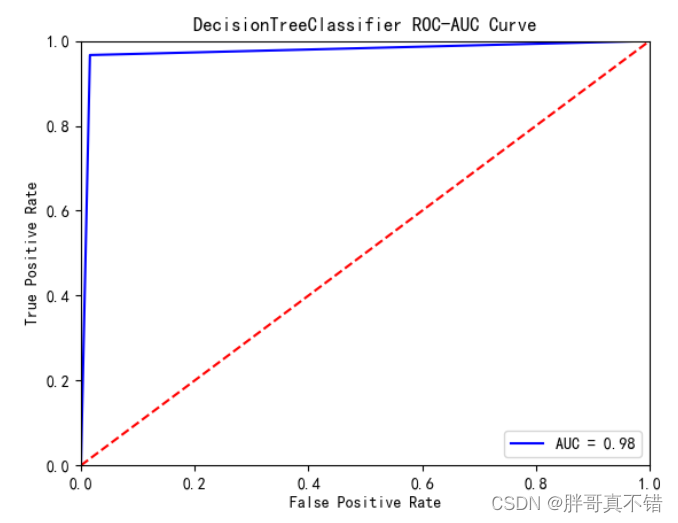

决策树分类模型:

从上图可以看出,决策树分类模型的AUC值为0.98。

支持向量机分类模型:

从上图可以看出,决策树分类模型的AUC值为1.0。

随机森林分类模型:

从上图可以看出,随机森林分类模型的AUC值为1.0。

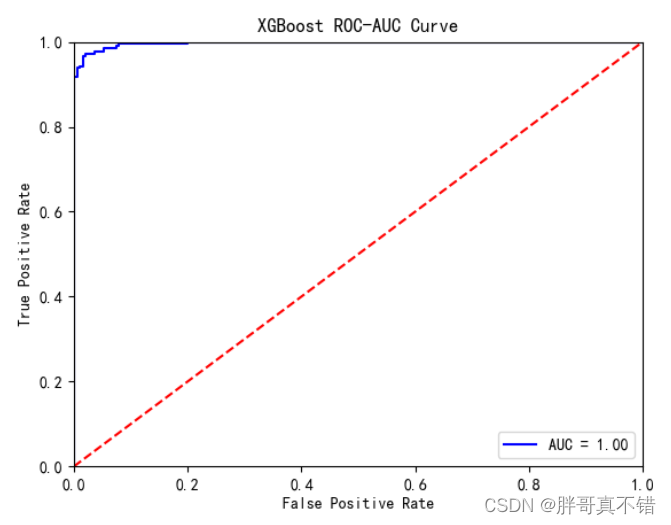

XGBoost分类模型:

从上图可以看出,XGBoost分类模型的AUC值为1.0。

8.结论与展望

综上所述,本文采用了决策树、支持向量机、随机森林和XGBoost算法来构建分类模型,最终证明了4种模型效果较好。此模型可用于日常产品的预测。

# 本次机器学习项目实战所需的资料,项目资源如下:

# 项目说明:

# 获取方式一:

# 项目实战合集导航:

https://docs.qq.com/sheet/DTVd0Y2NNQUlWcmd6?tab=BB08J2

# 获取方式二:

链接:https://pan.baidu.com/s/1k5oUmC9Kt3_5d3KWIHtizg

提取码:h1i2

![[图解]建模相关的基础知识-19](https://img-blog.csdnimg.cn/direct/6c5b6ec4beb94e898d6933f8493dbc0d.png)