>- **🍨 本文为[🔗365天深度学习训练营](https://mp.weixin.qq.com/s/0dvHCaOoFnW8SCp3JpzKxg) 中的学习记录博客**

>- **🍖 原作者:[K同学啊](https://mtyjkh.blog.csdn.net/)**目录

一、前言

目标

二、我的环境(依旧是在云gpu)

三、前期准备

1.设置GPU

import tensorflow as tf

gpus = tf.config.list_physical_devices("GPU")

if gpus:

gpu0 = gpus[0] #如果有多个GPU,仅使用第0个GPU

tf.config.experimental.set_memory_growth(gpu0, True) #设置GPU显存用量按需使用

tf.config.set_visible_devices([gpu0],"GPU")

2.导入数据(直接下载的自带的数据集)

import tensorflow as tf

from tensorflow.keras import datasets, layers, models

import matplotlib.pyplot as plt

(train_images, train_labels), (test_images, test_labels) = datasets.cifar10.load_data()3.归一化

# 将像素的值标准化至0到1的区间内。

train_images, test_images = train_images / 255.0, test_images / 255.0

train_images.shape,test_images.shape,train_labels.shape,test_labels.shape4.可视化图片

class_names = ['airplane', 'automobile', 'bird', 'cat', 'deer','dog', 'frog', 'horse', 'ship', 'truck']

plt.figure(figsize=(20,10))

for i in range(20):

plt.subplot(5,10,i+1)

plt.xticks([])

plt.yticks([])

plt.grid(False)

plt.imshow(train_images[i], cmap=plt.cm.binary)

plt.xlabel(class_names[train_labels[i][0]])

plt.show()四、构建简单的cnn网络

⭐关于卷积层:可参考【知识储备】部分

⭐池化层

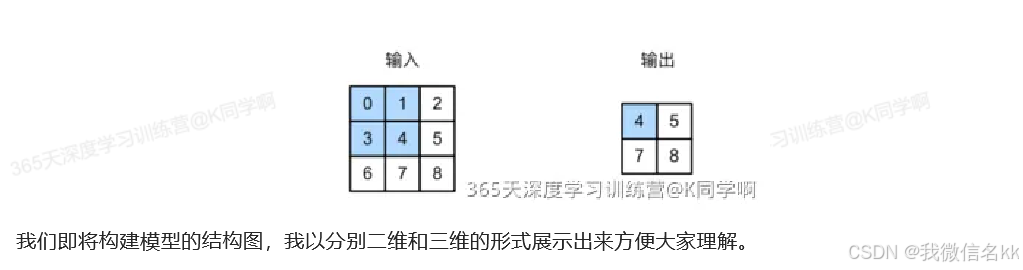

池化层对提取到的特征信息进行降维,一方面使特征图变小,简化网络计算复杂度;另一方面进行特征压缩,提取主要特征,增加平移不变性,减少过拟合风险。但其实池化更多程度上是一种计算性能的一个妥协,强硬地压缩特征的同时也损失了一部分信息,所以现在的网络比较少用池化层或者使用优化后的如SoftPool。

池化层包括最大池化层(MaxPooling)和平均池化层(AveragePooling),均值池化对背景保留更好,最大池化对纹理提取更好)。同卷积计算,池化层计算窗口内的平均值或者最大值。例如通过一个 2*2 的最大池化层,其计算方式如下:

- 平面结构图(可单击放大查看)

- 立体结构图(可单击放大查看)

-

model = models.Sequential([

layers.Conv2D(32, (3, 3), activation='relu', input_shape=(32, 32, 3)), #卷积层1,卷积核3*3

layers.MaxPooling2D((2, 2)), #池化层1,2*2采样

layers.Conv2D(64, (3, 3), activation='relu'), #卷积层2,卷积核3*3

layers.MaxPooling2D((2, 2)), #池化层2,2*2采样

layers.Conv2D(64, (3, 3), activation='relu'), #卷积层3,卷积核3*3

layers.Flatten(), #Flatten层,连接卷积层与全连接层

layers.Dense(64, activation='relu'), #全连接层,特征进一步提取

layers.Dense(10) #输出层,输出预期结果

])

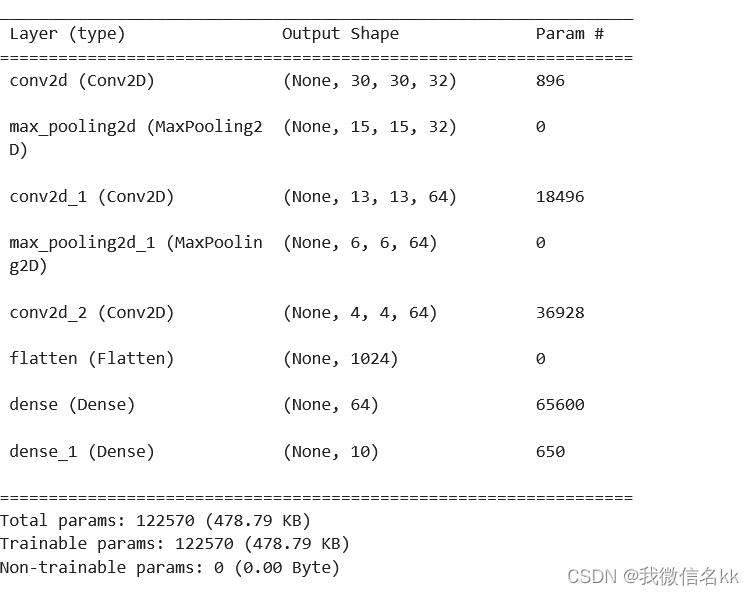

model.summary() # 打印网络结构

五.编译模型

model.compile(optimizer='adam',

loss=tf.keras.losses.SparseCategoricalCrossentropy(from_logits=True),

metrics=['accuracy'])

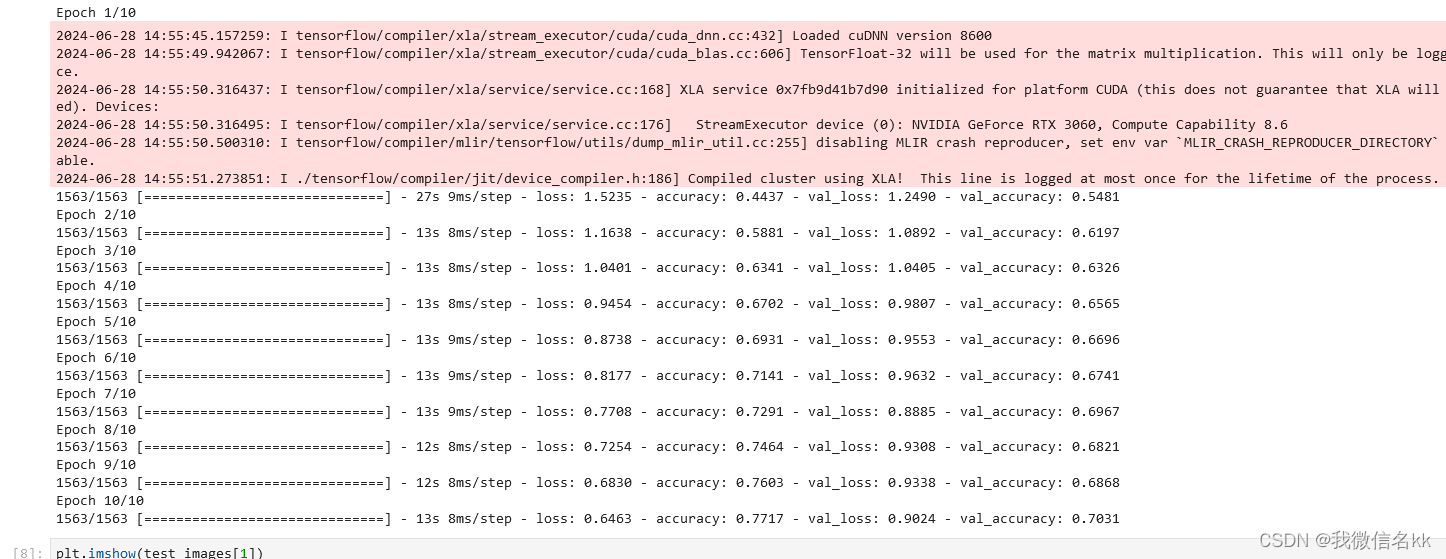

六、训练模型

history = model.fit(train_images, train_labels, epochs=10,

validation_data=(test_images, test_labels))

七预测和模型评估

预测

plt.imshow(test_images[1])

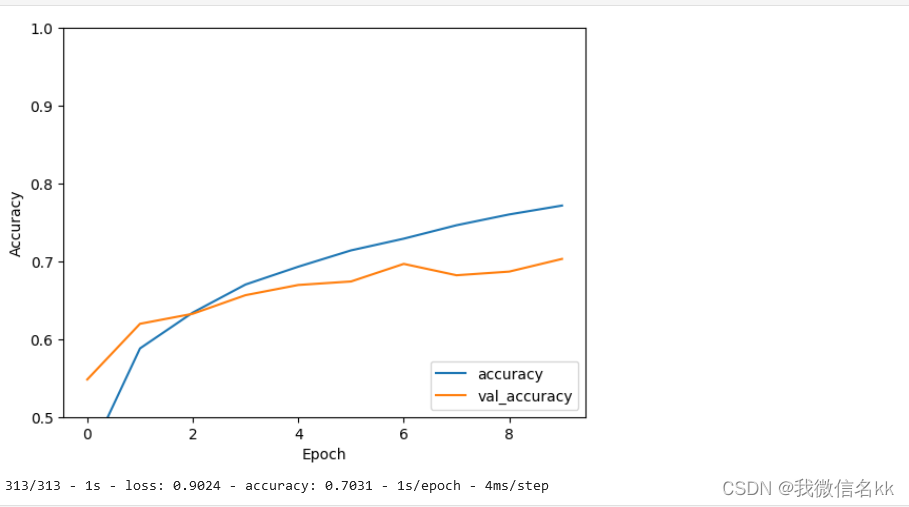

模型评估

import matplotlib.pyplot as plt

plt.plot(history.history['accuracy'], label='accuracy')

plt.plot(history.history['val_accuracy'], label = 'val_accuracy')

plt.xlabel('Epoch')

plt.ylabel('Accuracy')

plt.ylim([0.5, 1])

plt.legend(loc='lower right')

plt.show()

test_loss, test_acc = model.evaluate(test_images, test_labels, verbose=2)print(test_acc)

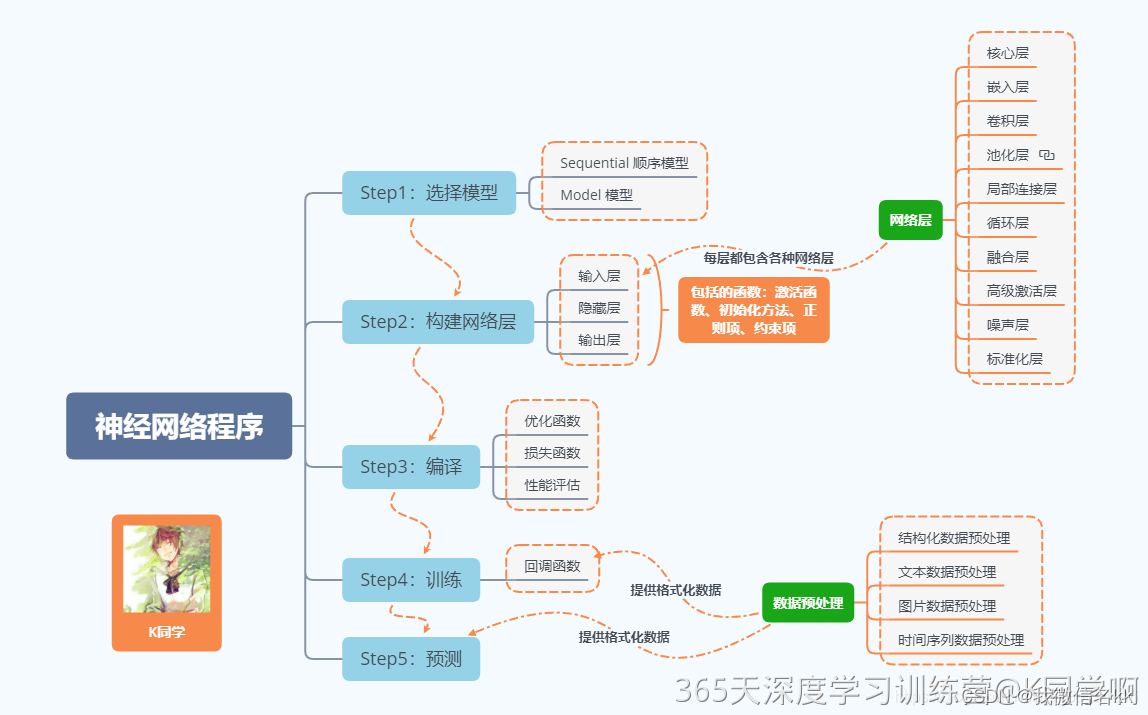

八、知识点详解和总结

1. 数据集介绍

CIFAR-10是一个广泛使用的彩色图像数据集,特别适合于机器学习和计算机视觉研究,尤其是在卷积神经网络的训练和评估中。它包含60,000张32x32像素的彩色图像,分为10个类别,每个类别包含6,000张图像,其中5,000张用于训练,1,000张用于测试。这些类别包括飞机、汽车、鸟类、猫、鹿、狗、蛙、马、船和卡车。图像数据是RGB三通道的,每个通道的像素值范围是0到255。CIFAR-10数据集常用于图像分类任务,是评估深度学习模型性能的标准基准之一。由于图像尺寸较小,分类任务可能面临挑战,尤其是在区分相似类别的图像时。数据集中的图像具有多样性,包括不同的背景、光照条件和角度。在TensorFlow中,可以通过`tensorflow.keras.datasets.cifar10.load_data()`函数轻松下载和加载CIFAR-10数据集,加载后得到的变量包括训练集图像`train_images`、训练集标签`train_labels`、测试集图像`test_images`和测试集标签`test_labels`,它们的形状分别是(50,000, 32, 32, 3)、(50,000,)、(10,000, 32, 32, 3)和(10,000,)。本次数据集直接加载的,速度比较慢。

2. 神经网络程序说明

数据集--选择网络模型--构建网络--编译-训练--预测--可视化得出结果

3.模型结构说明

本模型是一个顺序模型(Sequential model),由多个层次的卷积层、池化层、Flatten层和全连接层组成。3个卷积层两个池化层模型以一个具有32个过滤器的卷积层开始,其卷积核大小为3x3,激活函数为ReLU,输入图像的尺寸为32x32x3。接着是一个2x2的池化层,用于降低特征图的空间尺寸。模型继续使用另一个具有64个过滤器的卷积层,同样使用3x3的卷积核和ReLU激活函数,然后再次使用2x2的池化层。第三层卷积层与第二层相同,也是64个过滤器和3x3的卷积核,但不再跟随着池化层。之后,模型使用Flatten层将多维的特征图展平为一维向量,以便输入到全连接层。第一个全连接层有64个神经元,也使用ReLU激活函数。最后,模型以一个具有10个神经元的全连接层作为输出层,对应于CIFAR-10数据集中的10个类别。通过`model.summary()`函数,我们可以打印出模型的详细结构,包括每层的输出形状和参数数量。

4.编译

本模型使用Adam优化器进行训练,该优化器能够自适应地调整学习率以加快收敛速度。损失函数采用SparseCategoricalCrossentropy,SparseCategoricalCrossentropy是用于多分类问题的损失函数,当标签为整数时使用,且设置from_logits=True,意味着模型的输出层将输出未经softmax处理的原始logits,由损失函数内部负责应用softmax。评估模型时,我们关注的主要指标是准确率,即正确预测的样本数占总样本数的比例。通过编译模型,我们为模型的训练和评估阶段设定了优化算法、损失函数和评估指标。便于之后的训练。

编译模型是设置模型训练配置的重要步骤,它告诉模型如何进行优化、如何计算损失以及如何评估性能。一旦模型被编译,就可以使用model.fit()方法来训练模型,使用model.evaluate()方法来评估模型。