文章目录

- 引言

- 第一章 集成学习的基本概念

- 1.1 什么是集成学习

- 1.2 集成学习的类型

- 1.3 集成学习的优势

- 第二章 集成学习的核心算法

- 2.1 Bagging方法

- 2.2 Boosting方法

- 2.3 Stacking方法

- 第三章 集成学习的应用实例

- 3.1 图像分类

- 3.2 文本分类

- 第四章 集成学习的未来发展与挑战

- 4.1 模型多样性与集成策略

- 4.2 大规模数据与计算资源

- 4.3 集成学习的解释性与可视化

- 结论

引言

集成学习(Ensemble Learning)是机器学习中的一类方法,通过结合多个基学习器(base learners)的预测结果来提升整体模型的性能。相比于单一模型,集成学习方法具有更高的准确性和稳定性,在分类、回归以及其他复杂任务中展现出了显著优势。本文将深入探讨集成学习的基本原理、常见算法及其在实际中的应用,并提供代码示例和图表以帮助读者更好地理解和掌握这一技术。

第一章 集成学习的基本概念

1.1 什么是集成学习

集成学习是一种通过构建并结合多个学习器来完成学习任务的方法。其核心思想是将多个弱学习器(weak learners)组合成一个强学习器(strong learner),从而提升整体模型的泛化能力和预测准确率。

1.2 集成学习的类型

集成学习主要包括以下几种类型:

- Bagging(Bootstrap Aggregating):通过对数据集进行有放回的随机采样,生成多个子数据集,训练多个基学习器,并对结果进行平均或投票。

- Boosting:通过顺序训练多个基学习器,每个基学习器关注被前一个学习器错误分类的样本,最终将多个基学习器的结果进行加权组合。

- Stacking(Stacked Generalization):通过训练多个基学习器,并使用一个元学习器(meta-learner)来组合这些基学习器的预测结果。

1.3 集成学习的优势

- 提高准确性:通过组合多个模型的预测结果,可以有效减少单个模型的偏差和方差,从而提高预测准确性。

- 提高鲁棒性:集成学习模型在处理噪声和异常值时表现更加稳定。

- 提高泛化能力:通过不同基学习器的组合,集成学习模型具有更好的泛化能力,能够更好地应对未见数据。

第二章 集成学习的核心算法

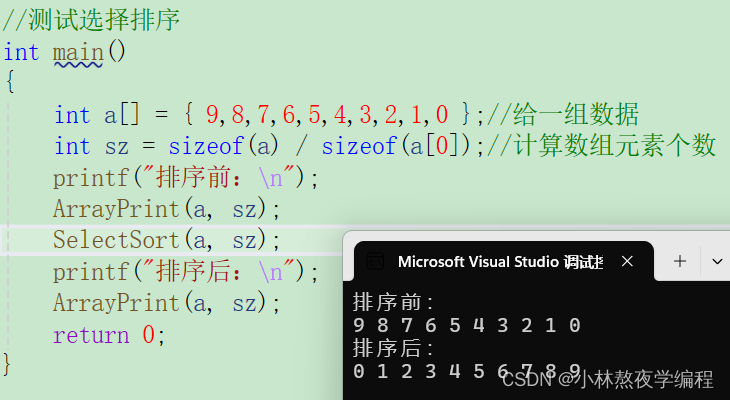

2.1 Bagging方法

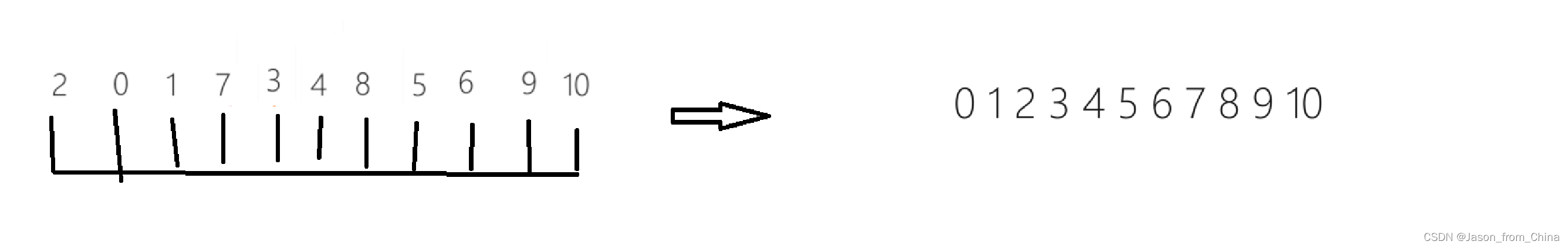

Bagging(Bootstrap Aggregating)是一种并行集成学习方法,通过对原始数据集进行多次有放回的随机采样,生成多个子数据集,并在每个子数据集上训练一个基学习器,最终将这些基学习器的预测结果进行平均或投票。

最著名的Bagging方法之一是随机森林(Random Forest),它通过在决策树的基础上进行Bagging,并在构建每棵决策树时随机选择部分特征,进一步提高模型的多样性和稳定性。

import numpy as np

import matplotlib.pyplot as plt

from sklearn.datasets import load_iris

from sklearn.ensemble import RandomForestClassifier

from sklearn.model_selection import train_test_split

from sklearn.metrics import accuracy_score

# 加载数据集

iris = load_iris()

X = iris.data

y = iris.target

# 划分数据集

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.3, random_state=42)

# 训练随机森林模型

model = RandomForestClassifier(n_estimators=100, random_state=42)

model.fit(X_train, y_train)

# 预测并评估模型

y_pred = model.predict(X_test)

accuracy = accuracy_score(y_test, y_pred)

print(f'模型准确率: {accuracy}')

# 可视化特征重要性

importances = model.feature_importances_

indices = np.argsort(importances)

plt.figure()

plt.title('Feature Importances')

plt.barh(range(X.shape[1]), importances[indices], color='b', align='center')

plt.yticks(range(X.shape[1]), iris.feature_names)

plt.xlabel('Relative Importance')

plt.show()

2.2 Boosting方法

Boosting是一种序列集成学习方法,通过顺序训练多个基学习器,每个基学习器关注被前一个学习器错误分类的样本,最终将多个基学习器的结果进行加权组合。常见的Boosting算法包括AdaBoost、Gradient Boosting和XGBoost。

from sklearn.ensemble import AdaBoostClassifier

from sklearn.tree import DecisionTreeClassifier

# 训练AdaBoost模型

base_estimator = DecisionTreeClassifier(max_depth=1, random_state=42)

model = AdaBoostClassifier(base_estimator=base_estimator, n_estimators=100, random_state=42)

model.fit(X_train, y_train)

# 预测并评估模型

y_pred = model.predict(X_test)

accuracy = accuracy_score(y_test, y_pred)

print(f'模型准确率: {accuracy}')

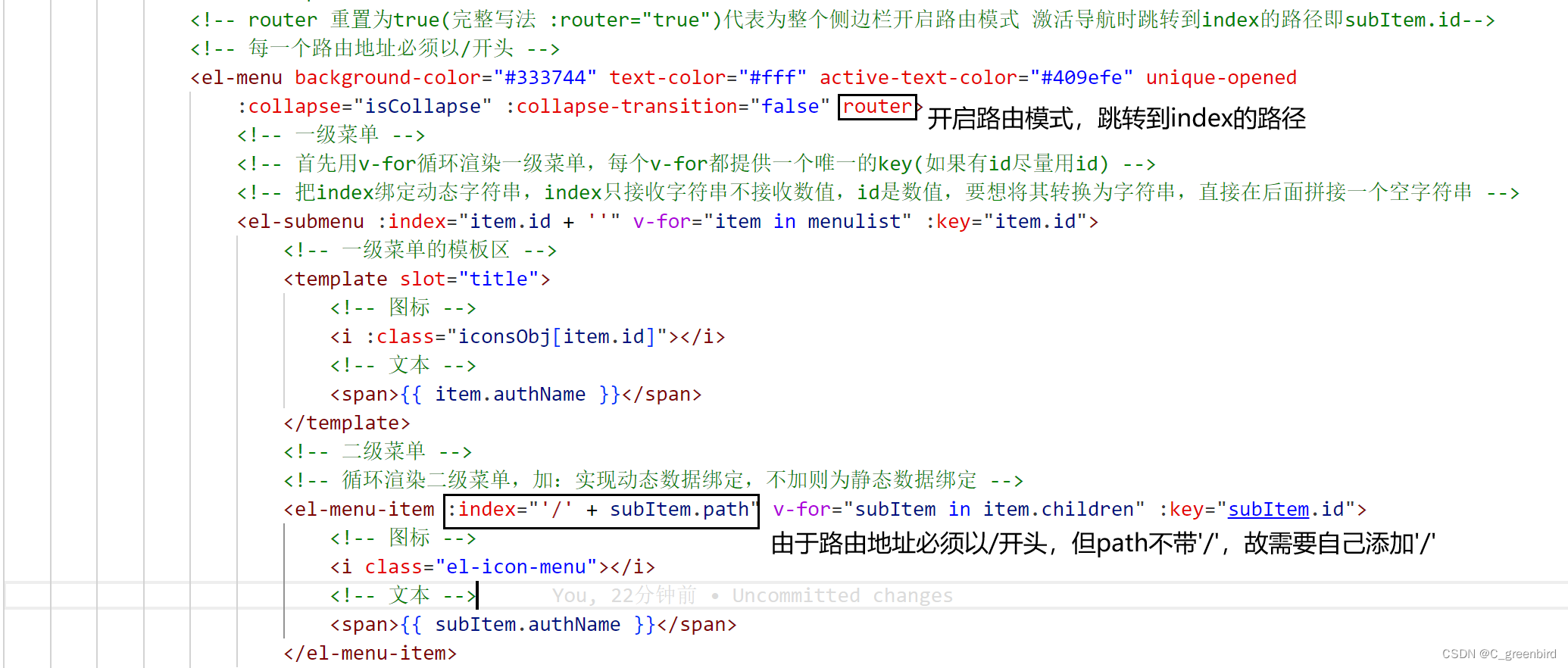

2.3 Stacking方法

Stacking(Stacked Generalization)是一种分层集成学习方法,通过训练多个基学习器,并使用一个元学习器(meta-learner)来组合这些基学习器的预测结果。Stacking能够充分利用不同学习器的优势,从而提高模型的预测性能。

from sklearn.linear_model import LogisticRegression

from sklearn.ensemble import StackingClassifier

# 定义基学习器

base_learners = [

('rf', RandomForestClassifier(n_estimators=100, random_state=42)),

('ada', AdaBoostClassifier(base_estimator=base_estimator, n_estimators=100, random_state=42))

]

# 定义元学习器

meta_learner = LogisticRegression()

# 训练Stacking模型

model = StackingClassifier(estimators=base_learners, final_estimator=meta_learner)

model.fit(X_train, y_train)

# 预测并评估模型

y_pred = model.predict(X_test)

accuracy = accuracy_score(y_test, y_pred)

print(f'模型准确率: {accuracy}')

第三章 集成学习的应用实例

3.1 图像分类

在图像分类任务中,集成学习方法通过组合多个卷积神经网络(CNN)的预测结果,显著提高了分类性能。以下是一个在CIFAR-10数据集上使用集成学习进行图像分类的示例。

import tensorflow as tf

from tensorflow.keras.datasets import cifar10

from tensorflow.keras.models import Sequential

from tensorflow.keras.layers import Conv2D, MaxPooling2D, Flatten, Dense

from tensorflow.keras.utils import to_categorical

# 加载数据集

(x_train, y_train), (x_test, y_test) = cifar10.load_data()

x_train, x_test = x_train / 255.0, x_test / 255.0

y_train, y_test = to_categorical(y_train), to_categorical(y_test)

# 定义CNN模型

def create_model():

model = Sequential([

Conv2D(32, (3, 3), activation='relu', input_shape=(32, 32, 3)),

MaxPooling2D((2, 2)),

Conv2D(64, (3, 3), activation='relu'),

MaxPooling2D((2, 2)),

Flatten(),

Dense(64, activation='relu'),

Dense(10, activation='softmax')

])

model.compile(optimizer='adam', loss='categorical_crossentropy', metrics=['accuracy'])

return model

# 训练多个CNN模型

models = [create_model() for _ in range(3)]

for model in models:

model.fit(x_train, y_train, epochs=10, validation_data=(x_test, y_test), verbose=2)

# 集成多个模型的预测结果

def ensemble_predict(models, x):

predictions = [model.predict(x) for model in models]

return np.mean(predictions, axis=0)

# 评估集成模型

y_pred = ensemble_predict(models, x_test)

accuracy = np.mean(np.argmax(y_pred, axis=1) == np.argmax(y_test, axis=1))

print(f'集成模型准确率: {accuracy}')

3.2 文本分类

在文本分类任务中,集成学习方法通过组合多个自然语言处理模型(如LSTM、Transformer等)的预测结果,提升了分类效果。以下是一个在IMDB情感分析数据集上使用集成学习进行文本分类的示例。

from tensorflow.keras.preprocessing.text import Tokenizer

from tensorflow.keras.preprocessing.sequence import pad_sequences

from tensorflow.keras.layers import Embedding, LSTM, Dense, Bidirectional

from tensorflow.keras.models import Sequential

# 加载数据集

(x_train, y_train), (x_test, y_test) = tf.keras.datasets.imdb.load_data(num_words=10000)

# 数据预处理

maxlen = 100

x_train = pad_sequences(x_train, maxlen=maxlen)

x_test = pad_sequences(x_test, maxlen=maxlen)

# 定义LSTM模型

def create_lstm_model():

model = Sequential([

Embedding(10000, 128, input_length=maxlen),

Bidirectional(LSTM(64)),

Dense(1, activation='sigmoid')

])

model.compile(optimizer='adam', loss='binary_crossentropy', metrics=['accuracy'])

return model

# 训练多个LSTM模型

lstm_models = [create_lstm_model() for _ in range(3)]

for model in lstm_models:

model.fit(x_train, y_train, epochs=5, validation_data=(x_test, y_test), verbose=2)

# 集成多个模型的预测结果

def ensemble_predict(models, x):

predictions = [model.predict(x) for model in models]

return np.mean(predictions, axis=0)

# 评估集成模型

y_pred = ensemble_predict(lstm_models, x_test)

accuracy = np.mean((y_pred > 0.5).astype(int) == y_test)

print(f'集成模型准确率: {accuracy}')

第四章 集成学习的未来发展与挑战

4.1 模型多样性与集成策略

集成学习的效果在很大程度上取决于基学习器的多样性。研究如何构建和选择具有高多样性的基学习器,以及如何设计更有效的集成策略,是未来集成学习发展的重要方向。

4.2 大规模数据与计算资源

随着数据规模的不断扩大,集成学习面临着更高的计算资源需求。研究如何在大规模数据和分布式计算环境下高效地训练和部署集成学习模型,是一个重要的研究课题。

4.3 集成学习的解释性与可视化

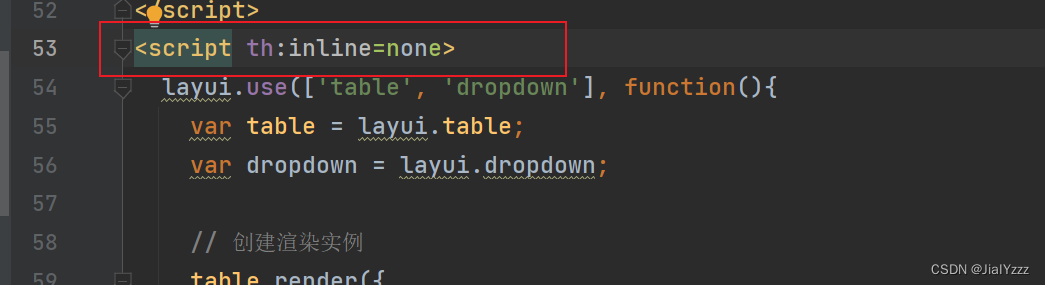

集成学习模型通常比单一模型更复杂,解释其决策过程变得更加困难。研究如何提高集成学习模型的解释性,并开发有效的可视化工具,以帮助理解和解释集成模型的行为,是一个值得探索的方向。

结论

集成学习作为一种强大的机器学习方法,通过组合多个基学习器的预测结果,显著提升了模型的准确性和稳定性。本文详细介绍了集成学习的基本概念、常见算法及其在实际中的应用,并提供了具体的代码示例和图表,帮助读者深入理解和掌握这一技术。希望本文能够为您进一步探索和应用集成学习提供有价值的参考。