高并发挑战?试试这些垂直优化技巧,让你的系统焕发新生!

- 背景介绍

- 性能优化

- 优化方向

- 架构演进历程

- 第一阶段:单体架构

- 弊端

- 瓶颈

- Tomcat与数据库独立部署

- 瓶颈

- 第二阶段:缓存架构

- 结合本地缓存和分布式缓存

- 瓶颈

- 第三阶段:反向代理实现负载均衡

- 通过DNS轮询实现机房间的负载均衡

- DNS轮询的工作原理

- 缺点和弊端

- 使用LVS或F5/A10来使多个Nginx负载均衡

- 瓶颈:反向代理的利与弊

- 第四阶段:数据库读写分离架构

- 瓶颈

- 第五阶段:数据库按业务分库

- 瓶颈

- 第六阶段:大应用拆分为小应用

- 瓶颈

- 总结归纳

背景介绍

随着业务的不断扩展,高并发问题成为了一个必须面对的挑战。为了应对这一挑战,我们可以从多个方面入手进行优化。我们可以考虑使用负载均衡技术。负载均衡可以将请求分发到多个服务器上,从而分散单个服务器的压力。这样不仅可以提高系统的并发处理能力,还能提高系统的可用性和稳定性。

性能优化

性能优化是一个综合性的过程,涵盖了从整体到细节的多个层面。在整体层面,负载均衡是关键,它能有效地分散请求,保证各节点的负载均衡,从而提高整体性能。此外,中间件的异步化处理也是重要的一环,通过将部分操作异步化,可以减少等待时间,提高系统的响应速度。存储优化同样不可忽视,通过优化数据存储方式、使用高速存储设备等手段,可以显著提升数据读写性能。

优化方向

在追求高并发的征途上,性能无疑是基石中的基石。它不仅是高并发场景的核心支撑,更是一个涉及面极为广泛的领域,要求我们研发团队投入更多的精力去打磨。个人总结性能优化主要集中在以下这几个方面:

- 架构层面:

- 负载均衡:分散请求,确保各节点均衡负载。

- 中间件异步化:减少等待时间,提高系统响应速度。

- 存储优化:提升数据读写性能,如优化存储方式或使用高速设备。

- 可用性优化:

- 服务治理:统一服务标准,规范服务调用。

- 服务保护:确保服务在遇到问题时能够迅速恢复。

- 可靠性保障:通过容错、备份等机制提高系统稳定性。

水平扩展提升: - 分层架构:按功能和性能需求划分层次,便于扩展和管理。

- 弹性架构:能够自适应地调整资源,应对突发的高并发需求。

- 服务拆分:将大服务拆分为小服务,简化逻辑,提高扩展性。

接下来,我将为大家深入剖析并详细介绍我所总结的整体架构的发展与演进历程。在这个过程中,我们将一起探讨架构的演变轨迹,以及各个阶段的关键特性和创新点。希望能够为大家带来更清晰的认识和更深入的理解。

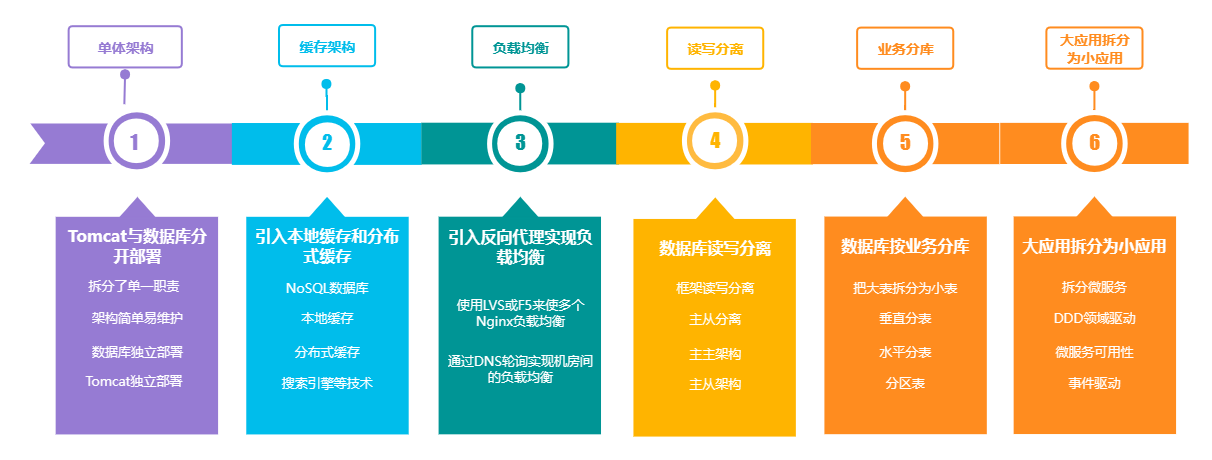

架构演进历程

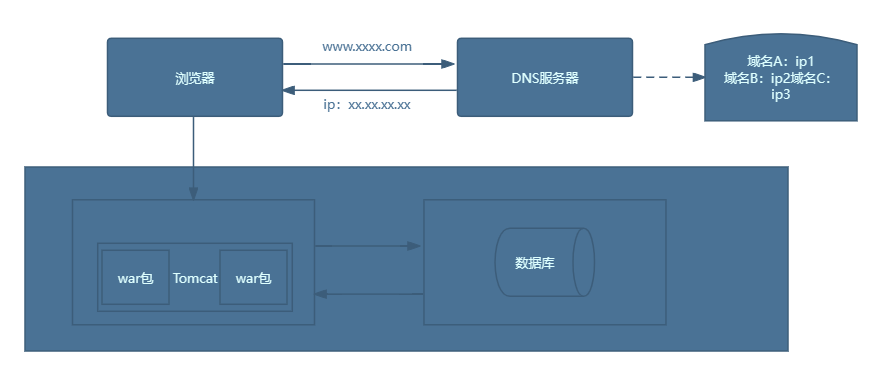

第一阶段:单体架构

互联网软件架构中的单机架构,是指将系统的所有代码和服务都部署在一台服务器上,整个项目的所有服务都由这台服务器提供。这种架构在系统的访问业务量较小时非常适用,因为它具有部署灵活、容易实现和方便管理的优点。开发者以及运维人员只需要关注这一台服务器即可。

弊端

单机架构也存在一些明显的弊端。首先,系统的可靠性不高,一旦这台服务器宕机,将会导致整个数据的丢失。其次,单机架构处理数据的能力有限,当业务增长到一定程度时,单机的资源将无法满足业务需求。此外,当数据出现快速增长时,会对服务器的处理能力造成巨大压力,这可能给生产环境以及数据安全带来很大的风险。

瓶颈

随着用户数量的不断增长,Tomcat与数据库之间的资源竞争逐渐凸显,导致单机的性能无法满足业务需求。这一瓶颈限制了系统的高效运行和业务的进一步发展。为了应对这一挑战,我们需要考虑分布式架构或云计算等解决方案,以实现资源的高效利用和系统的可扩展性。通过Tomcat与数据库分开部署,我们可以突破这一瓶颈,为业务提供更为稳定、可靠和高性能的支持。

Tomcat与数据库独立部署

瓶颈

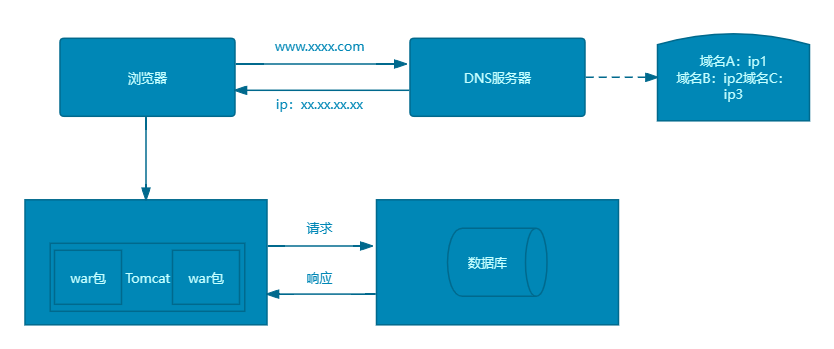

在用户规模不断扩大的情况下,数据库的并发读写能力成为了限制系统性能的关键因素。为了解决这一问题,我们可以采用缓存机制,利用诸如Redis、Memcached等缓存技术,将热点数据缓存起来,以减轻数据库的读写压力。这种做法可以有效提高数据库的并发读写能力,从而缓解系统性能受限的问题。

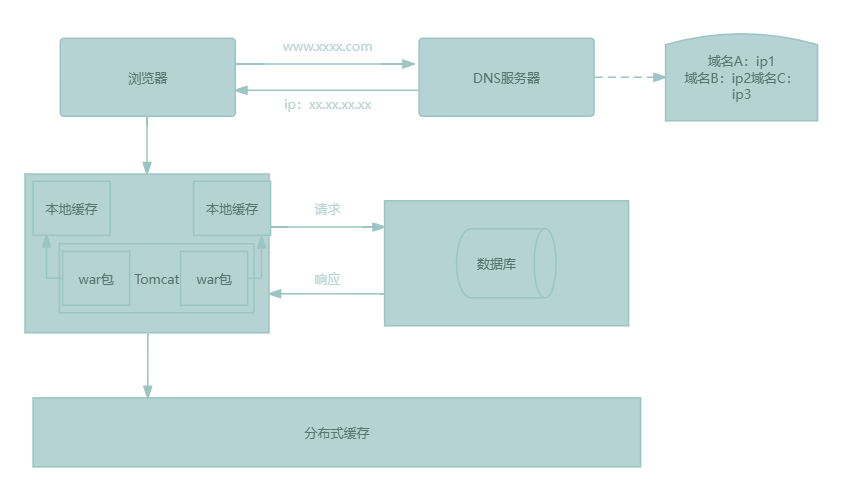

第二阶段:缓存架构

随着数据量和用户请求的不断增长,传统的单机架构逐渐暴露出性能瓶颈。为了提升系统的响应速度和处理能力,我们引入了本地缓存和分布式缓存技术。

- 本地缓存:在单机服务器上,能够迅速响应大部分的常见请求,减少了对后端数据库的访问压力。

- 分布式缓存:在网络中多个节点上存储和共享数据,实现了数据的横向扩展,大大提高了系统的并发能力。

结合本地缓存和分布式缓存

这种架构既保留了单机架构的简单性和可管理性,又通过缓存技术有效缓解了性能瓶颈。这种融合本地和分布式缓存的单机架构,为系统的持续发展和性能优化奠定了坚实的基础。

瓶颈

缓存系统成功地承受了绝大多数的访问请求,但随着用户数量的不断增长,单机Tomcat服务器开始面临越来越大的并发压力,其性能表现逐渐变得力不从心,难以应对日益增长的负载需求。这种压力使得Tomcat服务器的响应速度逐渐下降,甚至可能出现服务中断的情况,对整体系统的稳定性和可用性构成威胁。为了解决这一问题,我们需要考虑如何对系统进行优化和升级,以应对未来的挑战。

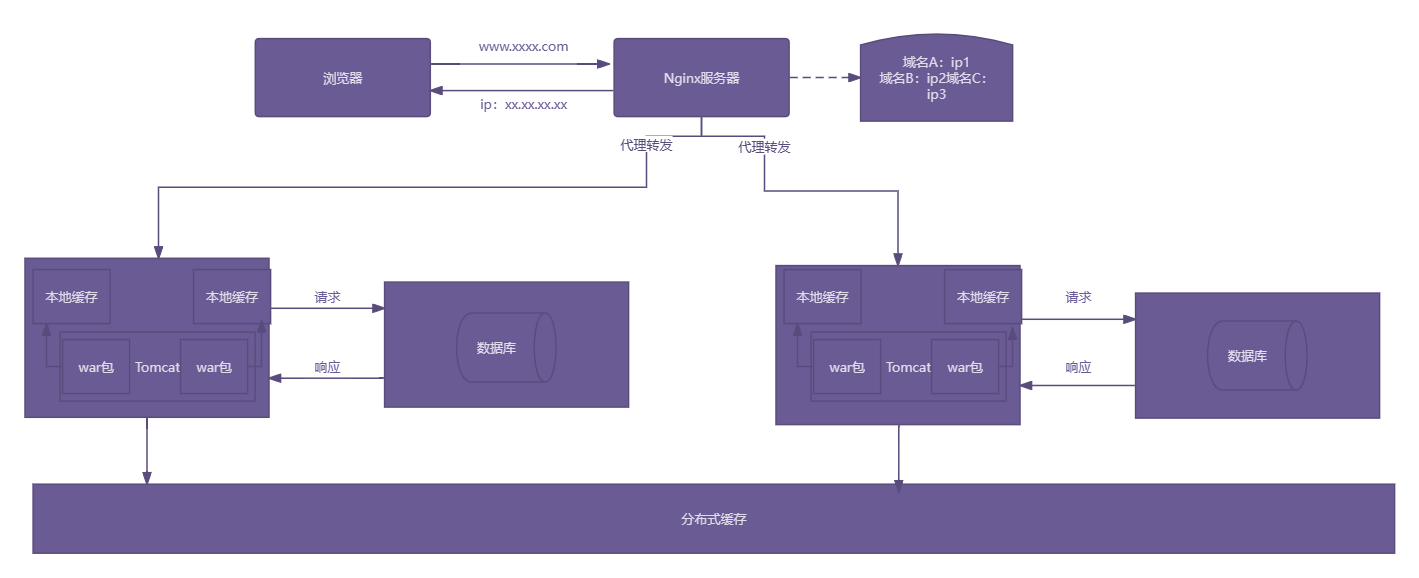

第三阶段:反向代理实现负载均衡

通过Nginx的反向代理的能力,接收客户端的请求,并将这些请求转发给内部Tomcat的Web服务器。客户端并不直接与目标服务器通信,通过反向代理与目标服务通信。反向代理隐藏了真实的服务器信息,提供了额外的安全性和负载均衡功能。 使用负载均衡技术,将数据库的读写请求均衡分配到多台服务器上,提高系统的整体性能和稳定性。

常见的实现方案,其实从上面的演进链路中也已经可以基本了解到各个方案适用的发展阶段和应对常见,这里再系统的总结下:

通过DNS轮询实现机房间的负载均衡

通过DNS轮询实现机房间的负载均衡是一种常见的方法,主要用于将客户端的请求分散到多个服务器或机房上,以提高系统的可用性和性能。以下是对这种方法的详细分析:

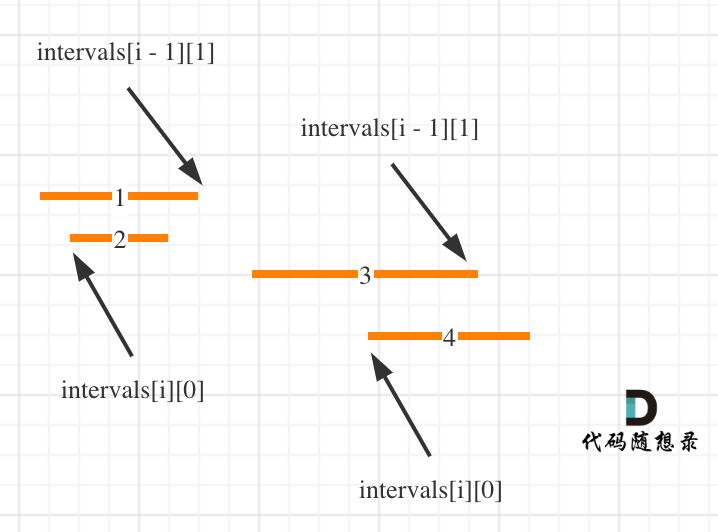

DNS轮询的工作原理

- 域名解析:当用户尝试访问一个域名时(例如

www.example.com),他们会向DNS服务器发送一个查询请求,以获取与该域名相关联的IP地址。 - 返回多个IP地址:如果DNS服务器配置为进行轮询,它会返回与该域名相关联的多个IP地址,而不是仅返回一个。这些IP地址通常代表位于不同服务器或机房上的服务。

- 客户端选择:客户端(如用户的浏览器)会从返回的IP地址列表中随机选择一个,并尝试与其建立连接。

- 负载均衡:由于DNS查询通常是由客户端发起的,因此这种方法能够在不同的服务器或机房之间实现负载均衡。客户端的每次新请求都有可能连接到不同的服务器,从而分散了流量。

缺点和弊端

- 不健康的服务器:如果某个服务器出现故障或性能下降,DNS轮询不会主动将其从轮询列表中移除,这可能导致客户端仍然尝试连接到不健康的服务器。

- 会话不连续性:由于每次新的DNS查询都可能返回不同的IP地址,这可能导致用户的会话在不同的服务器之间跳转,从而中断用户体验。

- 不适用于所有应用:DNS轮询对于需要持久连接或长时间会话的应用(如在线游戏或实时聊天应用)可能不太适合。

通过DNS轮询实现机房间的负载均衡是一种简单而有效的方法,适用于某些特定的场景和需求。

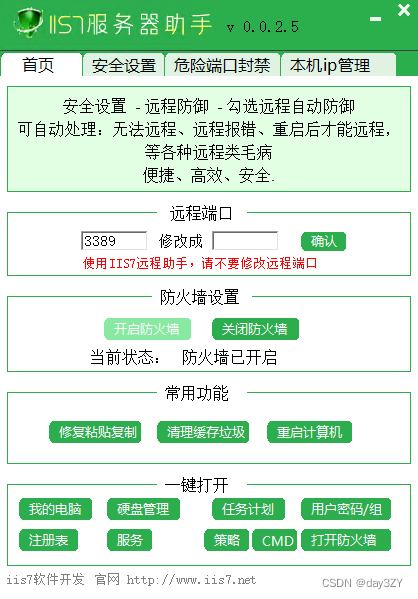

使用LVS或F5/A10来使多个Nginx负载均衡

对于需要更复杂负载均衡功能的应用,可能需要考虑使用硬件负载均衡器或软件负载均衡解决方案,例如:使用LVS或F5/A10来使多个Nginx负载均衡。如下图所示:

在这一背景下,我们面临两方面的挑战:一是如何有效应对LVS单机性能的限制,确保在高并发场景下依然能够提供稳定、高效的服务;二是如何优化网络架构,减少用户与服务器之间的距离带来的延迟,提升整体访问速度。

瓶颈:反向代理的利与弊

-

随着并发用户数的快速增长,尤其是当数量攀升至数十万级别时,LVS(Linux Virtual Server)作为单机解决方案,不可避免地会遭遇性能瓶颈。即便用户总数达到千万甚至亿级别,分布在不同地区,与服务器机房的距离各异,这种瓶颈效应会愈发显著,导致访问延迟明显不同,用户体验因此受到影响。

-

正如硬币有两面,这种增强的处理能力同时也带来了新的挑战。随着并发量的飙升,更多的请求像潮水般涌向数据库,使得原本稳定的单机数据库逐渐显露出其脆弱的一面,最终成为了整个系统性能的瓶颈。

反向代理虽然为应用服务器带来了强大的并发处理能力,但同时也增加了数据库的负载压力。

第四阶段:数据库读写分离架构

当第三阶段(反向代理实现负载均衡架构)所带来的数据库需要承受巨大的读写压力,其性能瓶颈逐渐凸显。为了满足不断增长的请求,可能需要考虑数据库的优化、读写分离、分库分表等策略来分散压力。

瓶颈

随着业务的不断增长,不同业务之间的访问量呈现出显著的差异,这导致不同业务之间存在直接的竞争和资源争夺,形成了明显的瓶颈。为了应对这一挑战,我们需要采取有效的措施来平衡资源分配,确保各个业务能够顺畅运行,同时提高整体业务效率。此外,还可以考虑引入负载均衡技术,将请求分发到多个数据库服务器,从而进一步提升系统的并发处理能力。

第五阶段:数据库按业务分库

为了更好地适应业务的发展和用户规模的扩张,我们必须认识到单机写库在面临大规模并发写入时可能遇到的性能限制。随着用户数据的不断积累,单机的写库处理能力将逐渐逼近其极限,这可能导致处理速度下降、响应时间延长甚至系统崩溃等问题。

为了确保系统的稳定性和可持续性,我们必须提前规划并采取相应的优化措施。这可能包括引入分布式数据库架构、增加缓存机制、优化写入策略等,以分散写库负载,提高整体性能。通过这些手段,我们可以有效地突破单机写库的瓶颈,确保系统能够持续、高效地为用户提供服务。

瓶颈

用户数量的持续增长会对单机写库带来极大的挑战,进而逐渐触及性能瓶颈。

第六阶段:大应用拆分为小应用

将大型应用拆分为多个小型应用是一种有效的策略,能够带来多方面的优势。通过拆分,我们可以将复杂的系统分解成更易于管理和维护的组成部分。每个小型应用都可以专注于特定的功能或业务领域,从而提高了代码的可读性和可重用性。

将大型应用拆分为多个小型应用是一种有效的策略,能够带来多方面的优势。通过拆分,我们可以将复杂的系统分解成更易于管理和维护的组成部分。每个小型应用都可以专注于特定的功能或业务领域,从而提高了代码的可读性和可重用性。

瓶颈

在软件开发中,不同应用之间经常存在共用的模块。如果这些模块由各个应用单独管理,那么相同的代码可能会在多个地方存在,这会导致维护和管理上的困难。尤其是当这些共用模块需要升级时,每个应用都需要进行相应的更新,这不仅增加了工作量,还可能引入错误和不一致性。

总结归纳

在系统的演进过程中,集群部署和负载均衡策略始终处于至关重要的地位。随着系统的不断扩展和优化,我们可以清晰地看到它们在整个演进链路上的关键作用:

-

当本地存储的性能瓶颈得到有效解决后,新的挑战出现在web容器的单体性能上。为了应对这一挑战,我们采用了nginx反向代理来实现多个web容器之间的负载均衡,确保系统在高并发场景下依然稳定、高效。

-

随着数据库和Tomcat的水平扩容,系统的并发处理能力得到了大幅提升。然而,此时单体nginx代理的性能成为了新的瓶颈。为了突破这一限制,我们引入了F5或LVS等高性能负载均衡设备,将多个nginx反向代理服务器进行负载均衡,进一步提升了系统的整体性能。

-

随着业务的持续发展,系统逐渐扩展至多个地区和机房。此时,垮地域访问延迟成为了新的瓶颈。为了优化用户体验和减少延迟,我们采用了DNS负载均衡策略,根据用户的地域信息智能选择最近的机房进行访问,从而实现了地域机房间的高效负载均衡。