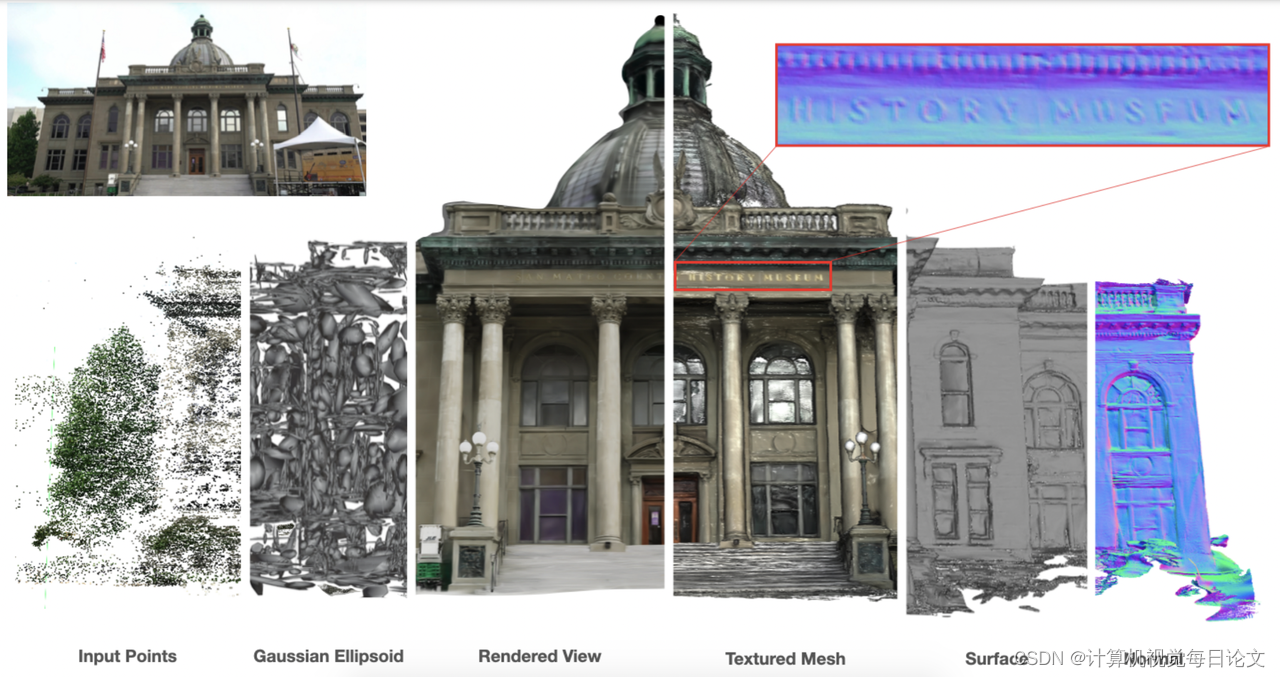

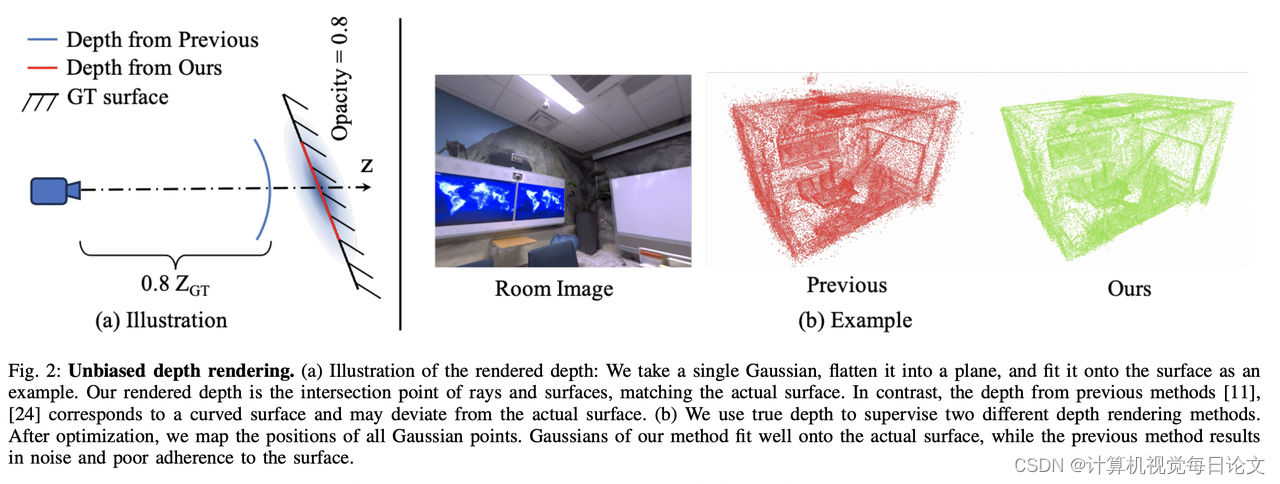

1、PGSR: Planar-based Gaussian Splatting for Efficient and High-Fidelity Surface Reconstruction

中文标题:PGSR:基于平面的高斯溅射,用于高效、高保真表面重建

简介:这项研究关注于3D高斯喷洒(3DGS)技术,该技术因其高质量渲染和超快的训练及渲染速度而备受关注。然而,由于高斯点云的非结构化和不规则性质,仅依靠图像重建损失很难保证几何重建精度和多视角一致性。

为解决这一问题,本文提出了一种称为快速基于平面的高斯喷洒重建表示(PGSR)的方法,实现高保真的表面重建和高质量渲染。

主要创新点如下:

1. 引入无偏深度渲染方法,直接从点云的高斯分布渲染深度和法线,避免了深度估计中的偏差。

2. 结合单视角几何、多视角光度和几何正则化,保留全局几何精度。

3. 提出相机曝光补偿模型,以应对光照变化较大的场景。

实验结果表明,该方法在快速训练和渲染的同时,保持了高保真的渲染和几何重建,优于基于3DGS和NeRF的方法。

总的来说,PGSR为3DGS技术提供了一种高效、高质量的表面重建解决方案,在保真度和渲染速度方面取得了显著进步,对于3D视觉应用具有重要意义。感兴趣的读者可以进一步了解该方法的详细技术细节。

2、Monkey See, Monkey Do: Harnessing Self-attention in Motion Diffusion for Zero-shot Motion Transfer

中文标题:Monkey See,Monkey Do:利用运动扩散中的自注意力实现零样本运动转移

简介:这篇文章探讨了如何有效利用预训练的扩散模型进行运动编辑的问题。

现有的基于扩散的运动编辑方法主要集中于处理运动空间,忽略了预训练模型权重中嵌入的先验潜在特征空间的巨大潜力。

本文提出了一种名为"Monkey See, Monkey Do"(MoMo)的新方法,通过仔细整合注意机制元素,实现零样本运动转移,即将领导者运动转移给跟随者运动,同时保持跟随者的微妙特征。

与之前的方法不同,MoMo利用运动反演,将编辑工作集中于真实和生成的运动,而不仅限于生成的运动。这在一定程度上解决了真实运动可编辑性受限的问题。

实验结果表明,MoMo优于当前的艺术水平,尤其是在无需进行特定应用程序训练的情况下,仍能在推断时应用于各种运动编辑任务,如合成分布之外的运动、风格转移和空间编辑等。、

总之,MoMo充分利用预训练扩散模型中的注意机制,开拓了运动编辑的新方向,为相关领域带来了积极影响。感兴趣的读者可以进一步了解其技术细节和应用前景。

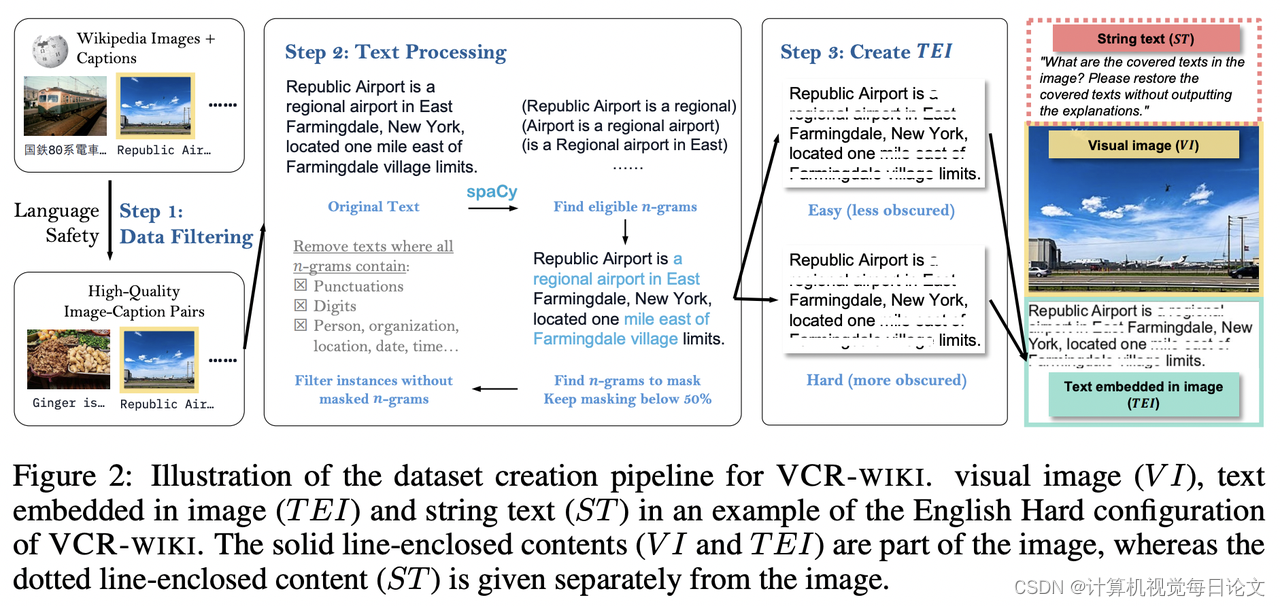

3、VCR: Visual Caption Restoration

中文标题:VCR:视觉字幕恢复

简介:这篇文章介绍了一项新的视觉-语言任务——"视觉字幕修复"(VCR)。

VCR任务要求模型使用图像中的像素级提示,准确地修复部分遮挡的文本。这个任务的关键在于需要对视觉、文本和嵌入图像中的文本这三种模态进行对齐,而这与常见的视觉元素和自然语言有本质的不同。

虽然之前的研究已经将嵌入图像中的文本整合到视觉问答任务中,但这些方法通常依赖于光学字符识别或掩码语言建模,主要转化为基于文本的处理。然而,在VCR任务中,基于文本的处理变得无效,因为需要综合利用图像、上下文以及微小暴露区域的微妙提示才能准确修复文本。

为了支持VCR任务的研究,作者开发了一个流程来生成合成图像,并使用维基百科的图像和字幕构建了一个名为VCR-Wiki的数据集,包括211万个英文和34.6万个中文实体,并分为易和难两个变体。

实验结果表明,当前的视觉语言模型在VCR任务中显著落后于人类表现,仅对模型在该数据集上进行微调也无法带来明显改进。

作者发布了VCR-Wiki数据集和数据构建代码,以促进未来针对这一新任务的研究。这有助于推动视觉-语言领域的发展,克服基于文本处理的局限性。