AI学习指南机器学习篇-核技巧与非线性支持向量机

在机器学习领域,核技巧(Kernel Trick)是一个非常重要的概念,它将线性支持向量机(SVM)扩展到非线性支持向量机,从而可以处理非线性的分类和回归问题。本文将深入探讨核技巧的概念,介绍如何使用核函数将线性支持向量机扩展到非线性支持向量机,并介绍常见的核函数,包括线性核、多项式核和高斯径向基函数(RBF)核。

核技巧的概念

在机器学习中,核技巧是一种用来处理非线性问题的技术。它通过将输入空间映射到一个高维特征空间,从而使得原本在低维空间中线性不可分的问题,在高维空间中变得线性可分。核技巧的基本思想是利用核函数来代替内积操作,从而避免显式的高维特征空间计算,大大节省了计算资源。常见的核函数包括线性核、多项式核和高斯径向基函数(RBF)核。

将线性支持向量机扩展到非线性支持向量机

线性支持向量机(SVM)在处理线性可分的分类问题时表现优异,但在处理非线性可分的问题时就显得力不从心。通过核技巧,可以将线性SVM扩展到非线性SVM,从而可以处理更加复杂的分类问题。核技巧的关键在于使用核函数来隐式地将数据映射到高维特征空间,从而将原本非线性可分的问题转化为线性可分的问题。通过最优化求解得到的超平面在高维特征空间中对应着非线性的决策边界,从而实现了非线性支持向量机的分类。

常见的核函数

线性核

线性核是最简单的核函数,它直接对输入特征进行线性内积操作。线性SVM就是使用线性核的支持向量机,在处理线性可分的问题时表现优异。线性核的数学表达式为: K ( x , y ) = x T y K(x, y) = x^T y K(x,y)=xTy。它通常适用于输入特征的维度较低,且数据线性可分的情况。

多项式核

多项式核通过计算输入特征的高阶多项式,从而将数据映射到更高维的特征空间。多项式核的数学表达式为: K ( x , y ) = ( x T y + c ) d K(x, y) = (x^T y + c)^d K(x,y)=(xTy+c)d。其中, d d d为多项式的阶数, c c c为常数项。多项式核适用于处理一般的非线性问题,但在高阶多项式的情况下容易导致过拟合。

高斯径向基函数(RBF)核

高斯径向基函数(RBF)核是非常常用的核函数之一,它通过将数据映射到无限维的特征空间,从而可以处理复杂的非线性问题。高斯RBF核的数学表达式为: K ( x , y ) = exp ( − ∣ ∣ x − y ∣ ∣ 2 2 σ 2 ) K(x, y) = \exp(-\frac{||x-y||^2}{2\sigma^2}) K(x,y)=exp(−2σ2∣∣x−y∣∣2)。其中, σ \sigma σ为高斯核的带宽参数,控制了数据映射到高维空间后的聚集程度。高斯RBF核适用于处理复杂的非线性问题,但需要注意调节带宽参数,以避免过拟合。

示例

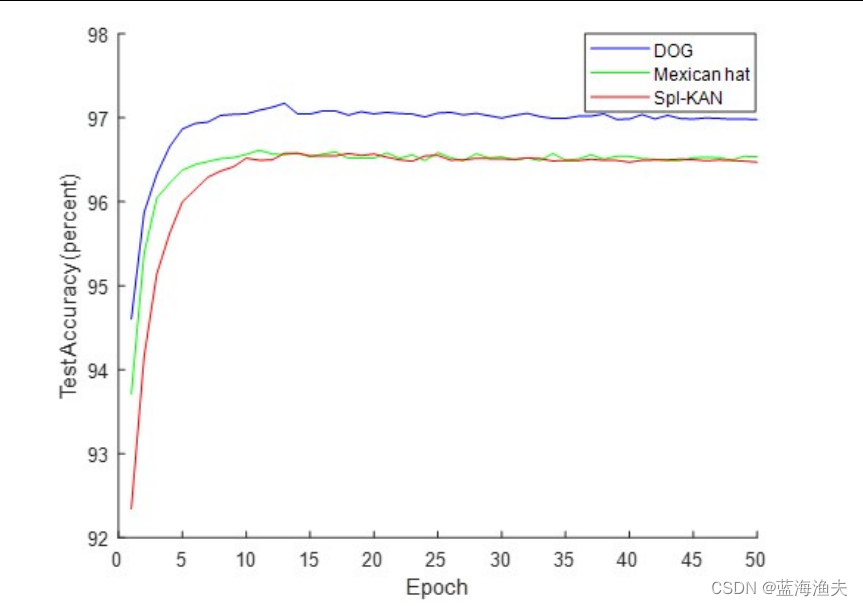

为了更好地理解核技巧和非线性支持向量机的应用,下面通过一个简单的示例来说明。假设我们有一个二维的数据集,其中包含两类数据,如下图所示:

显然,这个数据集在二维平面上是线性不可分的,无法通过一个直线来将两类数据完全分开。这时就可以使用非线性支持向量机来处理这个问题。首先,我们可以选择使用高斯RBF核作为核函数,将数据映射到更高维的特征空间。然后,我们可以通过最优化求解得到一个在高维特征空间中的超平面,从而实现了非线性的分类,如下图所示:

通过这个示例,我们可以看到如何使用核技巧将原本非线性不可分的问题转化为线性可分的问题,并通过非线性支持向量机实现了分类。

总结

本文深入探讨了核技巧的概念,介绍了如何使用核函数将线性支持向量机扩展到非线性支持向量机,并介绍了常见的核函数,包括线性核、多项式核和高斯径向基函数(RBF)核。通过详细的示例,我们可以更好地理解核技巧和非线性支持向量机的应用。在实际的机器学习任务中,选择合适的核函数对于模型的性能至关重要,需要根据具体的问题进行调试和优化。希望本文对您理解和应用核技巧有所帮助,欢迎交流讨论。