摘要

自动驾驶中多任务学习,特别是通过设计一种自适应、实时且轻量级的模型来同时处理目标检测、可行驶区域分割和车道线分割,是一种非常有用的研究方法,其中最出名的当属YOLOP模型。然后,YoloP在实时性上并没有得到满足,本文复现基于YoloV8的对任务方案,并在BDD100K数据集上验证和测试,给这方面研究的同学提供便利。BDD100k是一个大规模的自动驾驶数据集,包含了多种复杂的驾驶场景和天气条件。模型在该数据集上取得了具有竞争力的结果,证明了其在实际应用中的有效性。数据集以及完整的代码,在文末!

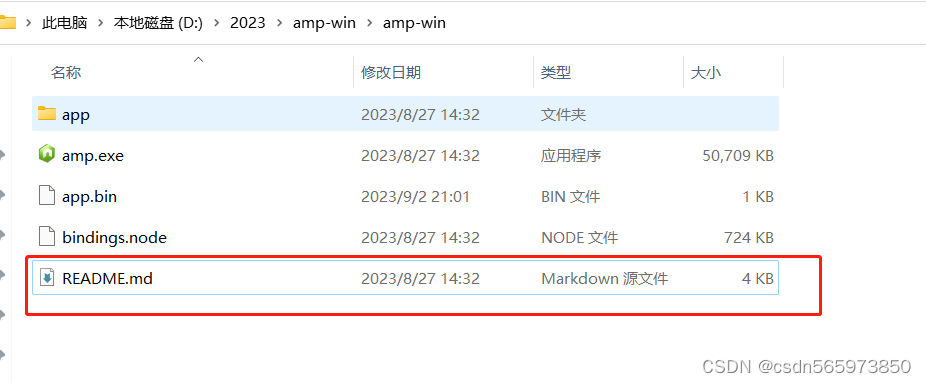

数据集以及下载

BDD100K是一个大型、多样化的自动驾驶数据集,旨在推动自动驾驶技术的研发与创新。它由加州大学伯克利分校的研究团队创建,提供了一个强大的平台,让开发者和研究人员能够利用丰富的图像和视频资源进行复杂的计算机视觉及自动驾驶任务的训练。

BDD100K数据集包含以下三个方面的内容:

- 图像数据:BDD100K有大约10万张拍摄于不同场景中的高分辨率图像。这些图像被分为训练集、验证集和测试集,每张图像都以JPEG格式存储,并以高质量的图像呈现。每张图像都配有详细的标注信息,包括各类物体的边界框、类型、遮挡情况、是否被截断等信息,以及车道线、交通灯、道路标志等其他重要信息。

- 视频数据:BDD100K数据集包含10万段高清视频,每个视频约40秒,分辨率为720p,帧率为30 fps。这些视频片段覆盖了全球多个城市、多种天气条件下的真实世界驾驶场