spark实战:实现分区内求最大值,分区间求和以及获取日志文件固定日期的请求路径

Apache Spark是一个广泛使用的开源大数据处理框架,以其快速、易用和灵活的特点而受到开发者的青睐。在本文中,我们将通过两个具体的编程任务来展示Spark的强大功能:首先是对一个简单的数据列表进行分区操作,并在每个分区内求最大值以及跨分区间求和;其次是从Apache日志文件中提取特定日期的请求路径。这两个任务将帮助你理解Spark在数据处理和日志分析方面的应用。

问题一:数据处理 - 分区内求最大值,分区间求和

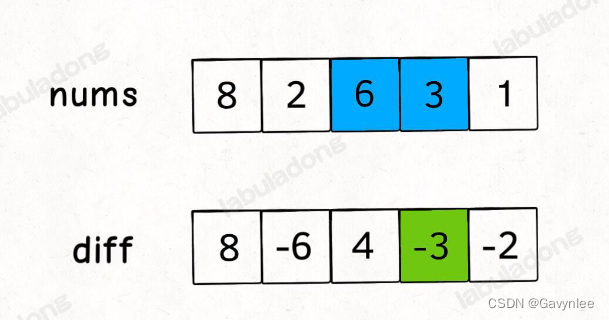

给定一个包含键值对的列表 List((“a”, 1),(“a”, 2), (“b”, 3), (“b”, 4),(“b”, 5),(“a”, 6)),任务是将这个列表分成两个分区,并在每个分区内找到最大值,同时计算所有分区间的总和。

解决方案

1、创建SparkSession:初始化Spark环境。

2、数据转换:将列表转换为RDD或DataFrame。

3、分区操作:将数据分成两个分区。

4、求最大值:在每个分区内使用reduce或aggregate操作求得最大值。

5、求总和:使用collect操作收集所有数据,然后求和。

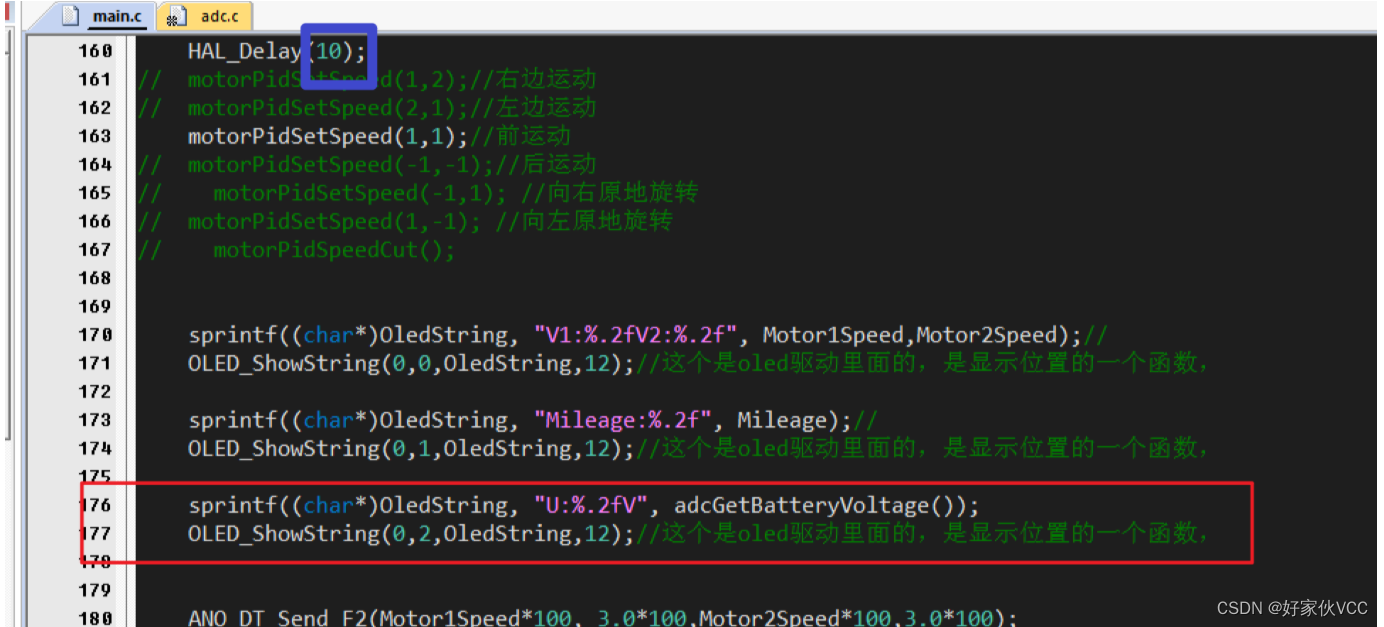

示例代码

import org.apache.spark.sql.SparkSession

import org.apache.spark.sql.functions._

object MaxAndSumExample {

def main(args: Array[String]): Unit = {

// 创建Spark会话

val spark = SparkSession.builder()

.appName("MaxAndSumExample")

.master("local[*]") // 使用本地模式,根据需要可以改为集群模式

.getOrCreate()

import spark.implicits._

// 给定的列表

val data = List(("a", 1), ("a", 2), ("b", 3), ("b", 4), ("b", 5), ("a", 6))

// 将列表转换为DataFrame

val df = data.toDF("key", "value")

// 设置分区数为2

val partitionedDF = df.repartition(2)

// 分区内求最大值

val maxPerPartition = partitionedDF.groupBy("key").agg(max($"value").alias("maxValue"))

// 分区间求和

val sumAcrossPartitions = df.groupBy("key").sum("value")

// 显示结果

maxPerPartition.show()

sumAcrossPartitions.show()

// 停止Spark会话

spark.stop()

}

}

问题二:日志分析 - 提取特定日期的请求路径

任务描述

从Apache日志文件中提取2015年5月17日的所有请求路径。

解决方案

1、日志文件读取:使用Spark读取日志文件。

2、日志解析:编写函数解析每行日志,提取日期和请求路径。

3、日期过滤:根据日期过滤日志行。

4、提取请求路径:从过滤后的日志中提取请求路径。

示例代码

import org.apache.spark.sql.SparkSession

import org.apache.spark.sql.functions._

object MaxAndSumExample {

def main(args: Array[String]): Unit = {

// 创建Spark会话

val spark = SparkSession.builder()

.appName("MaxAndSumExample")

.master("local[*]") // 使用本地模式,根据需要可以改为集群模式

.getOrCreate()

import spark.implicits._

// 给定的列表

val data = List(("a", 1), ("a", 2), ("b", 3), ("b", 4), ("b", 5), ("a", 6))

// 将列表转换为DataFrame

val df = data.toDF("key", "value")

// 设置分区数为2

val partitionedDF = df.repartition(2)

// 分区内求最大值

val maxPerPartition = partitionedDF.groupBy("key").agg(max($"value").alias("maxValue"))

// 分区间求和

val sumAcrossPartitions = df.groupBy("key").sum("value")

// 显示结果

maxPerPartition.show()

sumAcrossPartitions.show()

// 停止Spark会话

spark.stop()

}

}

结论

通过这两个示例,我们可以看到Apache Spark在处理数据列表和分析日志文件方面的强大能力。第一个示例展示了如何在Spark中进行基本的数据转换、分区操作和聚合操作。第二个示例则展示了如何读取和解析日志文件,以及如何根据特定条件过滤数据。这些技能在处理大数据时非常有用,可以帮助我们快速获得所需的信息。

如有遇到问题可以找小编沟通交流哦。另外小编帮忙辅导大课作业,学生毕设等。不限于MapReduce, MySQL, python,java,大数据,模型训练等。 hadoop hdfs yarn spark Django flask flink kafka flume datax sqoop seatunnel echart可视化 机器学习等