本篇的思维导图:

神经网络可调超参数:激活函数

神经网络中的激活函数(有时也叫激励函数)。

在逻辑回归中,输入的特征通过加权、求和后,还将通过一个Sigmoid逻辑函数将线性回归值压缩至[0,1]区间,以体现分类概率值。这个逻辑函数在神经网络中被称为激活函数(这个名词应该是来自生物的神经系统中神经元被激活的过程)。在神经网络中,不仅最后的分类输出层需要激活函数,而且每一层都需要进行激活,然后向下一层输入被激活之后的值。不过神经网络中间层的输出值,没有必要位于[0,1]区间,因为中间层只负责非线性激活,并不负责输出分类概率和预测结果。

那么,为什么每一层都要进行激活呢?其原因在于,如果没有激活函数,每一层的输出都是上层输入的线性变换结果&

【阶段四】Python深度学习03篇:深度学习基础知识:神经网络可调超参数:激活函数、损失函数与评估指标

news2026/2/16 11:28:51

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如若转载,请注明出处:http://www.coloradmin.cn/o/165994.html

如若内容造成侵权/违法违规/事实不符,请联系多彩编程网进行投诉反馈,一经查实,立即删除!相关文章

PyCharm调用远程Python解释器

PyCharm调用远程Python解释器

PyCharm中直接调用远程服务器中Python解释器:

本地不用搭建Python环境。既避免了本地使用Window而服务器使用Linux系统不统一情况,又不用担心本地调试没问题而放到服务器上就出现问题。 PyCharm中打开项目并设置Python解释…

封装chrome镜像

chrome镜像

selenium提供了一个镜像,但这个镜像里面包含了比较多的东西:

镜像地址-github supervisord java chrome webDriver

实际的使用中遇到了一些问题

chrome遇到一些比较耗费内存和cup的操作的时候,有的时候会kill掉java进程&a…

干货 | 大数据交易所数据安全流通体系标准化尝试

以下内容整理自清华大学《数智安全与标准化》课程大作业期末报告同学的汇报内容。第一部分:国内大数据交易所发展现状第二部分:国外大数据交易模式及法律法规欧盟的数据交易模式是基于2022年5月16日所提出的《数据治理法案》,其中提出了数据中…

【C++11】—— 包装器

目录

一、function包装器

1. function包装器基本介绍

2. function包装器统一类型

3. function包装器的使用场景

二、bind包装器 一、function包装器

1. function包装器基本介绍 function包装器 也叫作适配器。C中的function本质是一个类模板,也是一个包装器…

聚观早报|春节档新片预售总票房破千万;苹果获可折叠iPhone新专利

今日要闻:比亚迪据称拟在越南建汽车零部件厂;2023 年春节档新片预售总票房破 7000 万;苹果获得可折叠 iPhone 新专利;北京汽车获1000台EU5 PLUS约旦订单;娃哈哈要解决100万农户农产品出路

比亚迪据称拟在越南建汽车零部…

【数据结构】双向链表

1.双向链表的结构2.双向链表的实现首先在VS里面的源文件建立test.c和List.c,在头文件里面建立List.hList.h:#pragma once

#include <stdio.h>

#include <stdlib.h>

#include <assert.h>

typedef int LTDateType;

typedef struct ListNode

{LTDateType data;s…

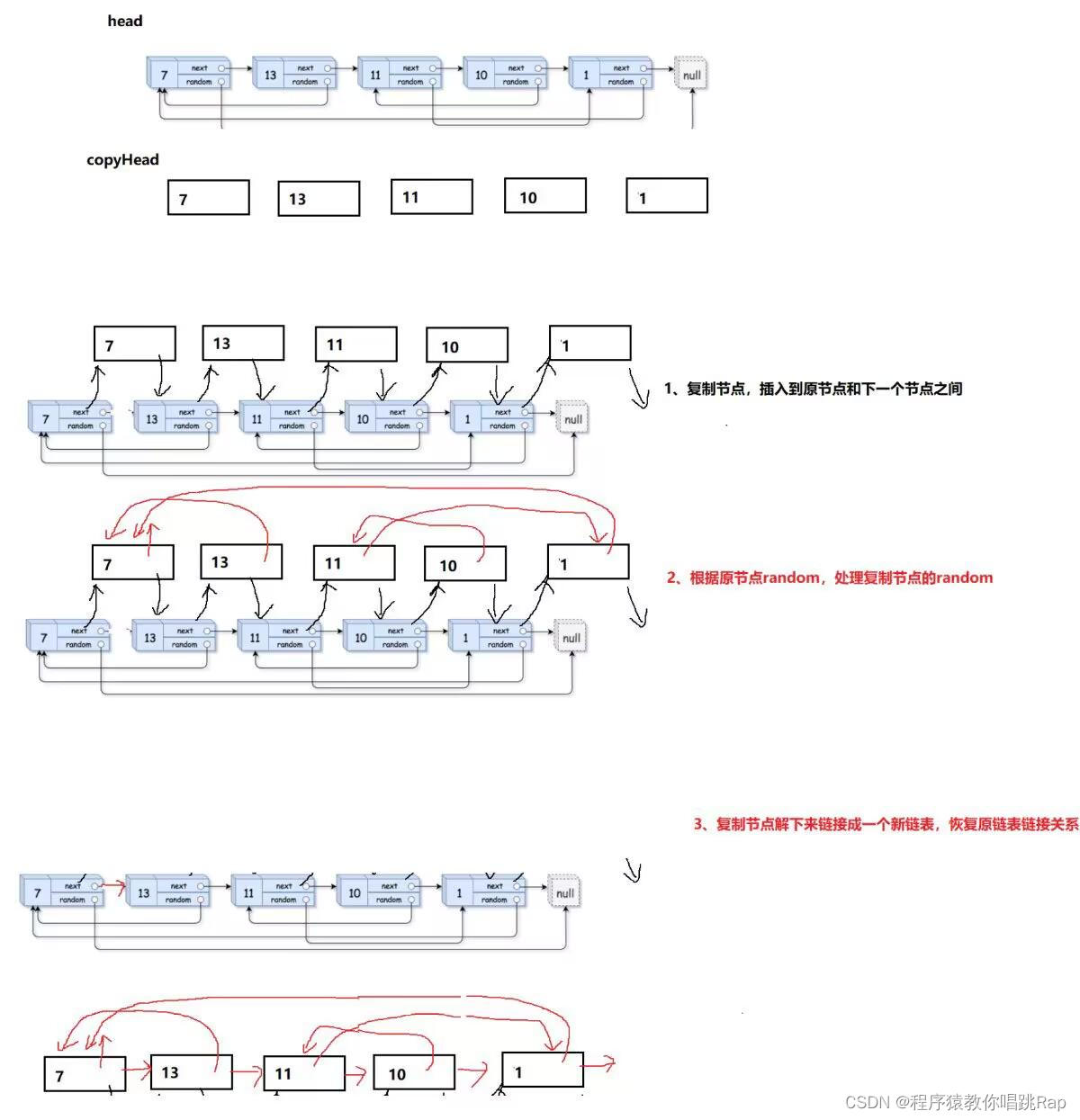

LeetCode 329. 矩阵中的最长递增路径(C++)*

思路: 1.用动态规划,但是时间复杂度太高,效率太低 2.使用常规的DFS,时间复杂度高,包含了太多重复无效遍历,会超时 3.在DFS的基础上使用记忆化搜索,帮助消去重复的遍历,提高效率 原题…

解决: 您目前无法访问 因为此网站使用了 HSTS。网络错误和攻击通常是暂时的,因此,此网页稍后可能会恢复正常

目录

问题描述

报错信息

问题原因

如何解决

参考资料 问题描述

您目前无法访问 因为此网站使用了 HSTS。网络错误和攻击通常是暂时的,因此,此网页稍后可能会恢复正常。

报错信息

今天使用Edge浏览器在访问一个平时常用的emoji网站时,…

springboot整合spring-security

在web开发中,安全性问题比较重要,一般会使用过滤器或者拦截器的方式对权限等进行验证过滤。此博客根据b站up主,使用demo示例进行展示spring-security的一些功能作用。

目 录

1、创建项目

2、编写controller

3、添加spring-security依赖 …

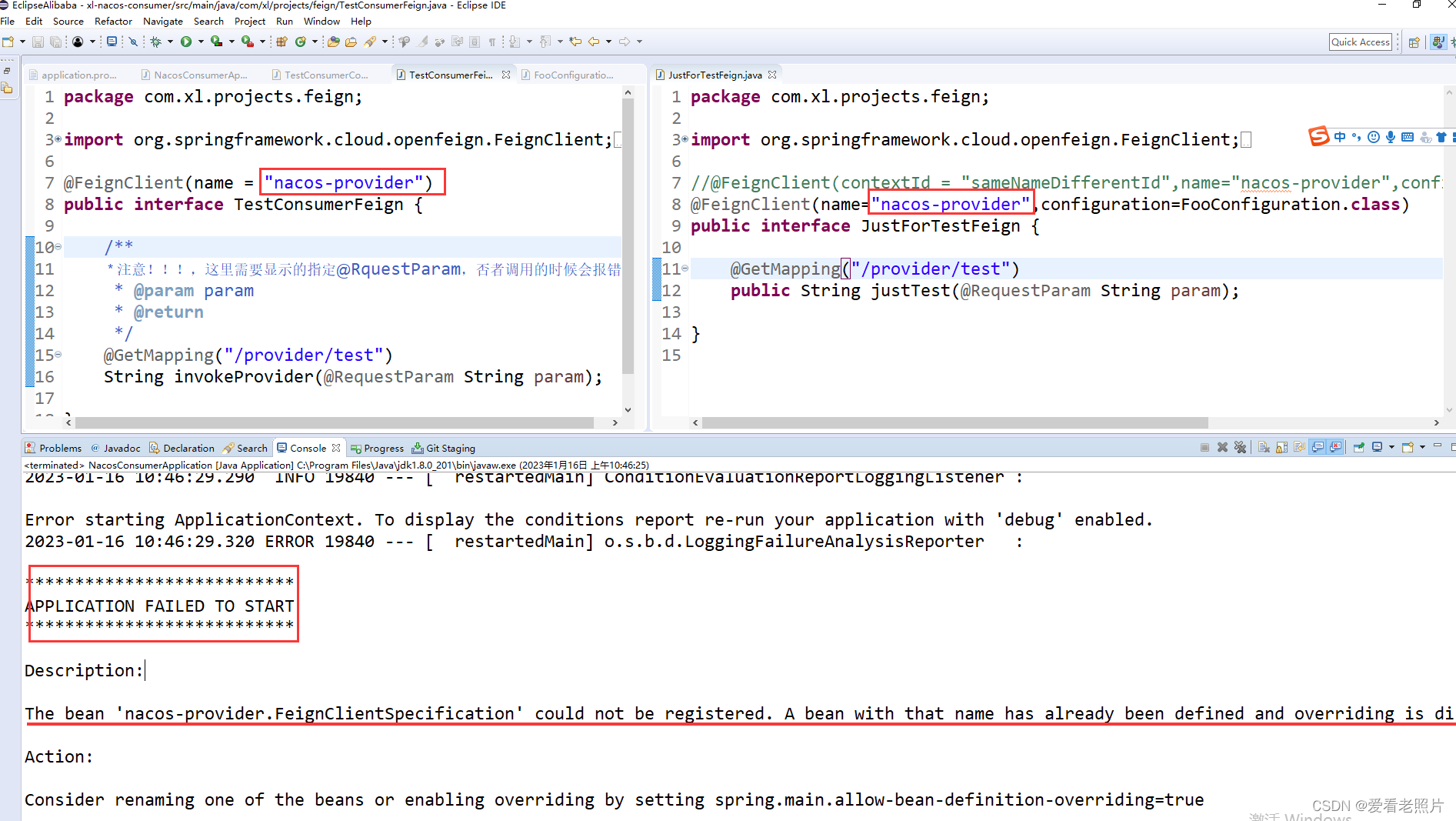

Spring Cloud OpenFeign 配置

最少的配置(使用默认配置)

最少/默认配置示例如下(使用Nacos作为服务的注册与发现中心):

application.properties

server.port8082

spring.application.namenacos-consumer

spring.cloud.nacos.discovery.server-ad…

[拆轮子] PaddleDetection中__shared__、__inject__ 和 from_config 三者分别做了什么

在上一篇中,PaddleDetection Register装饰器到底做了什么 https://blog.csdn.net/HaoZiHuang/article/details/128668393

已经介绍了 __shared__ 和 __inject__ 的作用:

__inject__ 表示引入全局字典中已经封装好的模块。如loss等。__shared__为了实现一些参数的配…

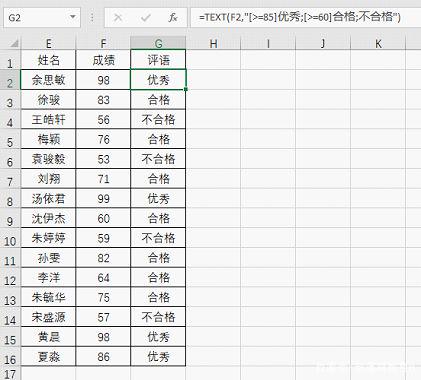

excel函数技巧:函数TEXT七助数据大变身

如果函数有职业,那各函数的职业会是什么呢?别的先不说,就拿TEXT而言,它可以让日期变数字、数字变日期、阿拉伯数字变大写中文数字、金额元变万元,连IF的条件判断它也可以变出来…这简直就是当之无愧的变装女皇啊&#…

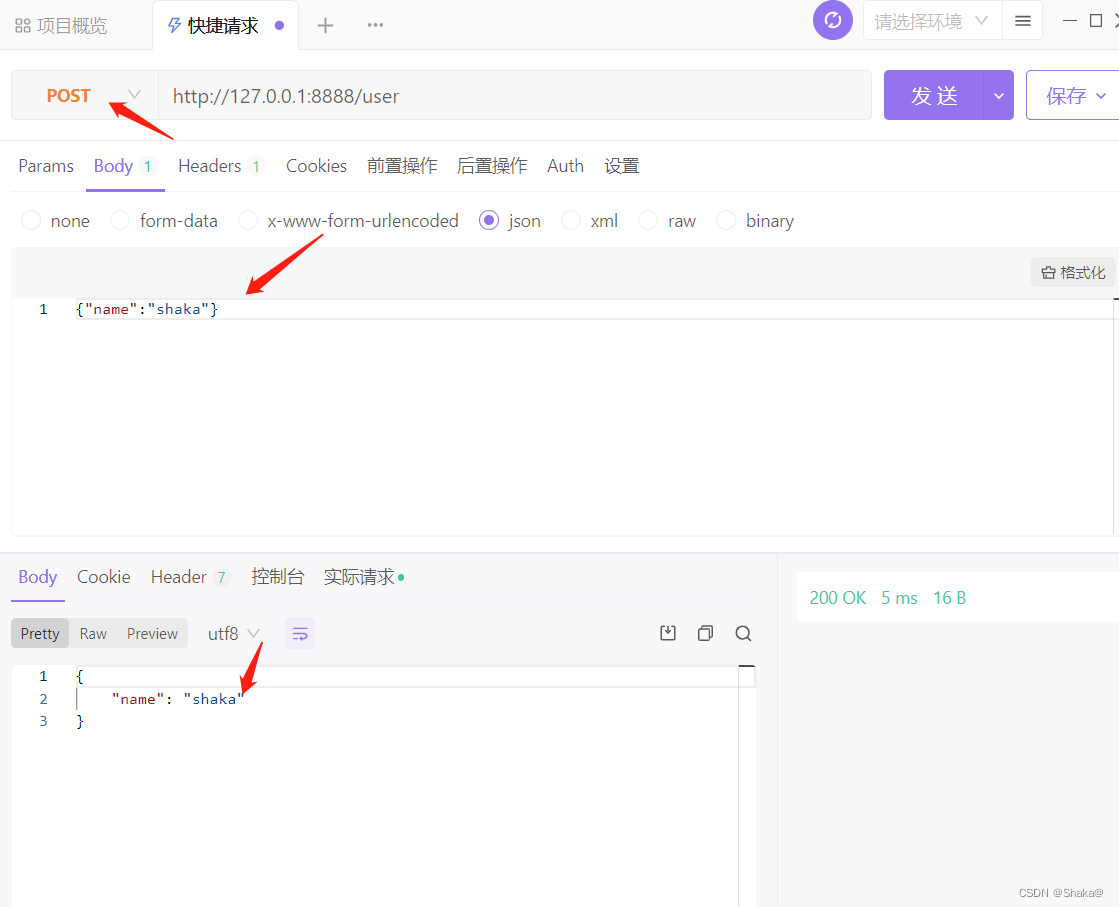

从0到1完成一个Node后端(express)项目(三、写接口、发起请求)

往期

从0到1完成一个Node后端(express)项目(一、初始化项目、安装nodemon) 从0到1完成一个Node后端(express)项目(二、下载数据库、navicat、express连接数据库)

写接口

我们看ex…

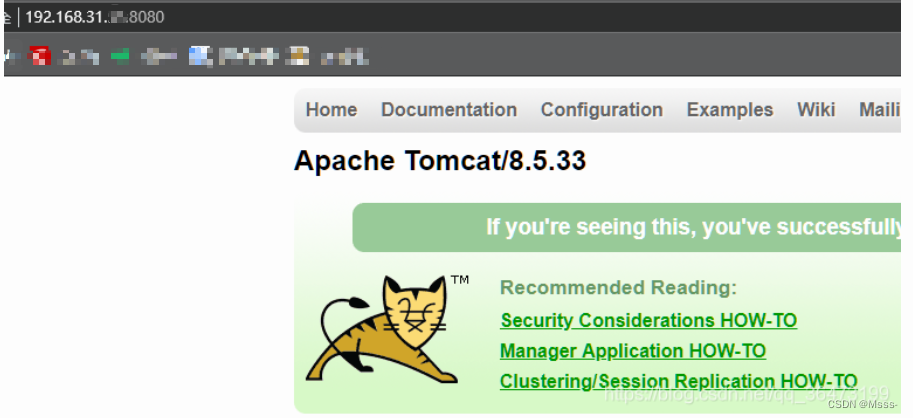

关于Linux部署Tomcat的访问问题

文章目录1.问题2.排除问题2.1检查Tomcat是否启动2.2检查防火墙&端口3.其他可能的问题3.1java的配置问题3.2可能出现了端口占用问题1.问题

在CentOS7系统的主机中配置好了Tomcat后发现通过默认端口无法访问到(http://xx:xx:xx:xx:8080)

2.排除问题 …

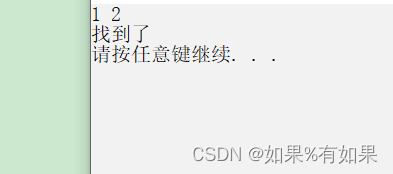

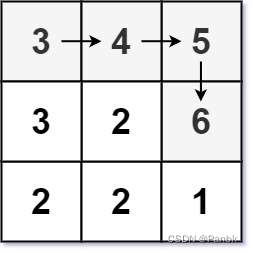

C语言在杨氏矩阵中找一个数

这道题大家都会做,使用暴力算法遍历整个数组。但是题目要求时间复杂度小于O(n),这样做显然不合题意,所以,通过分析杨氏矩阵的特点,我们发现矩阵右上角的那个数为一行中最大的,一列中…

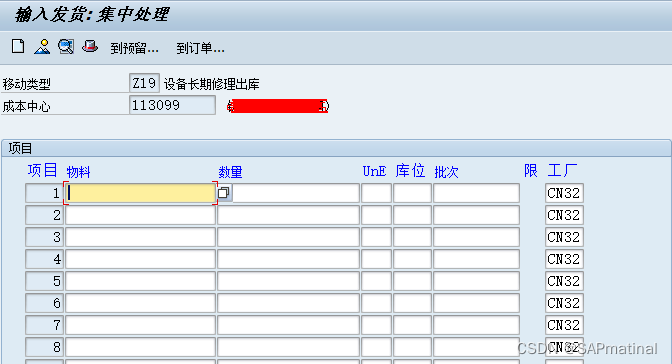

SAP MM 新建移动类型(Movement Type)

一、概念 物料的移动类型(Movement Type)代表了货物的移动,当一个物料做某种移动时,便开始了如下一系列事件:

1、一个物料凭证会被创建,可以被用来作为移动的证明及作为其它任何相关应用的一个信息来源&am…

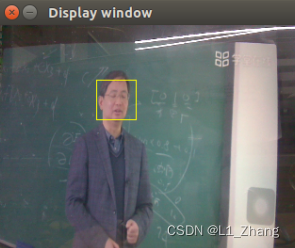

Jetson nano 入手系列之6—使用qt creator 开发c++ opencv+CSI摄像头人脸检测

Jetson nano 入手系列之6—使用qt creator 开发c opencvCSI摄像头人脸检测1.创建摄像头人脸检测项目1.1 创建并配置项目1.2 编辑文件1.2.1 main.cpp1.2.2 CMakeLists.txt2.构建及编译2.1 直接使用qt creator完成2.2 使用命令行参考文献本系列针对亚博科技jetson nano开发板。

…

一篇文章带你学会MySQL数据库的基本管理

目录

前言

一、数据库的介绍

二、mariadb的安装

三、数据库的开启及安全初始化

四、数据库的基本管理

五、数据库密码更改及破解

六、用户授权

七、数据库的备份

八、phpmyadmin的安装

总结 前言

什么是数据库?

每个人家里都会有衣柜,衣柜是…

![[拆轮子] PaddleDetection中__shared__、__inject__ 和 from_config 三者分别做了什么](https://img-blog.csdnimg.cn/b9e372fc214c4ff89128210a7661db71.png)