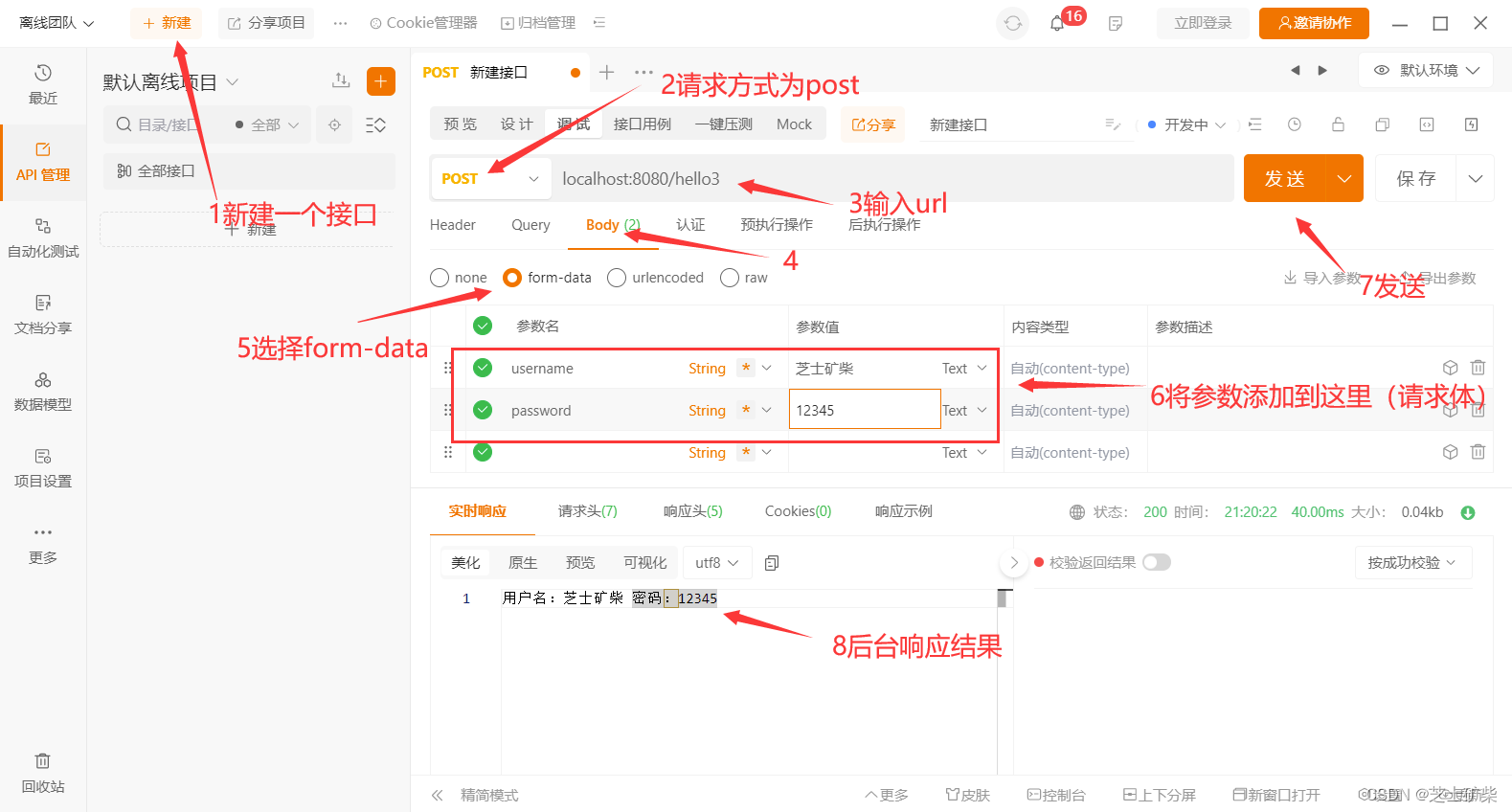

基本概念

损失函数也叫代价函数。损失函数就是计算预测结果和实际结果差距的函数,机器学习的过程就是试图将损失函数的值降到最小。

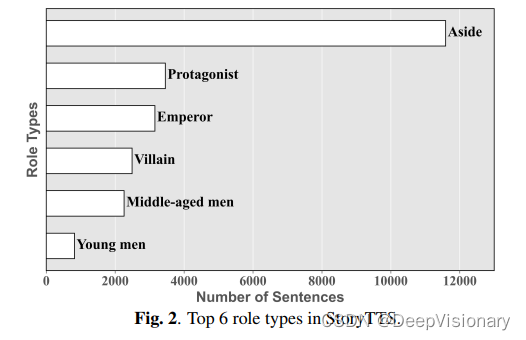

图左:|t_p - t_c| 图右:(t_p - t_c)**2

代码实现

过程推导

训练数据:

t_c = [0.5,14.0,15.0,28.0,11.0,8.0,3.0,-4.0,6.0,13.0,21.0]

t_u = [35.7,55.9,58.2,81.9,56.3,48.9,33.9,21.8,48.4,60.4,68.4]

通过散点图观察到训练数据与真值对应关系是线性变化,我们假设该方程为:y=wx+b

由此可以定义一个模型:

# 定义模型,假设这是一个简单的线性模型

def model(t_c,w,b):

return t_c*w+b我们需要计算预测值与真实值的差距(损失函数)来更新w和b的参数,来找到最适合的w和b值。

# 定义损失计算函数

def loss_fn(t_p,t_c):

return ((t_p-t_c)**2).mean()计算损失:

w = torch.ones(())

b = torch.zeros(())

t_p = model(t_c,w,b)

loss = loss_fn(t_p,t_u)

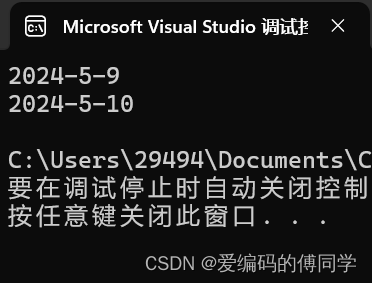

# loss tensor(1763.8848)手动更新损失降损失降低至最小:

w = torch.ones(())

b = torch.ones(())

t_p = model(t_c,w,b)

loss = loss_fn(t_p,t_u)

# loss tensor(1682.2847)完整代码

import torch

import numpy as np

import matplotlib.pyplot as plt

# 训练数据

t_c = [0.5,14.0,15.0,28.0,11.0,8.0,3.0,-4.0,6.0,13.0,21.0]

# 对应真值

t_u = [35.7,55.9,58.2,81.9,56.3,48.9,33.9,21.8,48.4,60.4,68.4]

t_c = torch.tensor(t_c)

t_u = torch.tensor(t_u)

# 数据观察

# plt.scatter绘制散点图,参数C是点的颜色,edgecolors是点的边框颜色

plt.scatter(t_c,t_u,c='r',edgecolors='g')

# 定义模型,假设这是一个简单的线性模型

def model(t_c,w,b):

return t_c*w+b

# 定义损失计算函数

def loss_fn(t_p,t_c):

return ((t_p-t_c)**2).mean()

# 计算损失

w = torch.ones(())

b = torch.zeros(())

t_p = model(t_c,w,b)

loss = loss_fn(t_p,t_u) # tensor(1763.8848)

# 手动更新损失

w = torch.ones(())

b = torch.ones(())

t_p = model(t_c,w,b)

loss = loss_fn(t_p,t_u) # tensor(1682.2847)