实时流传输协议 RTSP(Real-Time Streaming Protocol)是 TCP/IP 协议体系中的一个应用层协议,由哥伦比亚大学、网景和 RealNetworks 公司提交的 IETF RFC 标准。该协议定义了一对多应用程序如何有效地通过 IP 网络传送多媒体数据。RTSP 在体系结构上位于 RTP 和 RTCP 之上,它使用 TCP 或 UDP 完成数据传输。

一、RTSP 适用场景:

- 视频监控和安防系统:RTSP 在视频监控领域具有广泛的应用。它可以实现监控视频的实时传输、回放、点播和存储等功能,适用于大规模的视频监控系统,如城市安防、企事业单位、交通监控等场景。

- 直播服务:RTSP 在直播服务中也发挥着重要作用。它可以实现音视频数据的实时传输和控制,确保直播的流畅性和稳定性。同时,RTSP 还支持多种媒体格式和编码方式,适应不同平台和设备的播放需求。

- 点播服务:除了直播外,RTSP 还适用于点播服务。用户可以通过 RTSP 协议向服务器请求特定的音视频资源,进行播放和观看。这种方式适用于视频库、在线教育、远程会议等场景。

- 视频会议和远程教育:RTSP 在视频会议和远程教育领域也具有一定的应用价值。它可以实现音视频数据的实时传输和控制,确保会议的顺利进行和远程教育的有效性。

- 流媒体服务器与媒体播放器之间的通信:RTSP 协议是流媒体服务器与媒体播放器之间的主要通信协议,用于建立和控制媒体会话。通过 RTSP 协议,媒体播放器可以向流媒体服务器请求媒体数据,实现音视频内容的播放。

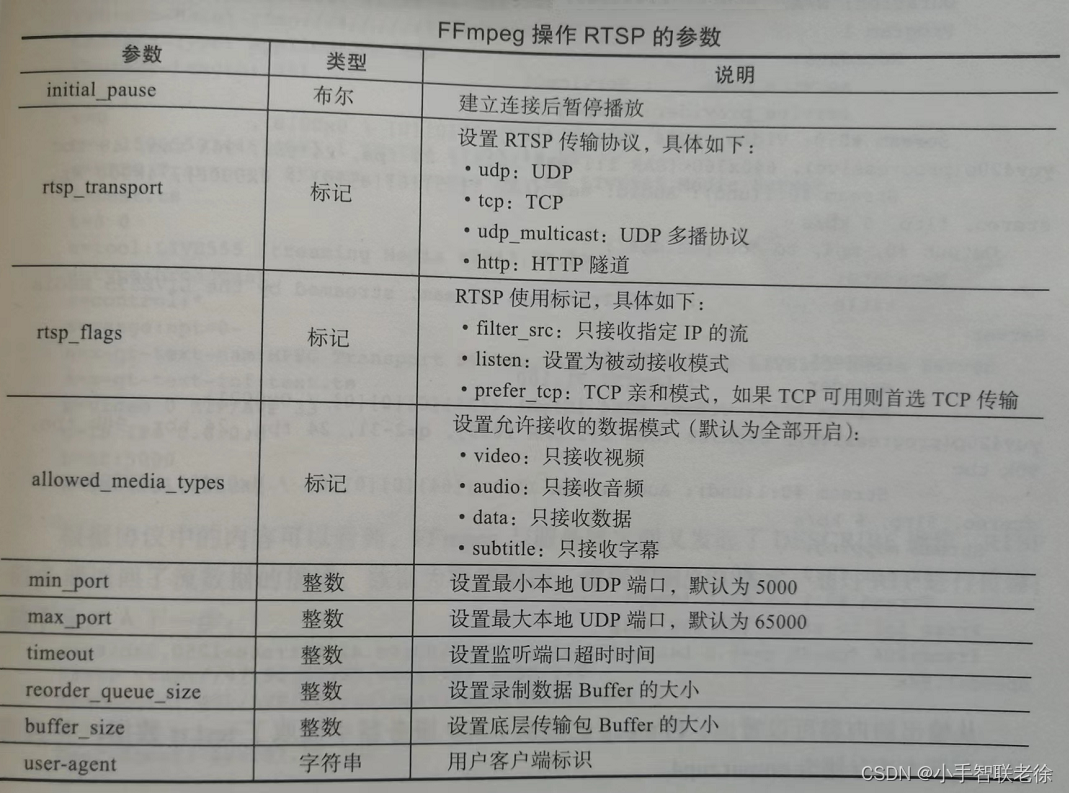

二、FFmpeg 操作 RTSP 的参数:

FFmpeg 是一个非常强大的开源工具,可以用来处理音频和视频,也可以进行 RTSP 视频流的推拉。

要使用 FFmpeg 进行 RTSP 视频流的推拉,需要首先确保系统已经安装了 FFmpeg。在大多数 Linux 发行版中,可以通过包管理器(如 apt 或 yum)来安装。在 Windows 或 Mac 上,需要从 FFmpeg 的官方网站下载并安装。

安装完成后,可以通过下面的命令,来查询 FFmpeg 操作 RTSP 的参数:

ffmpeg -h demuxer=RTSP

RTSP demuxer AVOptions:

-initial_pause <boolean> .D......... do not start playing the stream immediately (default false)

-rtsp_transport <flags> ED......... set RTSP transport protocols (default 0)

udp ED......... UDP

tcp ED......... TCP

udp_multicast .D......... UDP multicast

http .D......... HTTP tunneling

https .D......... HTTPS tunneling

-rtsp_flags <flags> .D......... set RTSP flags (default 0)

filter_src .D......... only receive packets from the negotiated peer IP

listen .D......... wait for incoming connections

prefer_tcp ED......... try RTP via TCP first, if available

satip_raw .D......... export raw MPEG-TS stream instead of demuxing

-allowed_media_types <flags> .D......... set media types to accept from the server (default video+audio+data+subtitle)

video .D......... Video

audio .D......... Audio

data .D......... Data

subtitle .D......... Subtitle

-min_port <int> ED......... set minimum local UDP port (from 0 to 65535) (default 5000)

-max_port <int> ED......... set maximum local UDP port (from 0 to 65535) (default 65000)

-listen_timeout <int> .D......... set maximum timeout (in seconds) to wait for incoming connections (-1 is infinite, imply flag listen) (from INT_MIN to INT_MAX) (default -1)

-timeout <int64> .D......... set timeout (in microseconds) of socket I/O operations (from INT_MIN to I64_MAX) (default 0)

-reorder_queue_size <int> .D......... set number of packets to buffer for handling of reordered packets (from -1 to INT_MAX) (default -1)

-buffer_size <int> ED......... Underlying protocol send/receive buffer size (from -1 to INT_MAX) (default -1)

-user_agent <string> .D......... override User-Agent header (default "Lavf60.3.100")也可以参考《 FFmpeg 从入门到精通 》书里的内容:

三、使用 FFmpeg 发送 RTSP 流媒体

假设有一个视频文件(例如 input.mp4)并希望将其作为 RTSP 流发送,可以使用以下命令:

ffmpeg -re -i input.mp4 -c:v libx264 -preset veryfast -maxrate 3000k -bufsize 6000k -pix_fmt yuv420p -g 50 -c:a aac -b:a 160k -ac 2 -ar 44100 -f rtsp rtsp://your_rtsp_server/live/stream

命令参数:

-re:以原始帧率读取输入(用于模拟实时流)。

-i input.mp4:指定输入文件。

-c:v libx264:使用 H.264 视频编码器。

-preset veryfast:设置 x264 编码器的预设,这里选择了较快的预设以获得更快的编码速度。

-maxrate 和 -bufsize:设置比特率和缓冲区大小。

-pix_fmt yuv420p:设置像素格式,这对于某些 RTSP 服务器是必需的。

-g 50:设置关键帧间隔(GOP大小)。

-c:a aac:使用 AAC 音频编码器。

-b:a 160k:设置音频比特率。

-ac 2:设置音频通道数为 2(立体声)。

-ar 44100:设置音频采样率为 44100 Hz。

-f rtsp:设置输出格式为 RTSP。

rtsp://your_rtsp_server/live/stream:指定 RTSP 服务器的 URL 和流路径。

四、使用 FFmpeg 播放 RTSP 流媒体

要播放 RTSP 流,可以使用以下命令:

ffmpeg -i rtsp://your_rtsp_server/live/stream -c:v copy -c:a copy -f mp4 -movflags frag_keyframe+empty_moov pipe:1 | ffplay -i pipe:0

这个命令实际上是将 RTSP 流转码为 MP4 格式并通过管道传递给 ffplay 进行播放。

因为 ffplay 可以直接播放 RTSP 流。更简单的命令是:

ffplay rtsp://your_rtsp_server/live/stream

ffplay -i rtsp://192.168.0.101:8555/person_detection

五、使用 FFmpeg 发送 RTSP 流媒体(摄像头作为源)

要使用 FFmpeg 发送和播放 RTSP 流媒体,并且以摄像头采集的视频作为源,需要按照以下步骤操作:

首先,需要确保摄像头已经被系统识别,可以通过某种方式(如 v4l2-ctl 或 ffmpeg -list_devices true -f dshow,对于Windows)来列出和选择。

然后,可以使用以下 FFmpeg 命令将摄像头采集的视频作为源,并发送到 RTSP 服务器:

ffmpeg -re -f v4l2 -input_format h264 -i /dev/video0 -c:v copy -an -f rtsp rtsp://your_rtsp_server/live/stream

命令参数:

-f v4l2 指定输入格式为 Video4Linux2(Linux上常用的摄像头输入格式)。

-input_format h264(如果摄像头直接输出 H.264 格式的话)。但通常摄像头输出的是原始格式(如 YUV),可能需要使用 -c:v libx264 来重新编码。

/dev/video0 是摄像头在 Linux 上的常见设备路径,具体取决于摄像头和系统配置。在 Windows 上,可能需要使用如 dshow 这样的输入选项和设备名。

-c:v copy 试图直接复制视频流(如果源是编码的格式),但如果源是原始格式,则需要用编码器(如 -c:v libx264)。

-an 表示不包含音频流(因为摄像头通常不输出音频)。

-f rtsp 指定输出格式为 RTSP。

rtsp://your_rtsp_server/live/stream 是 RTSP 服务器的 URL 和流路径。

注意事项:

如果摄像头输出的是原始格式而不是 H.264 编码的视频,需要使用视频编码器(如 -c:v libx264 )来重新编码视频流。

可能需要根据摄像头和 RTSP 服务器的具体配置来调整 FFmpeg 命令中的参数。

确保网络防火墙和安全设置允许 RTSP 流的传输。

如果 RTSP 服务器需要身份验证或其他安全设置,需要在 URL 中包含这些信息,如 rtsp://username:password@your_rtsp_server/live/stream。

老徐,2024/5/2