StabilityAI公司最新推出音频生成模型Stable Audio 2.0,该模型可通过单一自然语言提示以44.1kHz立体声播放具有连贯音乐结构的高质量、完整曲目,长达三分钟。

新模型超越了文本到音频的范围,还包括音频到音频的功能。用户现在可以上传音频样本,并通过自然语言提示将这些样本转换为各种声音。此更新还扩展了音效生成和风格转移,为艺术家和音乐家提供了更大的灵活性、控制力和更高的创作过程。

Stable Audio 2.0建立在Stable Audio 1.0 的基础上,后者于2023年9月首次亮相,是第一个商业上可行的人工智能音乐生成工具,能够利用潜在扩散技术生成高质量的44.1kHz音乐。此后,它被《时代》杂志评为2023年最佳发明之一。

相关链接

https://stableaudio.com/

新功能

我们最先进的音频模型以其新功能扩展了艺术家和音乐家的创意工具包。通过文本转音频和音频转音频提示,用户可以制作旋律、背景音轨、主干和声音效果,从而增强创作过程。

全长曲目

Stable Audio 2.0 与其他最先进的模型不同,因为它可以生成长度长达三分钟的歌曲,并配有结构化的作品,包括前奏、展开和结尾,以及立体声音效。

音频到音频生成

Stable Audio2.0现在支持音频文件上传,将想法转化为完整制作的样本。

变奏和音效创作

该模型放大了声音和音频效果的制作,从敲击键盘到人群的呼喊声或城市街道的嗡嗡声,它提供了提升音频项目的新方法。

风格转移

这项新功能可以在生成过程中无缝修改新生成或上传的音频。此功能允许自定义输出的主题,以与项目的特定风格和基调保持一致。

方法介绍

Stable Audio 2.0潜在扩散模型的架构经过专门设计,能够生成具有连贯结构的完整音轨。为了实现这一目标,我们对系统的所有组件进行了调整,以提高长期的性能。

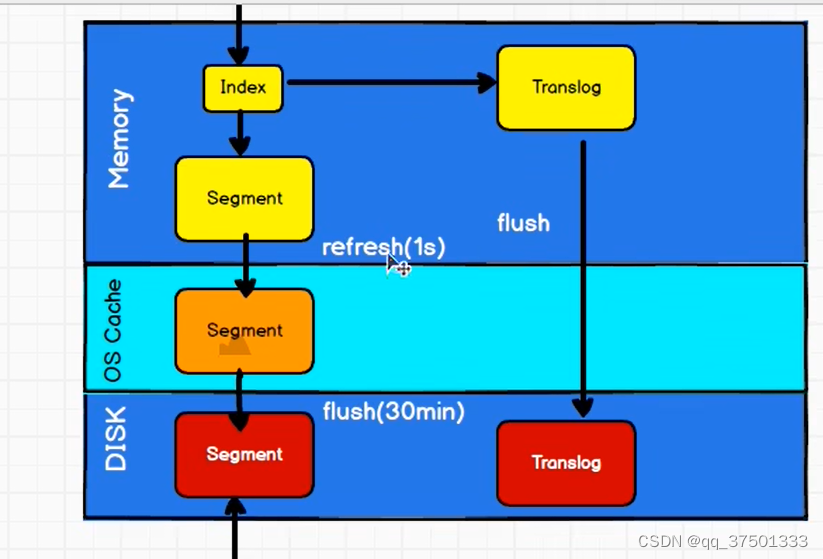

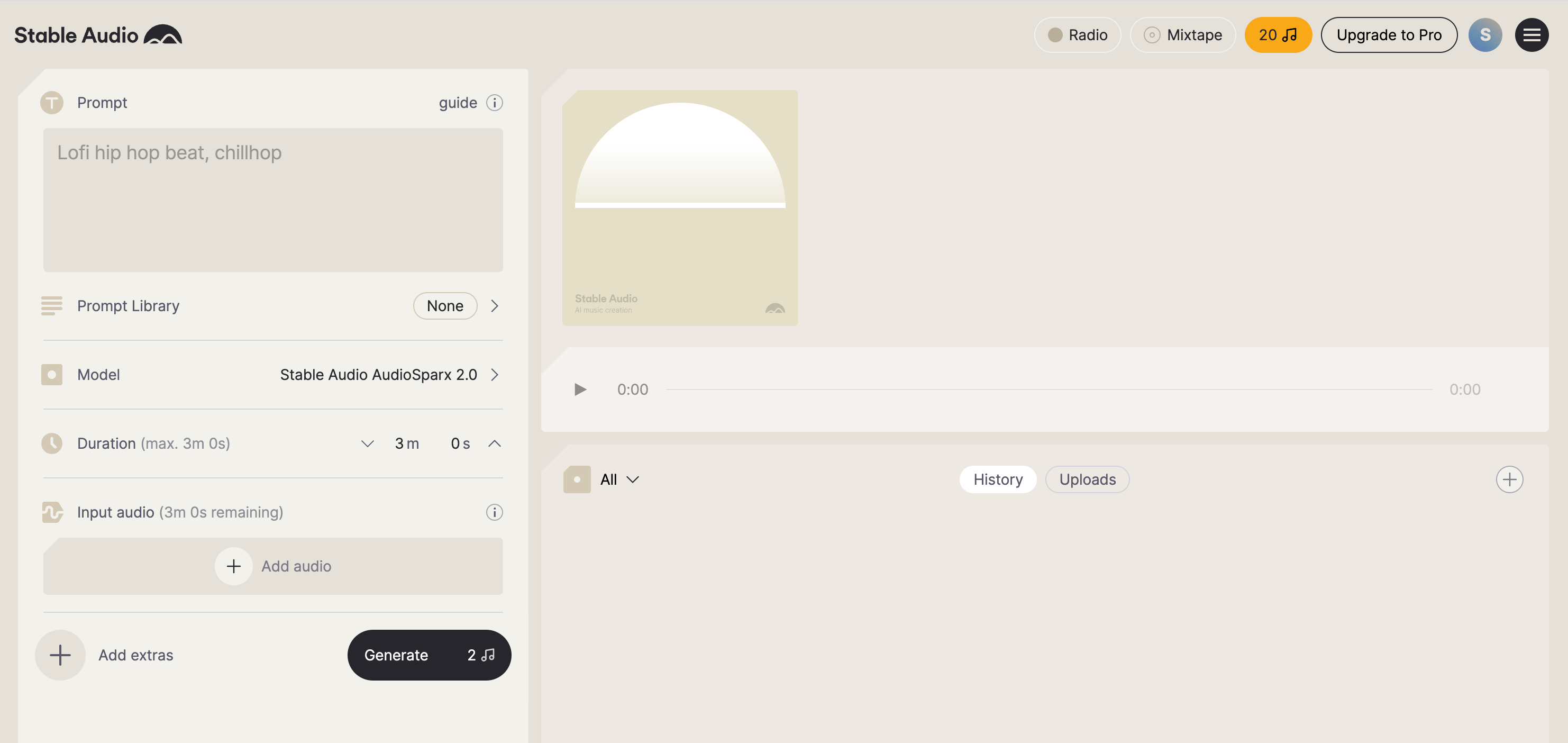

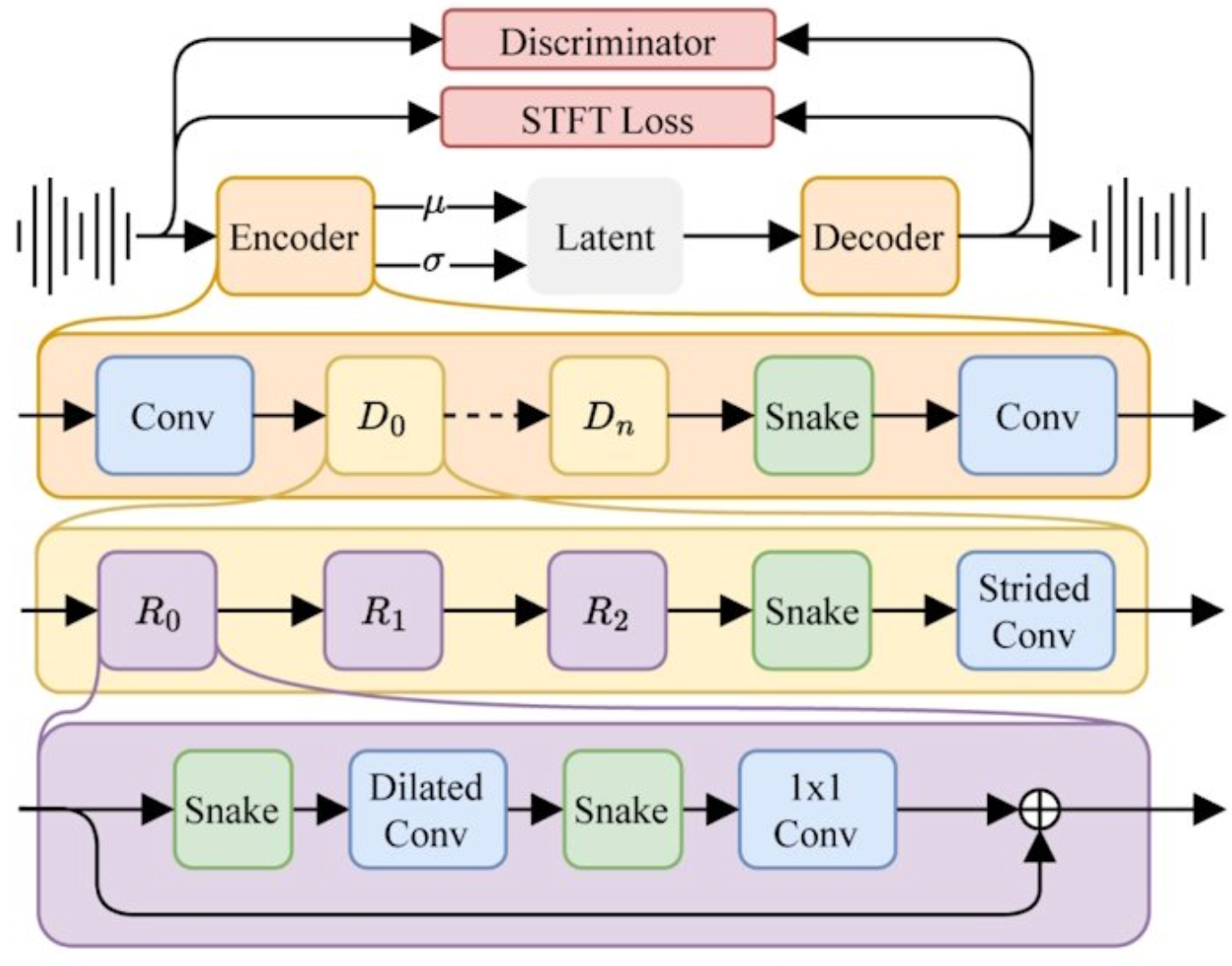

一种新的高度压缩的自动编码器将原始音频波形压缩为更短的表示形式。对于扩散模型,我们采用类似于stable diffusion 3中使用的扩散变压器 (DiT)来代替之前的U-Net,因为它更擅长处理长序列上的数据。这两个元素的结合产生了一个能够识别和再现高质量音乐作品所必需的大规模结构的模型。

自动编码器压缩音频并将其重建回原始状态。它捕捉并再现了基本特征,同时过滤掉不太重要的细节,以实现更连贯的生成。

扩散变压器(DiT)将随机噪声逐步细化为结构化数据,从而识别复杂的模式和关系。与自动编码器相结合,它能够处理更长的序列,从而根据输入创建更深入、更准确的解释。