文章名称:Inpainting For Fringe Projection Profilometry Based on Iterative Regularization

代码地址:

💡 摘要:本文提出了一种基于迭代正则化技术的新的条纹投影轮廓术(Fringe Projection Profilometry, FPP)修复算法。传统的FPP方法在物体表面出现高光区域时,通常无法准确重建物体的三维模型。在所提出的方法中,使用解析复小波变换(Analytic Complex Wavelet Transform)检测高光区域,然后基于迭代正则化模型,通过在复小波域中填充相应的高光区域来恢复缺失的条纹图案。通过使用合成和真实物体在不同光照条件下进行模拟和实验,实验结果表明,所提出的算法能够准确重建带有高光区域的物体的三维模型。

主要内容和创新点:

主要内容: 这篇文章主要讨论了一种新的用于条纹投影轮廓术(Fringe Projection Profilometry, FPP)的修复算法,该算法基于迭代正则化技术。文章首先介绍了FPP技术的基本原理,即通过投影条纹图案并捕捉由物体形状变形后的条纹图像来获取物体的深度信息,从而重建其三维模型。然而,在实际应用中,物体表面的高光区域会对条纹图像造成干扰,影响深度图的重建质量。为了解决这个问题,文章提出了一种新的算法,该算法能够在复小波域中检测和修复高光区域,从而恢复缺失的条纹图案,并最终重建出准确的三维模型。

创新点:

- 高光区域检测:文章提出了一种使用解析复小波变换(Analytic Complex Wavelet Transform, DTCWT)来检测高光区域的方法。这种方法能够在复小波域中有效地识别出高光区域,为后续的修复工作提供基础。

- 迭代正则化修复:文章采用了一种基于总变分范数(Total Variation Norm, TV-norm)的迭代正则化方法来修复高光区域。这种方法利用了条纹图像在复小波域中的片平滑特性,通过迭代过程恢复缺失的复杂小波系数,从而重建出完整的条纹图案。

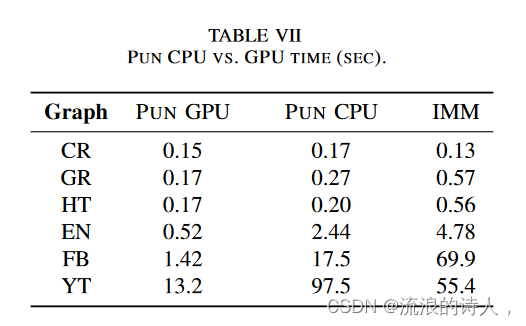

- 算法效率:所提出的修复算法具有较低的计算复杂度,因为DTCWT的实现确保了最小化过程的高效执行,该过程使用分裂Bregman方法(Split Bregman Method)进行。

- 实验验证:文章通过模拟和实验验证了所提出算法的有效性。实验结果表明,与传统的DTCWT方法和传统的修复方法相比,新算法能够更有效地纠正由于高光引起的条纹图像错误,提高了三维模型重建的准确性。

总的来说,这篇文章的创新之处在于提出了一种新的针对FPP中高光问题的处理方法,该方法能够在保持计算效率的同时,有效提高三维模型重建的质量和准确性。

文章部分内容摘录:

引言”(Introduction)

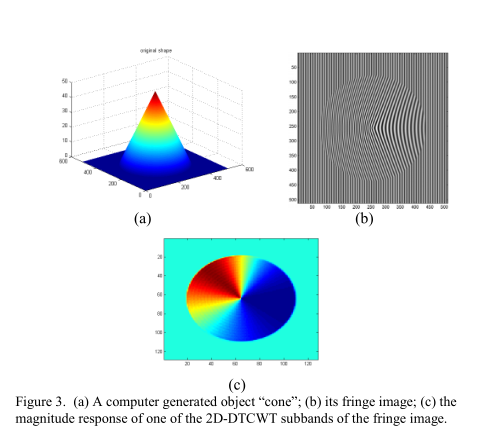

使用条纹投影轮廓术(Fringe Projection Profilometry, FPP)技术,我们可以获得物体的深度图信息,从而重建它们的三维(3D)模型。FPP的基本操作是通过投影仪投影的条纹图案与相机捕获的产生的条纹图像之间进行三角测量。在过去的十年中,FPP领域取得了显著的成就,这些成就使得物体的三维信息能够实现实时和高精度的测量[1][2]。在大多数FPP应用中,通常假设相机能够适当地捕获所有部分的变形条纹图像。然而,在现实世界的应用中,由于物体的材料和环境条件,这并不总是成立的。例如,当条纹图案被投影到瓷器物体上时,相机捕获的条纹图像将被由全局照明和直接照明引起的高光污染。这样的高光在不同视角下的大小和外观会发生变化。它们会破坏条纹图像,从而显著影响深度图重建结果。图1(a)和(b)展示了一个带有高光区域的陶瓷盘子的例子及其对应的条纹图像。请注意,高光已经在图像中压倒了底层的条纹图案。

为了处理这一挑战性任务,一种方法是根据主动立体技术[3]从不同视点获取几个条纹图像,或者使用移动相机/移动场景方法[4]、滑动投影仪方法[5]或偏振过滤方法[6][7]。尽管这些技术在去除高光方面是有效的,但它们需要额外的硬件,增加了系统的成本和复杂性。另一种方法是通过获取物体的多个条纹图像。例如,[7]中的方法使用高频图案的相移方法来三维重建半透明物体;而[2][8][9]中的方法使用离散条纹图案来减轻间接照明问题和次表面散射。这些技术更可取且成本效益更高,但它们有一个重要的缺点,即构建一个三维模型需要大量的条纹图像。这限制了这些方法对动态物体的适用性。它们在计算上也是昂贵的。恢复图像退化区域是一个典型的修复问题。已经开发了许多修复方法来增强由于某些区域丢失而退化的图像[10]。然而,这些方法大多是针对具有RGB颜色空间的自然图像。一个能够有效适应FPP环境的修复算法尚未被开发出来。在本文中,我们提出了一种新的基于迭代正则化技术的修复算法,用于去除条纹图像中的高光效果。首先,我们采用了一个高频条纹图案,正如最近在[6][7]中提出的,以减轻高光的影响。与[7]不同的是,我们只使用了一个条纹图案,因此条纹图像中的高光仍然存在(见图1(b))。其次,我们使用双树复小波变换(Dual-Tree Complex Wavelet Transform, DTCWT)将图像转换到复小波域。然后,通过分析粗级别复小波系数的幅度来检测高光区域。最后,我们采用总变分范数(TV-norm)迭代正则化方法来恢复由于高光而缺失的条纹的复小波系数。增强的条纹图像可以通过逆DTCWT获得,最终在相位解包裹过程之后,可以节俭地获得深度信息。

问题定义”(Problem Definition)

在高光存在的情况下,相机传感器测量的总辐射是直接照明和全局照明的总和[9]: $\ L(x, y) = L_d(x, y) + L_g(x, y)$ 其中 $L_d(x, y)$ 是来自投影仪的直接光,\( L_g(x, y) \) 是全局照明。关于全局照明的详细解释,读者可以参考[9]。在FPP中,投影到物体上的条纹图案根据物体形状发生变形,并且相机将捕获变形后的条纹图像,如下所示: $\ I(x, y) = [c_d(x, y) + c_g(x, y)] \cos(\phi(x, y) + \phi_c(x, y)) ]$ 其中 $\ \phi(x, y)$ 是条纹的相移,它与物体高度有直接关系。换句话说,如果已知 $\ \phi(x, y)$ ,就可以立即重建物体的三维模型。因此,目标是从可能已经被全局照明 $\ L_g(x, y)$ 引入的高光破坏的条纹图像 $\ cI(x, y)$ 中获得 $\ (\phi(x, y) )$ 的良好估计。

在本节中,我们定义了在高光影响下FPP重建三维模型的问题,并阐明了如何从可能被高光破坏的条纹图像中恢复出准确的相位信息的挑战。