多维时序 | Matlab实现VMD-CNN-LSTM变分模态分解结合卷积神经网络结合长短期记忆神经网络多变量时间序列预测

目录

- 多维时序 | Matlab实现VMD-CNN-LSTM变分模态分解结合卷积神经网络结合长短期记忆神经网络多变量时间序列预测

- 预测效果

- 基本介绍

- 程序设计

- 参考资料

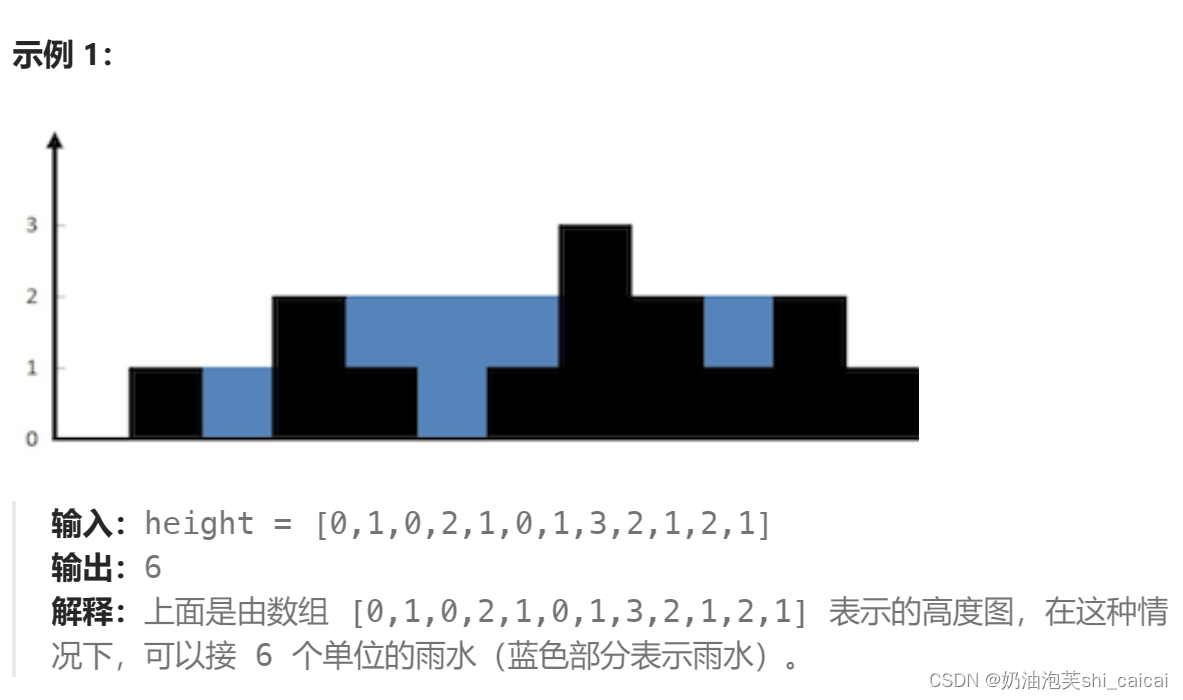

预测效果

基本介绍

1.Matlab实现VMD-CNN-LSTM变分模态分解结合卷积神经网络结合长短期记忆神经网络多变量时间序列预测;

2.运行环境为Matlab2021及以上;

3.输入多个特征,输出单个变量,考虑历史特征的影响,多变量时间序列预测;

4.data为数据集,main1_VMD.m、main2_VMD_CNN_LSTM.m为主程序,运行即可,所有文件放在一个文件夹;

5.命令窗口输出R2、MSE、MAE、MAPE和RMSE多指标评价;

VMD-CNN-LSTM,即变分模态分解(VMD)结合卷积神经网络(CNN)与长短期记忆网络(LSTM),是一种先进的时间序列预测模型,适用于多变量时间序列预测问题。下面我们将逐一分析这些组件及其组合方式如何工作。

首先,变分模态分解(VMD)是一种信号处理方法,用于将复杂信号分解为一系列具有稀疏性和频带限制的子模态分量。这有助于从原始数据中提取出具有不同频率特性的信息,为后续的机器学习模型提供更丰富的特征。

接着,卷积神经网络(CNN)是一种深度学习模型,特别适用于处理具有网格结构的数据,如图像。在时间序列预测中,CNN可以通过卷积操作提取数据的局部特征,并通过池化操作降低数据的维度,从而减少模型的计算复杂度。

长短期记忆网络(LSTM)是一种特殊的循环神经网络(RNN),擅长处理序列数据中的长期依赖关系。通过其门控机制,LSTM可以记忆过去的信息并传递给未来,这对于预测时间序列数据中的长期趋势非常有用。

将VMD、CNN和LSTM三者结合,可以构建一个强大的多变量时间序列预测模型。具体来说,VMD首先对原始数据进行分解,得到一系列子模态分量;然后,CNN对这些子模态分量进行特征提取;最后,LSTM利用这些特征进行时间序列预测。这种组合方式充分利用了三种方法的优点,使得模型在处理复杂时间序列问题时具有更高的预测精度和更强的泛化能力。

程序设计

- 完整程序和数据获取方式资源处下载Matlab实现VMD-CNN-LSTM变分模态分解结合卷积神经网络结合长短期记忆神经网络多变量时间序列预测。

%% 清空环境变量

warning off % 关闭报警信息

close all % 关闭开启的图窗

clear % 清空变量

clc % 清空命令行

%% 导入数据

res =xlsread('data.xlsx');

%% 数据分析

num_size = 0.7; % 训练集占数据集比例

num_train_s = round(num_size * num_samples); % 训练集样本个数

f_ = size(res, 2) - outdim; % 输入特征维度

%% 划分训练集和测试集

P_train = res(1: num_train_s, 1: f_)';

T_train = res(1: num_train_s, f_ + 1: end)';

M = size(P_train, 2);

P_test = res(num_train_s + 1: end, 1: f_)';

T_test = res(num_train_s + 1: end, f_ + 1: end)';

N = size(P_test, 2);

f_ = size(P_train, 1); % 输入特征维度

%% 数据归一化

[p_train, ps_input] = mapminmax(P_train, 0, 1);

p_test = mapminmax('apply', P_test, ps_input);

[t_train, ps_output] = mapminmax(T_train, 0, 1);

t_test = mapminmax('apply', T_test, ps_output);

% 输入特征

sequenceInputLayer([numFeatures,1,1],'name','input') %输入层设置

sequenceFoldingLayer('name','fold') %使用序列折叠层对图像序列的时间步长进行独立的卷积运算。

% CNN特征提取

convolution2dLayer([3,1],16,'Stride',[1,1],'name','conv1') %添加卷积层,64,1表示过滤器大小,10过滤器个数,Stride是垂直和水平过滤的步长

batchNormalizationLayer('name','batchnorm1') % BN层,用于加速训练过程,防止梯度消失或梯度爆炸

reluLayer('name','relu1') % ReLU激活层,用于保持输出的非线性性及修正梯度的问题

% 池化层

maxPooling2dLayer([2,1],'Stride',2,'Padding','same','name','maxpool') % 第一层池化层,包括3x3大小的池化窗口,步长为1,same填充方式

% 展开层

sequenceUnfoldingLayer('name','unfold') %独立的卷积运行结束后,要将序列恢复

%平滑层

flattenLayer('name','flatten')

lstmLayer(25,'Outputmode','last','name','hidden1')

dropoutLayer(0.2,'name','dropout_1') % Dropout层,以概率为0.2丢弃输入

fullyConnectedLayer(1,'name','fullconnect') % 全连接层设置(影响输出维度)(cell层出来的输出层) %

参考资料

[1] https://blog.csdn.net/kjm13182345320/category_11799242.html?spm=1001.2014.3001.5482

[2] https://blog.csdn.net/kjm13182345320/article/details/124571691