Adam算法是在RMSProp算法基础上对小批量随机梯度也做了指数加权移动平均 【可以看做是RMSProp算法与动量法的结合】。

目录

- 1. Adam算法介绍

- 2. 从零实现Adam算法

- 3. Pytorch简洁实现Adam算法--optim.Adam

- 总结

1. Adam算法介绍

Adam算法使用了动量变量 v t \boldsymbol{v}_t vt和RMSProp算法中小批量随机梯度按元素平方的指数加权移动平均变量 s t \boldsymbol{s}_t st,并在时间步0将它们中每个元素初始化为0。给定超参数 0 ≤ β 1 < 1 0 \leq \beta_1 < 1 0≤β1<1(算法作者建议设为0.9),时间步 t t t的动量变量 v t \boldsymbol{v}_t vt即小批量随机梯度 g t \boldsymbol{g}_t gt的指数加权移动平均:

v t ← β 1 v t − 1 + ( 1 − β 1 ) g t . \boldsymbol{v}_t \leftarrow \beta_1 \boldsymbol{v}_{t-1} + (1 - \beta_1) \boldsymbol{g}_t. vt←β1vt−1+(1−β1)gt.

和RMSProp算法中一样,给定超参数

0

≤

β

2

<

1

0 \leq \beta_2 < 1

0≤β2<1(算法作者建议设为0.999),

将小批量随机梯度按元素平方后的项

g

t

⊙

g

t

\boldsymbol{g}_t \odot \boldsymbol{g}_t

gt⊙gt做指数加权移动平均得到

s

t

\boldsymbol{s}_t

st:

s t ← β 2 s t − 1 + ( 1 − β 2 ) g t ⊙ g t . \boldsymbol{s}_t \leftarrow \beta_2 \boldsymbol{s}_{t-1} + (1 - \beta_2) \boldsymbol{g}_t \odot \boldsymbol{g}_t. st←β2st−1+(1−β2)gt⊙gt.

由于我们将

v

0

\boldsymbol{v}_0

v0和

s

0

\boldsymbol{s}_0

s0中的元素都初始化为0,

在时间步

t

t

t我们得到

v

t

=

(

1

−

β

1

)

∑

i

=

1

t

β

1

t

−

i

g

i

\boldsymbol{v}_t = (1-\beta_1) \sum_{i=1}^t \beta_1^{t-i} \boldsymbol{g}_i

vt=(1−β1)∑i=1tβ1t−igi。将过去各时间步小批量随机梯度的权值相加,得到

(

1

−

β

1

)

∑

i

=

1

t

β

1

t

−

i

=

1

−

β

1

t

(1-\beta_1) \sum_{i=1}^t \beta_1^{t-i} = 1 - \beta_1^t

(1−β1)∑i=1tβ1t−i=1−β1t。需要注意的是,当

t

t

t较小时,过去各时间步小批量随机梯度权值之和会较小。例如,当

β

1

=

0.9

\beta_1 = 0.9

β1=0.9时,

v

1

=

0.1

g

1

\boldsymbol{v}_1 = 0.1\boldsymbol{g}_1

v1=0.1g1。为了消除这样的影响,对于任意时间步

t

t

t,我们可以将

v

t

\boldsymbol{v}_t

vt再除以

1

−

β

1

t

1 - \beta_1^t

1−β1t,从而使过去各时间步小批量随机梯度权值之和为1。这也叫作偏差修正。在Adam算法中,我们对变量

v

t

\boldsymbol{v}_t

vt和

s

t

\boldsymbol{s}_t

st均作偏差修正:

v ^ t ← v t 1 − β 1 t , \hat{\boldsymbol{v}}_t \leftarrow \frac{\boldsymbol{v}_t}{1 - \beta_1^t}, v^t←1−β1tvt,

s ^ t ← s t 1 − β 2 t . \hat{\boldsymbol{s}}_t \leftarrow \frac{\boldsymbol{s}_t}{1 - \beta_2^t}. s^t←1−β2tst.

接下来,Adam算法使用以上偏差修正后的变量 v ^ t \hat{\boldsymbol{v}}_t v^t和 s ^ t \hat{\boldsymbol{s}}_t s^t,将模型参数中每个元素的学习率通过按元素运算重新调整:

g t ′ ← η v ^ t s ^ t + ϵ , \boldsymbol{g}_t' \leftarrow \frac{\eta \hat{\boldsymbol{v}}_t}{\sqrt{\hat{\boldsymbol{s}}_t} + \epsilon}, gt′←s^t+ϵηv^t,

其中 η \eta η是学习率, ϵ \epsilon ϵ是为了维持数值稳定性而添加的常数,如 1 0 − 8 10^{-8} 10−8。和AdaGrad算法、RMSProp算法以及AdaDelta算法一样,目标函数自变量中每个元素都分别拥有自己的学习率。最后,使用 g t ′ \boldsymbol{g}_t' gt′迭代自变量:

x t ← x t − 1 − g t ′ . \boldsymbol{x}_t \leftarrow \boldsymbol{x}_{t-1} - \boldsymbol{g}_t'. xt←xt−1−gt′.

2. 从零实现Adam算法

我们按照Adam算法中的公式实现该算法。其中时间步

t

t

t通过hyperparams参数传入adam函数。

%matplotlib inline

import torch

import sys

import d2lzh_pytorch as d2l

features, labels = d2l.get_data_ch7()

def init_adam_states():

v_w, v_b = torch.zeros((features.shape[1], 1), dtype=torch.float32), torch.zeros(1, dtype=torch.float32)

s_w, s_b = torch.zeros((features.shape[1], 1), dtype=torch.float32), torch.zeros(1, dtype=torch.float32)

return ((v_w, s_w), (v_b, s_b))

def adam(params, states, hyperparams):

beta1, beta2, eps = 0.9, 0.999, 1e-6

for p, (v, s) in zip(params, states):

v[:] = beta1 * v + (1 - beta1) * p.grad.data

s[:] = beta2 * s + (1 - beta2) * p.grad.data**2

v_bias_corr = v / (1 - beta1 ** hyperparams['t'])

s_bias_corr = s / (1 - beta2 ** hyperparams['t'])

p.data -= hyperparams['lr'] * v_bias_corr / (torch.sqrt(s_bias_corr) + eps)

hyperparams['t'] += 1

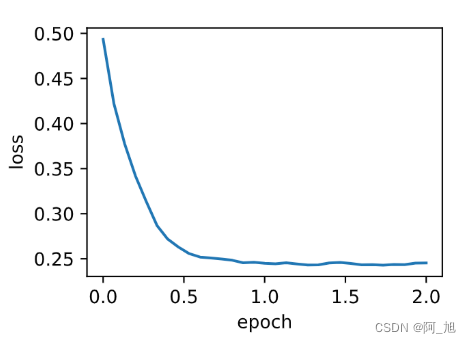

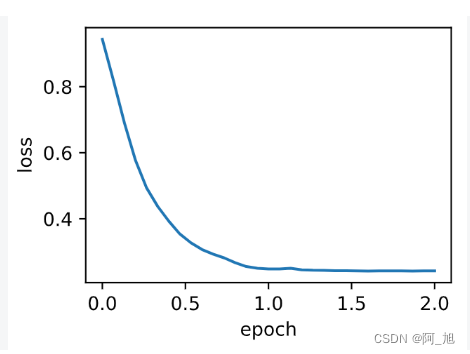

使用学习率为0.01的Adam算法来训练模型。

d2l.train_ch7(adam, init_adam_states(), {'lr': 0.01, 't': 1}, features, labels)

输出:

loss: 0.245370, 0.065155 sec per epoch

3. Pytorch简洁实现Adam算法–optim.Adam

通过名称为“Adam”的优化器实例,我们便可使用PyTorch提供的Adam算法。

d2l.train_pytorch_ch7(torch.optim.Adam, {'lr': 0.01}, features, labels)

输出:

loss: 0.242066, 0.056867 sec per epoch

总结

- Adam算法在RMSProp算法的基础上对小批量随机梯度也做了指数加权移动平均。

- Adam算法使用了偏差修正。

如果文章内容对你有帮助,感谢点赞+关注!

欢迎关注下方GZH:阿旭算法与机器学习,共同学习交流~

![[oeasy]python0041_ 转义字符_转义序列_escape_序列_sequence](https://img-blog.csdnimg.cn/img_convert/4d364d4b0a042d40013aa023ef78cf87.png)