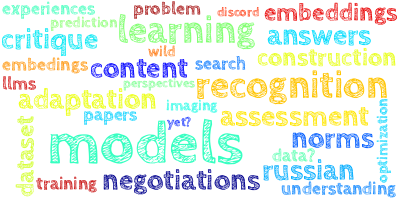

AI视野·今日CS.NLP 自然语言处理论文速览

Wed, 10 Jan 2024

Totally 38 papers

👉上期速览✈更多精彩请移步主页

Daily Computation and Language Papers

| Model Editing Can Hurt General Abilities of Large Language Models Authors Jia Chen Gu, Hao Xiang Xu, Jun Yu Ma, Pan Lu, Zhen Hua Ling, Kai Wei Chang, Nanyun Peng 大型语言模型的最新进展 LLM 开辟了访问存储在其参数中的知识的新范式。出现的一项关键挑战是,由于错误或过时的知识,法学硕士输出中存在幻觉。由于使用更新信息对法学硕士进行再培训需要大量资源,因此人们对模型编辑的兴趣日益浓厚。然而,许多模型编辑方法虽然在各种场景下都有效,但往往过分强调编辑性能的有效性、泛化性和局部性等方面,往往忽视了对法学硕士一般能力的潜在副作用。在本文中,我们担心模型真实性的提高可能会以这些通用能力的显着下降为代价,这不利于法学硕士的可持续发展。我们通过评估跨八个代表性任务类别的两个法学硕士的四种流行编辑方法来系统地分析副作用。广泛的实证研究表明,模型编辑确实提高了模型的真实性,但代价是严重损害了一般能力。 |

| Narrowing the Knowledge Evaluation Gap: Open-Domain Question Answering with Multi-Granularity Answers Authors Gal Yona, Roee Aharoni, Mor Geva 事实问题通常可以在不同的粒度级别上得到正确回答。例如,August 4, 1961 和 1961 都是问题 Barack Obama 出生时间 的正确答案。然而,标准问答 QA 评估协议没有明确考虑这一点,也没有将预测答案与单一粒度级别的答案进行比较。在这项工作中,我们提出了 GRANOLA QA,这是一种新颖的评估设置,其中根据一组多粒度答案的准确性和信息量来评估预测答案。我们提出了一种简单的方法,用于通过多粒度答案丰富现有数据集,并创建 GRANOLA EQ,这是 EntityQuestions 数据集的多粒度版本。我们评估了 GRANOLA EQ 上的一系列解码方法,包括一种称为 Decoding with Response Aggregation DRAG 的新算法,该算法旨在使响应粒度与模型的不确定性保持一致。我们的实验表明,具有标准解码的大型语言模型往往会生成特定的答案,而这些答案通常是不正确的。相比之下,当对多粒度答案进行评估时,DRAG 的准确率平均提高了近 20 个百分点,对于稀有实体而言,这一点进一步提高。 |

| RoSA: Accurate Parameter-Efficient Fine-Tuning via Robust Adaptation Authors Mahdi Nikdan, Soroush Tabesh, Dan Alistarh 我们研究了参数高效的微调 PEFT 方法,这些方法可以在大型语言模型 LLM 的背景下在有限的计算和内存预算下提供良好的准确性。我们提出了一种名为“鲁棒自适应 RoSA”的新 PEFT 方法,其灵感来自鲁棒主成分分析 PCA,该方法在一组固定的预训练权重之上联合训练 textit 低秩和 textit 高度稀疏组件,以有效地近似完整微调 FFT 解决方案的性能。在一系列具有挑战性的生成任务中,例如小学数学和 SQL 查询生成,这些任务需要微调才能获得良好的性能,我们表明,在相同的参数预算下,RoSA 的性能优于 LoRA 和纯稀疏微调。我们为 RoSA 提供系统支持,以补充训练算法,特别是以稀疏 GPU 内核的形式,支持内存和计算高效的训练。 |

| Lightning Attention-2: A Free Lunch for Handling Unlimited Sequence Lengths in Large Language Models Authors Zhen Qin, Weigao Sun, Dong Li, Xuyang Shen, Weixuan Sun, Yiran Zhong 线性注意力是一种有效的注意力机制,最近已成为传统 softmax 注意力的有前途的替代方案。凭借其以线性计算复杂度处理令牌的能力,线性注意力理论上可以在不牺牲速度的情况下处理无限长度的序列,即以固定的内存消耗保持各种序列长度的恒定训练速度。然而,由于累积求和 cumsum 的问题,当前的线性注意力算法无法在因果设置中展示其理论优势。在本文中,我们提出了 Lightning Attention 2,这是第一个线性注意力实现,使线性注意力能够实现其理论计算优势。为了实现这一点,我们利用平铺的思想,分别处理线性注意力计算中的块内和块间组件。具体来说,我们对帧内块使用传统的注意力计算机制,并对帧间块应用线性注意力内核技巧。通过前向和后向过程采用平铺技术,以充分利用 GPU 硬件。我们在 Triton 中实现我们的算法,使其具有 IO 感知能力和硬件友好性。对不同的模型大小和序列长度进行了各种实验。无论输入序列长度如何,Lightning Attention 2 都能保持一致的训练和推理速度,并且比其他注意力机制要快得多。 |

| Agent Alignment in Evolving Social Norms Authors Shimin Li, Tianxiang Sun, Xipeng Qiu 基于大语言模型的代理法学硕士越来越多地渗透到人类生产和生活的各个领域,凸显了将其与人类价值观保持一致的重要性。目前人工智能系统的调整主要集中在通过人为干预被动调整法学硕士。然而,智能体具有接收环境反馈和自我进化等特征,使得LLM对齐方法存在不足。为此,我们提出了一种智能体进化和对齐的进化框架,名为EvolutionaryAgent,它将智能体对齐转化为适者生存原则下的进化和选择过程。在社会规范不断发展的环境中,更好地适应当前社会规范的主体将有更高的生存和扩散概率,而那些不充分协调的主体会随着时间的推移而减少。从多个角度评估智能体是否符合社会规范的实验结果表明,EvolutionaryAgent 具有逐步更好地适应不断变化的社会规范的能力,同时保持其对一般任务的熟练程度。 |

| Language Detection for Transliterated Content Authors Selva Kumar S, Afifah Khan Mohammed Ajmal Khan, Chirag Manjeshwar, Imadh Ajaz Banday 在当代数字时代,互联网发挥着无与伦比的催化剂作用,消除了短信中尤其明显的地理和语言障碍。这种演变促进了全球交流,超越物理距离并促进动态的文化交流。一个显着的趋势是音译的广泛使用,即使用英文字母来传达母语信息,这对准确检测源语言的语言技术提出了独特的挑战。本文通过使用 BERT 进行语言分类和使用 Google Translate API 进行音译转换的印地语和俄语电话短信音译成英语的数据集来解决这一挑战。该研究开创了识别和转换音译文本的创新方法,应对数字通信多样化语言环境中的挑战。我们的模型强调了综合数据集对于训练 BERT 等大型语言模型法学硕士的关键作用,展示了在从音译文本中准确识别和分类语言方面的卓越能力。我们的模型的验证准确度为 99,稳健的性能凸显了其可靠性。在创新方法和 BERT 等尖端技术的支持下,对音译动态的全面探索使我们的研究处于解决数字通信语言领域独特挑战的前沿。 |

| An Assessment on Comprehending Mental Health through Large Language Models Authors Mihael Arcan, Paul David Niland, Fionn Delahunty 心理健康挑战给个人和社区带来了相当大的全球负担。最近的数据表明,超过 20 名成年人可能在一生中至少遇到一种精神障碍。一方面,大语言模型的进步促进了多样化的应用,但在理解和增强大语言模型在心理健康领域的潜力方面仍然存在巨大的研究差距。另一方面,在各种应用中,一个突出的问题涉及大型语言模型理解自然语言中人类心理健康状况表达的能力。本研究对大型语言模型在解决这一差距方面进行了初步评估。因此,我们将 Llama 2 和 ChatGPT 的性能与经典机器以及深度学习模型进行了比较。 |

| Evaluating Language Model Agency through Negotiations Authors Tim R. Davidson, Veniamin Veselovsky, Martin Josifoski, Maxime Peyrard, Antoine Bosselut, Michal Kosinski, Robert West 公司、组织和政府越来越多地利用语言模型 LM 的卓越功能来显示类似代理的行为。随着语言模型被用来执行自主性不断增强的任务,迫切需要可靠且可扩展的评估基准。当前主要是静态的 LM 基准测试不适合评估此类动态应用程序。因此,我们建议通过谈判博弈的视角共同评估 LM 的性能和一致性。我们认为,这项常见任务更好地反映了现实世界的部署条件,同时提供了对 LM 决策过程的见解。至关重要的是,谈判游戏使我们能够研究多轮、跨模型交互、调节复杂性并避免评估中的意外数据泄漏。我们报告了来自几个主要提供商的六个可公开访问的语言模型在各种谈判游戏中的结果,评估了自我对弈和交叉对弈的表现。 |

| MERA: A Comprehensive LLM Evaluation in Russian Authors Alena Fenogenova, Artem Chervyakov, Nikita Martynov, Anastasia Kozlova, Maria Tikhonova, Albina Akhmetgareeva, Anton Emelyanov, Denis Shevelev, Pavel Lebedev, Leonid Sinev, Ulyana Isaeva, Katerina Kolomeytseva, Daniil Moskovskiy, Elizaveta Goncharova, Nikita Savushkin, Polina Mikhailova, Denis Dimitrov, Alexander Panchenko, Sergei Markov 在过去的几年里,人工智能研究最显着的进步之一是基础模型 FM,其中以语言模型 LM 的兴起为首。随着模型规模的增加,LM 表现出可测量方面的增强以及新定性特征的开发。然而,尽管研究人员关注并且 LM 应用快速增长,但仍需要更好地了解其功能、局限性和相关风险。为了解决这些问题,我们引入了开放的俄语架构多模态评估 MERA,这是一个用于评估面向俄语的基础模型的新指令基准。该基准包含 11 个技能领域的生成模型的 21 项评估任务,并被设计为黑盒测试,以确保排除数据泄漏。本文介绍了一种在零次和少次固定指令设置中评估 FM 和 LM 的方法,该方法可以扩展到其他模式。我们提出了一种评估方法、一个用于 MERA 评估的开源代码库以及一个带有提交系统的排行榜。我们将开放语言模型作为基准进行评估,发现它们仍然远远落后于人类水平。 |

| LUNA: A Framework for Language Understanding and Naturalness Assessment Authors Marat Saidov, Aleksandra Bakalova, Ekaterina Taktasheva, Vladislav Mikhailov, Ekaterina Artemova 自然语言生成 NLG 模型的评估受到越来越多的关注,敦促开发评估生成文本各个方面的指标。 LUNA 通过引入 20 个 NLG 评估指标的统一界面来应对这一挑战。 |

| The Critique of Critique Authors Shichao Sun, Junlong Li, Weizhe Yuan, Ruifeng Yuan, Wenjie Li, Pengfei Liu Critique 作为一种用于评估模型生成内容质量的自然语言描述,已被证明在大型语言模型法学硕士的培训、评估和细化中发挥着重要作用。然而,对于评价批评本身的质量却缺乏原则性的认识。在本文中,我们开创了批评的批评,称为元批评,它是一个从两个方面评估批评的框架,即作为精确分数的事实性和作为回忆分数的综合性。我们计算精确率和召回率的调和平均值作为总体评分,称为 F1 分数。为了获得可靠的评估结果,我们提出了原子信息单元 AIU,它以更细粒度的方式描述批评。 MetaCritique 会考虑每个 AIU,并汇总每个 AIU 的判断以获得总分。此外,鉴于评估过程涉及复杂的推理,我们的 MetaCritique 提供了自然语言的基本原理来支持每个判断。我们构建了一个包含 300 个评论、2653 个 AIU 的元评估数据集,涉及问答、推理、蕴含和总结四个任务,并进行了比较研究以证明可行性和有效性。实验还表明,MetaCritique 判断的卓越批评会带来更好的改进,这表明生成人工智能确实有潜力通过我们的 MetaCritique 得到显着推进。 |

| Exploring Prompt-Based Methods for Zero-Shot Hypernym Prediction with Large Language Models Authors Mikhail Tikhomirov, Natalia Loukachevitch 本文研究了使用大型语言模型 LLM 进行上位词预测的零样本方法。该研究采用了一种基于文本概率计算的方法,并将其应用于各种生成的提示。实验表明,语言模型提示的有效性与经典模式之间存在很强的相关性,这表明可以使用较小的模型进行初步提示选择,然后再转向较大的模型。我们还通过自动识别的共下义词用附加信息来增强提示,从而探索预测共下义词的提示并改进上位词预测。 |

| TechGPT-2.0: A large language model project to solve the task of knowledge graph construction Authors Jiaqi Wang, Yuying Chang, Zhong Li, Ning An, Qi Ma, Lei Hei, Haibo Luo, Yifei Lu, Feiliang Ren 大型语言模型在不同的自然语言处理任务中表现出了强大的性能。本报告介绍了TechGPT 2.0,该项目旨在增强大型语言模型的能力,特别是在知识图谱构建任务中,包括NLP应用中的命名实体识别NER和关系三元组提取RTE任务。此外,它还作为法学硕士可供中国开源模型社区内的研究使用。我们提供两个7B大型语言模型权重和一个专门用于处理长文本的QLoRA权重。值得注意的是,TechGPT 2.0是在华为的Ascend服务器上训练的。它继承了TechGPT 1.0的所有功能,表现出强大的文本处理能力,特别是在医学和法律领域。此外,我们为该模型引入了新功能,使其能够处理地理区域、交通、组织、文学作品、生物学、自然科学、天文物体和建筑等各个领域的文本。这些增强功能还增强了模型处理幻觉、无法回答的查询和冗长文本的能力。本报告全面详细地介绍了华为Ascend服务器的完整微调过程,包括Ascend服务器调试、指令微调数据处理和模型训练的经验。 |

| Continuously Learning New Words in Automatic Speech Recognition Authors Christian Huber, Alexander Waibel 尽管最近取得了一些进展,但自动语音识别 ASR 系统仍远未达到完美。典型错误包括首字母缩略词、命名实体和领域特定的特殊词,这些词的可用数据很少或没有。为了解决识别这些单词的问题,我们提出了一种自我监督的持续学习方法。给定讲座演讲的音频和相应的幻灯片,我们倾向于使用之前工作中的记忆增强 ASR 模型来解码幻灯片中的新单词。然后,我们对谈话进行推理,将包含检测到的新单词的话语收集到适应数据集中。然后通过调整添加到模型的每个权重矩阵的低秩矩阵权重来对该集合执行持续学习。整个过程会在多次会谈中重复进行。 |

| Fighting Fire with Fire: Adversarial Prompting to Generate a Misinformation Detection Dataset Authors Shrey Satapara, Parth Mehta, Debasis Ganguly, Sandip Modha 最近,大型语言模型 LLM(例如 GPT、Bard、Llama 等)在语言生成能力方面取得的成功,可能会导致人们担心它们可能被滥用,通过生成假新闻和传播错误信息来引发大规模骚乱和社区仇恨。由于注释数据需要大量的手动工作,开发错误信息真实数据集的传统方法无法很好地扩展。在本文中,我们提出了一种基于法学硕士的方法,用于创建银标准地面实况数据集以识别错误信息。具体来说,给定一篇可信的新闻文章,我们提出的方法包括提示法学硕士自动生成原始文章的摘要版本。我们提出的方法中的提示充当控制机制,在生成的摘要中生成特定类型的事实不正确性,例如,错误的数量、错误的归因等。为了研究该数据集的有用性,我们进行了一组实验,在其中训练 |

| TransportationGames: Benchmarking Transportation Knowledge of (Multimodal) Large Language Models Authors Xue Zhang, Xiangyu Shi, Xinyue Lou, Rui Qi, Yufeng Chen, Jinan Xu, Wenjuan Han 大语言模型LLM和多模态大语言模型MLLM表现出了出色的通用能力,甚至在法律、经济、交通、医学等许多专业领域表现出了适应性。目前,已经提出了许多特定领域的基准来验证 M LLM 在特定领域的表现。在各个领域中,交通运输在现代社会中发挥着至关重要的作用,因为它影响着经济、环境和数十亿人的生活质量。然而,目前尚不清楚 M LLM 拥有多少交通知识以及他们是否能够可靠地执行交通相关任务。为了解决这一差距,我们提出了 TransportationGames,这是一个精心设计且全面的评估基准,用于评估交通领域的 M LLM。通过综合考虑现实场景中的应用,并参考Bloom分类法的前三个级别,我们通过选定的任务测试了各种M LLM在记忆、理解和应用交通知识方面的表现。实验结果表明,虽然一些模型在某些任务中表现良好,但总体上仍有很大的改进空间。 |

| Estimating Text Similarity based on Semantic Concept Embeddings Authors Tim vor der Br ck, Marc Pouly 由于其易用性和高精度,Word2Vec W2V 词嵌入在单词、句子和整个文档的语义表示以及语义相似度估计方面取得了巨大成功。然而,它们的缺点是它们是直接从表面表征中提取的,不能充分代表人类的思维过程,并且对于高度模糊的单词也表现不佳。因此,我们提出基于 MultiNet 语义网络 SN 形式的语义概念嵌入 CE,解决了这两个缺点。 |

| Chain-of-Table: Evolving Tables in the Reasoning Chain for Table Understanding Authors Zilong Wang, Hao Zhang, Chun Liang Li, Julian Martin Eisenschlos, Vincent Perot, Zifeng Wang, Lesly Miculicich, Yasuhisa Fujii, Jingbo Shang, Chen Yu Lee, Tomas Pfister 使用大型语言模型进行基于表的推理 LLM 是解决许多表理解任务(例如基于表的问答和事实验证)的一个有前途的方向。与通用推理相比,基于表格的推理需要从自由形式问题和半结构化表格数据中提取底层语义。 Chain of Thought 及其类似方法以文本上下文的形式整合了推理链,但如何在推理链中有效利用表格数据仍然是一个悬而未决的问题。我们提出了表链框架,其中表格数据在推理链中明确使用作为中间思想的代理。具体来说,我们指导法学硕士使用上下文学习来迭代生成操作并更新表格以表示表格推理链。因此,法学硕士可以根据之前操作的结果动态规划下一步操作。表格的这种不断演变形成了一条链,显示了给定表格问题的推理过程。该链承载中间结果的结构化信息,从而实现更准确、更可靠的预测。 |

| Probabilistic emotion and sentiment modelling of patient-reported experiences Authors Curtis Murray, Lewis Mitchell, Jonathan Tuke, Mark Mackay 这项研究引入了一种根据在线患者体验叙述来建模患者情绪的新颖方法。我们采用元数据网络主题模型来分析患者报告的护理意见经历,揭示与患者护理人员互动和临床结果相关的关键情感主题。我们开发了一个概率性、上下文特定的情感推荐系统,能够使用朴素贝叶斯分类器(使用上下文有意义的主题作为预测器)来预测多标签情感和二元情感。使用信息检索指标 nDCG 和 Q 度量来评估我们在该模型下预测情绪相对于基线模型的优越性能,我们预测的情绪达到了 0.921 的 F1 分数,显着优于标准情绪词典。该方法提供了一种透明且具有成本效益的方式来了解患者反馈,增强传统收集方法并为个性化患者护理提供信息。 |

| Improving the Robustness of Knowledge-Grounded Dialogue via Contrastive Learning Authors Jiaan Wang, Jianfeng Qu, Kexin Wang, Zhixu Li, Wen Hua, Ximing Li, An Liu 基于知识的对话 KGD 学习根据给定的对话上下文和外部知识 emph 例如生成信息丰富的响应。 ,知识图谱KG。最近,大型语言模型LLM和预训练技术的出现给基于知识的对话带来了巨大的成功。然而,在实际应用中构建KGD系统时,不可避免要面对各种现实世界的噪音。例如,对话上下文可能涉及诸如拼写错误和缩写之类的干扰。此外,知识图谱通常不完整,还可能包含错误和过时的事实。这种现实世界的噪声对 KGD 系统的鲁棒性提出了挑战,并阻碍了它们在现实世界中的应用。在本文中,我们提出了一种基于实体的对比学习框架来提高 KGD 的鲁棒性。具体来说,我们利用 KGD 样本中的实体信息来创建其正样本和负样本,分别涉及语义不相关和语义相关扰动。对比学习框架确保 KGD 模型了解这两种类型的扰动,从而利用实际应用中潜在的噪声输入生成信息丰富的响应。三个基准数据集的实验结果表明,我们的方法在自动评估分数方面实现了新的最先进性能,验证了其有效性和潜力。 |

| LAMPAT: Low-Rank Adaption for Multilingual Paraphrasing Using Adversarial Training Authors Khoi M.Le, Trinh Pham, Tho Quan, Anh Tuan Luu 释义是使用不同单词或句子结构传达相同含义的文本。它可以用作许多自然语言处理任务的自动数据增强工具,特别是在处理低资源语言时,数据短缺是一个严重的问题。为了在多语言环境中生成释义,之前的研究利用了机器翻译领域的知识,即通过相同语言的零样本机器翻译形成释义。尽管在人类评估方面表现良好,但这些方法仍然需要并行翻译数据集,因此不适用于没有并行语料库的语言。为了缓解这个问题,我们提出了第一个无监督多语言释义模型,LAMPAT textbf Lowrank textbf A daptation for textbf Multilingual textbf P araphrasing using textbf A dversarial textbf Training ,通过该模型单语数据集足以生成类似人类的文本多样的句子。在整个实验中,我们发现我们的方法不仅适用于英语,而且还可以推广到未见过的语言。 |

| Know Your Needs Better: Towards Structured Understanding of Marketer Demands with Analogical Reasoning Augmented LLMs Authors Junjie Wang, Dan Yang, Binbin Hu, Yue Shen, Ziqi Liu, Wen Zhang, Jinjie Gu, Zhiqiang Zhang 在本文中,我们探索了一种新的用户定位方式,非专业营销人员可以仅根据自然语言形式的需求来选择目标用户。这个问题的关键是如何将自然语言转化为实用的结构化逻辑语言,即对营销人员需求的结构化理解。考虑到大型语言模型LLM令人印象深刻的自然语言处理能力,我们尝试利用LLM来解决这个问题。以往的研究表明,通过思想链CoT提示可以有效增强法学硕士的推理能力。但现有的方法仍然存在一定的局限性 1 以往的方法要么使用简单的 Let s think step by step 拼写,要么在演示中提供固定示例,没有考虑提示和问题之间的兼容性,使得 LLM 在结构化语言转换等一些复杂的推理任务中效果不佳。 2 以往的方法往往是在闭源模型或过大的模型中实现,不适合工业实际场景。 |

| MARG: Multi-Agent Review Generation for Scientific Papers Authors Mike D Arcy, Tom Hope, Larry Birnbaum, Doug Downey 我们研究法学硕士为科学论文生成反馈的能力,并开发 MARG,这是一种使用多个参与内部讨论的法学硕士实例的反馈生成方法。通过在代理之间分发论文文本,MARG 可以使用超出基础 LLM 输入长度限制的论文全文,并且通过专门代理并合并针对不同评论类型实验、清晰度和影响量身定制的子任务,它提高了论文的有用性和特异性。反馈。在一项用户研究中,使用 GPT 4 的基线方法在超过一半的情况下被评为产生通用或非常通用的评论,并且在最佳基线中,每篇论文只有 1.7 条评论被评为总体良好。 |

| High-precision Voice Search Query Correction via Retrievable Speech-text Embedings Authors Christopher Li, Gary Wang, Kyle Kastner, Heng Su, Allen Chen, Andrew Rosenberg, Zhehuai Chen, Zelin Wu, Leonid Velikovich, Pat Rondon, Diamantino Caseiro, Petar Aleksic |

| Distortions in Judged Spatial Relations in Large Language Models: The Dawn of Natural Language Geographic Data? Authors Nir Fulman, Abdulkadir Memduho lu, Alexander Zipf 我们提出了一个基准,用于评估大型语言模型法学硕士辨别地理位置之间的基间方向的能力,并将其应用于三个著名的法学硕士 GPT 3.5、GPT 4 和 Llama 2。该基准专门评估法学硕士是否表现出类似于人类对个体位置空间关系的判断受到包含它们的更大群体的感知关系的影响。为了调查这一点,我们针对美国知名城市制定了 14 个问题。设计了七个问题来挑战法学硕士,其场景可能受到较大地理单位(例如州或国家)方向的影响,而其余七个目标位置不太容易受到这种分层分类的影响。在测试的模型中,GPT 4 表现出优越的性能,准确率为 55.3,其次是 GPT 3.5,准确率为 47.3,Llama 2 为 44.7。这些模型显示,在疑似存在层级偏差的任务上,准确性显着降低。例如,GPT 4 在这些任务上的准确度下降至 32.9,而在其他任务上的准确度为 85.7。尽管存在这些不准确之处,但这些模型在大多数情况下都能识别出最近的基本方向,这表明联想学习体现了类似人类的误解。 |

| Applying Large Language Models API to Issue Classification Problem Authors Gabriel Aracena, Kyle Luster, Fabio Santos, Igor Steinmacher, Marco A. Gerosa 在软件工程中,问题报告的有效优先级对于优化资源分配和及时解决关键问题至关重要。然而,对问题报告进行手动分类以确定优先级非常费力并且缺乏可扩展性。或者,许多开源软件 OSS 项目采用自动化流程来完成此任务,尽管依赖大量数据集进行充分训练。这项研究旨在设计一种自动化方法,即使在较小的数据集上进行训练,也能确保问题优先级划分的可靠性。我们提出的方法利用了生成式预训练 Transformers GPT 的力量,认识到它们有效处理此任务的潜力。通过利用此类模型的功能,我们的目标是开发一个强大的系统,准确地对问题报告进行优先级排序,减少对大量培训数据的需求,同时保持可靠性。在我们的研究中,我们开发了一种可靠的基于 GPT 的方法,通过减少训练数据集来准确标记问题报告并确定问题报告的优先级。通过减少对海量数据需求的依赖并专注于少量微调,我们的方法为软件工程中的问题优先级排序提供了更易于访问和更有效的解决方案。 |

| DebugBench: Evaluating Debugging Capability of Large Language Models Authors Runchu Tian, Yining Ye, Yujia Qin, Xin Cong, Yankai Lin, Zhiyuan Liu, Maosong Sun 大型语言模型法学硕士展示了卓越的编码能力。然而,作为编程能力的另一个关键组成部分,法学硕士的调试能力仍然相对未被开发。以前对法学硕士调试能力的评估受到数据泄露风险、数据集规模和测试错误种类的严重限制。为了克服这些缺陷,我们引入了 DebugBench,这是一个由 4,253 个实例组成的 LLM 调试基准。它涵盖了 C、Java 和 Python 中的 4 个主要错误类别和 18 个次要类型。为了构建 DebugBench,我们从 LeetCode 社区收集代码片段,使用 GPT 4 将错误植入到源数据中,并确保严格的质量检查。我们在零样本场景中评估了两个商业模型和三个开源模型。我们发现 1 虽然像 GPT 4 这样的闭源模型与人类相比表现出较差的调试性能,但像 Code Llama 这样的开源模型却无法获得任何通过率分数 2 调试的复杂性根据错误类别的不同而显着波动 3 结合了运行时反馈对调试性能有明显影响,但这并不总是有帮助。作为扩展,我们还比较了 LLM 调试和代码生成,揭示了它们之间对于闭源模型的强相关性。 |

| Rewriting the Code: A Simple Method for Large Language Model Augmented Code Search Authors Haochen Li, Xin Zhou, Zhiqi Shen 在代码搜索中,生成增强检索 GAR 框架可生成示例代码片段来增强查询,它已成为解决代码片段和自然语言查询之间模态不一致的主要挑战的一种有前景的策略,特别是通过展示的代码生成功能大型语言模型法学硕士。然而,我们的初步调查表明,这种法学硕士增强框架所带来的改进在某种程度上受到限制。这种限制可能归因于这样一个事实:生成的代码尽管功能准确,但经常显示出与代码库中的真实代码明显的风格偏差。在本文中,我们扩展了基础 GAR 框架,并提出了一种简单而有效的方法,该方法另外重写代码库中的代码 ReCo 以实现样式规范化。实验结果表明,在不同的搜索场景中,ReCo 显着提高了稀疏高达 35.7、零样本密集高达 27.6 以及微调密集高达 23.6 检索设置的检索精度。为了进一步阐明 ReCo 的优势并促进代码风格规范化的研究,我们引入了代码风格相似度,这是第一个专门用于量化代码风格相似度的指标。 |

| TwinBooster: Synergising Large Language Models with Barlow Twins and Gradient Boosting for Enhanced Molecular Property Prediction Authors Maximilian G. Schuh, Davide Boldini, Stephan A. Sieber 药物发现和开发的成功依赖于对分子活性和特性的精确预测。虽然计算机分子特性预测显示出巨大的潜力,但迄今为止其用途仅限于可获得大量数据的分析。在这项研究中,我们使用微调的大型语言模型来整合基于文本信息的生物测定,并结合 Barlow Twins(一种使用新颖的自我监督学习方法的连体神经网络)。该架构使用测定信息和分子指纹来提取真实的分子信息。 TwinBooster 通过提供最先进的零样本学习任务,能够预测看不见的生物测定和分子的特性。值得注意的是,我们的人工智能管道在 FS Mol 基准测试中显示出出色的性能。这一突破展示了深度学习在数据通常稀缺的关键属性预测任务中的应用。 |

| Private Fine-tuning of Large Language Models with Zeroth-order Optimization Authors Xinyu Tang, Ashwinee Panda, Milad Nasr, Saeed Mahloujifar, Prateek Mittal 在私人数据集上微调大型预训练模型可能会面临侵犯隐私的风险。差异隐私是一种通过增强算法稳定性来减轻隐私风险的框架。 DP SGD 能够以保护隐私的方式使用私有数据训练模型,但也带来了性能损失和重大工程挑战等新障碍。我们引入 DP ZO,这是一种微调大型语言模型的新方法,通过私有化零阶优化来保护训练数据的隐私。我们方法设计的一个关键见解是,我们使用的零阶算法 SPSA 中的梯度方向始终是随机的,唯一依赖于私有数据的信息是步长,即标量。因此,我们只需要私有化标量步长,这样可以节省内存。 DP ZO 可以用拉普拉斯噪声或高斯噪声实例化,在保守的隐私预算下,在不同任务和模型大小之间提供强大的隐私效用权衡。 |

| Vision Reimagined: AI-Powered Breakthroughs in WiFi Indoor Imaging Authors Jianyang Shi, Bowen Zhang, Amartansh Dubey, Ross Murch, Liwen Jing 室内成像是机器人和物联网的一项关键任务。 WiFi 作为一种无所不在的信号,是执行被动成像并将最新信息同步到所有连接设备的有前途的候选者。这是第一个将 WiFi 室内成像视为多模态图像生成任务的研究工作,将测量的 WiFi 功率转换为高分辨率室内图像。我们提出的 WiFi GEN 网络的形状重建精度是基于物理模型的反演方法的 275 倍。此外,Frechet Inception Distance 分数显着降低了 82 。为了检查该任务模型的有效性,发布了第一个大规模数据集,其中包含 80,000 对 WiFi 信号和成像目标。我们的模型吸收了基于模型的方法的挑战,包括非线性、不适定性和不确定性到我们的生成人工智能网络的大量参数中。该网络还旨在最适合测量的 WiFi 信号和所需的成像输出。 |

| FunnyNet-W: Multimodal Learning of Funny Moments in Videos in the Wild Authors Zhi Song Liu, Robin Courant, Vicky Kalogeiton 自动理解有趣的时刻,即观看喜剧时让人发笑的时刻具有挑战性,因为它们与各种特征有关,例如肢体语言、对话和文化。在本文中,我们提出了FunnyNet W,这是一种依赖于视觉、音频和文本数据的交叉和自注意力来预测视频中有趣时刻的模型。与大多数依赖字幕形式的真实数据的方法不同,在这项工作中,我们利用视频自然产生的模式,视频帧因为它们包含场景理解所必需的视觉信息,b音频因为它包含与有趣相关的更高级别的线索诸如语调、音高和停顿之类的时刻以及使用语音转文本模型自动提取的 c 文本,因为它在由大型语言模型处理时可以提供丰富的信息。为了获取训练标签,我们提出了一种无监督的方法,可以发现并标记有趣的音频时刻。我们提供了五个数据集的实验:情景喜剧 TBBT、MHD、MUStARD、Friends 和 TED 演讲 URunny。大量的实验和分析表明,FunnyNet W 成功地利用视觉、听觉和文本线索来识别有趣的时刻,而我们的研究结果表明,FunnyNet W 具有预测野外有趣时刻的能力。 |

| Large language models in bioinformatics: applications and perspectives Authors Jiajia Liu, Mengyuan Yang, Yankai Yu, Haixia Xu, Kang Li, Xiaobo Zhou 大型语言模型LLM是一类基于深度学习的人工智能模型,在各种任务中都具有出色的性能,尤其是在自然语言处理NLP方面。大型语言模型通常由具有大量参数的人工神经网络组成,使用自监督或半监督学习对大量未标记的输入进行训练。然而,他们解决生物信息学问题的潜力甚至可能超过他们对人类语言建模的熟练程度。在这篇综述中,我们将总结自然语言处理中使用的著名大语言模型,例如BERT和GPT,并重点探索大语言模型在生物信息学中不同组学层面的应用,主要包括大语言的应用基因组学、转录组学、蛋白质组学、药物发现和单细胞分析中的模型。 |

| Cross-Speaker Encoding Network for Multi-Talker Speech Recognition Authors Jiawen Kang, Lingwei Meng, Mingyu Cui, Haohan Guo, Xixin Wu, Xunying Liu, Helen Meng 端到端多说话者语音识别作为直接转录多个说话者重叠语音的有效方法引起了人们的极大兴趣。当前的方法通常采用具有分支编码器的 1 个单输入多输出 SIMO 模型,或基于具有串行输出训练 SOT 的基于注意力的编码器解码器架构的 2 个单输入单输出 SISO 模型。在这项工作中,我们提出了一种跨说话人编码 CSE 网络,通过聚合跨说话人表示来解决 SIMO 模型的局限性。此外,CSE模型与SOT集成,以利用SIMO和SISO的优点,同时减轻它们的缺点。据我们所知,这项工作代表了集成 SIMO 和 SISO 以实现多说话者语音识别的早期努力。在两个说话人的 LibrispeechMix 数据集上进行的实验表明,CES 模型在 SIMO 基线的基础上将单词错误率 WER 降低了 8 个。 |

| Chain of LoRA: Efficient Fine-tuning of Language Models via Residual Learning Authors Wenhan Xia, Chengwei Qin, Elad Hazan 微调是针对特定任务定制预训练大型语言模型的主要方法。随着模型规模和任务多样性的扩大,参数高效的微调方法变得至关重要。使用最广泛的方法系列之一是低阶自适应 LoRA 及其变体。 LoRA 将权重更新编码为两个低秩矩阵的乘积。 |

| Generation Z's Ability to Discriminate Between AI-generated and Human-Authored Text on Discord Authors Dhruv Ramu, Rishab Jain, Aditya Jain ChatGPT 等生成式人工智能 AI 聊天机器人的日益普及正在对社交媒体产生变革性影响。随着人工智能生成内容的普及,人们对在线隐私和错误信息产生了担忧。在社交媒体平台中,Discord 支持人工智能集成,使其主要的 Z 世代用户群特别容易接触到人工智能生成的内容。我们调查了 335 名 Z 世代老年人,以评估他们在 Discord 上区分人工智能生成的文本和人类创作的文本的能力。 |

| Working with Trouble and Failures in Conversation between Humans and Robots (WTF 2023) & Is CUI Design Ready Yet? Authors Frank F rster, Marta Romeo, Patrick Holthaus, Maria Jose Galvez Trigo, Joel E. Fischer, Birthe Nesset, Christian Dondrup, Christine Murad, Cosmin Munteanu, Benjamin R. Cowan, Leigh Clark, Martin Porcheron, Heloisa Candello, Raina Langevin |

| Chinese Abs From Machine Translation |

Papers from arxiv.org

更多精彩请移步主页

pic from pexels.com

![[足式机器人]Part2 Dr. CAN学习笔记-Advanced控制理论 Ch04-6 线性控制器设计Linear Controller Design](https://img-blog.csdnimg.cn/direct/aa4127cd77cd4c14a64ac0c899edbef3.png#pic_center)