更多资料获取

📚 个人网站:ipengtao.com

特征工程是机器学习中至关重要的一环,而Feature Engine库作为Python中的强大特征工程工具,提供了丰富的功能和灵活的操作。本文将深入探讨Feature Engine的各种特性,包括缺失值处理、变量转换、特征选择等,通过详细的示例代码,助力读者更好地理解和应用Feature Engine库。

安装与基础使用

首先,需要安装Feature Engine库:

pip install feature-engine

Feature Engine支持多种特征工程技术,其中一个基础的示例是对缺失值的处理:

from feature_engine.missing_data_imputers import MeanMedianImputer

import pandas as pd

# 创建示例数据

data = {'A': [1, 2, None, 4, 5],

'B': [10, None, 30, 40, 50]}

df = pd.DataFrame(data)

# 使用均值填充缺失值

imputer = MeanMedianImputer(imputation_method='mean', variables=['A', 'B'])

df = imputer.fit_transform(df)

变量转换与特征选择

Feature Engine支持多种变量转换和特征选择技术,例如使用Box-Cox进行幂变换:

from feature_engine.transformation import PowerTransformer

import numpy as np

# 创建示例数据

data = {'A': np.random.exponential(size=1000)}

df = pd.DataFrame(data)

# 使用Box-Cox进行幂变换

transformer = PowerTransformer(variables=['A'])

df = transformer.fit_transform(df)

分箱与编码

Feature Engine提供了分箱(binning)和编码(encoding)等高级特征工程技术。以下是一个分箱和WOE编码的示例:

from feature_engine.discretisation import EqualWidthDiscretiser

from feature_engine.encoding import WoERatioEncoder

# 创建示例数据

data = {'A': np.random.normal(50, 20, 1000),

'target': np.random.choice([0, 1], size=1000)}

df = pd.DataFrame(data)

# 使用等宽分箱

discretiser = EqualWidthDiscretiser(bins=5, variables=['A'])

df['A'] = discretiser.fit_transform(df)

# 使用WOE编码

encoder = WoERatioEncoder(variables=['A'])

df = encoder.fit_transform(df, df['target'])

时间特征工程

对于时间序列数据,Feature Engine也提供了方便的特征工程功能,例如创建时间特征:

from feature_engine.creation import TimeFeaturesExtractor

# 创建示例数据

data = {'date': pd.date_range('2022-01-01', periods=5, freq='D')}

df = pd.DataFrame(data)

# 提取时间特征

extractor = TimeFeaturesExtractor(features_to_extract=['year', 'month', 'day'])

df = extractor.fit_transform(df)

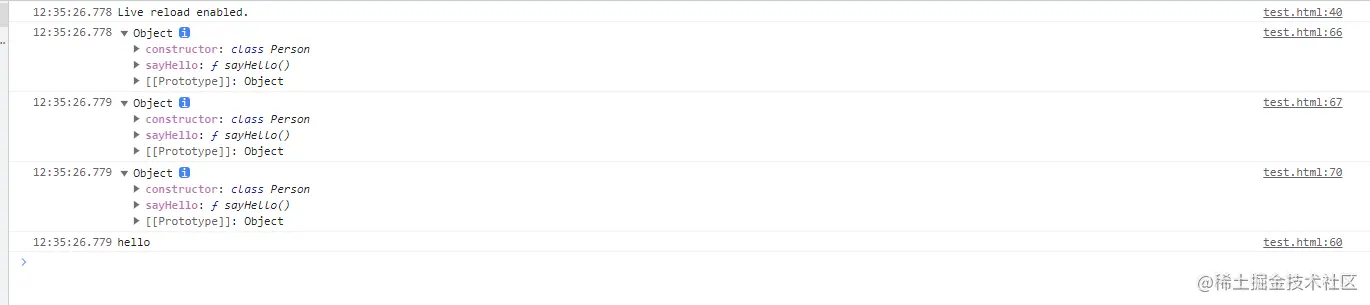

性能比较

在特征工程中,性能是关键因素之一。Feature Engine库通过优化算法和实现高效的数据处理机制,旨在提供高性能的特征工程功能。为了清晰展示Feature Engine在性能方面的优势,将进行一些常见操作的执行时间比较,与原生Python代码相对比。

示例比较:缺失值处理

考虑一个场景,有一个包含大量数据的DataFrame,其中存在缺失值。首先,将使用Feature Engine的缺失值处理功能:

from feature_engine.missing_data_imputers import MeanMedianImputer

import pandas as pd

import time

# 创建大型数据集

data = {'A': [1, 2, None, 4, 5] * 10000,

'B': [10, None, 30, 40, 50] * 10000}

df = pd.DataFrame(data)

# 使用Feature Engine处理缺失值

start_time = time.time()

imputer = MeanMedianImputer(imputation_method='mean', variables=['A', 'B'])

df = imputer.fit_transform(df)

end_time = time.time()

print(f"Feature Engine缺失值处理时间:{end_time - start_time} 秒")

接下来,将使用原生Python代码进行相同的缺失值处理:

import pandas as pd

import time

# 创建大型数据集

data = {'A': [1, 2, None, 4, 5] * 10000,

'B': [10, None, 30, 40, 50] * 10000}

df = pd.DataFrame(data)

# 使用原生Python代码处理缺失值

start_time = time.time()

df['A'].fillna(df['A'].mean(), inplace=True)

df['B'].fillna(df['B'].mean(), inplace=True)

end_time = time.time()

print(f"原生Python缺失值处理时间:{end_time - start_time} 秒")

通过比较两者的执行时间,我们可以清晰地看到Feature Engine在大规模数据处理中的效率优势。

实际应用场景

Feature Engine的真实应用场景广泛,它在数据预处理和特征工程中的实际应用可以解决许多常见问题。以下是一些实际场景的示例,展示Feature Engine的强大功能:

场景一:缺失值处理

在现实数据中,缺失值处理是一个常见的问题。Feature Engine提供了多种处理策略,如均值、中位数、众数填充,使得在实际应用中可以轻松应对缺失值的挑战。

from feature_engine.missing_data_imputers import MeanMedianImputer

import pandas as pd

# 示例数据集

data = {'A': [1, 2, None, 4, 5],

'B': [10, None, 30, 40, 50]}

df = pd.DataFrame(data)

# 使用均值填充缺失值

imputer = MeanMedianImputer(imputation_method='mean', variables=['A', 'B'])

df = imputer.fit_transform(df)

场景二:特征编码

在机器学习中,对分类变量进行编码是一个关键步骤。Feature Engine支持多种编码方法,如独热编码、标签编码、目标编码等,使得在处理分类变量时更加灵活。

from feature_engine.encoding import OneHotEncoder

import pandas as pd

# 示例数据集

data = {'Category': ['A', 'B', 'A', 'C', 'B']}

df = pd.DataFrame(data)

# 使用独热编码

encoder = OneHotEncoder(variables=['Category'])

df = encoder.fit_transform(df)

场景三:分箱与特征选择

在建模之前,对连续型特征进行分箱(binning)和特征选择是常见的步骤。Feature Engine提供了EqualWidthDiscretiser、DecisionTreeDiscretiser等分箱方法,以及VarianceThresholdSelector等特征选择方法,帮助用户更好地准备数据。

from feature_engine.discretisation import EqualWidthDiscretiser

from feature_engine.selection import VarianceThresholdSelector

import pandas as pd

# 示例数据集

data = {'A': [1, 2, 3, 4, 5],

'B': [0, 0, 0, 0, 0],

'C': [1, 1, 1, 1, 1]}

df = pd.DataFrame(data)

# 使用等宽分箱和方差选择

discretiser = EqualWidthDiscretiser(bins=3, variables=['A'])

selector = VarianceThresholdSelector(threshold=0.1)

df = discretiser.fit_transform(df)

df = selector.fit_transform(df)

性能优化与最佳实践

在处理大规模数据集时,性能优化是确保Feature Engine高效运行的关键。以下是一些优化策略和最佳实践,充分发挥Feature Engine的潜力:

1. 批处理

对于大规模数据集,考虑采用批处理的方式进行特征工程操作。通过将数据集分成小批次处理,可以降低内存使用,并提高处理速度。

# 示例:批处理缺失值填充

chunk_size = 1000

imputer = MeanMedianImputer(imputation_method='mean', variables=['A', 'B'])

for chunk in pd.read_csv('large_dataset.csv', chunksize=chunk_size):

chunk = imputer.fit_transform(chunk)

# 在此添加其他特征工程操作

# ...

# 合并处理后的结果

final_result = pd.concat(chunks)

2. 并行处理

利用并行计算的能力,可以加速特征工程的执行。Feature Engine的一些操作支持多线程处理,可以通过设置参数来启用并行计算。

# 示例:并行处理缺失值填充

imputer = MeanMedianImputer(imputation_method='mean', variables=['A', 'B'], concurrent='processes')

df = imputer.fit_transform(df)

3. 内存管理

在处理大型数据集时,注意内存的使用情况。避免不必要的数据复制和冗余,确保使用适当的数据类型,以降低内存占用。

# 示例:合适的数据类型

df['Column'] = df['Column'].astype('int32')

4. 特征选择

对于高维数据集,进行特征选择是一个重要的优化步骤。使用Feature Engine的特征选择器,可以排除对模型贡献较小的特征,从而减小数据集的维度。

# 示例:方差选择

from feature_engine.selection import VarianceThresholdSelector

selector = VarianceThresholdSelector(threshold=0.1)

df = selector.fit_transform(df)

5. 持续监控性能

在实际应用中,持续监控性能是优化的关键。通过记录执行时间、内存使用情况等指标,可以及时发现潜在的性能问题,并进行调整。

# 示例:使用timeit库监控执行时间

import timeit

start_time = timeit.default_timer()

# 在此执行Feature Engine操作

df = imputer.fit_transform(df)

end_time = timeit.default_timer()

print(f"特征工程执行时间:{end_time - start_time} 秒")

总结

在本文中,深入研究了Feature Engine库的各项特性和实际应用场景,旨在帮助大家更好地理解和运用这一强大的特征工程工具。首先介绍了库的基本安装和使用方法,然后通过丰富的示例代码展示了Feature Engine在缺失值处理、特征编码、分箱与特征选择、时间特征工程等方面的应用。

通过性能比较,清晰展示了Feature Engine在处理大规模数据时的效率优势,以及它相对于原生Python代码的优越性能。在性能优化与最佳实践部分,我们提供了一系列策略,以确保在实际应用中充分发挥Feature Engine的潜力,包括批处理、并行处理、内存管理、特征选择等方面的建议。

总的来说,Feature Engine作为Python中强大的特征工程库,为数据科学家和机器学习从业者提供了丰富的功能和灵活的操作。通过学习本文中的示例和最佳实践,将更加熟练地运用Feature Engine,提升机器学习项目中的特征工程质量和效率。无论是处理缺失值、进行特征编码,还是在大规模数据集上进行性能优化,Feature Engine都为数据处理提供了全面而强大的解决方案。

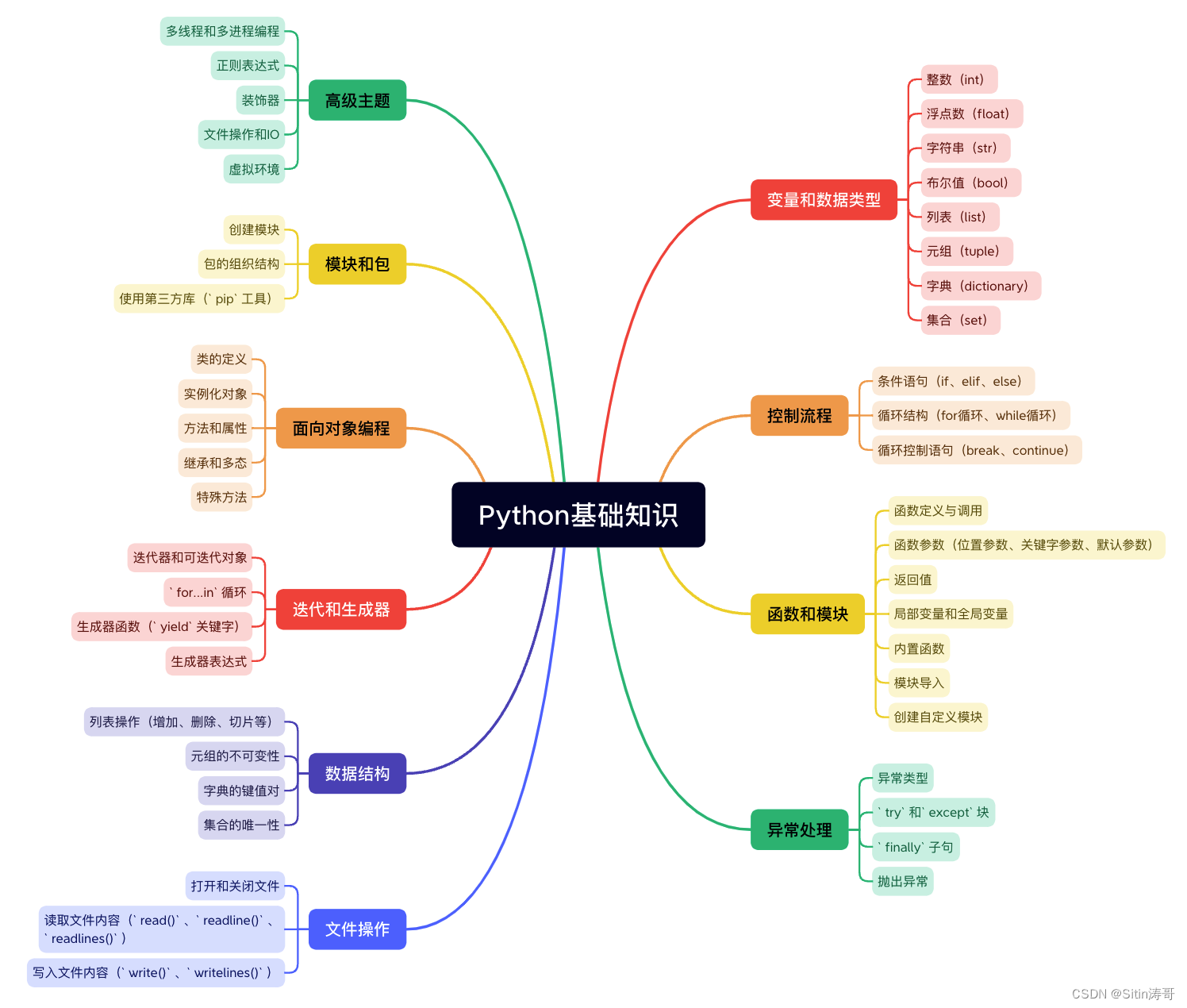

Python学习路线

更多资料获取

📚 个人网站:ipengtao.com

如果还想要领取更多更丰富的资料,可以点击文章下方名片,回复【优质资料】,即可获取 全方位学习资料包。

点击文章下方链接卡片,回复【优质资料】,可直接领取资料大礼包。

![[BUUCTF 2018]Online Tool1](https://img-blog.csdnimg.cn/direct/0a8a246dcfbf4aecb86ef040eec27fab.png)