目录

高性能应用服务HAI_GPU云服务器的申请与服务创建

官网地址:高性能应用服务HAI_GPU云服务器_腾讯云

通过高性能应用服务HAI——创建【stable diffusion】

WebUI效果:

服务器后台效果:

stable-diffusion服务测试

启动接口服务

配置外网访问:

访问官方提供的【swagger接口】

高级视频封面——效果图

总结

高性能应用服务HAI_GPU云服务器的申请与服务创建

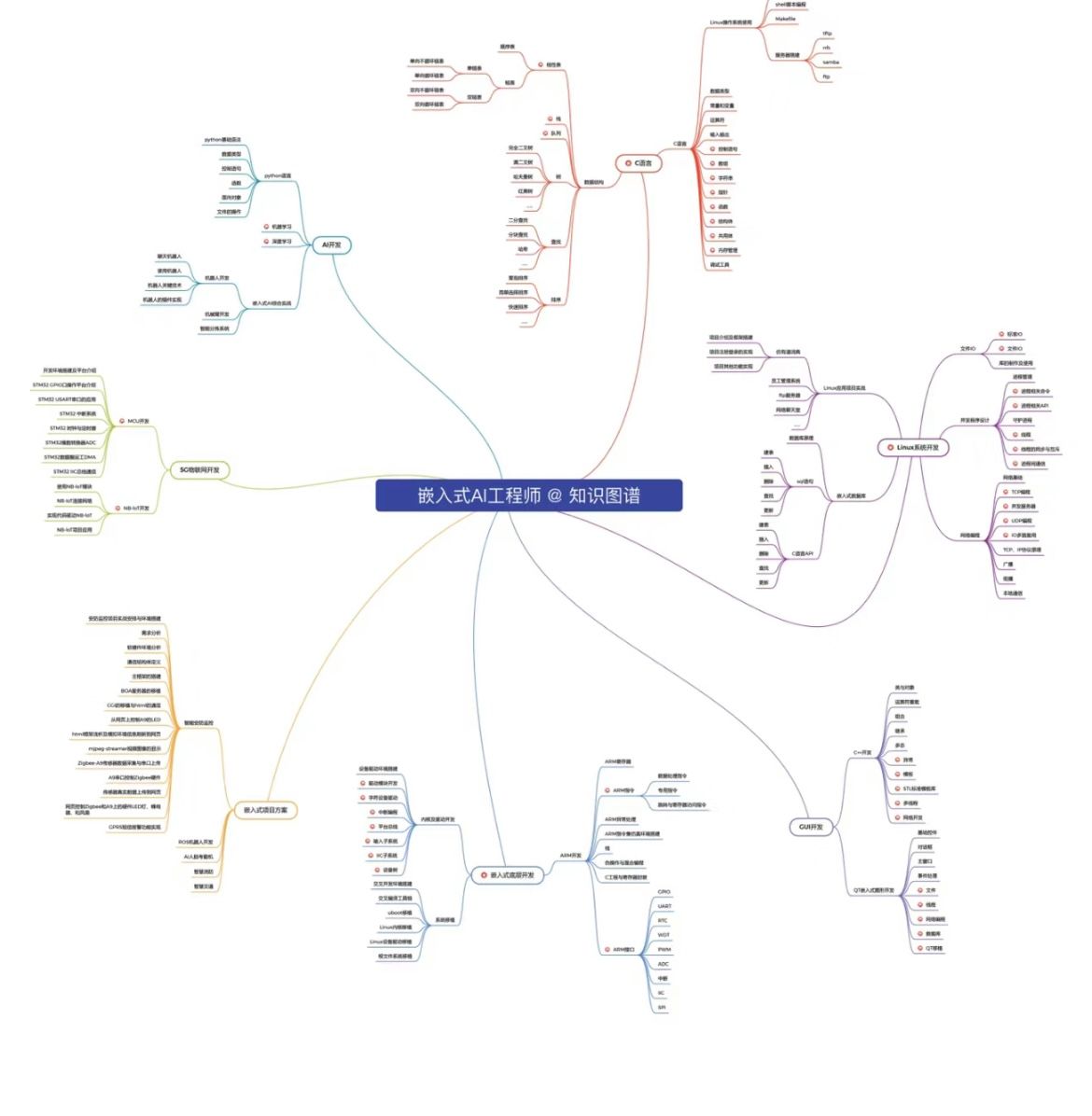

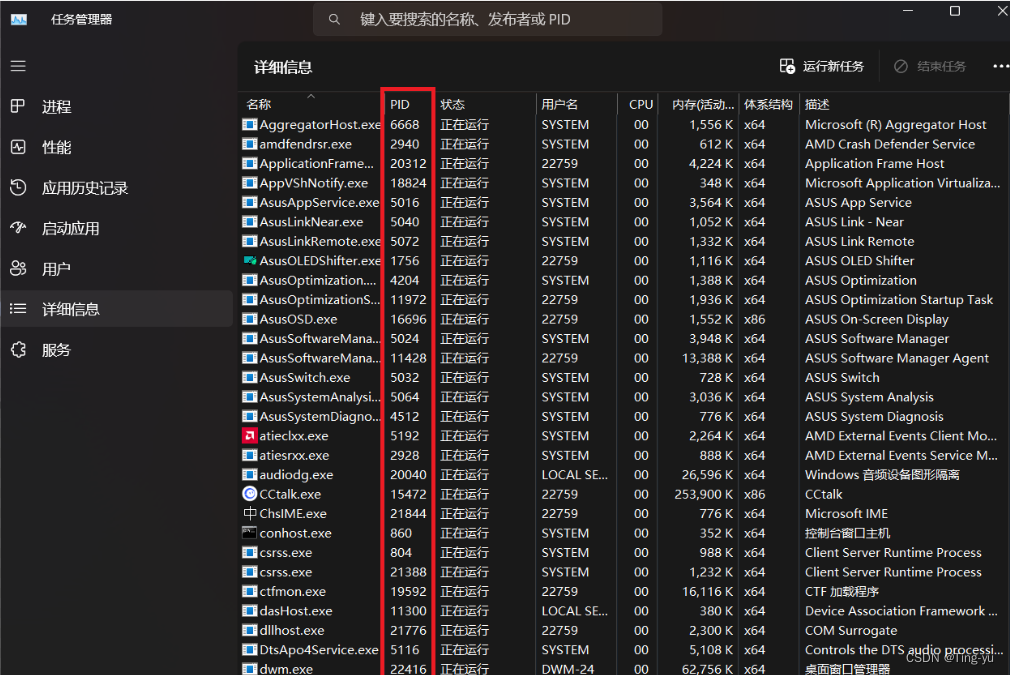

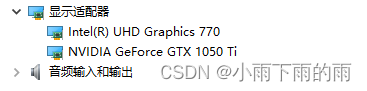

大家都知道当前最火热的就是AI课程的学习,但是AI吃显卡啊,例如我的:

想学习都没办法。。。现在有了,我就可以继续我的AI学习之旅了。

官网地址:高性能应用服务HAI_GPU云服务器_腾讯云

腾讯云出了个——高性能应用服务HAI_GPU云服务器,有了这个服务器我也能跑一跑【stable diffusion】 来生成一些想要的图片啦——开心。

服务器抢购火爆,想抢个高性能的的等待啊。。。

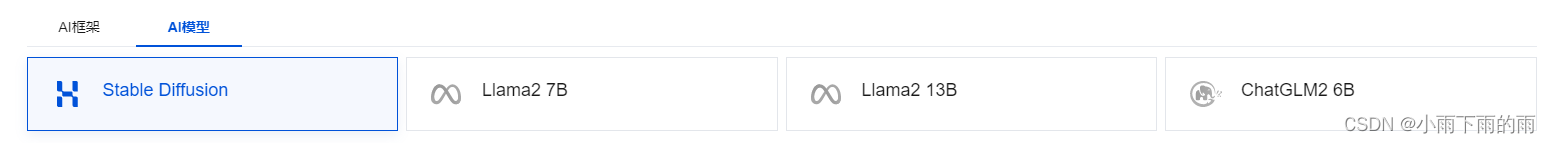

通过高性能应用服务HAI——创建【stable diffusion】

输入名称,选择版本,点击购买即可。

这里创建的时候是需要一些时间的,我们稍等一会。

启动完成,在【算力链接】的下拉菜单中我们能看到【WebUI】,那就代表可以直接操作了呢。非常棒。

WebUI效果:

服务器后台效果:

在页面操作中点击【JupyterLab】

在后台我们能看到【stable diffusion的所有代码】

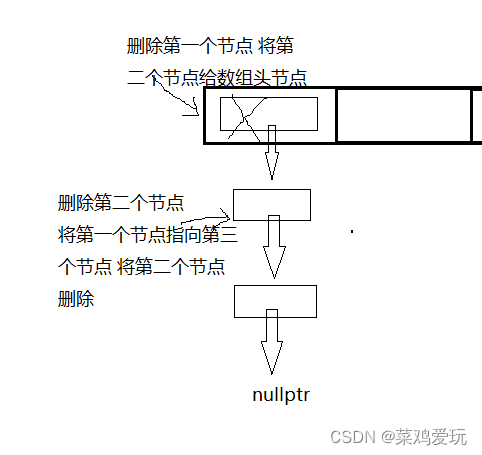

stable-diffusion服务测试

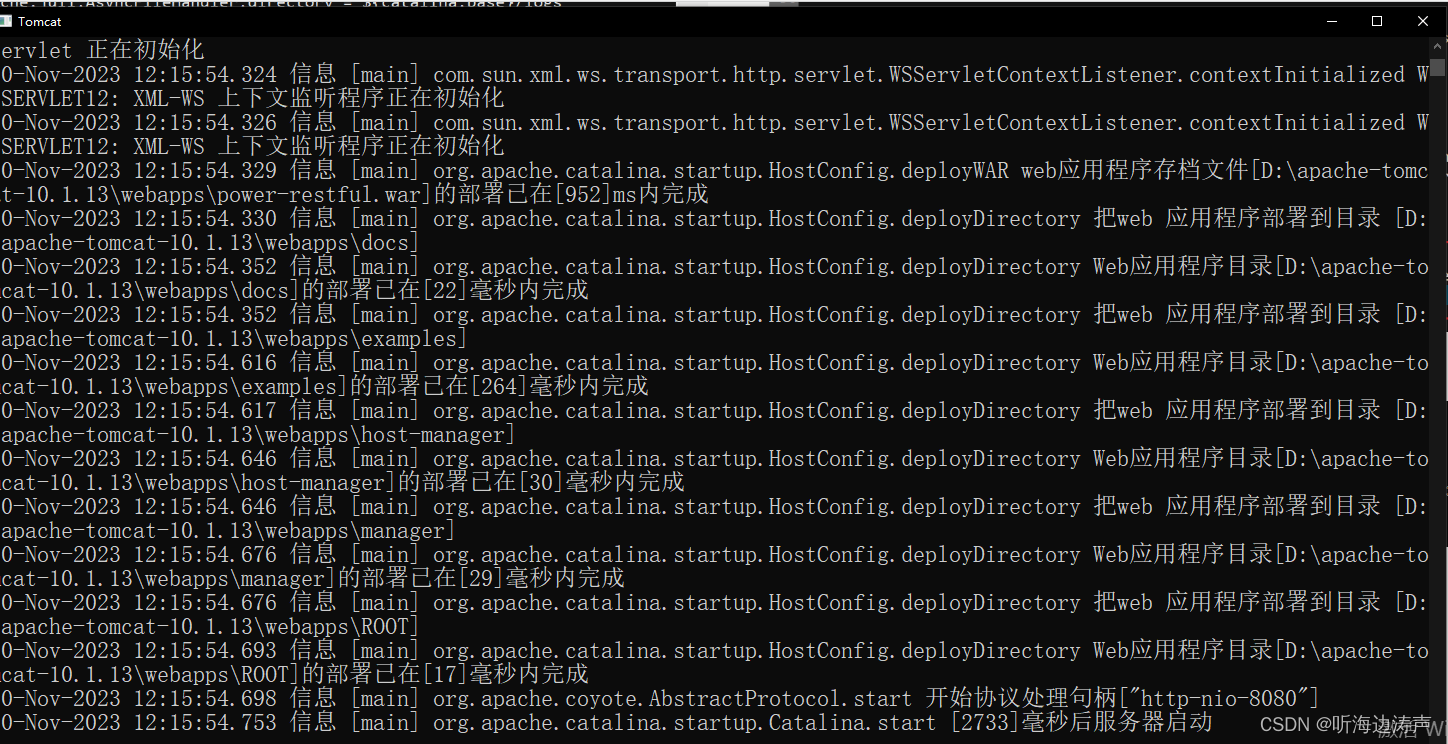

启动接口服务

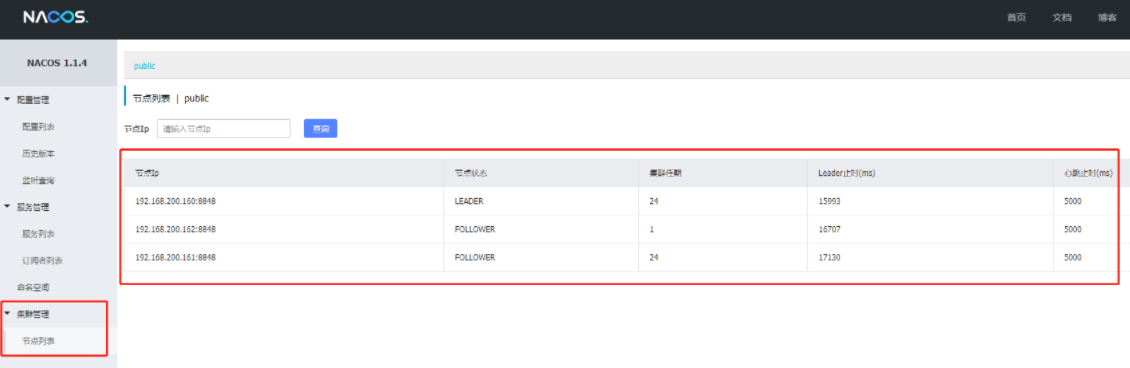

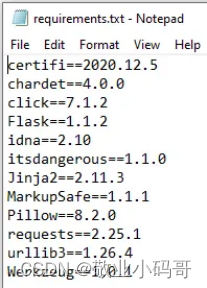

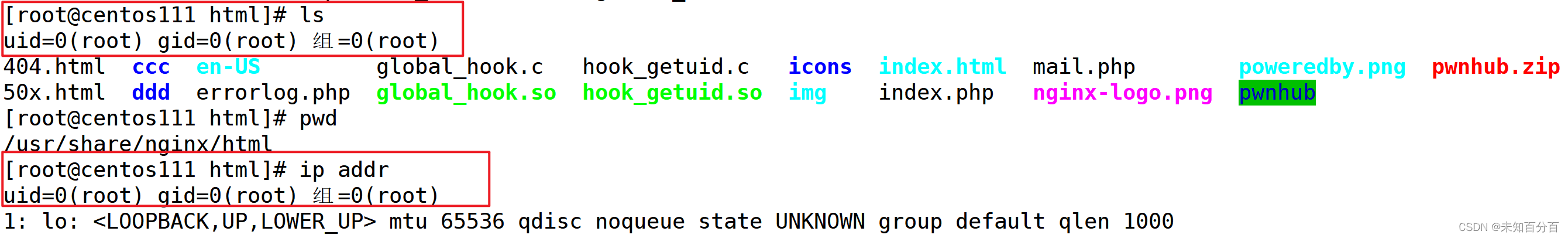

这里我们进入到【/root/stable-diffusion-webui】中,启动launch.py文件,给端口号设置是7862,对应的我们应该去服务中去配置7862的端口权限。

cd /root/stable-diffusion-webui

python launch.py --nowebui --xformers --opt-split-attention --listen --port 7862

配置外网访问:

编辑规则位置:

添加规则:

添加我们开启端口的TCP访问权限

添加完毕效果:

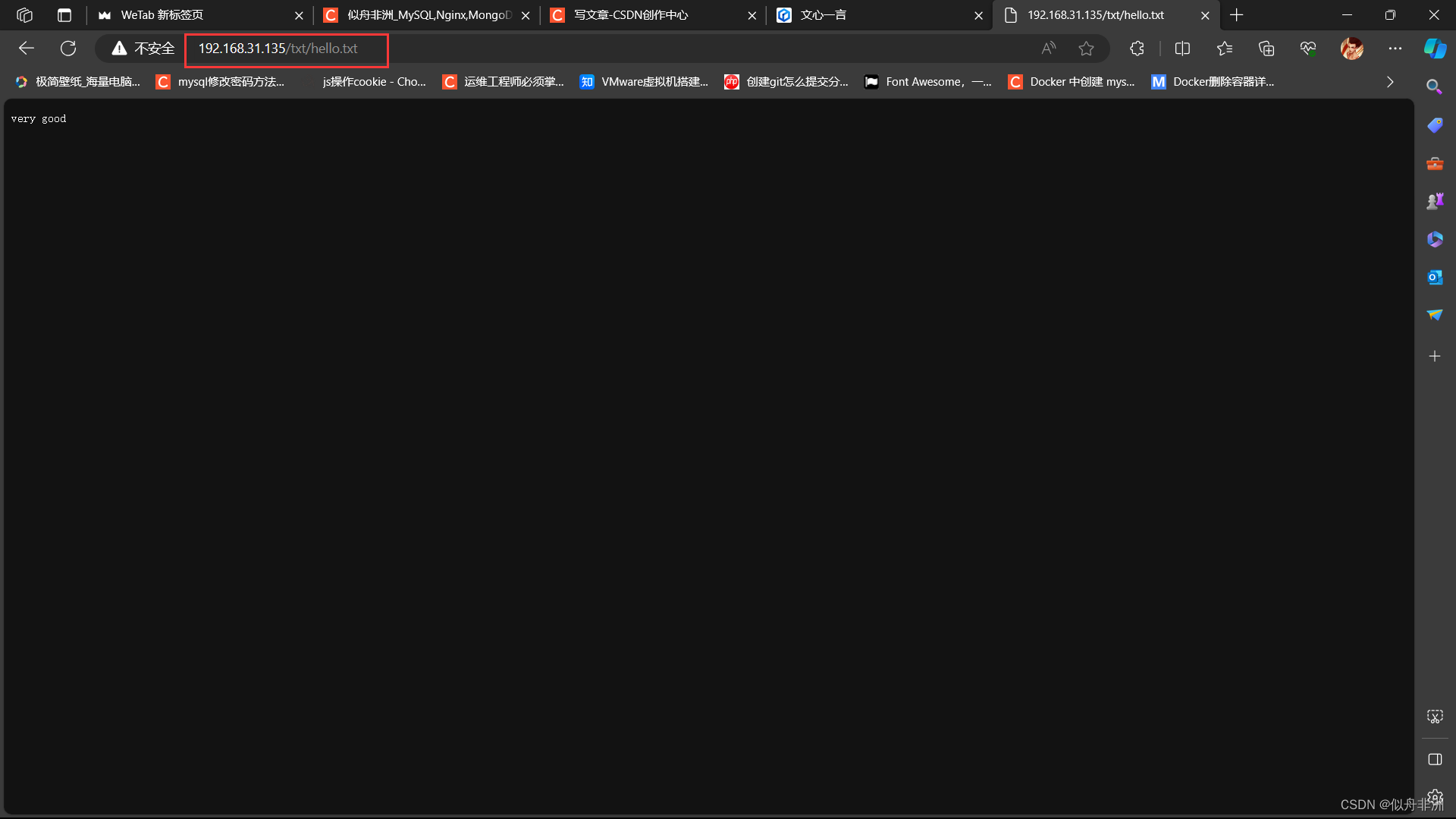

访问官方提供的【swagger接口】

接口很多,用手机截图看的多。我们主要使用前两个接口啊。

每次访问都有结果响应:

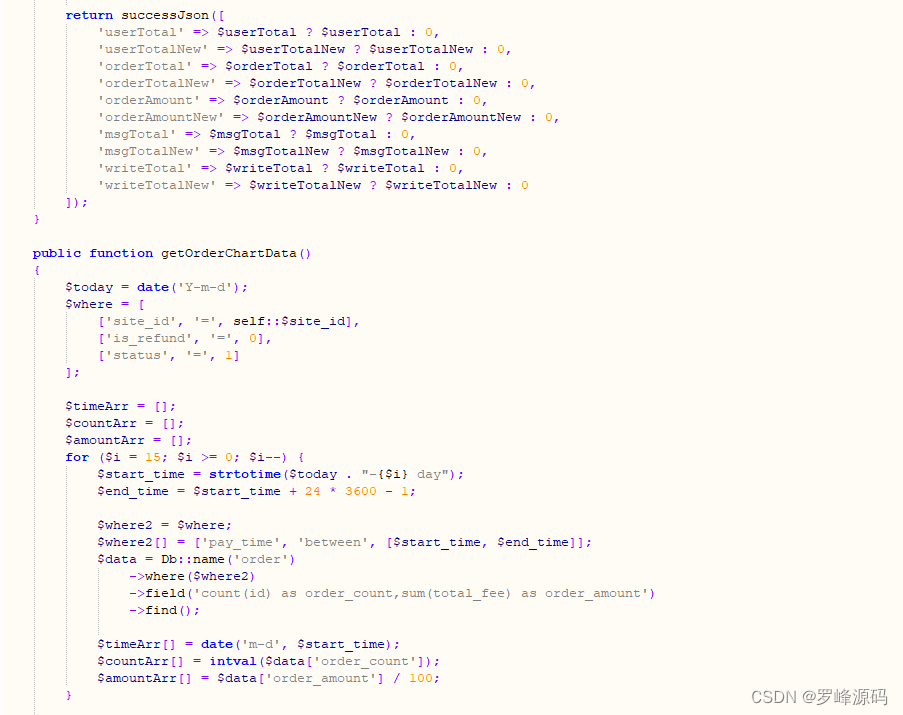

根据官网的swagger接口我们可以调用测试,这是示例代码,需要更换IP地址。

import json

import base64

import requests

your_ip = '0.0.0.0' # HAI服务器IP地址

your_port = 7862 # SD api 监听的端口

def submit_post(url: str,data: dict):

"""

Submit a POST request to the given URL with the given data.

"""

return requests.post(url,data=json.dumps(data))

def save_encoded_image(b64_image: str,output_path: str):

"""

Save the given image to the given output path.

"""

with open(output_path,"wb") as image_file:

image_file.write(base64.b64decode(b64_image))

if __name__ == '__main__':

# /sdapi/v1/txt2img

txt2img_url = f'http://{your_ip}:{your_port}/sdapi/v1/txt2img'

data = {

'prompt': 'a girl',

'negative_prompt':'(deformed,distorted,disfigured:1.0),poorly drawn,bad anatomy,wrong anatomy,extra limb,missing limb,floating limbs,(mutated hands and fingers:1.5),disconnected limbs,mutation,mutated,ugly,disgusting,blurry,amputation,flowers,human,man,woman',

'Steps':50,

'Seed':-1

}

response = submit_post(txt2img_url,data)

save_encoded_image(response.json()['images'][0],'girl.png')

测试效果:

高级视频封面——效果图

我生成了一些,把效果好的发出来了,也有很多效果差的,但是我已经感受过使用的快乐了呢。看着还都挺美的呢。

不太美的图:

生成提示词:

(high quality:1.1), (masterpieces:1.1), wallpaper, 8k, ultra detaled,cutting paper art, (radical simplism), the sea, sea mew, [sea wave], jianzhi, (tartrazine and lavender:1.1), Fresh and natural color scheme, (Morandi tone:1.4),

反向提示词:

EasyNegative, poor quality, bad quality, low image quality, humans, monochrome, grayness, frames, watermark, pixelization signature

总结

首先,HAI_GPU云服务器为用户提供了一个即插即用的应用环境。相较于传统的GPU云服务器,用户无需在繁杂的机型选择、环境部署和资源配置中迷失方向。HAI为用户自动匹配最合适的GPU算力资源,同时打通了必备云服务组件,大大简化了云服务的配置流程。

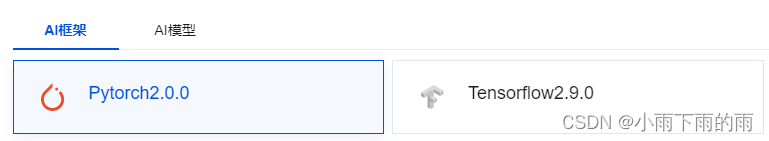

其次,HAI_GPU云服务器真正实现了分钟级的快速启动。传统的GPU云服务器需要用户自行部署驱动、CUDA、Python、Notebook等环境依赖,而HAI则直接为用户交付一个可用的应用环境,包含如StableDiffusion、ChatGLM等热门模型。这为用户节省了大量的时间和精力,使其能够更专注于研究和开发工作。

再者,产品的可视化界面也是其亮点之一。HAI_GPU云服务器为开发者提供了一个友好的图形界面,支持JupyterLab、WebUI等多种算力连接方式。这意味着,即使用户没有深厚的运维知识,也能够轻松上手,进行AI研究和调试。

此外,HAI_GPU云服务器在模型甄别和资源更新上也做得相当出色。对于初学者或是对特定领域不太熟悉的用户来说,面对繁多的模型版本可能会感到无所适从。但HAI为用户预置了最新版本的主流模型,并根据应用自动匹配合适的套餐机型,确保用户始终使用的是最新、最合适的资源。

当然,除了上述的这些显著优势外,HAI_GPU云服务器还有一个不可忽视的优点,那就是其广泛的应用场景。无论是AI作画、AI对话/写作,还是AI开发和测试,HAI都能轻松应对,满足各种高性能应用部署场景的需求。

高性能应用服务HAI_GPU云服务器凭借其出色的性能、便捷的使用方式和广泛的应用场景,真正做到了为用户带来无与伦比的体验。它不仅降低了GPU云服务器的使用门槛,还在多个角度优化了产品使用体验,真正做到了开箱即用。对于那些渴望在人工智能和深度学习领域有所建树的用户来说,HAI_GPU云服务器无疑是一个不可或缺的神器。