每周跟踪AI热点新闻动向和震撼发展 想要探索生成式人工智能的前沿进展吗?订阅我们的简报,深入解析最新的技术突破、实际应用案例和未来的趋势。与全球数同行一同,从行业内部的深度分析和实用指南中受益。不要错过这个机会,成为AI领域的领跑者。点击订阅,与未来同行! 订阅:https://rengongzhineng.io/

许多开源的小型语言模型已经发布,这使得在本地运行由SLMs驱动的客户端应用程序成为可能。有一个来自https://ollama.ai/blog/building-llm-powered-web-apps的有趣博客文章。我在我的M1 Mac上尝试了这个方法,结果是令人鼓舞的。

首先,从以下链接安装Ollama的Mac版本: Ollama

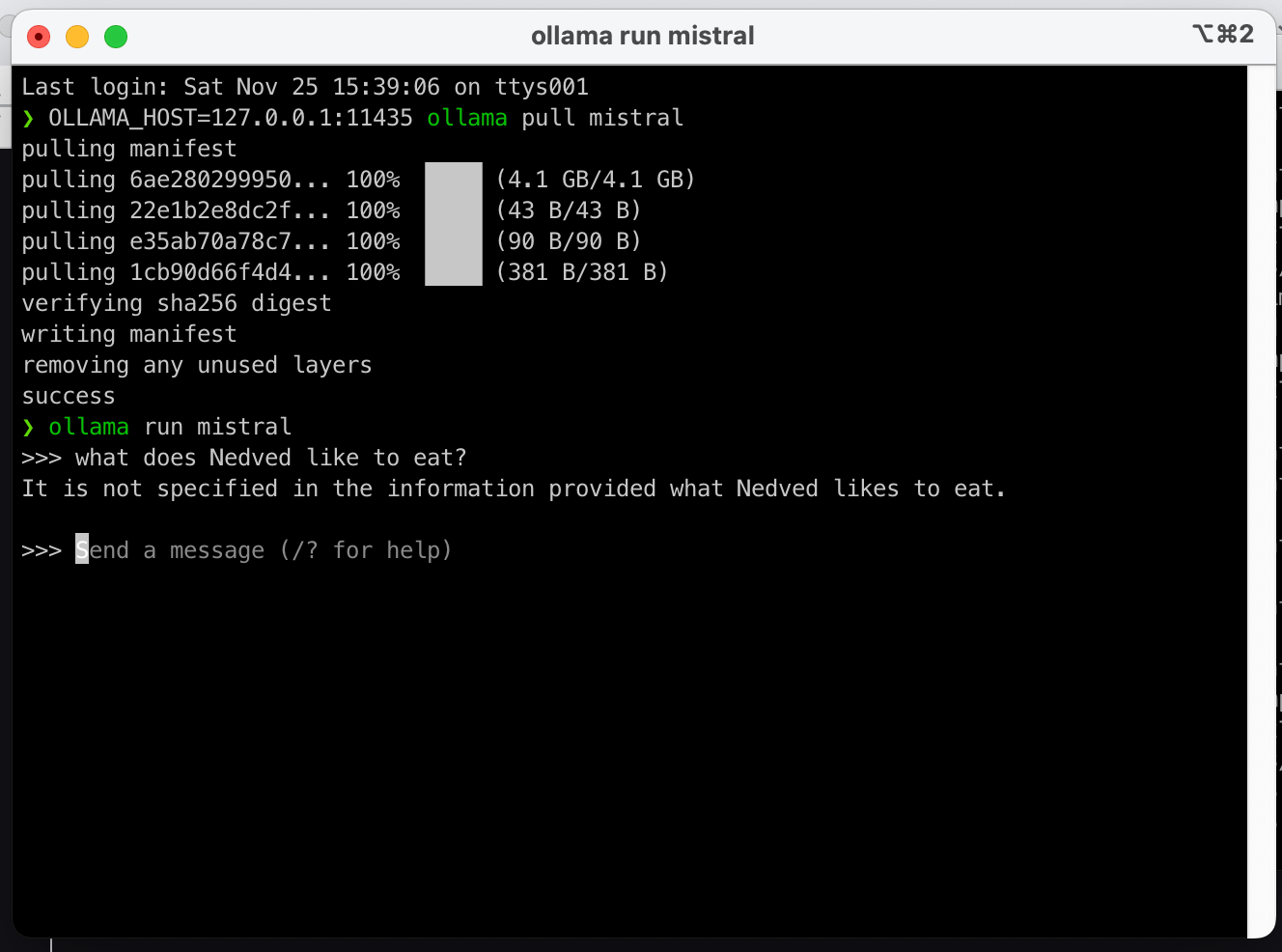

安装完成后,加载Mistral。

$ ollama run mistral

要运行本地模型,请遵循以下指南:

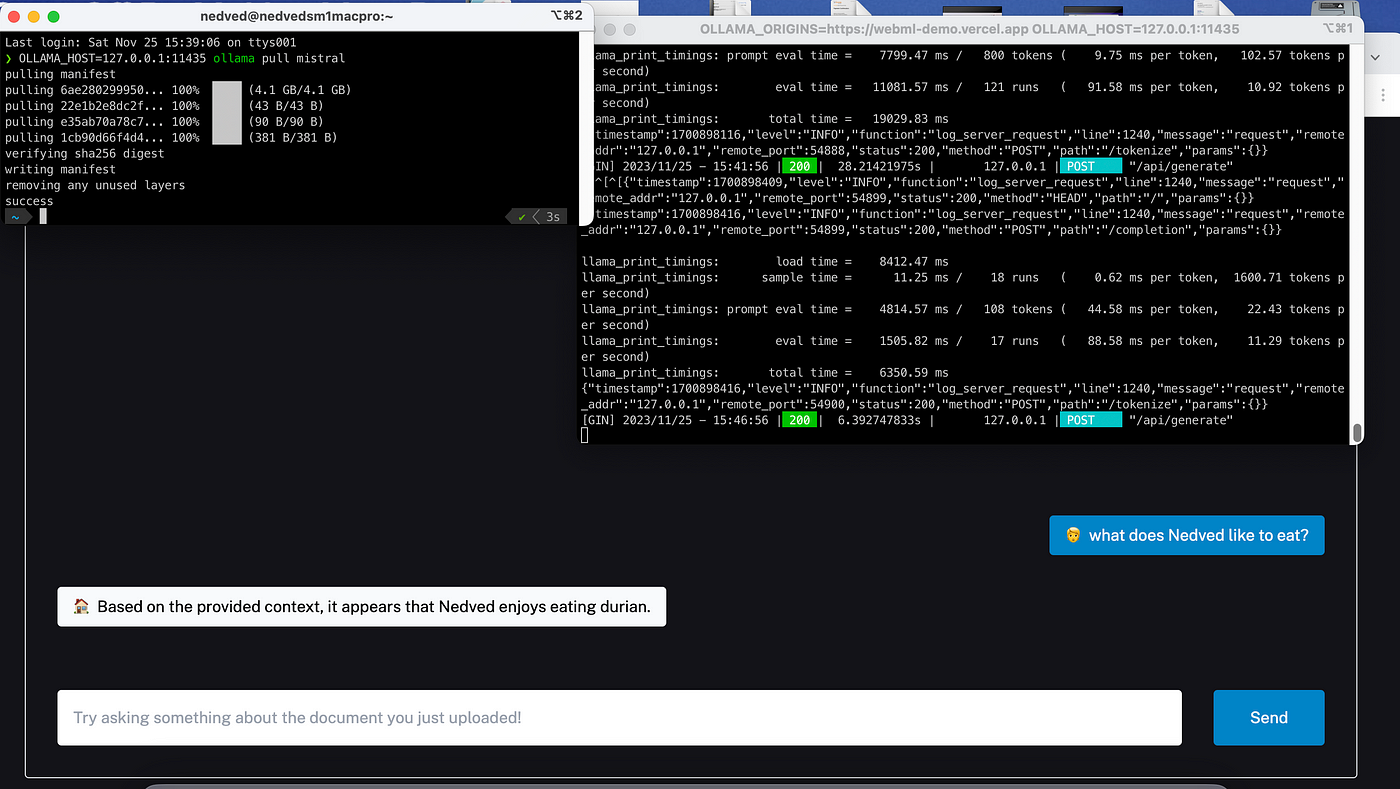

$ OLLAMA_ORIGINS=https://webml-demo.vercel.app OLLAMA_HOST=127.0.0.1:11435 ollama serve

然后,在内外个终端上面

$ OLLAMA_HOST=127.0.0.1:11435 ollama pull mistral

准备好要嵌入的PDF文件,其内容是:

Nedved likes to eat durian a lot.

然后在浏览器中输入网址 https://webml-demo.vercel.app 进行操作,接着上传之前准备好的PDF文件。

问问题 “What does Nedved like to eat?”, 在上传PDF文件后,你会看到基于PDF内容的回复。如果你直接向本地运行的Mistral提出同样的问题,你会得到以下回复。

目前,还不能将SLM(小型语言模型)集成到浏览器应用中。但随着边缘硬件的改进和越来越多的SLM发布,例如llama、Mistra,以及微软最近发布的ORCA 2(参见:https://www.microsoft.com/en-us/research/blog/orca-2-teaching-small-language-models-how-to-reason/),未来出现更多基于本地SLM的Web应用是一个令人兴奋的前景。