前言

AAWS实例数据对于自动化任务、监控、日志记录和资源管理非常重要。开发人员和运维人员可以通过AWS提供的API和控制台访问和管理这些数据,以便更好地管理和维护他们在AWS云上运行的实例。然而,在使用 spider 框架进行网页爬取时,我们常常会面临一些技术挑战,特别是当我们尝试获取 AWS 实例数据时。本文将探讨在 spider 网页爬虫中可能遇到的 AWS 实例数据获取问题,并提供解决方案,以确保爬虫的顺利运行。

报错示例

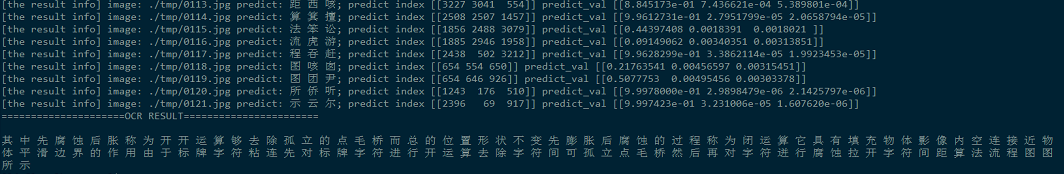

使用 spider 框架进行网页爬取时,可能会遇到如下的错误信息:

2017-05-31 22:00:38 [scrapy] INFO: Scrapy 1.0.3 started (bot: scrapybot)

2017-05-31 22:00:38 [scrapy] INFO: Optional features available: ssl, http11, boto

2017-05-31 22:00:38 [scrapy] INFO: Overridden settings: {}

2017-05-31 22:00:38 [scrapy] INFO: Enabled extensions: CloseSpider, TelnetConsole, LogStats, CoreStats, SpiderState

2017-05-31 22:00:38 [boto] DEBUG: Retrieving credentials from metadata server.

2017-05-31 22:00:39 [boto] ERROR: Caught exception reading instance data

Traceback (most recent call last):

File "/usr/lib/python2.7/dist-packages/boto/utils.py", line 210, in retry_url

r = opener.open(req, timeout=timeout)

File "/usr/lib/python2.7/urllib2.py", line 429, in open

response = this._open(req, data)

File "/usr/lib/python2.7/urllib2.py", line 447, in _open

'_open', req)

File "/usr/lib/python2.7/urllib2.py", line 407, in _call_chain

result = func(*args)

File "/usr/lib/python2.7/urllib2.py", line 1228, in http_open

return this.do_open(httplib.HTTPConnection, req)

File "/usr/lib/python2.7/urllib2.py", line 1198, in do_open

raise URLError(err)

URLError: <urlopen error timed out>

2017-05-31 22:00:39 [boto] ERROR: Unable to read instance data, giving up

2017-05-31 22:00:39 [scrapy] INFO: Enabled downloader middlewares: HttpAuthMiddleware, DownloadTimeoutMiddleware, UserAgentMiddleware, RetryMiddleware, DefaultHeadersMiddleware, MetaRefreshMiddleware, HttpCompressionMiddleware, RedirectMiddleware, CookiesMiddleware, ChunkedTransferMiddleware, DownloaderStats

2017-05-31 22:00:39 [scrapy] INFO: Enabled spider middlewares: HttpErrorMiddleware, OffsiteMiddleware, RefererMiddleware, UrlLengthMiddleware, DepthMiddleware

2017-05-31 22:00:39 [scrapy] INFO: Enabled item pi

这个问题的出现主要是由于 spider 框架在使用 Boto 库获取 AWS 实例数据时,出现了错误。具体来说,由于网络问题导致超时, spider 无法获取 AWS 实例数据,从而无法进行后续的网页爬取操作。

解决方案

对于这个问题,我们可以采取以下的解决方案:

1. 检查网络连接

首先,我们需要检查本地的网络连接是否正常。如果本地的网络连接存在问题,那么 spider 在获取 AWS 实例数据时,就可能出现超时或者无法获取数据的情况。因此,我们需要确保本地的网络连接是正常的。

2. 调整超时时间

如果网络连接没有问题,那么我们需要考虑调整 spider 的超时时间。在 spider 中,可以通过修改 settings.py 文件中的 DOWNLOAD_TIMEOUT 和 HTTP_TIMEOUT 参数,来调整超时时间。一般来说,我们应该将这两个参数的值设置得较大,以防止 spider 在获取 AWS 实例数据时,由于网络问题,导致超时。

在 spider 的 settings.py 文件中,可以添加如下配置:

DOWNLOAD_TIMEOUT = 60 # 设置下载超时时间为60秒

HTTP_TIMEOUT = 60 # 设置HTTP请求超时时间为60秒

这样可以确保 spider 在获取数据时有足够的时间来完成操作。

3. 使用代理服务器

如果网络连接和超时时间都没有问题,那么我们需要考虑使用代理服务器。通过使用代理服务器,我们可以避免直接访问 AWS 实例数据,从而避免出现超时的情况。在 spider 中,可以通过修改 settings.py 文件中的 HTTP_PROXY 参数,来设置代理服务器的地址和端口。

在 spider 的 settings.py 文件中,可以添加如下配置:

import requests

# 代理服务器的信息

proxyHost = "www.16yun.cn"

proxyPort = "5445"

proxyUser = "16QMSOML"

proxyPass = "280651"

# 构建代理服务器的URL

HTTP_PROXY = f"http://{proxyUser}:{proxyPass}@{proxyHost}:{proxyPort}"

# 构建请求头

headers = {

"User-Agent": "Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/80.0.3987.87 Safari/537.36"

}

# 创建代理服务器的Session

session = requests.Session()

session.proxies = {

"http": HTTP_PROXY,

"https": HTTP_PROXY

}

# 发送请求

url = "https://example.com" # 替换为你要访问的目标网址

response = session.get(url, headers=headers)

# 处理响应数据

if response.status_code == 200:

print("成功访问网站")

# 进一步处理网页内容

# ...

else:

print("访问网站失败")

请将 your_proxy_server 替换为实际的代理服务器地址,port 替换为代理服务器的端口号。使用代理服务器可以帮助解决网络访问问题,但要确保代理服务器稳定可用。

4. 检查 AWS 实例状态

如果以上的方法都无法解决问题,那么我们需要检查 AWS 实例的状态。如果 AWS 实例的状态异常,那么 spider 在获取 AWS 实例数据时,就可能出现错误。因此,我们需要确保 AWS 实例的状态是正常的。

可以登录到 AWS 管理控制台,检查实例的运行状态、网络配置和安全组设置等是否正确。确保实例能够正常访问互联网。

总结

以上就是对这个问题的解决方案。在实际操作中,我们可以根据具体的情况,选择适合自己的解决方案。同时,我们还需要注意,这些解决方案可能会带来一些副作用,所以在爬取过程中我们需要随时进行观察,监测错误。

![23111706[含文档+PPT+源码等]计算机毕业设计SSM框架网上书城全套微信支付电商购物](https://img-blog.csdnimg.cn/img_convert/8e4fb2245d5c5847f514e415a873d82b.png)