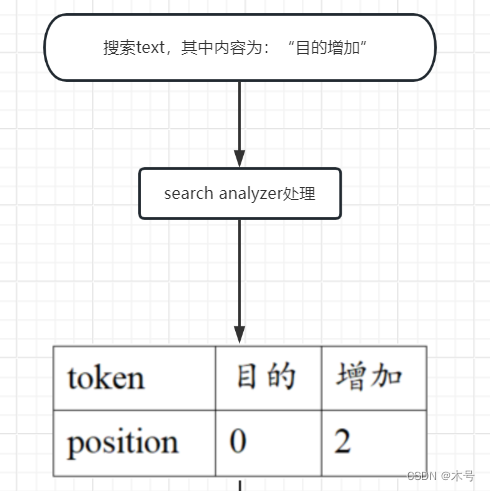

在图像分类任务中,使用旋转、噪声等数据增强方法训练图像分类器,可以提高分类器对这些保留语义的扭曲的不变性,这是图像分类器极为期望的一种质量。

引用Bora等人的工作,指出只要增强过程可以表示为概率分布上的可逆变换,那么训练过程中网络可以消除这种增强,找到正确的分布。

进一步解释可逆变换的关键在于允许仅通过观察增强后的集合就可以推断原始集合的相等性或不等性。这并不需要每个图像的增强都是可逆的。举例解释,以0.9的概率将图像置为零,是概率分布意义上的可逆操作。然而,如以0.25的概率进行0/90/180/270度随机旋转则不是可逆的,因为旋转后无法分辨不同方向。

如果以概率p < 1进行旋转,则会有很多旋转0度情况,这提示生成图像所需要的正确方向。

类似地设计许多其他可能导致泄漏的增强,可是只要跳过概率非零,就可以转变为非泄漏。

结合多个非泄漏增强也是非泄漏的。

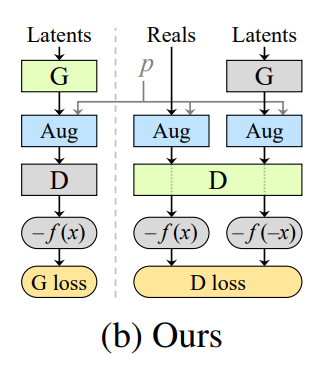

训练架构如下:

图片是一个示意图,用来说明这种技术的训练过程¹²。图片中的蓝色元素表示和变换相关的操作,而其他的元素表示标准的GAN训练过程,包括生成器G和判别器D¹²。图片中的橙色元素表示损失函数,而绿色的框表示正在训练的网络¹²。