Scaling Language-Image Pre-training via Masking(FLIP,2023)👍

贡献:

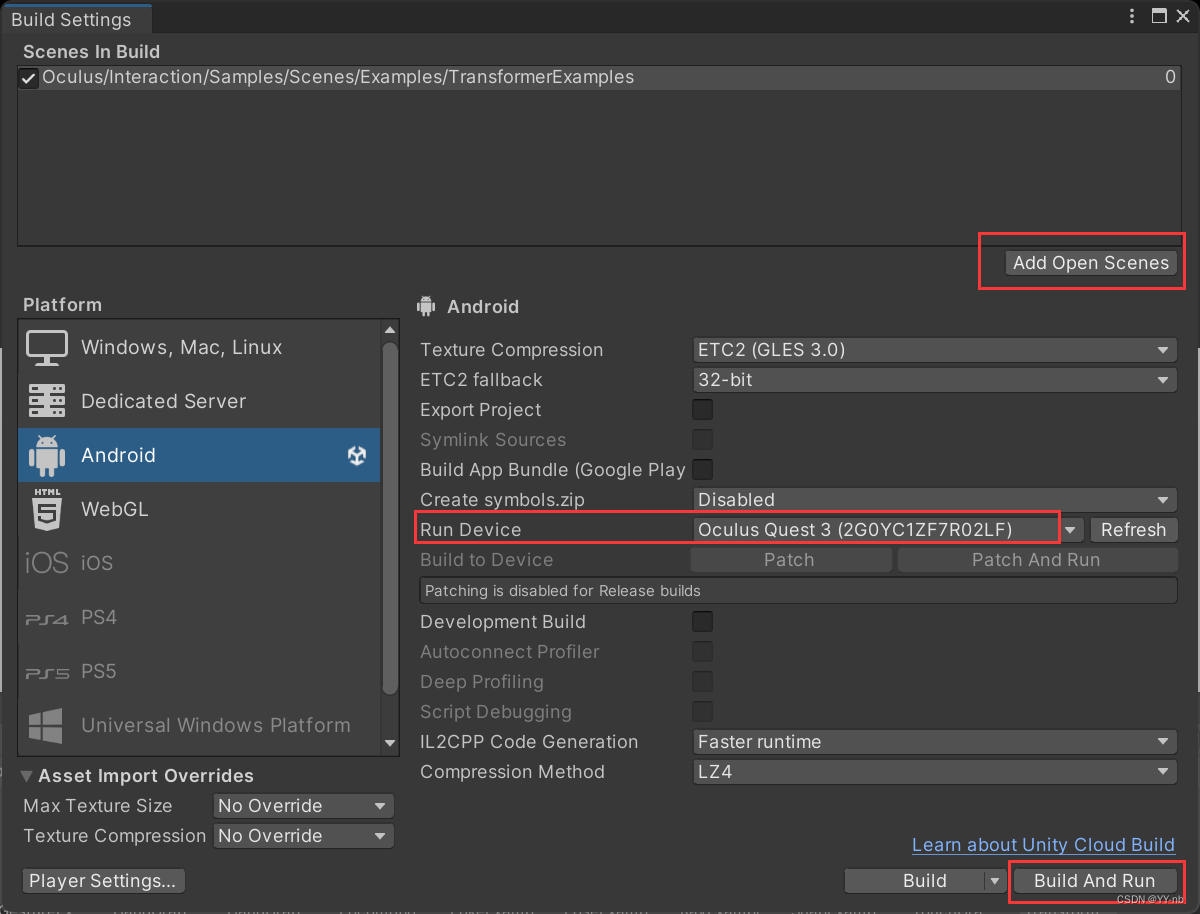

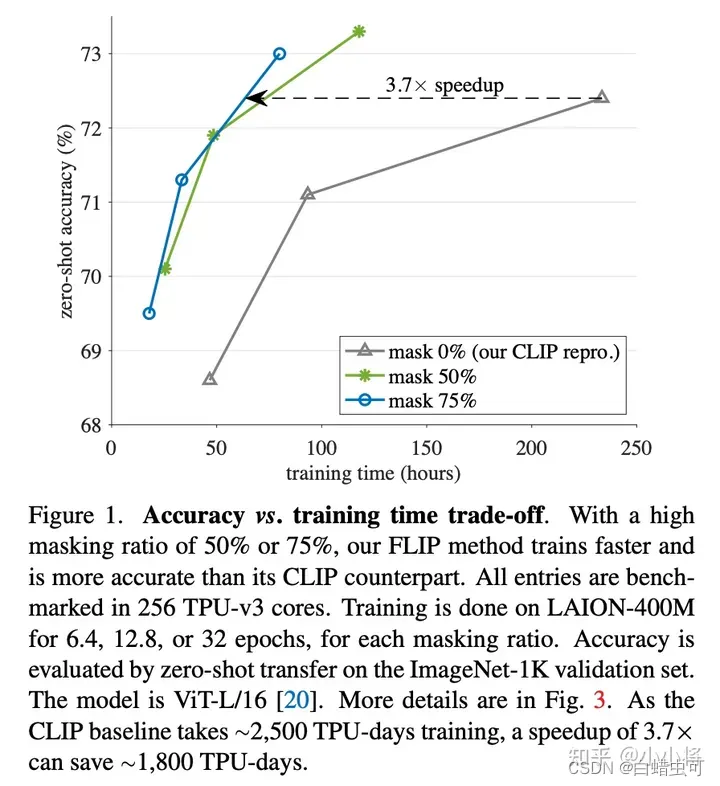

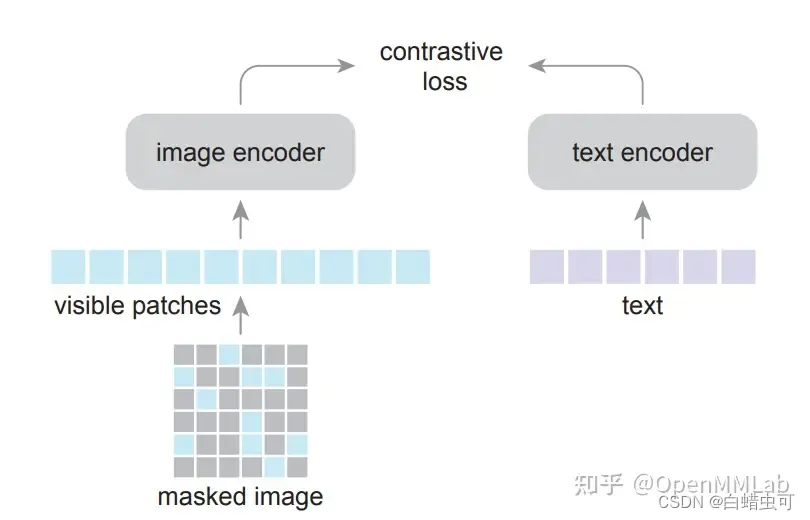

1.图像端引入MAE的随机MASK,image encoder只处理未mask的patches(和之前的MAE方法一致),减少了输入序列长度加速训练,减少memory开销。

text端没引入mask是因为text信息比较dense(图片信息比较稀疏),mask掉效果反而不好,之后是选择mask掉text

padding的地方提升了精度。

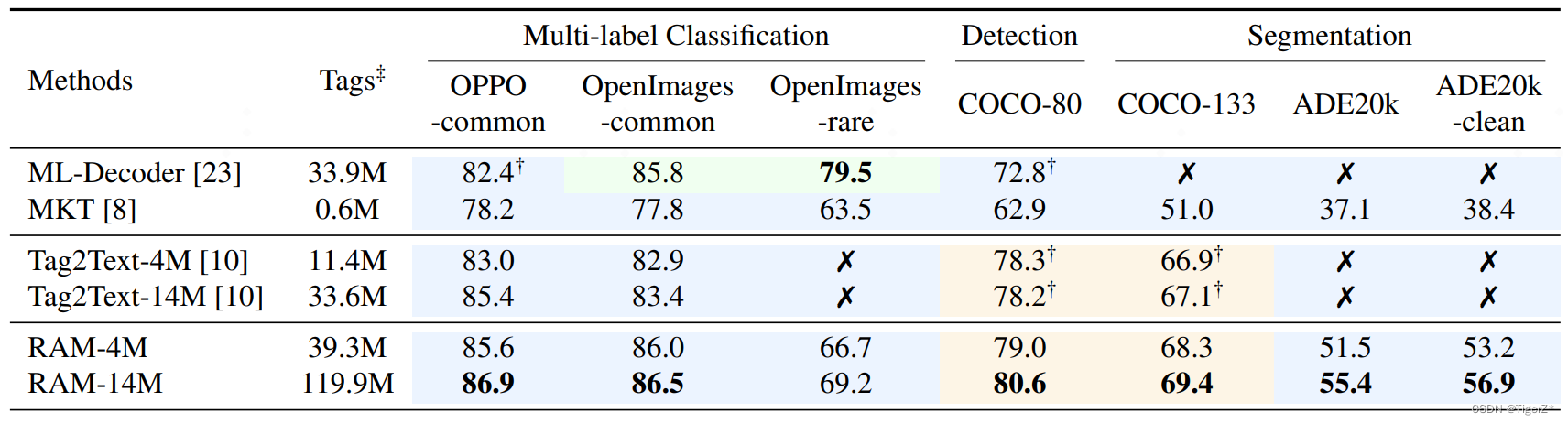

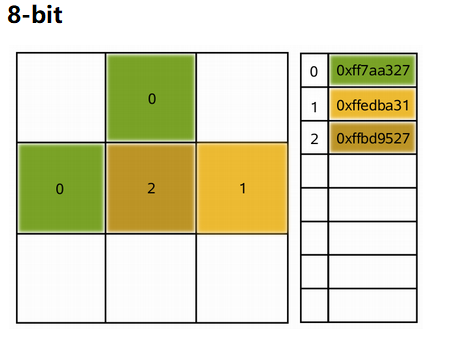

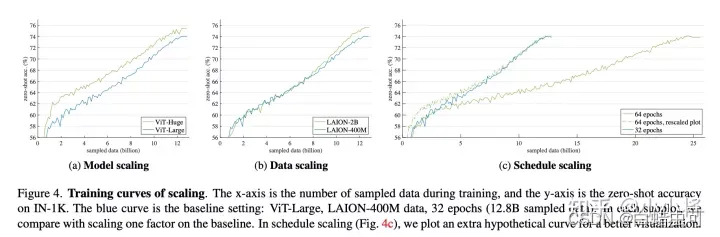

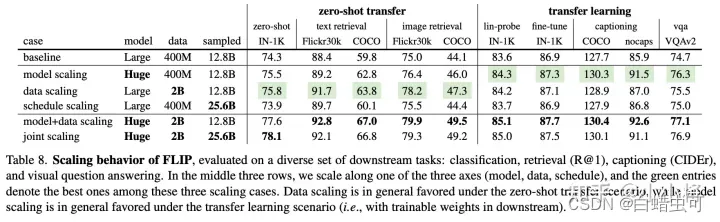

2.做了三个方面的scale:说明model和data的scale还是很重要的,不同数据集相同大小也会对模型造成影响

- model scaling:vit变大,效果很直观的好

- data scaling:将预训练数据集从LAION-400M扩展到更大的数据集LAION-2B(固定训练过程采样的样本总量)

- schedule scaling:增加训练过程的采样数据量(从12.8B->25.6B,即训练epochs从32增加至64)

下图绿色划线:增大VIT有利于transfer learning,增加数据量有利于做zero shot

模型

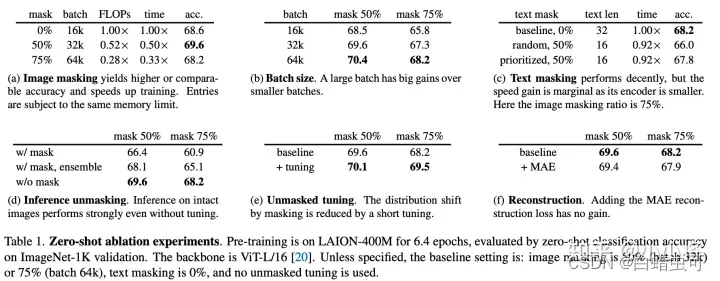

Ablation study

(a)我觉得可能提升的一个因素是bz大了,负样本也多了,效果好,作者不做相同bz的实验

(d)说明了减少mask率微调几个epoch有有助于提升精度

GLIP:Grounded Language-Image Pre-training(2022)👍

模型:

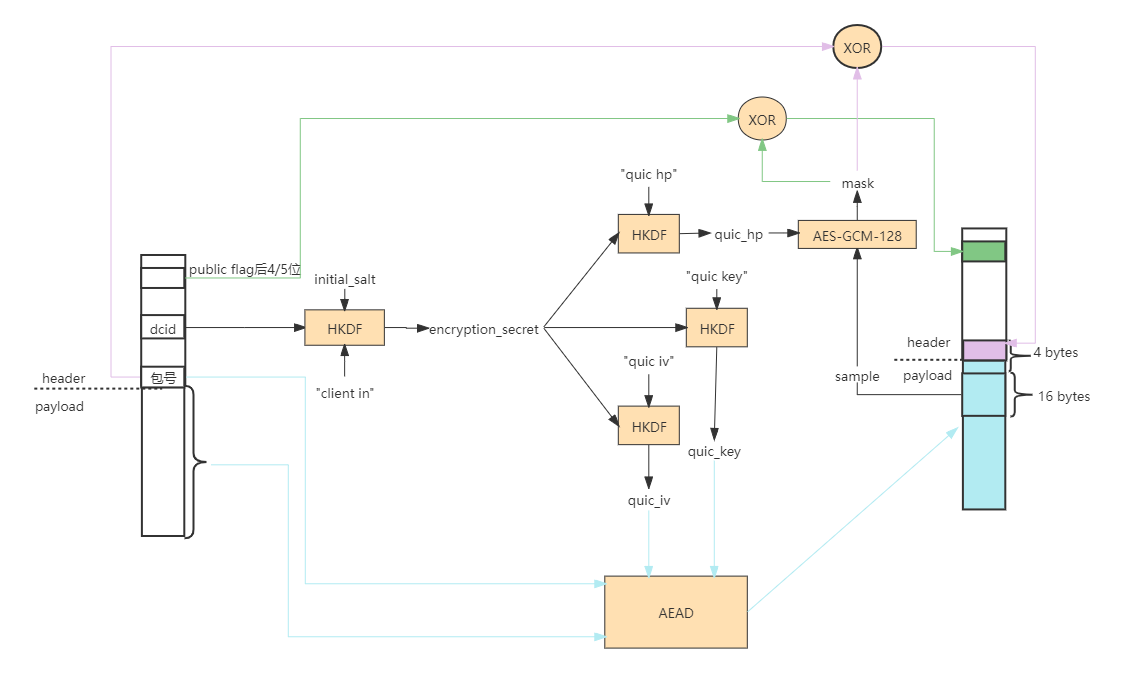

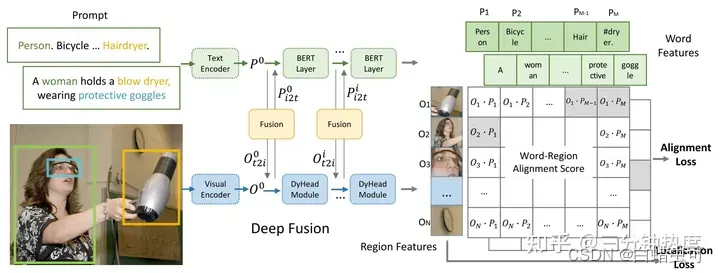

Language-Aware Deep Fusion:

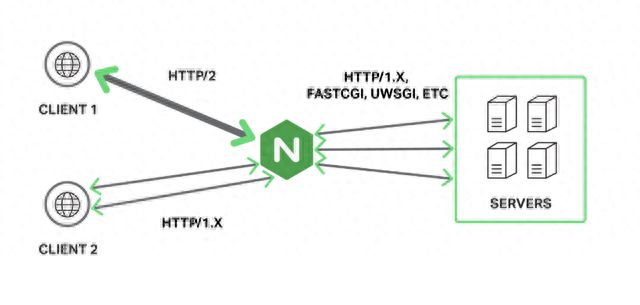

1.image encoder 和 text encoder 抽取图像和文本的特征

2.对抽取的特征进行cross attention ,获得更好的交互后的特征:

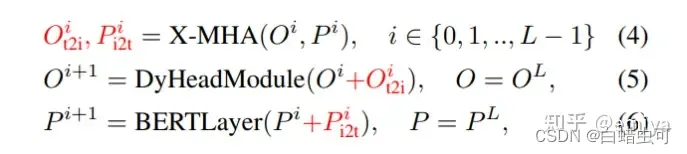

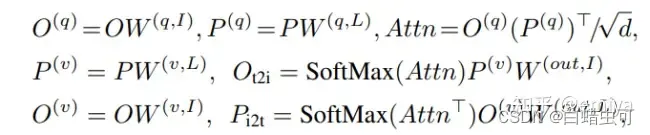

X-MHA:cross-modality multi-head attention module,类似cross attention,qk算attn,各自的v分别算一次

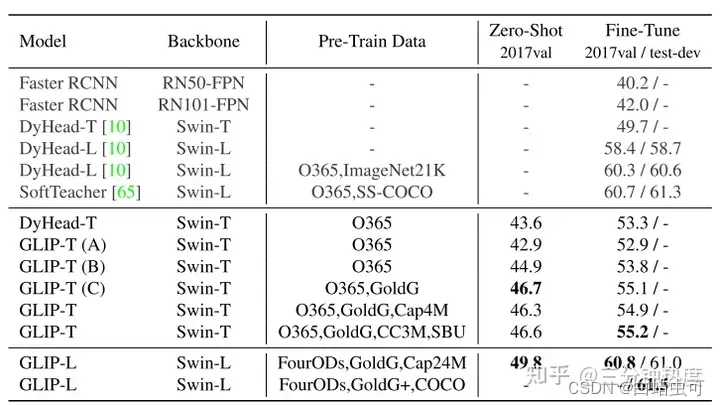

上图(B)是在(A)的基础上添加了deep fusion,涨点还是很明显的,增加数据量涨点也很明显