FastSpeech 基于 Transformer 的前馈网络,用于并行生成 TTS 梅尔谱图。 FastSpeech 模型与自回归 Transformer TTS 相比,梅尔谱图生成速度加快了 270 倍,端到端语音合成速度加快了 38 倍。

项目实现

docker cp LJSpeech-1.1.tar.bz2 torch_na:/workspace/FastSpeech/data

docker cp /home/elena/tts/waveglow_256channels_ljs_v2.pt torch_na:/workspace/FastSpeech/waveglow/pretrained_model把下载的预训练模型改名为

waveglow_256channels.pt

解压文件当当前文件夹

unzip alignments.zip 然后运行preprocess.py

python preprocess.py 处理完数据后,开始进行训练

python train.py

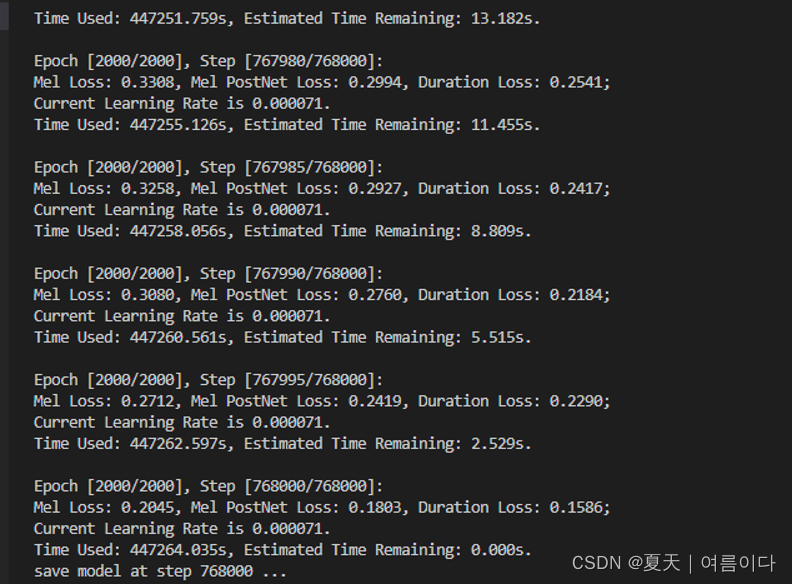

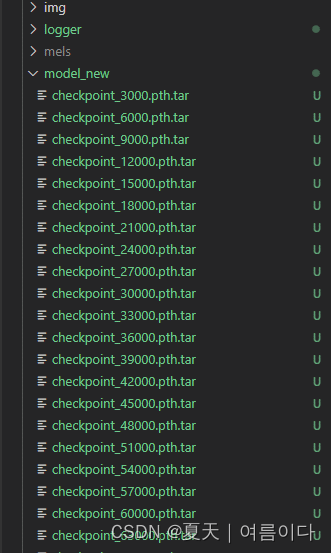

(训练将近一周)训练后如图

训练后进行验证,先修改eval.py中的超参数 --step ,改为自己刚训练后的model_new文件夹下的checkpoint后面的数,如图

我的情况把默认0,改为768000,如下

if __name__ == "__main__":

# Test

WaveGlow = utils.get_WaveGlow()

parser = argparse.ArgumentParser()

parser.add_argument('--step', type=int, default=768000) #把默认0,改为768000,其他的不变

parser.add_argument("--alpha", type=float, default=1.0)

args = parser.parse_args()然后再运行

python eval.py(如果运行后出现错误,请参考Q&A2)

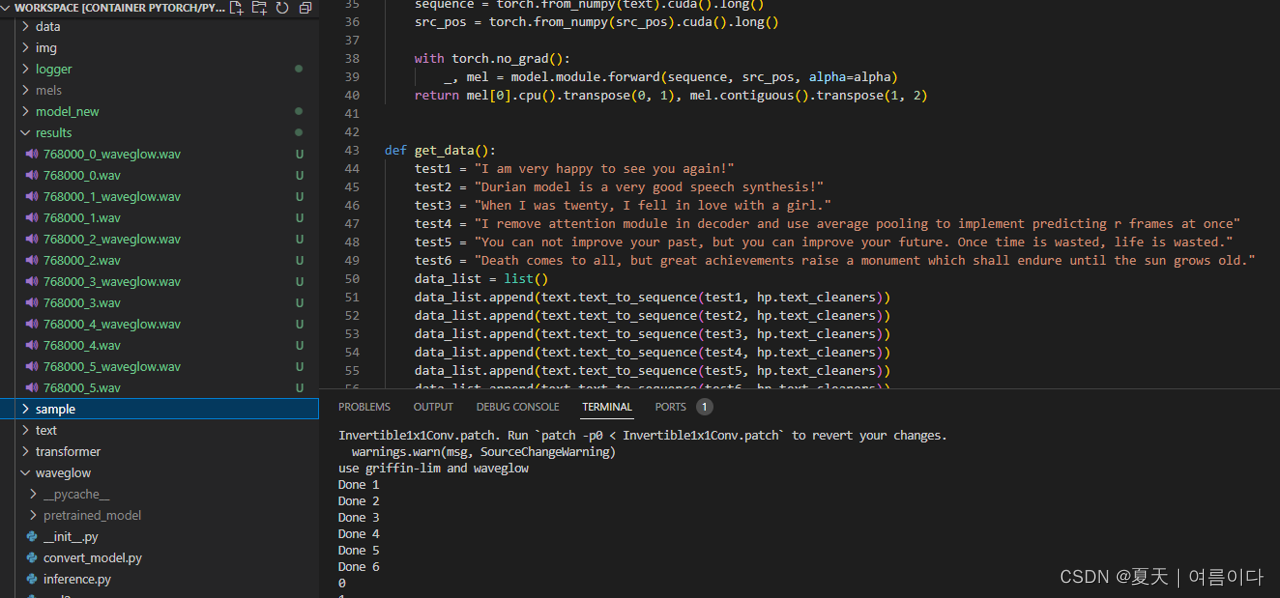

结果显示如图

生成俩种结果,一种是通过mel_spce,一种通过waveglow.

waveglow生成的效果更好,mel_space噪声比较大!

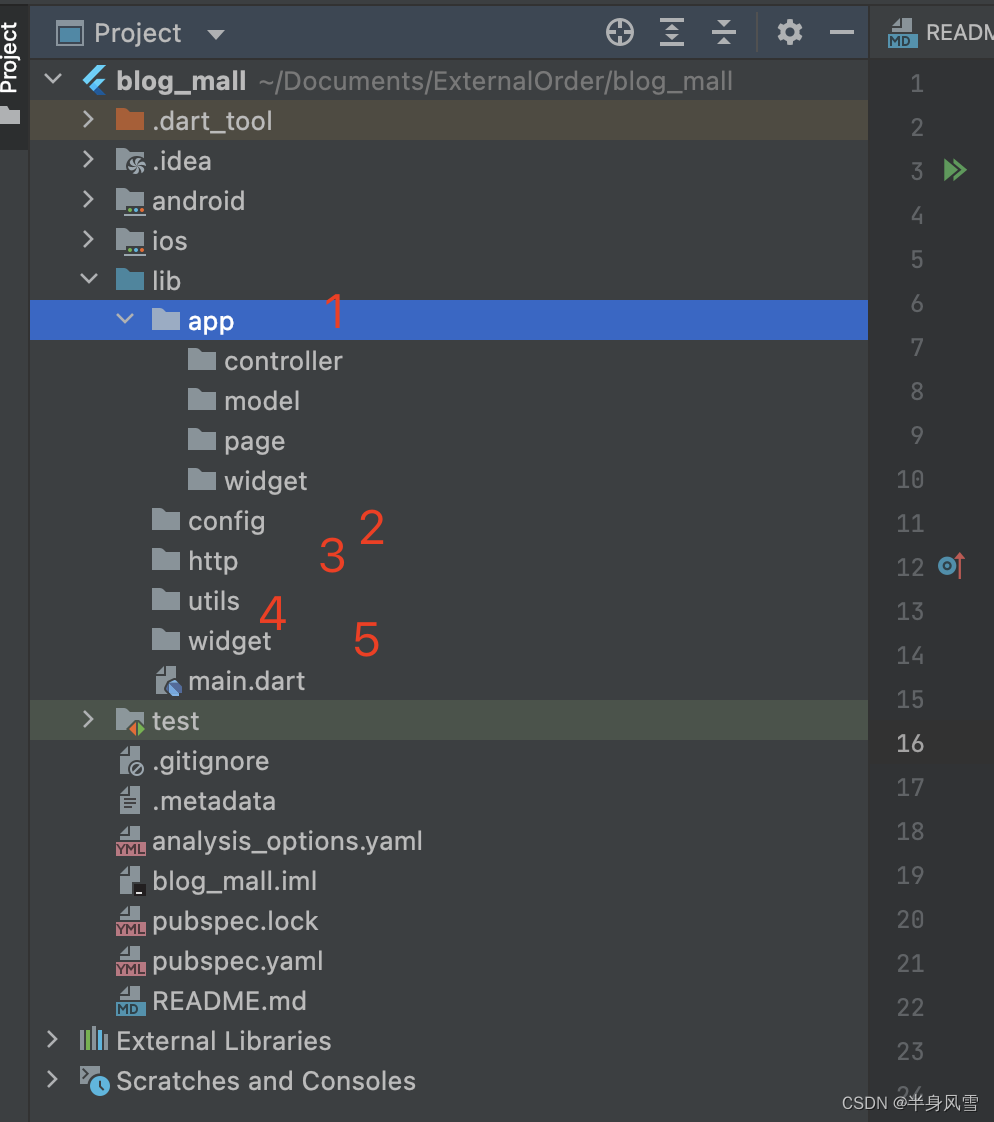

代码详解

preprocess.py ->对LJSpeech数据集进行预处理

def preprocess_ljspeech(filename):

# LJSpeech 数据集作为输入路径

in_dir = filename

# mel 谱图输出路径为 ./mels ,若路径不存在则创建路径

out_dir = hp.mel_ground_truth

if not os.path.exists(out_dir):

os.makedirs(out_dir, exist_ok=True)

# 执行语音波形-mel谱图转换,并保存mel谱图,得到LJSpeech数据集语音文本列表

metadata = ljspeech.build_from_path(in_dir, out_dir)

# 将得到的语音文本列表写入磁盘

write_metadata(metadata, out_dir)

# 移动语音文本列表文件

shutil.move(os.path.join(hp.mel_ground_truth, "train.txt"),

os.path.join("data", "train.txt"))

hparams.py 模型的相关参数

# Mel

num_mels = 80

text_cleaners = ['english_cleaners']

# FastSpeech

vocab_size = 300

max_seq_len = 3000

encoder_dim = 256 #模型编码维度

encoder_n_layer = 4 #模型编码层数

encoder_head = 2 #模型头

encoder_conv1d_filter_size = 1024 #模型输出大小

decoder_dim = 256 #模型解码维度

decoder_n_layer = 4

decoder_head = 2

decoder_conv1d_filter_size = 1024

fft_conv1d_kernel = (9, 1)

fft_conv1d_padding = (4, 0)

duration_predictor_filter_size = 256

duration_predictor_kernel_size = 3

dropout = 0.1

# Train

checkpoint_path = "./model_new" #训练模型保存路径

logger_path = "./logger" #训练日志保存路径

mel_ground_truth = "./mels" #

alignment_path = "./alignments"

batch_size = 32

epochs = 2000

n_warm_up_step = 4000

learning_rate = 1e-3

weight_decay = 1e-6

grad_clip_thresh = 1.0

decay_step = [500000, 1000000, 2000000]

save_step = 3000

log_step = 5

clear_Time = 20

batch_expand_size = 32

疑问与解答 Q&A

1.为什么生成的梅普图(mel)是npy文件?

2.ModuleNotFoundError: No module named 'numba.decorators'

在运行验证模型时,出现模型错误,因为库版本错误。

卸载numba,然后安装 numba-0.48.0即可

pip install numba==0.48.0参考文献

【1】GitHub - xcmyz/FastSpeech: The Implementation of FastSpeech based on pytorch.

![计算机视觉与深度学习-全连接神经网络-训练过程-权值初始化- [北邮鲁鹏]](https://img-blog.csdnimg.cn/7c03d5ccd7b949858a9723f7de70d60e.png)