无论人与人之间还是人与机之间,只要有协同就会有风险。其原因主要是:协同可能导致合作伙伴之间的利益冲突,协同合作还可能引发信息共享的风险,协同可能面临合作对象的信任问题,协同合作还可能受到外部环境的影响等等。

人人组队的风险主要涉及以下几个方面:

沟通和合作障碍:团队成员之间可能存在沟通和合作上的障碍,例如语言和文化差异、性格和价值观冲突等。这可能会干扰团队的协作和决策,甚至导致团队内部的分裂和矛盾。

缺乏技能或知识:团队成员可能缺乏必要的技能或知识,导致无法充分发挥其潜力,并影响整个团队的表现和绩效。

个人利益和目标不一致:团队成员可能追求自己的个人利益或目标,而忽视整个团队的利益和目标。这可能会导致合作和协作上的问题,并且使团队的决策和绩效受到负面影响。

分工不当:团队成员间的分工可能不当,导致某些成员过度投入或被忽视,从而影响整个团队的表现和绩效。

缺乏领导力或管理能力:如果团队缺乏有效的领导或管理人员,则可能会出现混乱或决策上的不确定性,从而影响团队的绩效和成果。

为了应对这些风险,人人组队需要采取一系列的措施,例如:

加强沟通和协作:设置明确的目标和方向,建立有效的沟通渠道和协作机制,提高团队成员之间的协作能力和沟通技巧等。

提高技能和知识水平:鼓励团队成员不断学习和提升自己的技能和知识水平,以便在团队中发挥更大的作用。

强调团队利益和目标:强化团队合作和目标意识,鼓励团队成员关注整个团队的利益和目标,并使个人利益与整体利益保持一致。

合理分工:根据团队成员的技能和能力,合理分工,以保证每个成员都能够充分发挥自己的潜力,并为团队做出贡献。

设立领导和管理机制:设立有效的领导和管理机制,指导团队决策和协调团队工作,提高团队的表现和绩效。

通过采取这些措施,人人组队可以有效地应对潜在的风险,并最大限度地发挥整个团队的创造力和合作力,取得良好的成果。

人机组队的风险主要涉及以下几个方面:

技术风险:机器可能存在技术上的局限性和缺陷。尽管人工智能和机器学习技术不断改进,但机器仍然可能出现错误、偏差或不完全准确的情况,这可能会对团队的决策和绩效产生负面影响。

误解和沟通障碍:机器和人之间的沟通可能会受到语言理解、语义理解和上下文理解等方面的限制。机器可能无法完全理解人类的意图和表达,或者可能给出模棱两可或有歧义的回应,导致误解和沟通障碍的出现。

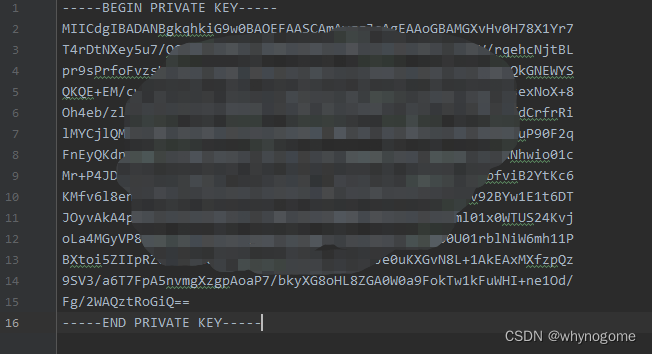

安全和隐私风险:机器可能会存储和处理大量敏感信息,包括个人身份信息、财务数据等。如果机器的安全性和隐私保护措施不足,可能会面临数据泄露、滥用或被黑客攻击等风险,对个人和组织造成损害。

依赖风险:对机器的过度依赖可能导致人类对问题的深入思考和主观判断能力的减退,从而降低整体团队的创造力和创新能力。另外,机器可能会出现意外故障或中断,如果没有备用方案或替代措施,团队的工作可能会受到重大影响。

道德和伦理问题:与机器合作时,我们需要考虑到人工智能在决策和行为中可能引发的伦理和道德问题。例如,机器可能会在决策中存在偏见、歧视或不公平的倾向,或者产生违背社会价值观的结果。因此,我们需要建立适当的监管和规范框架,以确保机器的行为符合伦理和道德标准。

为了应对这些风险,人机组队需要采取一系列的措施,包括提供充分的培训和技术支持,建立有效的沟通机制,保障数据安全和隐私,设立备用方案和容灾措施,以及加强对机器行为的监管和规范等。只有在充分考虑并管理这些风险的情况下,人机组队才能发挥最大的效益,并取得良好的成果。