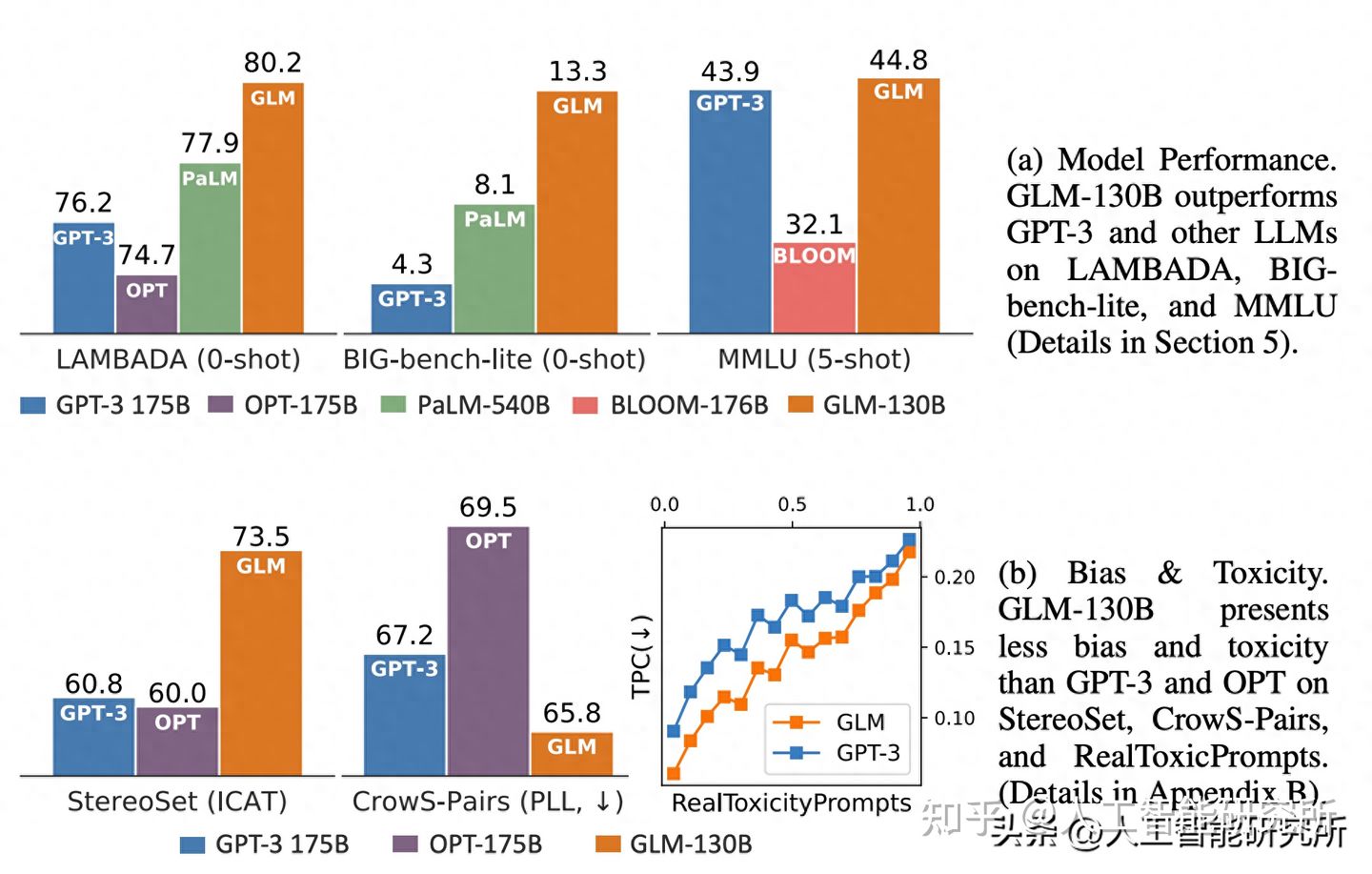

ChatGLM-6B 是一个开源的、支持中英双语的对话语言模型,基于 General Language Model (GLM) 架构,具有 62 亿参数.ChatGLM2-6B 是开源中英双语对话模型 ChatGLM-6B 的第二代版本,其第二代继承了第一代的优秀特点,并在第一代的基础上,更新了更多的新特性。

更强大的性能:

ChatGLM2-6B 使用了 GLM 的混合目标函数,

经过了 1.4T 中英标识符的预训练与人类偏好对齐训练,评测结果显示,

相比于初代模型,ChatGLM2-6B 在 MMLU(+23%)、CEval(+33%)、GSM8K(+571%) 、

BBH(+60%)等数据集上的性能取得了大幅度的提升。

更长的上下文:

基于 FlashAttention 技术,模型的上下文长度(Context Length)

由 ChatGLM-6B 的 2K 扩展到了 32K,并在对话阶段使用 8K 的上下文长度训练。

更高效的推理:

基于 Multi-Query Attention 技术,ChatGLM2-6B

有更高效的推