基本概念

问题的提出

基本概念

(1)特征形成:由仪器直接测量出来的数值,或者是根据仪器的数据进行计算后的结果

(2)特征选择:用计算的方法从一组给定的特征中选择一部分特征进行分类

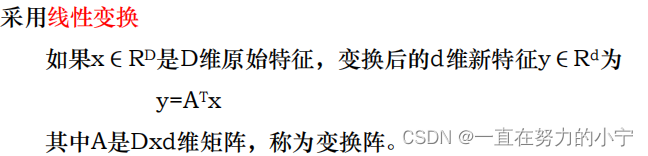

(3)特征提取:通过适当的变换把原有的D个特征转换为d(<D)个特征

特征选择

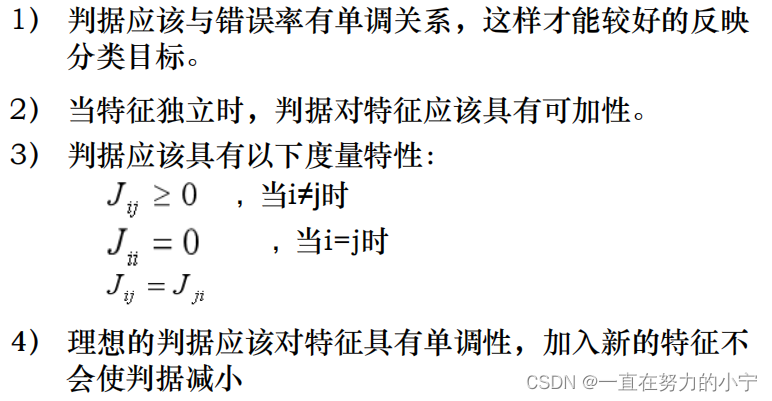

特征的评价准则

类别可分离性判据

常用的特征判据

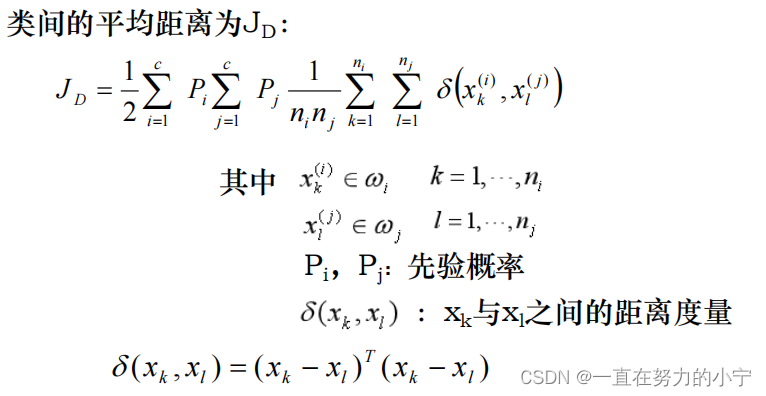

1. 基于类内类间距离的可分性判据

(1)基本思想:计算各类特征向量之间的平均距离,考虑最简单的两类情况,可以用两类中任意两两样本间的平均来代表两个类之间的距离。

(2)判据的表达式:

(3)矩阵形式的类间距离的表达式

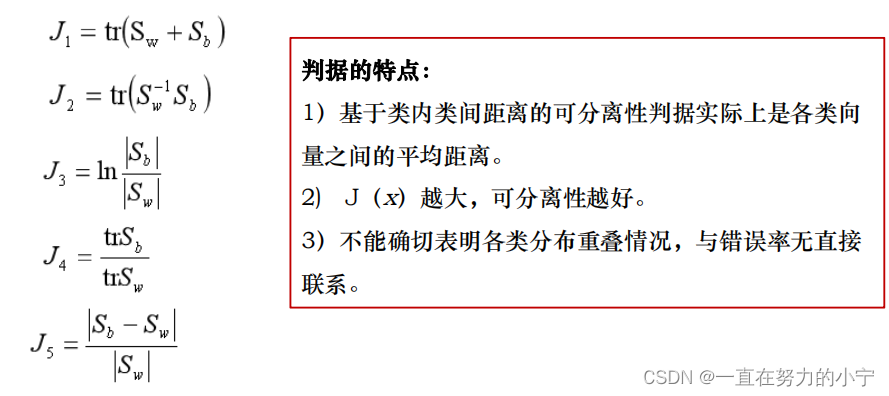

(4)其它的基于类内类间距离的判据

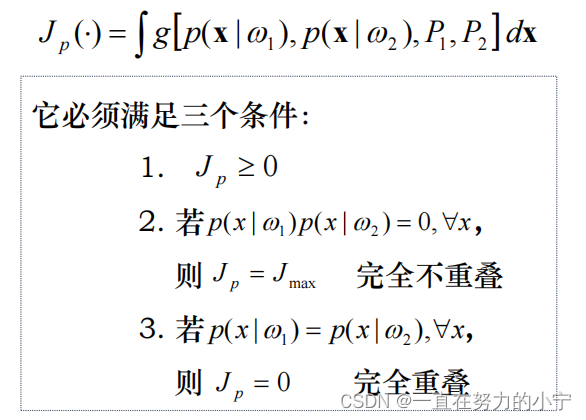

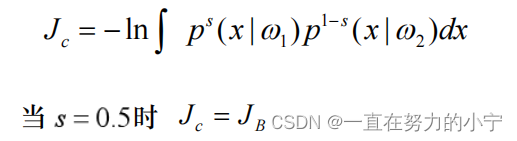

2. 基于概率分布的可分性判据

(4)散度----人们在似然比的基础上定义了散度来作为类别可分性的度量

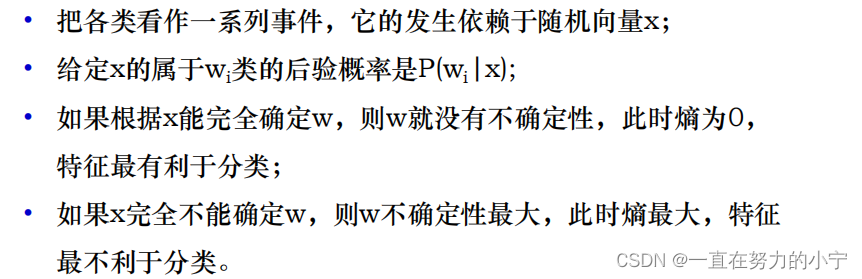

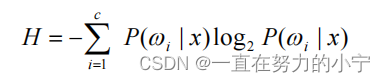

3. 基于熵的可分性判据

(1)定义:借用熵的概念来描述各类的可分性

在特征的某个取值下: 如果样本属于各类的后验概率越平均,则该特征越不利于分类; 如果后验概率越集中于某一类,则特征越有利于分类。在信息论中,熵表示不确定性,熵越大不确定性越大

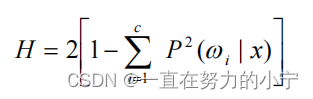

(3)常用的熵度量

② 平方熵

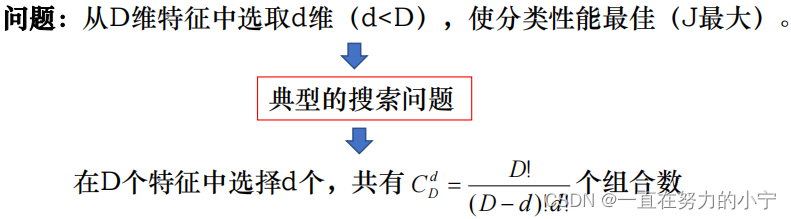

特征选择的最优和次优算法

特征选择的最优算法

1. 最优算法

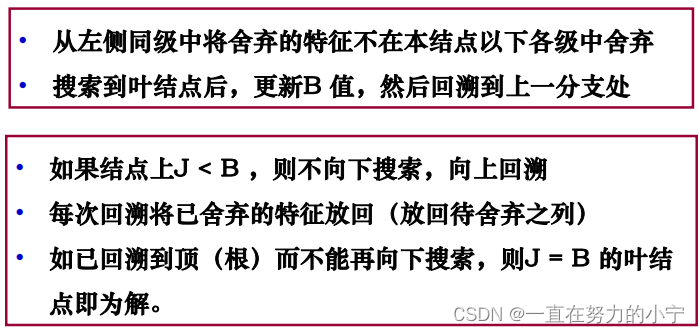

2. 分枝定界法(branch and bound)

• 自顶向下:从包含所有候选特征开始,逐步去掉不被选中的特征

• 回溯:考虑到所有可能的组合

• 基本思想:从左到右建树 → 从右到左搜索 → 回溯避免不必要计算 → 找到最优解

• 计算量:在d大约为D的一半时,分枝定界法比穷举法节省的计算量最大

• 算法要点:根节点为全体特征,每个结点上舍弃一个特征,各个叶结点代表选择的各种组合 等

特征选择的次优算法

1. 单独最优特征的组合

• 计算各特征单独使用时的判据值并加以排队,取前d 个作为选择结果。

2. 顺序前进法

3. 顺序后退法

4. 增l减r法(l-r法)

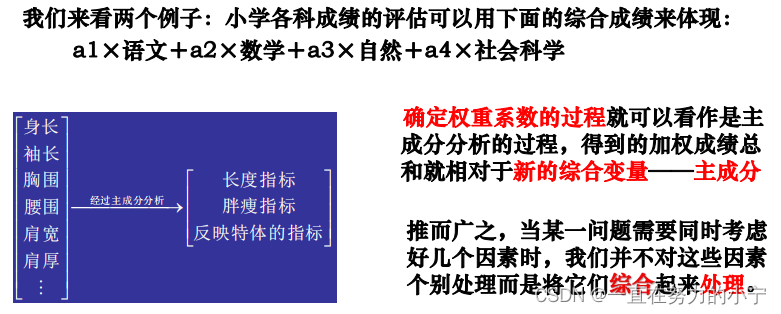

特征提取之PCA算法

问题的提出

主成分分析PCA

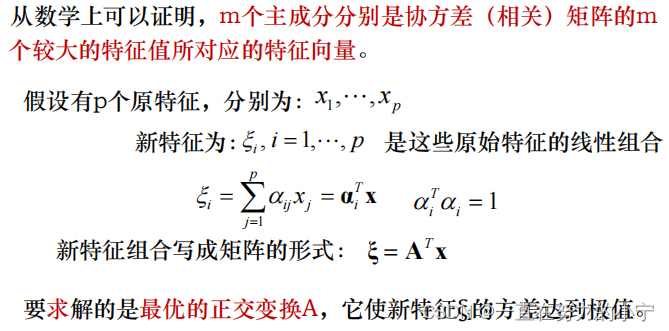

出发点是从一组特征中计算出一组按重要性从大到小排列的新特征,它们是原有特征的线性组合,并且相互之间是不相关的。

主成分分析的目的:压缩变量个数,用较少的变量去解释原始数据中的大部分变量,剔除冗余信息

主成分分析的方法

特征提取之K-L变换

基于PCA变换的iris数据分类

还没更新完![]() 模式识别好难

模式识别好难![]()

![[附源码]Nodejs计算机毕业设计基于的校园疫情防控管理Express(程序+LW)](https://img-blog.csdnimg.cn/52f04dc7529041f29b6371a95069a46e.png)