👀日报&周刊合集 | 🎡生产力工具与行业应用大全 | 🧡 点赞关注评论拜托啦!

🤖 艾瑞咨询8月最新报告,看透2023年中国AIGC产业全景

ShowMeAI知识星球资源编码:R178

艾瑞咨询在8月份最新发布了「2023年中国AIGC产业全景报告」报告,对 AIGC 产业进行了全景式的洞察,并对 AIGC 的技术发展、应用前景、社会影响、监管趋势等方面进行了概括和预测。

以上截图均来自这份报告。总体来看,报告预测AIGC技术将带来产业变革和生产力革命,对经济社会各个方面产生广泛深远的影响,非常值得深入阅读!

🤖 AI向实 X 产业跃迁 | InfoQ 大模型技术应用创新大赛

InfoQ 极客传媒向全球极客发起了这场「大模型技术应用创新大赛」,发掘创新解决方案,共同推动大模型技术在不同行业的落地实践。

大赛共分为技术创新、产品经理、产业应用 (教育 / 金融 / 汽车 / 制造) 等6个赛道,并将联合企业共同细化赛题、共享应用场景和实际数据 ⋙ 比赛官网 | 了解更多

报名表单:https://www.infoq.cn/form/?id=1680

需要注意的是,大赛面向广泛的开发者群体,包括未来开发者、企业开发者、个人开发者,并且要于8月31日24:00点之前完成报名。

报名阶段可按照队伍报名,也可自由报名,每队人数不超过5人。更多报名信息和注意事项,可查看上方表单 👆

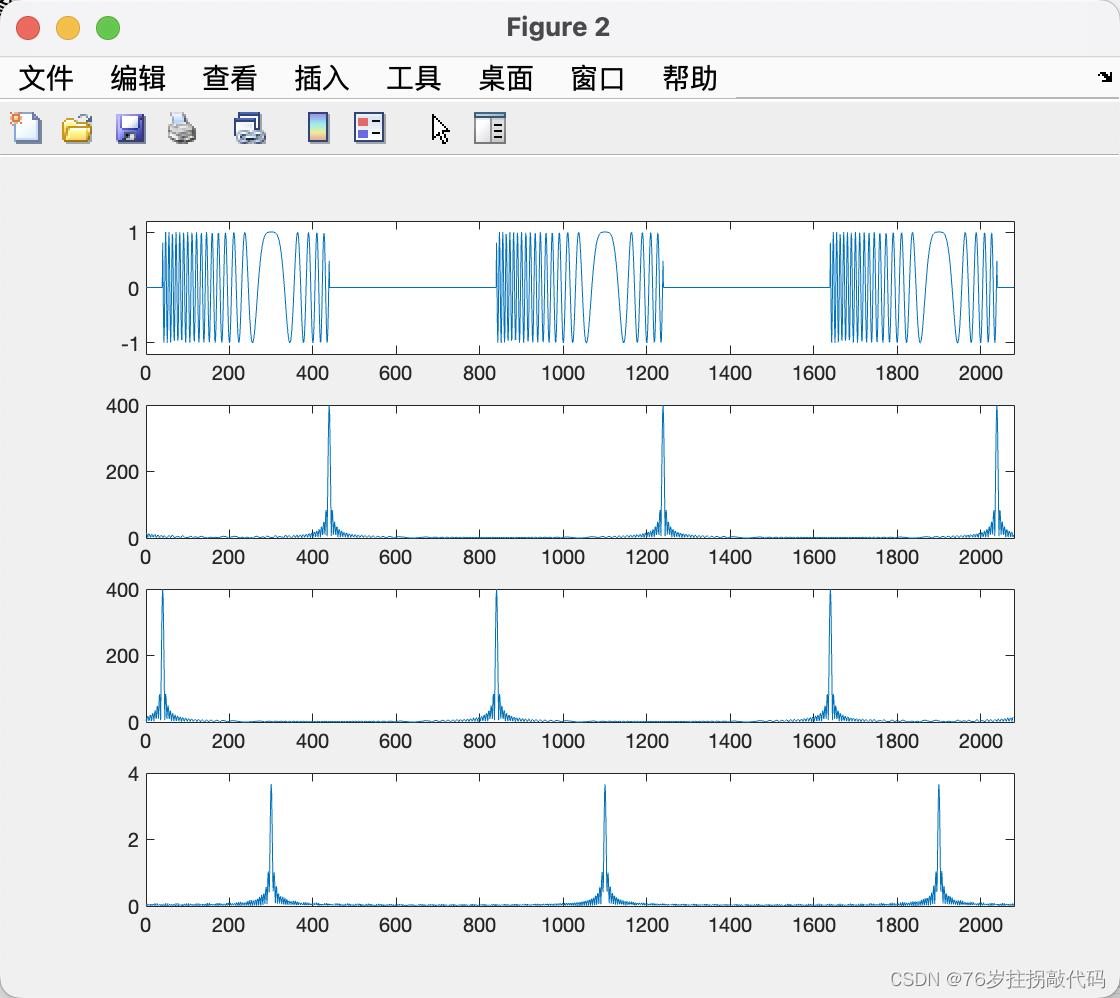

🤖 微软宣布将 Python 集成到 Excel,自动化数据分析即将成真

8月22日,微软宣布将 Python (流行的编程语言) 引入了 Excel,将 Python 强大的数据分析 & 可视化库与 Excel结合了起来。

这项功能已经在公共预览版中推出,用户可以在Excel中使用 Python 库来操作和浏览数据,然后使用Excel的公式、图表和数据透视表来进一步生成更详细的数据洞察。

不过,使用这项功能需要加入 Microsoft 365 Insider 计划,并按照说明将 Excel 更新到最新版本 ⋙ Microsoft Blog | Join the Microsoft 365 Insider Program

🤖 OpenAI GPT-3.5 Turbo 推出微调功能,开发者能定制大模型

8月22日,OpenAI 发布了 GPT-3.5 Turbo 的微调和API更新,而 GPT-4 的微调也将在今年秋季推出。这次更新使开发者能够定制更适合他们用例的模型,并能够大规模运行这些定制模型。

本次更新的早期测试显示,经过微调的 GPT-3.5 Turbo 可以在某些任务上匹配甚至超越基础GPT-4的能力。

与所有API一样,发送到微调API的数据归客户所有,OpenAI或任何其他组织都不会使用它来训练其他模型 ⋙ OpenAI Blog | 中文解读

🤖 设计师到底如何使AIGC介入工业化生产

这是一篇科普+行业经验分享的文章,作者结合自己的工作经验讲述了如何训练适合业务的模型,不同业务对AI介入程度的要求,以及盈利方向和AI对个人工作的影响。整体来说这篇文章非常值得一读:

不同 AIGC 软件效果图

▢ 比较了 Midjourney 和 Stable Diffusion 两种主流 AIGC 软件的生成效果,Midjourney 的图像更精细细腻,Stable Diffusion质量稍差

原理阐述&软件选择

▢ 开源意味着可以自由选择改造技术。因此大多情况下,适合工业化应用的 AIGC 软件是 Stable Diffusion

AIGC 工业化到底是什么

▢ 在项目画风一致前提下,快速大量生成图像,以解决具体需求,减少人工成本,提升工作效率

▢ 需求量越大、要求越低的业务,AIGC 应用价值越大

举个例子

▢ 第一步:训练符合特定画师风格的模型

▢ 第二步:结合软件完成多样个性化需求,包含「文生图法」「图生图法」

不同业务的AI介入程度

▢ 想法越多确定性越强,AI介入越少;买量向产品AI可大幅提升20%-30%效率

▢ 更看重审美品位和需求理解能力,技术要求较低

盈利方向

▢ 重点是发掘AI的商业应用方向,而非仅专注AI技术

▢ 直接盈利不易,可考虑打包应用来实现商业化

AI对我个人影响

▢ AI出现使产品要求变化,需要学习探索用户需求

▢ 需要关注内容和故事性,单一画面不够,需要有效连接表达内容 ⋙ 阅读原文

🤖 Anthropic创始人访谈:Scaling与强化学习,可解释性与AGI安全

Anthropic 是 LLM 赛道排名第二的公司,今年 7 月,Anthropic 推出了最新一代模型 Claude 2。

Dario Amodei 是 Anthropic CEO,是一位非常低调的AI公司CEO,几乎不参加公开访谈、也很少在 Twitter 上发表观点。这是他很难得的接受播客访谈,并详细解释了 Anthropic 在可解释性上的关注和投入。

在访谈中,Dario 解释了 Anthropic 在可解释性上的关注和投入,并认为AI Safety 和 alignment 同等重要,一旦 alignment 出现问题,就应该以同样高度重视滥用带来的 AI 安全问题。

可解释性是保证模型安全的重要途径之一, 类似于给模型照 X 光、做 MRI 检查,让研究人员有可能了解模型内部在发生什么、识别风险的可能来源。要真正理解 Scaling Law 为什么会起作用、以及如何实现 alignment 都离不开可解释性。

原文非常长,目录如下,感兴趣可以阅读全文:

1. 为什么 Scaling Law 会起作用

2. 模型能力将如何和人类看齐?

3. Alignment:可解释性是给模型「照 X 光」

4. AGI 安全:AI Safety 与 网络安全

5. 商业化与 Long Term Benefit Trust ⋙ Youtube访谈视频 | 文字版(中文)

🤖 LangChain+向量数据库的 LLM 产品应用课程

「LangChain & Vector Databases in Production」是一门面向工程师和技术专家的免费课程,主要介绍如何使用 LangChain 框架和深湖 (Deep Lake) 向量数据库,来构建基于大型语言模型的应用。

课程包含10+实战项目,预计完成学习时间在 25-40 小时之间,需要学习者具备 Python 和 Jupyter Notebook 的基础知识,可以支持完成以下学习目标,是一门非常不错的课程:

▢ 掌握 LLM 的基础理论和向量数据库的运用,能够顺利地将 LLM 应用到生产环境中,利用API和提示工程进行优化

▢ 学习使用 LangChain 构建实用的 LLM 应用,利用LangChain的链和代理以及 Deep Lake 的全部能力

▢ 掌握唯一的多模态向量数据库Deep Lake的使用,可以构建文本、图像、视频等所有AI数据的终极数据壁垒

1. LangChain入门:从零到英雄

2. 认识彼此

3. 大型语言模型和LangChain

4. 学习提示方法

5. 使用索引组织知识

6. 使用链将组件组合在一起

7. 赋予LLM记忆能力

8. 使用工具使LLM与世界互动

9. 将语言模型用作推理引擎的代理 ⋙ 课程页面

🤖 业内顶尖的 LLM 与 Transformer 主题座谈会,跟进领域最新研究进展

这是一门由西蒙斯计算理论研究所举办的为期一周的研讨会,由多位该领域顶尖的学者主讲,目的是讨论大型语言模型和 Transformer 的最新研究进展。

研讨会聚集了该领域的专家学者,通过学术报告、小组讨论和问答环节,交流大语言模型和 Transformer 模型在自然语言处理、计算机视觉等领域的最新理论与应用研究。

研讨会内容涵盖理论模型、算法创新、应用探索等方面。该研讨会对推动该领域技术发展具有重要意义。

1. 人工智能的火花

2. 不可能的可能与可能的不可能

3. 实现大型语言模型的可靠使用:更好的检测、一致性和指令调优

4. 对泛化能力的观察

5. 小组讨论 (Alexei Efros主持)

6. 理解神经网络缩放定律的起源和分类

7. 受数据约束的语言模型缩放

8. 语言模型中复杂技能出现的理论

9. 通过符号蒸馏实现解释性

10. 构建生态系统而不是整体

11. 如何使用自我对弈使语言模型在解决编程难题上有改进

12. 大型语言模型遇上版权法

13. 小组讨论 (Shafi Goldwasser主持)

14. 语言模型中的本地化

15. 语言模型既是统计学家,也是适应性生物

16. 对齐的语言模型是否“对抗对齐”?

17. 形式化解释神经网络行为

18. 大型语言模型时代的意义

19. 将语言整合到智能体系结构中

20. 超越语言:扩大机器人本体论

21. LLM是自然语言处理的开始还是结束?

22. 大型语言模型时代的人机交互

23. 大型语言模型的水印

24. 情景学习:简单函数类的案例研究

25. 预训练任务多样性和非贝叶斯情境学习在回归中的出现

26. 转换器是否必要?一种关于泛化的数据中心视角 ⋙ 课程页面 | Youtube视频学习

感谢贡献一手资讯、资料与使用体验的 ShowMeAI 社区同学们!

◉ 点击 👀日报&周刊合集,订阅话题 #ShowMeAI日报,一览AI领域发展前沿,抓住最新发展机会!

◉ 点击 🎡生产力工具与行业应用大全,一起在信息浪潮里扑腾起来吧!